- •3.1. Постановка задачи 23

- •5.1. Постановка задачи 41

- •6.1. Постановка задачи 48

- •7.1. Постановка задачи 59

- •9.1. Постановка задачи 81

- •Введение

- •Тема 1. Элементы теории погрешностей

- •1.1. Точные и приближенные числа

- •1.2. Абсолютная и относительная погрешность

- •Тема 2. Методы решения нелинейных уравнений

- •2.1. Постановка задачи

- •Отделение корней (локализация корней);

- •Уточнение корней.

- •2.2. Отделение корней

- •2.2.1. Графическое отделение корней

- •2.2.2. Аналитическое отделение корней

- •2.3. Уточнение корней

- •2.3.1. Метод половинного деления

- •2.3.2. Метод итерации

- •2.3.3. Метод Ньютона (метод касательных)

- •2.3.4. Метод хорд

- •Тема 3. Интерполяция функций

- •3.1. Постановка задачи

- •3.2. Интерполяционная формула Лагранжа

- •3.3. Интерполяционные формулы Ньютона

- •3.3.1. Конечные разности

- •3.3.2. Первая интерполяционная формула Ньютона

- •3.3.3. Вторая интерполяционная формула Ньютона

- •3.4. Сплайн – интерполяция

- •Тема 4. Аппроксимация функций

- •4.1. Постановка задачи аппроксимации

- •4.2. Метод наименьших квадратов

- •Тема 5. Численное интегрирование

- •5.1. Постановка задачи

- •5.2. Методы прямоугольников

- •5.3. Формула трапеций

- •5.4. Формула Симпсона

- •5.5. Оценка погрешности численного интегрирования

- •Тема 6. Методы решения обыкновенных дифференциальных уравнений

- •6.1. Постановка задачи

- •6.2. Метод Эйлера

- •6.3. Методы Рунге-Кутты

- •6.4. Решение оду n-го порядка

- •Тема 7. Одномерная оптимизация

- •7.1. Постановка задачи

- •7.2. Метод прямого перебора с переменным шагом

- •7.3. Метод дихотомии

- •7.4. Метод золотого сечения

- •7.5. Метод средней точки

- •Тема 8. Многомерная оптимизация

- •8.1. Постановка задачи и основные определения

- •8.2. Методы спуска

- •8.3. Метод градиентного спуска с дроблением шага

- •8.4. Метод наискорейшего спуска

- •8.5. Метод покоординатного спуска

- •Тема 9. Методы решения систем линейных уравнений

- •9.1. Постановка задачи

- •9.2.Метод Гаусса

- •9.3. Метод итераций

- •Список литературы

8.4. Метод наискорейшего спуска

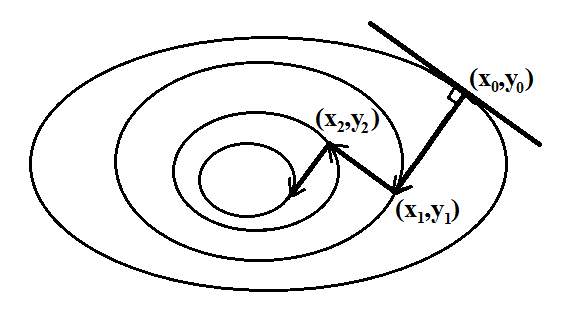

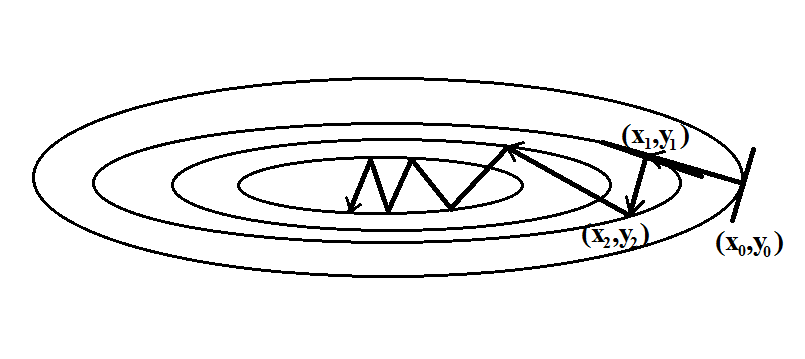

Суть метода состоит в следующем. Из выбранной точки (x0,y0) спуск осуществляют в направлении антиградиента до тех пор, пока не будет достигнуто минимальное значение целевой функции Q(x, y) вдоль луча (рис.8.4-1). В найденной точке луч касается линии уровня. Затем из этой точки спуск проводится в направлении антиградиента (перпендикулярном линии уровня) до тех пор, пока соответствующий луч не коснется в новой точке, проходящей через нее линии уровня, и т.д.

Рис. 8.4-1

Выразим целевую функцию Q(x, y) через шаг l. При этом представим целевую функцию на определенном шаге как функцию одной переменной, т.е. величины шага

Величина

шага на каждой итерации определяется

из условия минимума функции

:

:

=

min(

=

min( (l))

lk

= l*(xk,

yk),

l>0.

(l))

lk

= l*(xk,

yk),

l>0.

Таким образом, на каждой итерации выбор шага lk предполагает решение задачи одномерной оптимизации. По способу решения этой задачи различают:

аналитический метод (НСА);

численный метод (НСЧ).

В

методе НСА значение шага получают из

условия

,

а в методе НСЧ величину lk

находят на отрезке [0;1]c

заданной точностью, используя один из

методов одномерной оптимизации.

,

а в методе НСЧ величину lk

находят на отрезке [0;1]c

заданной точностью, используя один из

методов одномерной оптимизации.

Пример 8.4-1. Найти минимум функции Q(x,y)=x2 + 2y2 с точностью e=0.1, при начальных условиях: x0=2; y0=1.

Проделаем одну итерацию методом НСА.

В ыразим

целевую функцию через величину l:

ыразим

целевую функцию через величину l:

=(x-2lx)2+2(y-4ly) 2 = x2-4lx2+4l2x2+2y2-16ly2+32l2y2.

Из

условия

¢(l)=0

найдем значение l*:

Полученная функция l=l(x,y) позволяет найти значение l. При x=2 и y=1 имеем l=0.3333.

Вычислим значения координат следующей точки:

Проверим выполнение критерия окончания итераций при k=1:

Поскольку |2*0.6666|>0.1 и |-0.3333*4|>0.1 , то условия окончания процесса итераций не выполнены, т.е. минимум не найден. Поэтому следует вычислить новое значение l при x=x1 и y=y1 и получить координаты следующей точки спуска. Вычисления продолжаются до тех пор, пока не выполнятся условия окончания спуска.

Отличие численного метода НС от аналитического состоит в том, что поиск значения l на каждой итерации происходит одним из известных численных методов одномерной оптимизации (например, методом дихотомии или методом золотого сечения). При этом в качестве интервала неопределенности служит диапазон допустимых значений l€ [0;1].

8.5. Метод покоординатного спуска

Выбор антиградиента в качестве направления спуска к минимуму, к сожалению, не всегда является удачным. Градиентный метод сходится достаточно быстро, если для минимизируемой функции поверхности уровня близки к сферам (при m=2 линии уровня близки к окружностям). Однако если поверхности уровня функции сильно вытянуты в некоторых направлениях, что характерно для «овражных» функций, градиентный метод сходится крайне медленно.

У

таких функций (в двумерном случае)

рельеф поверхности U=Q(x1,x2)

напоминает рельеф местности с оврагом.

Поэтому такие функции называют

«овражными».

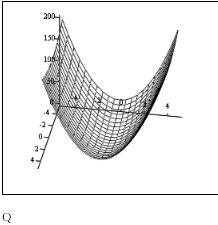

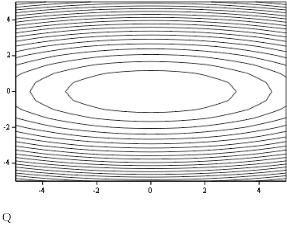

На рис.8.5-1 приведены графики поверхности

и линий уровня «овражной» функции

.

.

|

|

Рис. 8.5-1

Вдоль направлений, характеризующих «дно оврага», «овражная» функция меняется незначительно, а в других направлениях, характеризующих «склон оврага», происходит резкое изменение значений функции.

Если начальная точка Х0 попадает на «склон оврага», то направление градиентного спуска оказывается почти перпендикулярным «дну оврага» и очередное приближение Х1 попадает на противоположный «склон оврага». Следующий шаг в направлении ко «дну оврага» возвращает приближение Х2напротивоположный «склон оврага» и т.д. В результате вместо того, чтобы двигаться вдоль оврага (в направлении точки минимума), траектория спуска совершает зигзагообразные скачки поперек «оврага» (рис.8.5-2).

Рис. 8.5-2.

Один из существенных недостатков градиентного метода связан с его чувствительностью к погрешностям вычислений. Особенно сильно этот недостаток сказывается в малой окрестности точки минимума, где антиградиент, задающий направление поиска, мал по модулю. Поэтому эффективность градиентного метода на завершающей стадии существенно ниже, чем на начальной стадии.

Проблему «оврагов» позволяет решать, например, метод циклического покоординатного спуска. В этом методе в качестве очередного направления спуска выбирают направление одной из координатных осей.

Рассмотрим n+1 цикл одного из вариантов этого метода, считая, что n–ое приближение (Хn) к минимуму функции Q(X)=Q(x1, … xm) уже найдено.

1-й шаг. На первом шаге проводят спуск по координате x1. Значения остальных координат x2 = x2(n) , x3 = x3(n) , … , xm= xm(n) фиксируют, а x1(n) выбирают из условия:

Q(x1(n+1) , x2(n) … xm(n) ) = min Q(x1, x2(n) … xm(n) )

Фактически решается задача минимизации функции одной переменной

Q(x1) = min Q(x1, x2(n) … xm(n) ).

2-шаг. На втором шаге производится спуск по координате x2. Значения остальных координат x1 = x1(n) , x3 = x3(n), … , xm= xm(n) фиксируют, а x2(n+1) выбирают как решение задачи одномерной оптимизации

Q(x1(n+1), x2(n+1) , x3(n) … xm(n+1) ) = min Q(x1(n+1), x2, x3(n)… xm(n) ).

Аналогично осуществляют следующие шаги.

На последнем m-ом шаге координату xm(n+1) определяют из условия

Q(x1(n+1) , x2(n+1) , … xm-1(n+1),xm(n+1) ) = minQ(x1(n+1), … xm-1(n+1),xm).

В результате получается очередное приближение x(n+1) к точке минимума.

Далее

цикл метода снова повторяется. Каждый

цикл метода состоит из m

шагов (т.е. по количеству переменных).

Так как на k-том

шаге очередного цикла значение координаты

xk(n+1)

определяют из условия минимизации

функции Q

по направлению xk,

то необходимо, чтобы в точке (x1(n+1)

, x2(n+1)

,

… xk-1(n+1),

xk,

xk+1(n+1)

,

…xm(n+1))

производная

обращалась в ноль.

обращалась в ноль.

На рис. 8.5-3 изображена графическая иллюстрация циклического покоординатного спуска для случая m=2.

|

Рис. 8.5-3

Пример 8.5-1. Найти минимум функции Q(x,y)=x2+10y2-xy-y с точностью e=0.01, при начальных условиях: x0=2; y0=3методом циклического покоординатного спуска.

1-я

итерация:

фиксируем y=y0

;

;

фиксируем

x=x1

2-я

итерация:

фиксируем y=y1

;

;

фиксируем

x=x2

3-я

итерация:

фиксируем y=y2

;

;

фиксируем

x=x3