Методическое пособие 391

.pdf

В этом случае высказыванию <толщина изделия очень маленькая> отвечает нечеткое множество CON(A)= A2 ; высказыванию <толщина изделия не большая или средняя> -

нечеткое множество А2 A3; высказыванию <толщина

изделия не маленькая и не большая> A1 A3.

2.6. Искусственные нейронные сети

Интеллектуальные системы на основе искусственных нейронных сетей позволяют с успехом решать проблемы распознавания образов, прогнозирования, оптимизации, ассоциативной памяти и управления. Традиционные подходы к решению этих проблем не всегда дают необходимую гибкость и много приложений выигрывают от использования нейросетей. Искусственные нейросети являются электронными моделями нейронной структуры мозга, который, главным образом, учится на опыте. Естественной аналог доказывает, что множество проблем, не поддающихся решению традиционными компьютерами, могут быть эффективно решены с помощью нейросетей.

Все перечисленные выше задачи могут сводиться к следующей математической постановке. Необходимо построить отображение X→Y такое, чтобы на каждый возможный входной сигнал X формировался правильный выходной сигнал Y. Отображение задается конечным набором пар «вход – известный выход». Число таких пар (обучающих примеров) существенно меньше общего числа возможных сочетаний значений входных и выходных сигналов. Совокупность всех обучающих примеров носит название обучающей выборки.

В задачах распознавания образов X – некоторое представление образа (изображение, вектор чисел и т.д.), Y – номер класса, к которому принадлежит входной образ. К известным приложениям относятся распознавание букв,

51

распознавание языка, классификация сигнала электрокардиограммы, классификация клеток крови.

Кластеризация/категоризация. При решении задачи кластеризации, обучающее множество не имеет меток классов. Алгоритм кластеризации основан на подобии образов и помещает похожие образы в один кластер. Известны случаи применения кластеризации для добычи знаний, сжатия данных

иисследования свойств данных.

Взадачах управления X – набор контролируемых параметров управляемого объекта, Y – код, определяющий управляющее воздействие, соответствующее текущим значениям контролируемых параметров.

Взадачах прогнозирования в качестве входных сигналов используются временные ряды, представляющие значения контролируемых переменных на некотором интервале времени. Выходной сигнал – множество переменных, которое является подмножеством входного сигнала.

Таким образом, большая часть прикладных задач может быть сведена к реализации некоторого сложного многомерного функционального преобразования. В результате построения такого отображения необходимо добиться того, чтобы обеспечивалось формирование правильных выходных сигналов в соответствии со всеми примерами обучающей выборки и формирование правильных выходных сигналов в соответствии со всеми возможными входными сигналами, которые не вошли в обучающую выборку. Это может быть реализовано с применением аппарата искусственных нейронных сетей.

Продолжительный период эволюции придал мозгу человека много качеств, отсутствующих в современных компьютерах с архитектурой фон Неймана. К ним можно отнести распределенное представление информации и параллельные вычисления, способность к обучению и обобщению, адаптивность, толерантность к ошибкам, низкое энергопотребление. Приборы, построенные на принципах биологических нейронов, имеют перечисленные

52

характеристики, которые можно считать существенным достижением в индустрии обработки данных.

Базовым элементом мозга человека являются специфические клетки, известные как нейроны, способные запоминать, думать и применять предыдущий опыт к каждому действию, что отличает их от остальных клеток тела. Кора головного мозга человека является плоской, образованной из нейронов поверхностью, толщиной от 2 до 3 мм и площадью около 2200 см2, что вдвое превышает площадь поверхности стандартной клавиатуры. Кора главного мозга содержит около 1011 нейронов, что приблизительно равно числу звезд Млечного пути. Каждый нейрон связан с 103 – 104 другими нейронами. В целом мозг человека имеет приблизительно от 1014 до 1015 взаимосвязей. Сила человеческого ума зависит от числа базовых компонент, многообразия соединений между ними, а также от генетического программирования и обучения.

Индивидуальный нейрон является сложным, имеет свои составляющие, подсистемы и механизмы управления и передает информацию через большое количество электрохимических связей. Насчитывают около сотни разных классов нейронов. Вместе нейроны и соединения между ними формируют недвоичный, нестойкий и несинхронный процесс, отличающийся от процесса вычислений традиционных компьютеров. Искусственные нейросети моделируют лишь главнейшие элементы сложного мозга.

Биологический нейрон (нервная клетка) состоит из тела клетки – сомы (soma), и двух типов внешних древовидных ответвлений: аксона (axon) и дендритов (dendrites). Тело клетки содержит ядро (nucleus), где находится информация про свойства нейрона, и плазму, которая производит необходимые для нейрона материалы. Нейрон получает сигналы (импульсы) от других нейронов через дендриты (приемника) и передает сигналы, сгенерированные телом клетки, вдоль аксона (передатчик), который в конце разветвляется на волокна

53

(strands). На окончаниях волокон находятся синапсы (synapses) (рис. 13).

Дендрит

Сома

Аксон

Синапсы

Рис. 13. Схема биологического нейрона

Синапс является функциональным узлом между двумя нейронами (волокно аксона одного нейрона и дендрит другого). Когда импульс достигает синаптического окончания, вырабатываются химические вещества, называемые нейротрансмиттерами. Нейротрансмиттеры проходят через синаптичную щель, и в зависимости от типа синапса, возбуждают или тормозят способность нейрона-приемника генерировать электрические импульсы. Результативность синапса настраивается проходящими через него сигналами, поэтому синапсы обучаются в зависимости от активности процессов, в которых они принимают участие. Нейроны взаимодействуют с помощью короткой серии импульсов. Сообщение передается с помощью частотно-импульсной модуляции.

Последние экспериментальные исследования доказывают, что биологические нейроны структурно сложнее, чем упрощенное объяснение существующих искусственных нейронов, которые являются элементами современных искусственных нейронных сетей. Поскольку нейрофизиология

54

предоставляет ученым расширенное понимание действия нейронов, а технология вычислений постоянно совершенствуется, разработчики сетей имеют неограниченное пространство для улучшения моделей биологического мозга.

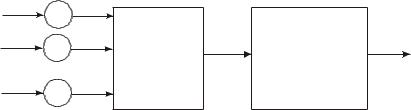

Базовый модуль нейронных сетей – искусственный нейрон – моделирует основные функции естественного нейрона (рис. 14).

Входные сигналы xn, взвешенные весовыми коэффициентами соединения wn, складываются, проходят через передаточную функцию, генерируют результат и выводятся.

В имеющихся сейчас пакетах программ искусственные нейроны называются «элементами обработки» и имеют больше возможностей, чем простой искусственный нейрон, описанный выше. На рис. 15 изображенная детальная схема упрощенного искусственного нейрона.

X0 |

W0 |

|

X1 |

||

W1 |

||

X2 |

||

W2 |

||

|

||

Xn |

Wn |

|

|

Сумматор

Передаточная

функция

Выход

Рис. 14. Базовый искусственный нейрон

Модифицированные входы передаются на функцию суммирования, которая преимущественно только суммирует произведения. Можно выбрать различные операции, такие как среднее арифметическое, наибольшее, наименьшее, OR, AND, и т.п., что вырабатывают разные значения. Большинство коммерческих программ разрешают инженерампрограммистам создавать собственные функции сумматора с

55

помощью подпрограмм, закодированных на языке высокого уровня.

|

|

Функции сумматора |

Передаточная функция |

|

X1 |

W1 |

Сумма |

Гиперболический |

|

|

|

|

||

X2 |

W2 |

Максимум |

тангенс |

|

|

Минимум |

Линейная |

|

|

|

|

Среднее |

Сигмоида |

Выход |

|

|

И |

Синус |

|

Xn |

Wn |

|

||

ИЛИ |

|

|

||

|

|

|

Рис. 15. Модель нейрона

Иногда функция суммирования усложняется добавлением функции активации, разрешающей функции суммирования действовать во времени. Как правило, сумматор реализует функцию вида:

n |

|

S w0 wi xi , |

(2) |

i 1 |

|

где xi - значения информационных входов, wi - веса, w0 -

смещение.

Значение S, вычисленное сумматором, подается на вход активизационной функции, которая и вычисляет выходное значение (возбуждение) нейрона. Конкретный вид преобразующей (передаточной) функции подбирается с учетом специфики решаемой задачи. На практике используют более десятка видов преобразующей функции. Чаще всего берут сигмоидную функцию:

Y f (s) |

1 |

, |

(3) |

|

|||

1 e s |

|

|

|

56 |

|

|

|

где α – управляющий параметр, его значения лежат на отрезке [0, +∞]. Значения S могут быть любыми, но для примера взяты [-1, +1] (соответственно и значения α будут другими при других S). Выходные значения Y лежат в диапазоне [0…1]. При уменьшении α сигмоид становится более пологим, в пределе при α=0 вырождается в горизонтальную линию на уровне 0,5. При увеличении α сигмоид приближается по внешнему виду к функции единичного скачка с порогом в точке s=0 (рис. 16).

Y |

|

Y |

|

Y |

|

1 |

|

1 |

|

1 |

|

0 |

S |

0 |

S |

0 |

S |

=3 |

|

=55 |

|

=0 |

|

Рис. 16. Сигмоидная функция

Одно из важных свойств сигмоидной функции – простое выражение для ее производной:

f '(s) f (s)(1 f (s)). |

(4) |

Сигмоидная функция дифференцируема на всей оси абсцисс, что используется в некоторых алгоритмах обучения. Кроме того, она обладает свойством усиливать слабые сигналы лучше, чем большие, и предотвращает насыщение от больших сигналов, так как они соответствуют областям аргументов, где сигмоид имеет пологий наклон.

Отличительной особенностью обработки сигналов в искусственных нейронных сетях (ИНС) является принцип параллельной обработки, который достигается путем объединения большого числа нейронов в так называемые слои и соединения определенным образом нейронов различных слоев, а также, в некоторых конфигурациях, и нейронов одного слоя между собой, причем обработка взаимодействия всех нейронов ведется послойно.

57

ИНС – это набор нейронов, соединенных между собой. Как правило, передаточные функции всех нейронов в сети фиксированы, а веса являются параметрами сети и могут изменяться. Задача построения ИНС решается в два этапа: выбор архитектуры сети и обучение сети (подбор весов).

Для решения разных практических задач требуются различные модели нейронных сетей. Модель нейронной сети определяется моделями нейронов и структурой связей сети.

ИНС может рассматриваться как направленный граф со взвешенными связями, в котором искусственные нейроны являются узлами. По архитектуре связей ИНС могут быть сгруппированы в два класса: сети прямого распространения, в которых графы не имеют петель, и рекуррентные сети, или сети с обратными связями.

С точки зрения топологии, среди нейронных сетей можно выделить три основные типа: полносвязные сети, многослойные или слоистые сети и слабосвязные сети (нейронные сети с локальными связями).

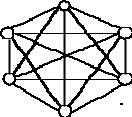

Полносвязные сети представляют собой ИНС, каждый нейрон которой передает свой выходной сигнал остальным нейронам, в том числе и самому себе. Все входные сигналы подаются всем нейронам. Выходными сигналами сети могут быть все или некоторые выходные сигналы нейронов после нескольких тактов функционирования сети. На каждом такте функционирования сети на входы нейронов подается внешний входной сигнал и выходы нейронов предыдущего такта (рис. 17).

Рис. 17. Графическое представление полносвязной нейронной сети

58

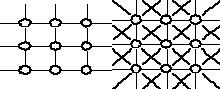

Среди известных архитектурных решений выделяют группу слабосвязанных нейронных сетей, когда каждый нейрон сети связан лишь с соседними (рис. 18).

Рис. 18. Графическое представление слабосвязной нейронной сети

Самым распространенным вариантом архитектуры являются многослойные сети (рис. 19). Нейроны в данном случае объединяются в слои с единым вектором входных сигналов. Внешний входной вектор подается на входной слой нейронной сети (рецепторы). Выходами нейронной сети являются выходные сигналы последнего слоя (эффекторы). Кроме входного и выходного слоев, нейросеть имеет один или несколько скрытых слоев нейронов, не имеющих контактов с внешней средой. Число нейронов в каждом слое может быть произвольным и никак не связано с количеством нейронов в других слоях. Связи от выходов нейронов некоторого слоя m к входам нейронов следующего слоя (m+1) называются последовательными. Различают несколько типов связей между слоями с номерами m и (m+s): последовательные (s=1), прямые ( s>1), обратные (s<0). Связи между нейронами одного слоя называют латеральными (боковыми).

Для оценки числа нейронов в скрытых слоях однородных (с единой функцией активации для всех нейронов) нейронных сетей можно воспользоваться формулой для оценки необходимого числа синаптических весов Lw (в многослойной сети с сигмоидальными передаточными функциями):

59

m N |

|

L |

w |

m ( |

|

N |

1)(n m 1) m, |

(5) |

|||||||||||||||||||||||||||||||||||

1 log2 N |

|

|

|

|

|

||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

m |

|

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Рис.19. Графическое представление многослойной нейронной сети

где n – размерность входного сигнала, m – размерность выходного сигнала, N – число элементов обучающей выборки.

Оценив необходимое число весов, можно рассчитать число нейронов в скрытых слоях:

L |

Lw |

. |

|

|

|

|

|

|

|||||

|

|

n m |

|

|||

2(L n m) N 10(L n m). |

(6) |

|||||

N |

n m L |

N |

n m. |

|

||

10 |

|

|

||||

|

2 |

|

|

|||

Выбор структуры НС осуществляется в соответствии с особенностями и сложностью задачи. Для решения некоторых отдельных типов задач уже существуют оптимальные, на сегодняшний день, конфигурации. Если же задача не может быть сведена ни к одному из известных типов, разработчику приходится решать сложную проблему синтеза новой конфигурации. При этом он руководствуется несколькими основополагающими принципами: возможности сети возрастают с увеличением числа ячеек сети, плотности связей между ними и числом выделенных слоев; введение обратных

60