- •1. Причинность, регрессия, корреляция.

- •Корреляционно – регрессионный анализ. Линейная парная регрессия.

- •Оценка линейного коэффициента корреляции

- •Шкала Чеддока

- •Показатели работы некоторых сельскохозяйственных предприятий Тамбовской области (данные условные)

- •Расчетная таблица

- •Нелинейная парная корреляция.

- •Производство и себестоимость продукции на одном из заводов Тамбовской области в 2011 году

- •Расчетная таблица

- •4. Множественная регрессия.

- •Исходные данные

- •Расчётная таблица

- •5. Непараметрические методы анализа.

- •Вспомогательная таблица для расчёта коэффициента взаимной сопряжённости

- •Зависимость освоения «Статистики» от типа школы, которую закончили студенты

- •Расчётная таблица

- •Расчётная таблица

- •Расчетная таблица

ТЕМА: «Статистическое изучение взаимосвязи социально-экономических явлений. Корреляционно-регрессионный анализ».

Причинность, регрессия, корреляция.

Корреляционно – регрессионный анализ. Линейная парная регрессия.

Нелинейная парная корреляция.

Множественная регрессия.

Непараметрические методы анализа.

1. Причинность, регрессия, корреляция.

Исследование объективно существующих связей между явлениями – важнейшая задача теории статистики.

Связи между признаками и явлениями, ввиду их большого разнообразия, классифицируются по ряду оснований. Признаки по их значению для изучения взаимосвязи делятся на два класса. Признаки, обусловливающие изменения других, связанных с ними признаков, называются факторными, или просто факторами. Признаки, изменяющиеся под действием факторных признаков, называют результативными.

Из множества разнообразных форм проявления взаимосвязей в качестве двух самых общих видов выделяют функциональную (полную) и корреляционную (неполную) связи. В первом случае величине факторного признака строго соответствует одно и только одно значение результативного признака. Корреляционная связь проявляется в среднем для массовых наблюдений, когда заданным значениям зависимой переменной соответствует некоторый ряд вероятных значений независимой переменной.

Связи между явлениями и их признаками классифицируются по степени тесноты, по направлению и по аналитическому выражению.

По степени тесноты связи различают количественные критерии оценки тесноты связи (в соответствии со шкалой Чеддока, о чём речь пойдёт в дальнейшем).

По направлению связи бывают прямыми и обратными, положительными и отрицательными. При прямой связи с увеличением или уменьшением значений факторного признака происходит увеличение или уменьшение значений результативного. Например, увеличение степени механизации труда способствует росту рентабельности строительного производства. В случае обратной связи значения результативного признака изменяются в противоположном направлении по сравнению с изменением факторного признака. Так, с увеличением уровня фондоотдачи снижается себестоимость единицы производимой продукции.

Относительно своей аналитической формы связи могут быть линейные и нелинейные. Если статистическая связь между явлениями приближенно выражена уравнением прямой линии, то её называют линейной связью; если же она выражена уравнением какой – либо кривой линии (параболы, гиперболы: степенной, показательной и т. д.), то такую связь называют нелинейной или криволинейной.

Для выявления наличия связи, ее характера и направления используют методы: приведения параллельных данных, аналитических группировок, графический, корреляции.

Корреляция – это статистическая зависимость между случайными величинами, не имеющими строго функционального характера, при которой изменение одной из случайных величин приводит к изменению ожидания другой.

В статистике принято различать следующие варианты зависимостей:

1. Парная корреляция – связь между признаками (результативным и факторным признаками или двумя факторными).

2. Частная корреляция - зависимость между результативным и факторным признаками при фиксированном значении других факторных признаков.

3. Множественная корреляция – зависимость результативного и двух или более факторных признаков, включенных в исследование.

Корреляционно – регрессионный анализ. Линейная парная регрессия.

Корреляционно-регрессионный анализ включает в себя измерение тесноты, направление связи и установление аналитического выражения связи.

Одним из методов корреляционно-регрессионного анализа является метод парной корреляции, рассматривающий влияние вариации факторного признака Х на результативный У. Аналитическая связь между ними описывается уравнениями:

прямой ![]()

параболы ![]()

гиперболы ![]()

Если результативный и факторный признаки возрастают одинаково, примерно в арифметической прогрессии, то это свидетельствует о наличии линейной связи между ними, а при обратной связи – гиперболической. Если результативный признак увеличивается в арифметической прогрессии, а факторный значительно быстрее, то используется параболическая или степенная функции.

Оценка параметров

уравнения регрессии ао

и а1

осуществляется

методом наименьших квадратов, в основе

которого лежит требование минимальности

сумм квадратов отклонений эмпирических

данных Yi

от выровненных (теоретических)

![]() :

:

![]() min

(1)

min

(1)

Система нормальных уравнений для нахождения параметров линейной парной регрессии имеет вид:

![]()

(2)

(2)

![]()

Для оценки типичности параметров уравнения регрессии используется t – критерий Стьюдента. При этом вычисляются значения t- критерия:

для параметра

![]()

![]() (3)

(3)

для параметра

![]()

![]() (4)

(4)

В формулах (3) и (4):

(5)

(5)

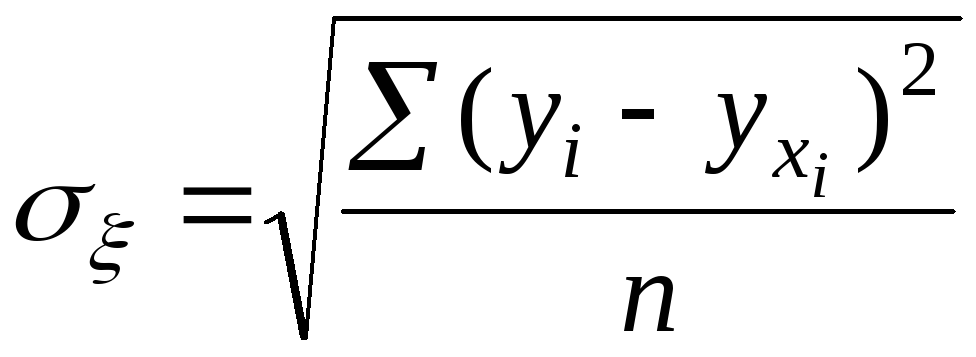

σξ- среднее

квадратическое отклонение результативного

признака

![]() от

выровненных значений

от

выровненных значений![]() :

:

![]() (6)

(6)![]()

σX-

среднее квадратическое отклонение

факторного признака

![]() от

общей средней

от

общей средней![]() .

.

Полученные по

формулам (3) и (4) фактические значения

![]() и

и

![]() сравниваются с критическим

сравниваются с критическим

![]() ,

который получают по таблице Стьюдента

с учетом принятого уровня значимости

,

который получают по таблице Стьюдента

с учетом принятого уровня значимости![]() и числа степеней свободы

и числа степеней свободы

![]() .

.

Полученные при анализе корреляционной связи параметры уравнения регрессии признаются типичными, если t фактическое больше t критического

![]() (7)

(7)

По проверенным на типичность параметрам уравнения регрессии производится построение математической модели связи. При этом параметры примененной в анализе математической функции получают соответствующие количественные значения: параметр а0 показывает усредненное влияние на результативный признак неучтенных (не выделенных для исследования) факторов; параметр а1 – на сколько изменяется в среднем значение результативного признака при изменении факторного на единицу его собственного измерения.

Проверка практической значимости синтезированных в корреляционно-регрессивном анализе математических моделей осуществляется посредством показателей тесноты связи между признаками х и у.

Для статистической оценки тесноты связи применяются следующие показатели вариации:

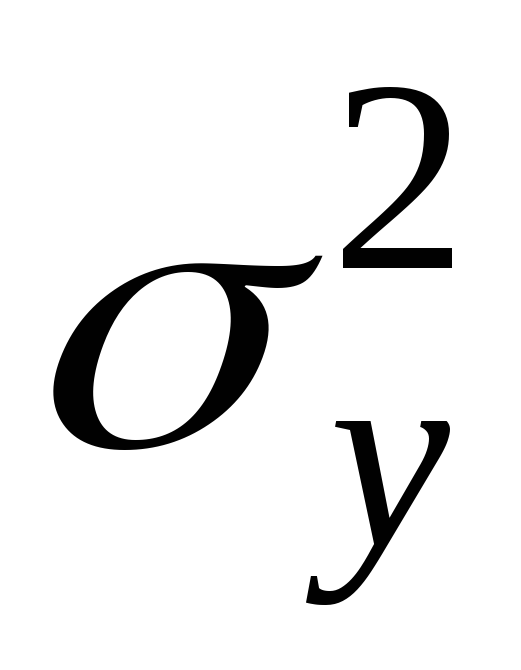

общая дисперсия результативного признака

,

отображающая общее влияние всех факторов

,

отображающая общее влияние всех факторов

![]() (8)

(8)

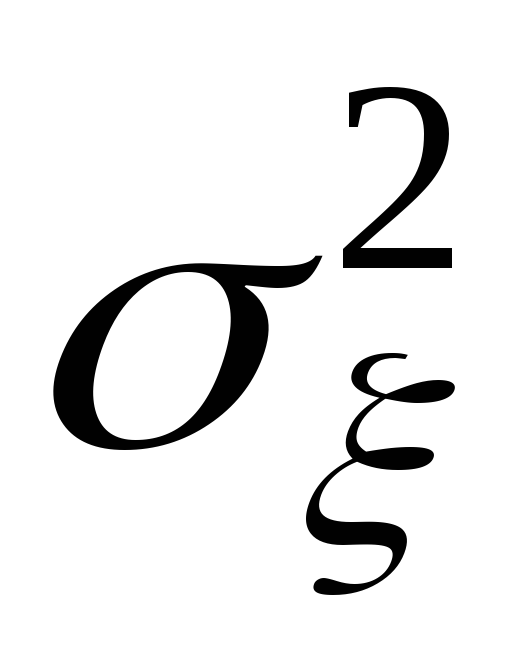

факторная дисперсия результативного признака

,

отражающая вариациюy

только от воздействия изучаемого

фактора x

,

отражающая вариациюy

только от воздействия изучаемого

фактора x

![]() (9)

(9)

Формула (9)

характеризует отклонение выровненных

значений

![]() от их общей средней величины

от их общей средней величины

![]() ;

;

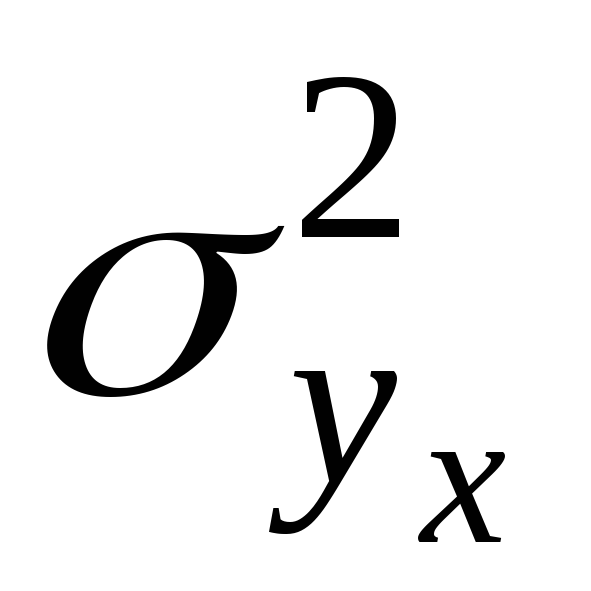

остаточная дисперсия

,

отражающая вариацию результативного

признакаy

от всех прочих, кроме x,

факторов

,

отражающая вариацию результативного

признакаy

от всех прочих, кроме x,

факторов

![]() (10)

(10)

Формула (10)

характеризует отклонения эмпирических

(фактических) значений результативного

признака yi

от их выровненных значений

![]() .

.

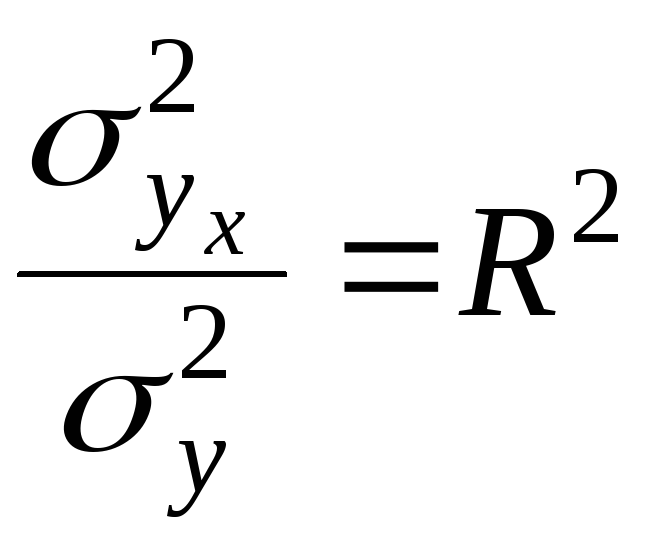

Соотношение между факторной и общей дисперсиями характеризует меру тесноты связи между признаками x и y

(11)

(11)

Показатель R2 называется индексом детерминации (причинности). Он выражает долю факторной дисперсии, т.е. характеризует, какая часть общей вариации результативного признака y объясняется изменением факторного признака x.

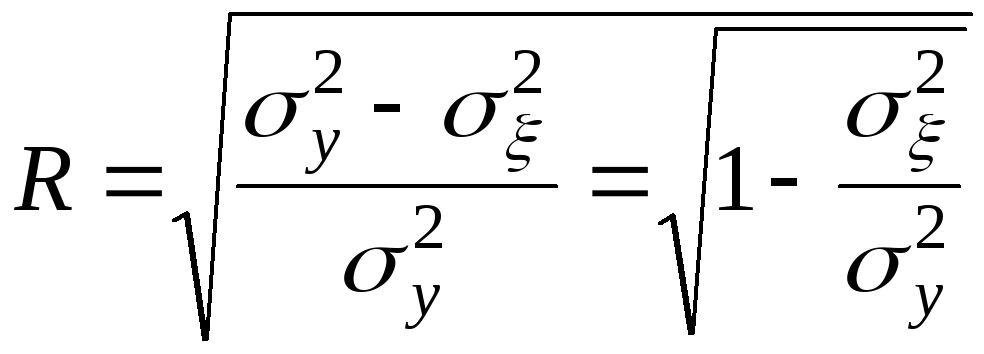

На основе формулы (11) определяется индекс корреляции R

(12)

(12)

Используя правило сложения дисперсии, получают формулу индекса корреляции

(13)

(13)

Формула (71) является основным алгоритмом для определения индекса корреляции с использованием машинной обработки анализируемых данных.

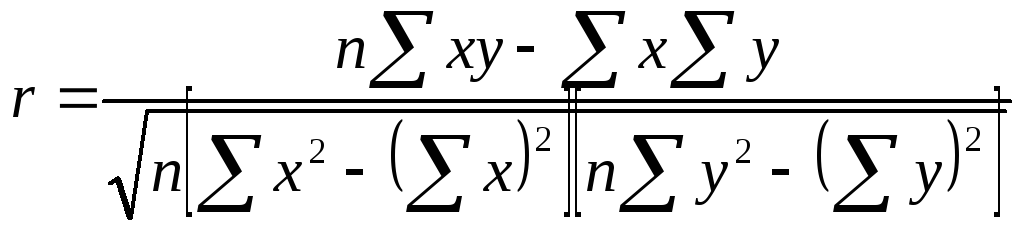

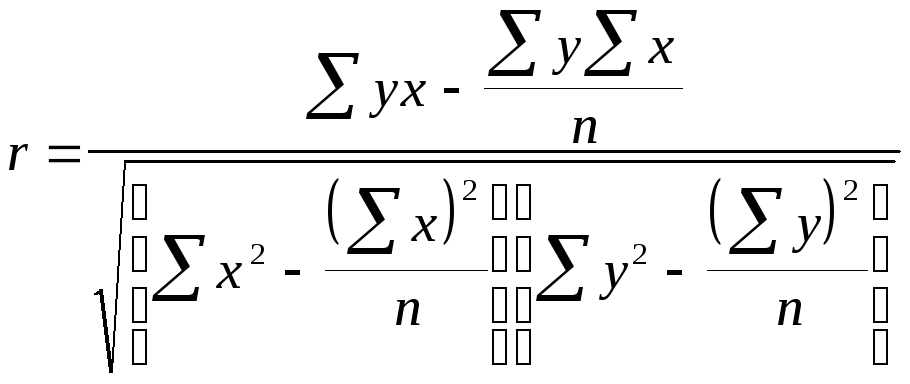

При прямолинейной форме связи показатель тесноты связи определяется по формуле линейного коэффициента корреляции r.

В теории разработаны и на практике применяются различные модификации формулы расчёта данного коэффициента:

![]() ,

где

,

где ![]()

![]()

или

или

(14)

(14)

Заметим, что по абсолютной величине линейный коэффициент корреляции r равен индексу корреляции r только при прямолинейной связи.

Линейный коэффициент корреляции изменяется в пределах от -1 до 1: -1 ≤ r ≤ 1. Знаки коэффициентов регрессии корреляции совпадают. При этом интерпретацию выходных значений коэффициента корреляции можно представить в следующей таблице: