- •1.Жизненный цикл автомобиля.

- •2.Особенности проектирования автомобилей

- •3.Поиск технических решений. Подсистема поиска аналогов.

- •4. Выбор оптимальных вариантов технического решения. Метод отсечения (последовательный анализ)

- •5. Подсистема синтеза технических решений

- •7. Описание проектируемого автомобиля при моделировании

- •8. Этапы формирования математических моделей. Модели структурного уровня.

- •9. Этапы формирования мат моделей. Модели логического уровня

- •10. Этапы формирования мат. Моделей. Модели количественного уровня.

- •11. Отличия аналитических и имитационных моделей.

- •12. Понятие о модельном времени

- •13. Способы изменения модельного времени

- •14. Задачи оптимизации проектных решений. Понятие целевой функции.

- •15. Этапы работы программы метода конечных элементов. Фаза постпроцессорной обработки.

- •16. Регулярные методы минимализации функции (градиентные и сопряженных градиентов)

- •17. Ньютоновские методы минимализации функции

- •18. Квазиньютоновские методы минимизации функции.

- •20. Методы минимизации функций (случайный поиск).

- •Основы метода конечных элементов. Матрица жесткости.

- •Этапы работы программы метода конечных элементов. Фаза препроцессорной обработки и фаза анализа модели.

- •Основы метода конечных элементов. Типы элементов и степени свободы.

- •24. Примеры использования методов конечных элементов (плоская пластина).

- •25. Интегрированная машиностроительная система (сравнение с традиционной, этапы развития, преимущества).

- •26. Процессный способ организации квазипараллелизма в имитационных моделях.

- •27. Способы организации квазипараллелизма в имитационных моделях (просмотр активностей.

- •28. Агрегатный способ организации квазипараллелизма в имитационных моделях

- •29. Способы организации квазипараллелизма в имитационных моделях (составление расписания событий)

- •30. Автоматизированное проектирование и производство кузова автомобиля ( на примере автомобиля Ford).

- •31. Общие сведения о программном пакете adams (назначение, модули, возможности)

- •32. Модуль View программного пакета adams (назначение, возможности, меню, команды)

17. Ньютоновские методы минимализации функции

Метод Ньютона-это методы второго порядка.

Xk+1= xk-{ɸ’’(xk)}-1

Метод Ньютона , имеет очень узкую область сходимости, если их оптим. лежит ближе к Х0.

Недостатки метода Ньютона, частично устр. В модиф. Методе Ньютона.

Xk+1=xk-λк{ɸ’’(xk)}-1ɸ’(xk) λк{ɸ’’(xk)}-1 -это обратная матрица Гессе

λk=min{ɸ(xk-λk(ɸ’’(хк))-1ɸ’(xk)}

В обратной матрице 2-ая производная не должна равняться -0.

Квази-Ньютоновские методы.

Xk+1 = xk-λкƞкφ'(xk)

18. Квазиньютоновские методы минимизации функции.

По конспекту:

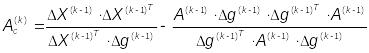

-

матрица, которая расч без использования

второй производной

-

матрица, которая расч без использования

второй производной

!Все что далее, не глядя взято из интернетов, что не совсем похоже на конспект (как минимум по обозначениям), поэтому что писать – выбор ваш!

Квазиньютоновский метод

Описание алгоритма:

Данный метод обладает положительными чертами метода Ньютона, однако, использует информацию только о первых производных. В этом методе приближение к очередной точке в пространстве оптимизируемых параметров задается формулой:

![]()

Направление поиска определяется выражением:

![]() ,

,

где

![]() - матрица порядка

- матрица порядка

![]() (метрика).

(метрика).

Матрица

![]() - вычисляется по формуле.

- вычисляется по формуле.

![]() ,

,

где:

(1)

(1)

Где

![]() изменение градиента на предыдущем шаге.

изменение градиента на предыдущем шаге.

Данный алгоритм отличается устойчивостью, так как обеспечивает убывание целевой функции от итерации к итерации.

Алгоритм метода:

Шаг 1. Задать: начальную точку х(0). Перейти к шагу 2.

Шаг 2. Вычислить направление поиска s(k). Перейти к шагу 3.

Шаг 3. Произвести поиск вдоль прямой . Перейти

к шагу 4.

Шаг 4. Проверка условия окончания поиска.

Да: закончить поиск;

Нет: перейти к шагу2.

19. Регулярные методы минимизации функций (прямые методы и методы сопряженных направлений). Конспект:

Прямые методы (при работе не используются производные от целевой функции)

Методы сопряженных направлений (тоже не используются производные от целевой функции)

К прямым относят симплексные методы (Нелдера-Мида)

< =

что это за рисунок и какому методу –

без понятия.

=

что это за рисунок и какому методу –

без понятия.

Википедия:

Метод Нелдера —Мида, также известный как метод деформируемого многогранника и симплекс-метод, — метод безусловной оптимизации функции от нескольких переменных, не использующий производной(точнее — градиентов) функции, а поэтому легко применим к негладким и/или зашумлённым функциям.

Суть метода заключается в последовательном перемещении и деформировании симплекса вокруг точки экстремума.

Метод находит локальный экстремум и может «застрять» в одном из них. Если всё же требуется найти глобальный экстремум, можно пробовать выбирать другой начальный симплекс. Более развитый подход к исключению локальных экстремумов предлагается в алгоритмах, основанных на методе Монте-Карло, а также в эволюционных алгоритмах.

Липа какая-то:

Метод сопряженных направлений Пауэлла

Описание алгоритма:

Метод ориентирован на решение задач с квадратичными целевыми функциями. Основная идея алгоритма заключается в том, что если квадратичная функция:

![]()

приводится к виду сумма полных квадратов

![]()

то

процедура нахождения оптимального

решения сводится к

![]() одномерным

поискам по преобразованным координатным

направлениям.

одномерным

поискам по преобразованным координатным

направлениям.

В

методе Пауэлла поиск реализуется в

виде:

![]()

вдоль

направлений

![]() ,

,

![]() ,

называемых

,

называемых

![]() -сопряженными

при линейной независимости этих

направлений.

-сопряженными

при линейной независимости этих

направлений.

Сопряженные

направления определяются алгоритмически.

Для нахождения экстремума квадратичной

функции

переменных необходимо выполнить

![]() одномерных поисков. Алгоритм метода:

одномерных поисков. Алгоритм метода:

Шаг

1. Задать исходные точки

![]() ,

,

![]() и направление

и направление

![]() .

В частности, направление

может совпадать с направлением

координатной оси;

.

В частности, направление

может совпадать с направлением

координатной оси;

Шаг

2. Произвести одномерный поиск из точки

в направлении

получить точку

![]() ,

являющуюся точкой экстремума на заданном

направлении;

,

являющуюся точкой экстремума на заданном

направлении;

Шаг

3. Произв. одномерный поиск из точки

в направлении

получить точку

![]() ;

;

Шаг

4. Вычислить направление

![]() ;

;

Шаг

5. Провести одномерный поиск из точки

(либо

)

в направлении

с выводом в точку

![]() .

.