- •Регрессионные модели идентификации: статический объект, понятия о регрессии, парная и множественная регрессия, ошибка идентификации.

- •Диагностирование линейных оу методом комплементарного сигнала. Процедуры диагностирования, оценка работоспособности оу, локализация дефектов по годографу неисправностей.

- •2. Диагностирование линейных оу методом комплементарного сигнала. Постановка задачи, расчет кс по измеренным значениям выходного сигнала.

- •2. Диагностирование линейных оу методом комплементарного сигнала. Постановка задачи, аналитический расчет кс.

- •2. Дифференциальные модели од: метод малого параметра, условия работоспособности.

- •Составить булеву матрицу для конкретной функциональной модели.

- •2. Построение тестов: формулирование задачи, множество проверок, составление булевой матрицы, нахождение элементарных тестов на примере булевой матрицы.

- •2. Авторегрессионные модели идентификации.

- •2. Функциональные модели: задание модели, графическое представление, множество состояний од, таблица неисправностей, неразличимые состояния.

- •Представим степень интеграла в правой части (23) в виде произведения интегралов:

- •2. Линейное прогнозирование состояния од: точечный прогноз

- •2. Составить дробный факторный план (четверть реплики) для модели

- •2. Планы для квадратичных моделей, постановка задачи. Ортогональный центральный композиционный план второго порядка: структура плана, свойства плана.

- •2. Планы для моделей, содержащих линейные члены и взаимодействия различного порядка: дробный факторный план для модели , контраст плана, допустимость плана.

- •2. Оценка состояния объекта по результатам измерения выхода оу, фильтр с конечной памятью.

- •2. Применение дробного фп для модели , правила составления таблицы, смешение оценок коэффициентов модели.

- •Частотный метод определения коэффициентов пф

- •2. Формулы для вычислений и свойства полных и дробных факторных планов для линейных моделей.

- •2. Условия Гаусса – Маркова: проверка случайного характера элементов остаточного ряда

- •2. Оценка адекватности модели оу при проведении параллельных опытов.

- •2. Полные факторные планы первого порядка, определение примеры пфп для , свойства матрицы планирования.

- •Правило построения полных факторных планов

- •2. Дробные факторные планы (дробный факторный эксперимент): дробные реплики, определение, правило построения дробных факторных планов, генератор плана.

- •2. Планы для квадратичных моделей (планы второго порядка), постановка задачи, полные факторные планы

- •2. Метод сопряженных направлений для квадратичной целевой функции.

- •2.Составление булевой матрицы для конкретной функциональной модели.

Билет №1

Регрессионные модели идентификации: статический объект, понятия о регрессии, парная и множественная регрессия, ошибка идентификации.

Объект считается статическим, если находится в установившемся (стационарном) состоянии. Модель статического объекта связывается установившимися значениями входных и выходных сигналов.

Регрессионные модели идентификации

![]() ,

,

![]() .

.

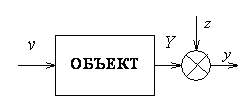

Рассматривается

объект с n

– наблюдаемыми входами

![]() и одним выходом. Кроме того, на выход

объекта оказывают влияние ненаблюдаемые

входы z.

Нельзя говорить о функциональной

зависимости между выходом и наблюдаемыми

входами, а можно говорить о стохастичности

или вероятностной связи.

и одним выходом. Кроме того, на выход

объекта оказывают влияние ненаблюдаемые

входы z.

Нельзя говорить о функциональной

зависимости между выходом и наблюдаемыми

входами, а можно говорить о стохастичности

или вероятностной связи.

Упростим

задачу, рассматривая объект одним входом

Упростим

задачу, рассматривая объект одним входом

![]() и одним выходом

.

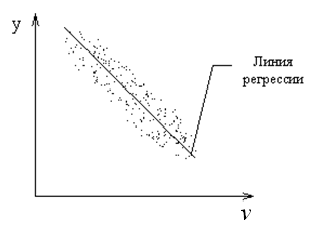

Будем задавать случайный вход и

фиксировать выход.

и одним выходом

.

Будем задавать случайный вход и

фиксировать выход.

Получаем

множество точек с координатами

![]() – корреляционное поле.

– корреляционное поле.

Для

одного и того же значения входа –

множество выходов (выход подвержен

влиянию ненаблюдаемых входов). Действие

ненаблюдаемых входов z

можно интерпретировать как влияние

помехи.

Для

одного и того же значения входа –

множество выходов (выход подвержен

влиянию ненаблюдаемых входов). Действие

ненаблюдаемых входов z

можно интерпретировать как влияние

помехи.

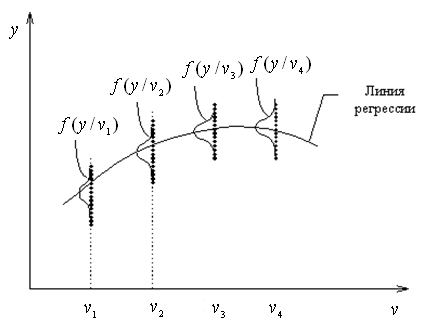

Для того, чтобы установить связь между выходом и входом рассмотрим рисунок

Множество выходов можно заменить средним значением

![]() (1)

где

(1)

где

![]() -

условная

плотность вероятности выхода при данном

значении

-

условная

плотность вероятности выхода при данном

значении

![]() .

.

Зависимость

называется регрессионной:![]()

Соединяя

средние точки кривой, получим регрессию

![]() .

Регрессионная зависимость

.

Регрессионная зависимость

![]() представляет собой статическую

характеристику ОУ.

представляет собой статическую

характеристику ОУ.

Если

ОУ имеет один вход и один выход, то его

характеристикой является простая или

парная регрессия:

![]() .

Если математическое ожидание выхода

связно n

– входами, то регрессия множественная:

.

Если математическое ожидание выхода

связно n

– входами, то регрессия множественная:

![]() В литературе вектор входов

В литературе вектор входов

![]() называют точкой в факторном пространстве,

а

называют точкой в факторном пространстве,

а

![]() – поверхность отклика в факторном

пространстве.

– поверхность отклика в факторном

пространстве.

Как

простая регрессия, так и множественная,

являются моделями статического объекта

(с одним и n

– входами).

Как

простая регрессия, так и множественная,

являются моделями статического объекта

(с одним и n

– входами).

Значение

выхода:![]() (2) где

(2) где

![]() – фактическое значение результативного

признака (выхода ОУ);

– фактическое значение результативного

признака (выхода ОУ);

![]() – теоретическое значение выхода ОУ,

найденное из уравнения регрессии;

– теоретическое значение выхода ОУ,

найденное из уравнения регрессии;

![]() – случайная величина, обусловленная

действием ненаблюдаемых факторов ОУ.

– случайная величина, обусловленная

действием ненаблюдаемых факторов ОУ.

Графически (2) представлено в виде схемы на рис выше.

Мера

близости модели и объекта определяется

некоторым функционалом ошибки:

![]() который зависит от структуры модели

который зависит от структуры модели![]() вектора параметров.

вектора параметров.

Оценка

модели выполняется на основе минимизации

или снижения до определенного уровня

значения

![]() .

Одним из критерия идентификации является

критерий качества (4):

.

Одним из критерия идентификации является

критерий качества (4):

![]() (4)

Согласно которому оператор

(4)

Согласно которому оператор

![]() можно принять за модель объекта, если

максимальное значение модуля ошибки

идентификации на интервале наблюдений

можно принять за модель объекта, если

максимальное значение модуля ошибки

идентификации на интервале наблюдений

![]() стремится к минимальной величине.

Критерий (4) используется, если входы и

выход объекта являются детерминированными

функциями(неслучайными). Но, как правило,

входные воздействия являются случайными

сигналами, поэтому используется критерий

(5):

стремится к минимальной величине.

Критерий (4) используется, если входы и

выход объекта являются детерминированными

функциями(неслучайными). Но, как правило,

входные воздействия являются случайными

сигналами, поэтому используется критерий

(5):

![]() (5)

(5)

Выбирается та модель, которая приводит математическое ожидание в минимум. Для практики используется квадратичный критерий качества, значения которых всегда неотрицательны. Для детерминированных сигналов – критерий (6), для аналоговых – критерий (4).

![]() ,

(6)

,

(6)

Для случайных сигналов – критерий (7):

![]() .

(7)

.

(7)

![]() .

(8)

.

(8)

![]()

Критерий (8) используется, если выходы объекта и модели являются непрерывными функциями (функциями с непрерывным временем), если измерение осуществляется дискретно, то используется критерий (9):

![]() (9)

(9)

В случаях 4-9 минимизация осуществляется по оператору . Изменяем структуру и параметры операторов и выбирается с минимальной ошибкой.

Для нахождения оценки коэффициентов определяем ошибку идентификации:

![]() – остаточный

ряд,

– остаточный

ряд,

где

![]() - вектор невязок (остатков).

- вектор невязок (остатков).

![]()

![]() – дисперсия

остатка,

– дисперсия

остатка,

![]() – единичная матрица,

– единичная матрица,

![]() – ковариационная матрица остатков,

элементами которой являются ковариации

между остатками, а по главной диагонали

дисперсии.

– ковариационная матрица остатков,

элементами которой являются ковариации

между остатками, а по главной диагонали

дисперсии.

Для нахождения оценок коэффициентов регрессии введем критерий идентификации в виде квадрата нормы остатков:

![]() (6)

(6)

В

качестве оценок выбирают такие величины,

при которых

![]() .

(6) – оптимизационная задача без

ограничений, т.е.

.

(6) – оптимизационная задача без

ограничений, т.е.

![]() может

быть любым.

может

быть любым.

Находится векторная производная от целевой функции и приравнивается к нулю:

![]()

![]() – матричное

уравнение.

– матричное

уравнение.

В результате получим

![]() (7)

(7)