- •2.4. Курсове проектування

- •1. Динамічні ряди та їхні властивості

- •Системи економетричних рівнянь для прогнозу, прийняття рішень та імітації

- •Проста вибіркова лінійна регресія

- •Оцінка параметрів лінійної регресії за допомогою методу найменших квадратів

- •Імовірнісний зміст простої регресії Узагальнена регресійна модель

- •1. Математичне сподівання параметра

- •Коефіцієнти кореляції та детермінації

- •Поняття про ступені вільності

- •Простий anova-аналіз. Аніліз дисперсій.

- •1. Класична лінійна багатофакторна модель

- •1.1 Основні припущення у багатофакторному регресійному аналізі

- •1.2.Етапи побудови багатофакторної регресійної моделі

- •1.3 Розрахунок невідомих параметрів багатофакторної регресії за мнк

- •1.3.2 Коефіцієнт множинної кореляції та детермінації

- •1.3.3 Anova–дисперсійний аналіз

- •1.4 Перевірка моделі на адекватність

- •2. Матричний підхід до лінійної багатофакторної регресії

- •2.1 Запис ублрм у матричному вигляді

- •2.2 Припущення класичної лінійної багатофакторної регресії

- •2.3 Оцінювання невідомих параметрів у багатофакторній регресії

- •2.4 Дисперсійно-коваріаційна матриця параметрів регресії

- •2.6 Прогнозування за багатофакторною рекгресійною моделлю

- •1. Мультиколінеарність

- •1.1 Теоретичні наслідки мульттиколінеарності

- •1.2. Практичні наслідки мультиколінеарності

- •1.3 Тестування наявності мультиколінеарності

- •2.5. Індивідуальна робота студентів

- •7 Навчально-методичні матеріали та технічні засоби

- •7.1 Основні джерела інформації

- •7.2 Додаткові джерела інформації

- •Основы системного анализа и проектирования асу: Уч. Пособие Павлов, с.Н . Гриша а.А. И др – к.: Выща шк.; 1991. – 367с.

- •2.12.6. T-тест для оцінки значимості коефіцієнта кореляції

- •7.8 Основні поняття теорії ймовірностей

- •7.8.1 Інтегральна функція розподілу ймовірностей випадкової величини

- •7.8.4. Закон рівномірного розподілу ймовірностей

- •7.8.5. Нормальний закон розподілу

- •7.8.5.1. Вплив параметрів нормального розподілу на форму нормальної кривої

- •7.8.6. Розподіл

- •Графік і таблиця нормального закону розподілу

- •Графік і таблиця f-розподілу Фішера

- •Графік і таблиця t-розподілу Ст’юдента

- •5.3. Автокореляція

- •5.3.1. Природа автокореляції. Основні поняття та означення

- •5.3.2. Тестування автокореляції

- •5.3.3. Оцінка параметрів регресійної моделі при наявності автокореляції

- •5.4. Авторегресивні і дистрибутивно-лагові моделі

- •5.4.1.Природа авторегресивних моделей. Приклади практичного застосування авторегресивних моделей

- •5.4.1.1. Приклади використання лагових моделей в економіці. Роль "часу" або "часового лагу" в економіці

- •5.4.1.2. Причини лагів

- •5.4.2. Оцінка параметрів дистрибутивно-лагових моделей

- •5.4.2.1. Послідовна оцінка дистрибутивно-лагових моделей

- •5.4.2.2. Підхід Койка до дистрибутивно-лагових моделей

- •5.4.3. Перша модифікація моделі Койка: модель адаптивнихочікувань

- •5.4.4. Друга модифікація моделі Койка: модель часткових пристосувань

- •Комбінація моделей адаптивних очікувань і частковихпристосувань

- •Оцінювання параметрів авторегресивних моделей

- •Метод допоміжних змінних

- •Виявлення автокореляції в авторегресивних моделях: h-тест Дарбіна

2.12.6. T-тест для оцінки значимості коефіцієнта кореляції

Ми знаємо, що коефіцієнт кореляції r вимірює щільність зв’язку між двома змінними. У випадку простої лінійної регресії він вимірює щільність зв’язку між незалежною змінною x і залежною змінною y. Задамося ціллю встановити:

як пов’язані коефіцієнт кореляції r між вибірковими значеннями x і y з коефіцієнтом кореляції ρ всієї генеральної сукупності;

як перевірити значимість коефіцієнта кореляції і як для цього використати t-статистику (2.115).

Спробуємо спочатку відповісти на друге запитання, що автоматично дає відповідь і на перше запитання. Використаємо t-статистику у вигляді (2.115) для визначення, чи статистично значимо коефіцієнт кореляції всієї сукупності відрізняється від нуля.

Спочатку розглянемо найпростіший випадок, а саме тест для оцінки значимості коефіцієнта кореляції (з припущенням, що ρ = 0).

Сформулюємо нуль-гіпотезу:

![]() (2.116)

(2.116)

де r – вибірковий коефіцієнт кореляції між x і y;

n – кількість спостережень.

Величина t* розподілена за розподілом Ст’юдента з (n-k) ступенями вільності (нагадаємо, що для простої лінійної регресії k = 2).

Розраховане

значення t*

порівнюємо з критичним значенням

![]() при

α 100%-ному

рівні значимості й (n-2)

ступенях вільності. Якщо

при

α 100%-ному

рівні значимості й (n-2)

ступенях вільності. Якщо

![]() ,

відкидаємо нуль-гіпотезу

,

відкидаємо нуль-гіпотезу

![]() і

приймаємо гіпотезу

і

приймаємо гіпотезу

![]() .

.

Приклад. Маємо вибірку значень x і y, яка складається з 20 спостережень; коефіцієнт кореляції r = 0,82. Ми хочемо перевірити при 5%-ному рівні значимості, чи значимо коефіцієнт кореляції відрізняється від нуля.

Тобто перевіряємо нуль-гіпотезу:

проти альтернативної:

.

![]()

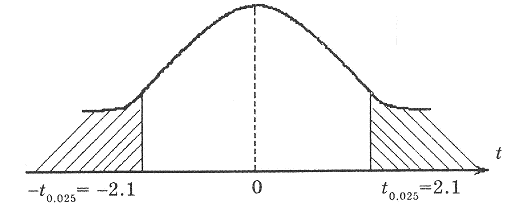

Малюнок 2.14. Перевірка на значимість коефіцієнта кореляції за t-тестом Ст’юдента

За

t-таблицями

Ст’юдента знаходимо теоретичне значення

t з 18

ступенями вільності і 5%-ним рівнем

значимості, яке дорівнює

![]() (мал. 2.14). Оскільки t*>t,

ми відкидаємо нуль-гіпотезу і робимо

висновок, що

(мал. 2.14). Оскільки t*>t,

ми відкидаємо нуль-гіпотезу і робимо

висновок, що

![]() .

.

Трансформований у z-тест t-тест для оцінки значимості коефіцієнта кореляції (з припущенням, що )

Якщо

,

то t-розподіл

з коефіцієнтом ρ

є несиметричним. Тобто

t-статистику

не можна використовувати для перевірки

таких гіпотез, як

![]() або

або

![]() .

.

Цю проблему було вирішено в 1921 році Фішером, який трансформував ρ у величину h:

![]() ,

,

розподілену нормально з математичним сподіванням

![]()

і дисперсією

![]()

що формалізовано можна записати

.

.

Як будь-яку нормально розподілену величину, її можна стандартизувати, тобто звести до нормально розподіленої величини з математичним сподіванням 0 і дисперсією 1 шляхом перетворення:

![]()

Приклад. З вибірки, що складається з 28 спостережень, знайдено, що r = 0.70.

Чи варто відкинути гіпотезу, що ρ = 0.6 ( в генеральній сукупності) з ризиком помилитися 5%?

Тобто перевіряємо нуль-гіпотезу:

![]()

проти

![]()

Для цього обчислимо величину:

Далі розрахуємо значення z-статистики:

![]()

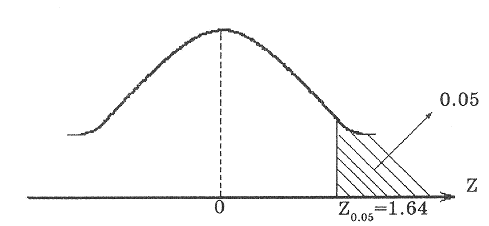

З

огляду на те, що заданий рівень помилки

α=0.05, за таблицями нормального розподілу

знаходимо критичне значення

![]()

Табличне

значення

![]() (мал. 2.15).

(мал. 2.15).

Малюнок 2.15. Функція густини нормального закону розподілу