- •Вопрос 1 Непрерывность действительных функций одного и многих действительных переменных. Свойства непрерывных функций.

- •Вопрос 2 Числовой ряд. Сходящиеся ряды и их простейшие свойства. Функциональные ряды. Равномерно сходящиеся ряды. Степенные ряды. Область и радиус сходимости степенного ряда.

- •Вопрос 4 Матрицы над кольцом и операции над ними. Определители матриц и их свойства. Ранг матрицы над полем. Обратная матрица и способы ее вычисления.

- •Вопрос 5 Векторные пространства над полем. Линейно зависимые и независимые системы векторов. Подпространства векторного пространства, операции над ними. Свойства конечномерных векторных пространств.

- •Вопрос 6 Кольцо многочленов над кольцом с единицей. Делимость многочленов с остатком. Значение многочлена, его корень.

- •Вопрос 8 Евклидово (унитарное) пространство и его свойства. Ортогонализация системы векторов. Существование ортонормированного базиса. Ортогональное дополнение подпространства.

- •Вопрос 9 Кольца вычетов. Малая теорема Ферма. Сравнения первой степени. Китайская теорема об остатках.

- •Вопрос 10 Вероятностное пространство. Аксиомы теории вероятностей. Классическое определение вероятности.

- •Вопрос 11 Случайные величины, функции распределения, их свойства. Абсолютно непрерывные и дискретные распределения. Типовые распределения: биномиальное, пуассоновское, нормальное.

- •Вопрос 12 Условные вероятности. Независимость событий. Формула полной вероятности. Формулы Байеса. Независимые случайные величины.

- •Вопрос 13 Математическое ожидание случайной величины и его свойства. Примеры. Дисперсия случайной величины и ее свойства. Вычисление математических ожиданий и дисперсий типовых распределений.

- •Вопрос 15 Центральная предельная теорема для независимых одинаково распределенных случайных величин.

- •Вопрос 16 Основные понятия математической статистики и т.Д..

- •Вопрос 18 Критерии согласия. Критерий согласия Пирсона (критерий 2).

- •Вопрос 19 Алгоритмы сортировки. Сортировки сравнениями: пузырьковая сортировка и сортировка вставками. Оценки трудоемкости.

- •Вопрос 21 Цифровая сортировка как пример сортировки подсчетом. Бинарный и интерполяционный поиск. Оценки трудоемкости.

- •Вопрос 22 Алгоритмы поиска в деревьях. Деревья двоичного поиска. Алгоритм вставки и удаления элемента в дерево двоичного поиска. Оценки трудоемкости.

- •Вопрос 24 Теорема Шеннона для канала без шума и ее практическое значение.

- •Вопрос 25. Теорема Шеннона для канала с шумом и ее практическое значение.

- •Вопрос 26 Классификация помехоустойчивых кодов и принципы их построения.

- •Вопрос 27 Угрозы безопасности информации. Классификация и модель угроз безопасности. Угрозы конфиденциальности, целостности, доступности, раскрытия параметров ас.

- •Вопрос 28 Понятие политики безопасности. Формирование и структура политики иб. Дискреционная политика безопасности. Мандатная политика безопасности.

- •Вопрос 29 Основные положения руководящих документов фстэк в области зи.

- •Вопрос 30 Определение и классификация нарушителя. Модель нарушителя. Модель нарушителя в соответствии с рд фстэк.

- •Вопрос 32 Стандарт по обеспечению информационной безопасности гост р исо/мэк 17799. Практические правила управления иб. Отправная точка для внедрения иб.

- •Вопрос 33 Стандарт по обеспечению информационной безопасности гост р исо/мэк 27001. Система менеджмента информационной безопасности.

- •Вопрос 34 Формальные модели безопасности. Модель Белла-Лападула как основа построения систем мандатного разграничения доступа. Основные положения модели.

- •Вопрос 35 Методы и средства ограничения и управления доступом. Пас управления доступом. Типовая структура и типовые функции пас управления доступом.

- •Вопрос 36 Методы и средства привязки программного обеспечения к аппаратному окружению и физическим носителям.

- •Вопрос 37. Защита программ от исследования. Методы и средства защиты.

- •Вопрос 38. Защита от разрушающих программных воздействий (рпв). Методы и средства защиты от разрушающих программных воздействий. Изолированная программная среда.

- •Вопрос 39 Информативные сигналы и их источники. Побочные электромагнитные излучения и наводки. Структура, классификация и основные характеристики технических каналов утечки информации.

- •Вопрос 40 Скрытие речевой информации в каналах связи. Энергетическое скрытие акустических информативных сигналов.

- •Вопрос 42 Криптосистемы с открытым ключом. Понятие сертификата. Криптосистема rsa. Выбор параметров.

- •Вопрос 43 Криптографические хэш-функции. Стандарт гост р 34.11.

- •8.3 Этап

- •Вопрос 44 Цифровая подпись. Схемы цифровой подписи. Стандарт гост р 34.10.

- •45 Блочные шифры. Режимы блочных шифров. Гост 28147.

- •46 Протоколы открытого ключевого обмена. Диффи-Хеллман

- •Вопрос 47. Классификация ключей по типам алгоритмов, их функциям, уровням и криптопериоду.

- •Вопрос 48 Основные механизмы безопасности операционных систем (ос): средства и методы аутентификации в ос, модели разграничения доступа, организация и использование средств протоколирования.

- •Вопрос 49. Администрирование ос: основные задачи и принципы сопровождения системного по, управления безопасности ос.

- •Вопрос 50 Классификация сетевых атак. Классификация средств сетевой защиты

- •Вопрос 51. Основные принципы обеспечения безопасности в Internet.

- •Вопрос 53 Защита информации ограниченного доступа: коммерческой тайны.

- •Вопрос 54 Защита государственной тайны.

- •Вопрос 55 Защита информации ограниченного доступа: персональных данных.

- •Вопрос 56 Лицензирование деятельности в области защиты информации.

- •Вопрос 57. Сертификация средств защиты информации.

- •Вопрос 58. Аттестация объектов информатизации.

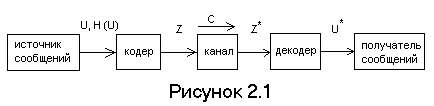

Вопрос 24 Теорема Шеннона для канала без шума и ее практическое значение.

Идеальный

канал без памяти

(канал без

шума) -

дискретный канал, вероятность

возникновения ошибки у которого близка

к 0. Пропускная способность такого

канала C=Vk*logN.

При наличии идеального канала стоит

задача согласование дискретного

источника с дискретным каналом без

шума: о возможности передачи по нему

без потерь от произвольного дискретного

источника, характеризующегося некоторой

производительностью H’(U)

со скоростью, равной пропускной

способности канала.

Для

того, чтобы скорость передачи информации

в канале была равна его пропускной

способности, на вход канала должен

действовать дискретный источник с

определенными статическими свойствами,

максимизирующие величину i(Z,Z*).

Функция кодера, осуществляющего

согласование в статическом смысле

сообщения источника со входного канала,

является полным устранением избыточности

сообщения. Кодер осуществляет кодирование

сообщения, т.е. каждому дискретному

сообщению по определенным правилам

ставит в соответствие последовательность

символов из алфавита объемом N.

Возможность построения кодера, полностью

устраняющего избыточность произвольного

источника сообщений, и определяет

возможность решения поставленной

задачи безошибочной передачи информации

со скоростью, равной пропускной

способности канала. При полном ее

решении оказывается справедливым

равенство:

,

откуда имеем

,

откуда имеем

,

где H(U)

- энтропия

источника передаваемых сообщений, Vk

и Vc

- средние количества символов

соответственно сообщения и кода

передаваемых в единицу времени. η

- среднее количество символов кода

приходящиеся на одно сообщение. Степень

приближения к точному выполнению

равенств зависит от степени уменьшения

избыточности источника сообщений.

,

где H(U)

- энтропия

источника передаваемых сообщений, Vk

и Vc

- средние количества символов

соответственно сообщения и кода

передаваемых в единицу времени. η

- среднее количество символов кода

приходящиеся на одно сообщение. Степень

приближения к точному выполнению

равенств зависит от степени уменьшения

избыточности источника сообщений.

Кодирование позволяющее устранять избыточность источников сообщений называется эффективным. Предельные возможности такого кодирования раскрывается в теореме Шеннона для канала без шума, которая является одним из основных положений теории передачи информации.

Т: Пусть источник сообщений имеет производительность H’(U) = Vc H(U), а канал имеет пропускную способность C =Vklog M. Тогда можно закодировать сообщения на выходе источника таким образом, чтобы получить среднее число кодовых символов приходящихся на элемент сообщения η = Vk / Vc = (H(U) / log M) + ε, где ε - сколь угодно мало (прямая теорема).

Получить меньшее значение η невозможно (обратная теорема).

Вопрос 25. Теорема Шеннона для канала с шумом и ее практическое значение.

Р![]() ассмотрим

задачу

согласования дискретного источника с

дискретным каналом с шумом, когда в

процессе передачи сигнал

искажается шумом. Наличие в канале шума

приводит к тому, что по сигналу Z* нельзя

однозначно определить сигнал Z. Этот

эффект характеризуется наличием потерь

информации или ненадежностью канала

H(Z/Z*)>0

ассмотрим

задачу

согласования дискретного источника с

дискретным каналом с шумом, когда в

процессе передачи сигнал

искажается шумом. Наличие в канале шума

приводит к тому, что по сигналу Z* нельзя

однозначно определить сигнал Z. Этот

эффект характеризуется наличием потерь

информации или ненадежностью канала

H(Z/Z*)>0

Производительность ансамбля сигналов Z на входе канала должна быть выше производительности источника сообщений U, и, следовательно, Z , кроме информации об U, должен содержать дополнительную собственную информацию.

При этом если бы удалось ввести дополнительную информацию таким образом, чтобы при прохождении сигнала Z по каналу с шумом вследствие ненадежности канала терялась бы именно она, а не полезная информация о сообщении U, то оказалось бы возможным обеспечить безошибочную передачу сообщений U по каналу с шумом с конечной скоростью H’(U) <C. Таким образом, задачей кодера в данной ситуации является согласование источника с каналом, заключается во внесении в сообщение источника избыточности, обладающей описанной выше свойством.

Теорема Шеннона для канала шумом: если производительность источника сообщений H(U) меньше пропускной способности канала С т.е. H(U) < C, то существует такая система кодирования которая обеспечивает возможность передачи сообщений источника со сколь угодно малой вероятностью ошибки (прямая теорема) Если H’(U)<C, то можно закодировать сообщение таким образом, что ненадежность в единицу времени будет меньше, чем H’(U) – C+ ε, то H’(U / U*) <H’(U)–C+ ε. (Обратная теорема) Не существует способа кодирования обеспечивающего ненадежность в единицу времени меньшую, чем H’(U)-C.

В такой формулировке эта теорема была дана самим Шенноном. В литературе часто вторая часть прямой теоремы и обратная теорема объединяются в виде обратной теоремы сформулированной так: если H’(U)>C, то такого способа кодирования не существует.