- •Основы Теории Информации Гордеев э.Н.

- •Содержание

- •1Введение

- •1.1Предмет курса

- •1.2Основная цель курса

- •1.3Теория информации и смежные дисциплины

- •1.4Подходы к определению понятия информация.

- •2Алфавит. Слово. Язык. Информация.

- •3Информация и алгоритм.

- •3.1Задачи, алгоритмы

- •3.1.1Задача

- •3.2Алгоритм

- •3.2.1Нормальные алгорифмы Маркова (нам).

- •3.2.2Машины Тьюринга

- •4Кодирование информации. Количество информации. Сжатие информации.

- •4.1Кодирование информации.

- •4.1.1Примеры кодировок

- •4.1.2Свойства кодировок

- •4.2Наиболее распространенные способы кодирования и их свойства. Алгоритмы кодирования.

- •4.2.1Кодирование слов и поиск минимального кода

- •4.2.2Признаковое кодирование.

- •4.2.3Признаковое кодирование и проблема распознавания.

- •4.2.4Сериальное кодирование

- •4.2.5Алфавитное кодирование.

- •4.2.5.1Неравенство Крафта.

- •4.2.5.2Префиксные коды.

- •4.2.6Кодирование натурального ряда.

- •4.2.6.1Код Элайеса.

- •4.2.6.2Код Левенштейна

- •5Количество информации. Энтропия.

- •5.1.1Энтропия по Хартли.

- •5.1.2Энтропия по Шеннону.

- •5.1.2.1Математическая модель: алфавитное кодирование случайного источника.

- •5.1.2.2Энтропия по Шеннону

- •5.1.2.3Энтропия по Шеннону и энтропия по Хартли.

- •6Теорема Шеннона

- •7Свойства энтропии.

- •8Алгоритмы кодирования

- •8.1Алгоритм Шеннона (Фано)

- •8.2Алгоритм Хаффмана

- •8.3Блочное кодирование

- •8.4Алгоритм арифметического кодирования

- •8.5Код Элайеса

- •8.6Код Левенштейна

- •9Блочное кодирование и теорема Шеннона.

- •10Канал с шумом.

- •10.1Модели каналов.

- •10.2Передача информации по двоичному симметричному каналу с шумом

- •10.2.1Схема и принципы кодирования.

- •10.3Корректирующие способности кодов. Границы мощности.

- •10.4Теорема Шеннона для канала с шумом.

- •10.4.1Факты из теории вероятности.

- •10.4.2Схема кодирования и декодирования. Вспомогательные утверждения.

- •10.4.3Вероятностное доказательство теоремы.

- •10.4.4Комбинаторное доказательство теоремы.

- •10.5Линейные коды

- •10.5.1Пример. Код Хемминга.

- •10.5.2Замечание. Совершенные коды и теорема Шеннона.

- •10.5.3Бчх – коды

- •10.6Спектр кода. Эквидистантные коды

- •11Рекомендованная литература

3.2.2Машины Тьюринга

Согласно тезису Черча любые две формальные схемы, описывающие понятие алгоритма должны быть эквивалентны друг другу.

Здесь мы рассмотрим еще одну, пожалую самую популярную из таких схем - машину Тьюринга. Подобно предыдущему формализму она предназначается для преобразования некоторого одного слова P в заданном алфавите в другое слово Q.

Заметим, что существует несколько разновидностей МТ. Более того, даже для одного и того же типа МТ определения могут варьироваться. Это может быть связано с мелкими техническими удобствами, а также с попытками не загромождать формализма "очевидными" тонкостями.

Рассмотрим самый простой объекта - одноленточную детерминированную МТ. Она представляет собой пятерку {S, A, F, q0, }, где S={q1,…qk} - конечное множество, элементы которого называются состояниями, A={a1,…,an} - алфавит, FS. Элементы F называются конечными состояниями, выделено начальное состояние q0 и схема переходов машины Тьюринга . Каждый такой переход еще называется командой, а вся схема (список команд) представляет собой частично определенное отображение из SASA{L, R, St}. Здесь {L, R, St } - множество из трех элементов, смысл которых ниже поясняется.

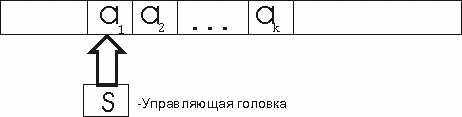

Опишем теперь механизм работы МТ. На двусторонней бесконечной ленте, разбитой на ячейке, начиная с некоторой ячейки, записано входное слово P (по одному символу в каждой ячейке). Имеется еще один объект - "головка" МТ, который характеризуется наличием определенного приписанного ей состояния и умением читать и писать.

Работа МТ состоит из последовательности тактов.

В начальный момент времени головка обозревает ячейку ленты, в которой записан первый символ входного слова, и находится в начальном состоянии.

Вообще, положение головки, ее состояние и запись на ленте полностью описывают конфигурацию МТ в данный момент времени. Поэтому конфигурацией МТ и называется слово v1…vkqjvk+1…vm. Эта запись свидетельствует о том, что в данный момент времени головка МТ находится в состоянии qj и обозревает ячейку ленты, в которой записан символ vk+1. Все же слово, записанное к этому моменту на ленте, имеет вид v1…vkvk+1…vm.

Каждой конфигурации K=v1…vkqjvk+1…vm однозначно сопоставляется пара конфигурации qjvk+1и слово конфигурации v1…vkvk+1…vm.

Такт работы представляет собой переход из одной конфигурации к другой. Этот переход осуществляется путем выполнения некоторой команды qiaj qrat{Z}. (Пару qiaj назовем левой частью команды qiajqrat{Z}, а тройку qrat{Z} - правой частью этой команды.) Если пара конфигурации не является левой частью ни одной из команд, то МТ останавливается и процесс ее работы заканчивается.

Если же такая команда qiaj qrat{Z} найдена, то это означает, что перед выполнением данного такта МТ находилась в состоянии qi, обозревала ячейку с символом aj, а после выполнения данного такта она перешла в состояние qr, в ранее обозреваемой ячейке появился символ at .Z имеет одно из трех значений L, R, St. В первом случае головка сдвинулась на данном такте на одну ячейку влево, во втором - вправо, в третьем - осталась на месте. Если qr является конечным состоянием, то процесс работы МТ заканчивается и МТ останавливается. В противном случае для вновь полученной конфигурации ищется команда, правая часть которой совпадает с парой конфигурации, и процесс продолжается.

Так как каждая команда определяется однозначно, то, в отличие от НАМ, порядок команд в списке не имеет значения.

Переход от конфигурации Ki к конфигурации Kj в результате выполнения некоторого такта работы МТ обозначим через KiKj. Если существует такая последовательность команд, что в результате их выполнения МТ перешла из конфигурации Ki к конфигурации Kj, то эту ситуацию обозначим через KiKj.

Заметим, что МТ может зацикливаться. Это довольно тонкий момент в данном формализме, который восходит к тому факту в определении алгоритма, согласно которому алгоритм не обязан сам распознавать слова из своей области действия. Конечно, если мы требуем, чтобы перед началом работы была проведена проверка на соответствие входного слова области действия, то никакого зацикливания не может быть, так как уже на стадии проверки будут отсеяны те слова, на которых алгоритм не может корректно работать (слова, которым он не применим). Если же такой предварительной стадии нет, то она может быть заменена предположением о том, что у нас есть некоторый механизм идентификации зацикливаний. То есть, мы можем различать три ситуации: МТ остановилась и завершила свою работу; МТ находится в процессе работы, совершив некоторой количество переходов, и готовится к очередному такту работы; МТ зациклилась, т.е. будет работать и никогда не остановится.

Если МТ на входном слове P за конечное число тактов останавливается, то говорят, что она применима к этому слову. Последовательность конфигураций от начальной до конечной называется вычислением МТ на слове P.

В отличие от НАМ в данном формализме присутствуют такие понятия как: читающая и пишущая головка, обозреваемая ячейка, сдвиги вправо и влево и пр. Все это с точки зрения формальной схемы интуитивного понятия "алгоритм" также нуждается в формализации. Она более или менее очевидна, особенно с точки зрения людей, знакомых с азами компьютерной техники. (Заметим, что Тьюринг предложил свой формализм в 1935 году, когда о компьютерах еще и речи не было). Предположим, что все эти детали определены, и мы получили некоторый алгоритм T,C. Он работает в алфавите C, C является надалфавитом алфавита A машины Тьюринга Т. А для любых слов P и Q в алфавите С соотношение T,C(P)=Q выполняется тогда и только тогда, когда существует такое вычисление на машине Тьюринга Т такое, что оно начинается с конфигурации q0R и заканчивается конфигурацией R1qiR2, где R1R2=Q.

Вообще же произвольный алгоритм в алфавите D называется вычислимым по Тьюрингу тогда и только тогда, когда существует машины Тьюринга T с алфавитом A и алфавит C, являющийся надалфавитом AD такие, что алгоритмы T,C и вполне эквивалентны относительно D.

Перейдем теперь к рассмотрению примеров.

Пример 1. Построить МТ, вычисляющую функцию T(X)= (машина стирает любой слово).

Входной алфавит: A={a1…an}.

Множество состояний состоит из единственного начального состояния q=q0.

Работа

МТ описывается единственной командой:

![]() .

.

Пример 2. Построить МТ, вычисляющую функцию T(x,y)=x+y.

Алфавит A=(*,1).

При

этом сохраняем договоренность о том,

что через![]() обозначаются любые символы алфавита.

обозначаются любые символы алфавита.

На входе

мы имеем

. На выходе - *

. На выходе - *![]() .

.

![]()

Теорема: Пусть M – машина Тьюринга, вычисляющая функцию f, тогда существует нормальный алгоритм Маркова, вычисляющий ту же функцию.

Доказательство: A

– алфавит МТ, S –

множество отношений, B

= A

![]() S.

S.

a,b![]() A,

q, q’

S

A,

q, q’

S

Машина Тьюринга |

Нормальный Алгоритм Маркова |

δ(q,a) = (q’, b, S) |

qa→q’b |

δ(q,a) = (q’, b, R) |

qa ck → bq’ ck qa → bq’_’ |

δ(q,a) = (q’, b, L) |

ck: ck qa → q’ckb |

qi → ∙λ , qi F

λ → q0

Сложность (количество действий):

Снам(n)≤Смт(n)+2

Снам(n) =O(Смт(n))

Существует и обратная теорема: Если существует НАМ, вычисляющий функцию f, тогда существует и МТ, вычисляющая ту же функцию.

Тезич Чёрча: Любой алгоритм можно реализовать на МТ (и на НАМ).

f: A*→{0, 1} – функция распознавания, она может быть вычислена с помощью машины Тьюринга, она задает язык для алфавита A.

Вопрос: Любая ли такая функция может быть вычислимой?