- •Коммерциялық емес акционерлік қоғам

- •Ақпараттар теориясы

- •5В070400 – «Есептеу техникасы және бағдарламамен қамтамасыз ету» мамандығының барлық оқу бөлімінің студенттері үшін дәрістер жинағы

- •1 Дәріс. Сигнал, ақпарат және хабар

- •1.1 Хабар кездейсоқ үрдіс ретінде

- •1.2 Детерминделген сигналдарды бейнелеу формалары

- •1.1 Сурет - Сигналдардың бейнелеу формулалары

- •1.3 Хартли өлшемі. Ақпараттың сандық бағасы

- •1.4 Шеннон энтропиясы мен Больцман энтропиясының арасындағы байланыс

- •1.2 Сурет - Ықтималдылықты жағдайлардың айырмашылығы

- •1.4 Ақпарат түсінігі

- •2 Дәріс. Бөгеусіз дискретті арна

- •2.1 Ақпарат таратудың бөгеусіз дискретті арнасы

- •2.2 Арнаның өткізу қабілеті

- •2.3 Бөгеусіз арнаның өткізу қабілеті үшін теорема

- •2.4 Бөгеусіз дискретті арнаның математикалық моделі

- •2.1 Сурет - Екілік симметриялық арнадағы өту ықтималдығы

- •3 Дәріс. Бөгеулері бар дискретті арна

- •3.1 Бөгеу туралы ұғым

- •3.2 Бөгеулердің түрлері

- •3.3 Бөгеулі ақпаратты таратушы дискретті арна

- •3.1 Сурет - Екілік арнаның өткізгіштілік қабілетінің қателік мүмкіндігіне р0 қатынасы

- •4 Дәріс. Бөгеулері бар дискретті арна (жалғасы)

- •4.1 Кедергісі және өткізгіштік қабілеті бар арнаға арналған теорема

- •4.2 Бөгеулі дискреттік арналардының математикалық моделі

- •4.3 Ақпаратты үздіксіз түрде ұсыну

- •4.1 Сурет - Сигналдың түрлері

- •4.4 Сигналды қалпына келтіру сапасының критерилері

- •5 Дәріс. Үздіксіз арна

- •5.1 Үздіксіз сигналды ортогональды қатарларға жіктеу

- •5.2 Фурье қатарлары және олардың байланыс техникасында қолданылуы

- •5.3 Котельников теоремасы (Шеннонның негізгі теоремасы)

- •5.4 Үздіксіз арнаның өткізу қабілеті (бөгеусіз және бөгеулермен)

- •5.1 Сурет - үб арнасының үлгісі

- •6 Дәріс. Байланыс жүйесіндегі сигналдарды түрлендіру және қалыптастыру әдістері

- •6.1 Ақпарат тасушының модуляциялау әдістері

- •6.2 Гармоникалық модуляциялық сигналы

- •6.1 Сурет - Модулятор

- •6.3 Амплитудалық (ам), жиіліктік (чм), фазалық (фм) модуляция

- •6.2 Сурет - Амплитудалық – модуляцияланған сигнал

- •6.3 Сурет – Жм сигналының лездік жиілігі

- •7 Дәріс. Фазалық модуляция

- •7.1 Фазалық модуляция

- •7.2 Сигналдардың уақыттық, спектрлік және векторлық көріністері

- •7.4 Жиілік жолығының ұзындығы және жм және фм сигналдарының спектрлерінің айырмашылығы.

- •7.6 Сурет - Бессель функцияларының графиктері

- •8 Дәріс. Импульсті модуляция

- •8.1 Сурет – Әр түрлі импульсті модуляция сигналдары

- •8.2 Дискреттік модуляциялау әдістері

- •8.2 Сурет - Дискреттік модуляция кезіндегі сигналдардың уақыттық диаграммалары

- •8.3. Импульстер жүйесінің спектрі

- •8.3 Сурет - Импульстер жүйесінің спектрі

- •9 Дәріс. Бөгеуге тұрақты кодтау теориясы

- •9.1 Өткізгіштік қабілеті және құжаттарды жіберу жылдамдығы

- •9.2 Мәліметтердің артықшылығы

- •9.3 Тиімді кодтау теоремасы

- •10 Дәріс. Бөгеуге тұрақты түзетуші кодтар

- •10.1 Жалпы мәліметтер

- •10.2 Қателерді табудың және түзетудің негізгі принциптері

- •10.3 Кодалық қашықтық және кодтың түзету қабілеті

- •10.4 Кодтарды түзету классификациясы

- •11 Дәріс. Бөгеуге тұрақты түзетуші кодтар (жалғасы)

- •11.2 Үйірткі кодтар

- •12 Дәріс. Жүйелердің бөгеулерге тұрақтылық теориясы

- •12.1 Хабарлардың оптималды қабылдау шарттары

- •12.2 Оптималды қабылдағыштардың алгоритмдер мен сұлбаларын синтездеу, коррелияцилық қабылдағыш, үйлестірілген сүзгісі бар қабылдағыш

- •12.1 Сурет - Котельниковтың қолайлы қабылдағышы

- •13 Дәріс. Үйлесімді сүзгісі бар қабылдағыш

- •13.1 Үйлесімді сүзгісі бар қабылдағыш

- •13.1 Сурет - Котельников үйлесімді сүзгілі оптималды қабылдағышы

- •13.2 Модуляция түрлері және сигналды қабылдаудың әртүрлі

- •13.2 Сурет – ам, жм, фм сигналдарының эквивалентті энергияларын анықтау үшін

- •13.2 Салыстырмалы фазо-манипуляцияланған сигналдар

- •14 Дәріс. Көпарналы байланыс

- •14.1 Көпарналы байланыс

- •14.1 Сурет- Көпарналы байланыс арнасынын функционалды сұлбасы

- •14.2 Сигналдардың фазалық, жиіліктік, уақыттық бөлінуінің әдістері

- •14.2 Сурет - Арналардың уақытша бөлінуі

- •14.3 Сурет - цат-тің құрылымдық сұлбасы

- •15 Дәріс. Модуляцияның цифрлық әдістері

- •15.1 Ақпаратты қалпына келтіру және дискритизацияның принципі

- •15.1 Сурет - Аналогтық сигналдың цифрлық икм сигналға айналу құрылымы

- •15.2 Импулсті - кодалық модуляция (икм)

- •Мазмұны

9.2 Мәліметтердің артықшылығы

Мәліметтер жинағы ретінде компьютерге орыс тілінде мәтін енгізетін операторды қарастырамыз. Әріптердің мәтінде әр түрлі ықтималдықпен пайда болатыны мәлім. Мысалы, А әрпі Ц немесе Ю әрпіне қарағанда анағұрлым көбірек беріледі. Бұдан басқада, келесі әріптің пайда болуы, алдындағы әріпке тәуелді. Дауысты дыбыстардан кейін Ь, Ъ және Ы әрпінің болмауы мәлім. Е әрпінің қатарынан үш рет болуы өте сирек болады («змееед» сөзінде). Жады жоқ таратушыға қарағанда, «жады бар» таратушы шығысында (тәуелді мәліметтер) мәліметтер дұрыс пайда болады, қателер азырақ болады. Осылай, біз мәліметтер артықшылығы деген түсінік кіргіземіз. Оны формалді түрде мына ара қатынас арқылы табуға болады:

![]() .

(9.3)

.

(9.3)

Яғни, энтропия неғұрлым көп болса, соғұрлым таратқыштың мәлімет шығаруы аз, ал керісінше артық мәліметтің шамасының көлемі 0≤ρ≤1 аралығында болады.

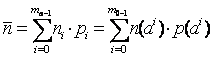

Берілген шама әріптер (символдар) n санын сипаттайды, олар таратқыштың берілген мәліметтер көлеміне байланысты. Артық шаманың көлемін былай табамыз:

![]() .

(9.4)

.

(9.4)

![]() өлшемі

қысу коэффициенті деп аталады. Ол

мәліметтерді қандай көлемге дейін

қысуға болатын шамасын көрсетеді, егер

оның құрамындағы артық шаманы алып

тастасақ та сондай мәнге ие боламыз.

Мысалы, телеграмманы текст түрінде

жіберген кезде олардың құрамындағы

тыныс белгілерін оңай қалпына келтіруге

болады.

өлшемі

қысу коэффициенті деп аталады. Ол

мәліметтерді қандай көлемге дейін

қысуға болатын шамасын көрсетеді, егер

оның құрамындағы артық шаманы алып

тастасақ та сондай мәнге ие боламыз.

Мысалы, телеграмманы текст түрінде

жіберген кезде олардың құрамындағы

тыныс белгілерін оңай қалпына келтіруге

болады.

Әріптер мен сөздердің арасында байланыс болса, онда оларды қайтадан қалпына келтіру мүмкіндігі бар.

Артық

мән параметрінен басқа тағы да басты

характері жылдамдықпен сипатталуы

мумкін

![]() симв/с

хабар тарату оның шығарушылығымен

сипатталады, ол энтропияны уақыт

бірлігімен сипаттайды.

симв/с

хабар тарату оның шығарушылығымен

сипатталады, ол энтропияны уақыт

бірлігімен сипаттайды.

![]() .

(9.5)

.

(9.5)

Егер

энтропия максималды болса ол log N тең,

ал өлшемі

![]() ,

бит/с, ақпарат таратушының жылдамдығы

деп аталады.

,

бит/с, ақпарат таратушының жылдамдығы

деп аталады.

Таратушының мәні – ақпараттың бір секунд ішіндегі үздіксіз жұмысының орташа мәні.

9.3 Тиімді кодтау теоремасы

Тиімді кодтаудың теоретикалық негізі К.Шеннон теоремасымен анықталады. Бұл теореманың мәні мынада: таратқышта Н (бит символға) энтропиясы бар болсын, ал арнада өткізу қабілеттілігі С (бит секундына) тең. Сондықтан хабарды таратқыш шығысында былай кодтауға болады, Е-қаншалықты аз болсада орташа жылдамдықпен C/H-E секундына арна арқылы бір символ жібере аламыз. Хабар элементтерінің орташа жылдамдығынан артық, C/H жылдамдығымен ақпараттар жіберу мүмкін емес.

Айта кету керек, ДХ бөгеуілсіз байланыс арнасы арқылы жібергенде, 2 шарт орындалуы керек.

1 шарт: кодтық комбинациялар әр түрлі болуы керек. Яғни қабылдағышта декодтау керек және керекті ДХ элементтерімен байланыста болуы керек.

2 шарт: кодтау тәсілі максималды пайдалы болу керек, жіберілген хабар қысқа немесе оның жіберу жылдамдығы максималды болуы керек.

1 шартты қанағаттандыртатын тиімді кодтарды префиксный деп атайды.

Себебі, бұл кодтарда алдыңғы комбинация ешқандай бөліктен немесе префикс басқа комбинацияларда бола алмайды.

2 шартты қанағаттандыратын кодтар оптималды деп есептеледі.

Хабардың

таратқышында кодтың минимал оптималды

орташа мәні nmin

,

бір-біріне тәуелсіз

![]() мына

теңдікте жатады.

мына

теңдікте жатады.

![]() .

(9.6)

.

(9.6)

Оптималды екілік код үшін (в=2, m=2).

Хабардың бір элементіне сай келетін нақты кодтың орташа мәні былай анықталады:

.

(9.7)

.

(9.7)

![]() .

(9.8)

.

(9.8)

(9.7) мәнді, (9.8) қойсақ, онда оптималдылық шарты n=nmin

![]() .

(9.9)

.

(9.9)

Сонымен,

А хабарының ai

элементіне сәйкес келетін

![]() кодалық

комбинациясының ni

дәрежесінің мәні оптималды тиімді кодта

оның түсуінің pi

ықтималдығына тәуелді. Ықтималдылығы

неғұрлым көп болса, соғұрлым кодтық

комбинацияның дәрежесі аз болады және

керісінше. Осыған байланысты, мұндай

кодтауды статистикалық (ықтималдылықты)

деп те атайды. Сонымен бірге, статистикалық

(тиімді) кодтар біркелкі емес кодтауға

жатады. Таратқыш кодерінің артықшылығын

келесі формуламен есептейді:

кодалық

комбинациясының ni

дәрежесінің мәні оптималды тиімді кодта

оның түсуінің pi

ықтималдығына тәуелді. Ықтималдылығы

неғұрлым көп болса, соғұрлым кодтық

комбинацияның дәрежесі аз болады және

керісінше. Осыған байланысты, мұндай

кодтауды статистикалық (ықтималдылықты)

деп те атайды. Сонымен бірге, статистикалық

(тиімді) кодтар біркелкі емес кодтауға

жатады. Таратқыш кодерінің артықшылығын

келесі формуламен есептейді:

.

(9.10)

.

(9.10)

Артық

шығыны

![]() нөлге

жуық болатын, оптималдыға жақын екілік

тиімді кодтың мысалы ретінде Шеннон-Фано

мен Хаффменнің кодын айтуға болады.

нөлге

жуық болатын, оптималдыға жақын екілік

тиімді кодтың мысалы ретінде Шеннон-Фано

мен Хаффменнің кодын айтуға болады.

Шеннон-Фаноның

әдісімен екілік кодтаудың принципін

қарастырайық. Екілік сивол элементтері

![]() ықтималдығының

азаю ретімен бағанға (топ) ретінде

орналасады. Кодтаудың бірінші бөлімінде

бұл топ мүмкіндігінше ықтималдықтарының

қосындысы бірдей болатын екі топқа

бөлінеді. Бірінші топтың барлық

элементтерін 0 символымен, ал екінші

топтың І символымен белгілейді. Кодтаудың

екінші бөлімінде ықтималдықтары бірдей

әр топты тағыда екі топқа жіктейді. Бұл

процесс бір элементтен тұратын топтар

шыққанша жалғасады.

ықтималдығының

азаю ретімен бағанға (топ) ретінде

орналасады. Кодтаудың бірінші бөлімінде

бұл топ мүмкіндігінше ықтималдықтарының

қосындысы бірдей болатын екі топқа

бөлінеді. Бірінші топтың барлық

элементтерін 0 символымен, ал екінші

топтың І символымен белгілейді. Кодтаудың

екінші бөлімінде ықтималдықтары бірдей

әр топты тағыда екі топқа жіктейді. Бұл

процесс бір элементтен тұратын топтар

шыққанша жалғасады.

(9.1-кестеде) Шеннон-Фаноның тармақталған ықтималдықпен ДХ таратушыға тиімді кодты құрудың мысалы келтірілген:

![]() ,

,

![]() ,

,

![]() ,

,

![]() .

.

Берілгені: Н (А)=1,75 бит, Hmax= 2 бит, r(A)=0.125.

Құрылған

код үшін:

![]() бит,

nmin=1.75

бит,

бит,

nmin=1.75

бит,

![]() Сәйкесінше,

берілген код оптималды. 10.1 Кестеде

берілген алғашқы код салыстыру үшін

келтірілген:

Сәйкесінше,

берілген код оптималды. 10.1 Кестеде

берілген алғашқы код салыстыру үшін

келтірілген:

![]() бит.

бит.

![]() /

/![]() =

ксж

қатынасы өрнегін қысу коэффициенті деп

атайды. Мұндағы Ксж=1,15.

=

ксж

қатынасы өрнегін қысу коэффициенті деп

атайды. Мұндағы Ксж=1,15.

9.1 кесте - Шеннон-Фано тиімді кодын құрудың мысалы

А {ai} |

{pi} |

Кодтау жолдары |

Тиімді код |

Алғашқы код |

|||||

I |

II |

III |

Код комб. |

ni таңба |

Код комб. |

niпр таңба |

|||

а3 а1 а0 а2 |

0,5 0,25 0,125 0,125 |

0 1 1 1 |

- 0 1 1 |

- - 0 1 |

0 10 110 111 |

1 2 3 3 |

11 01 00 10 |

2 2 2 2 |

|