- •Часть I основы математического моделирования и алгоритмизации процессов функционирования сложных систем

- •I. Методологические основы моделирования

- •1.1. Исходные понятия и определения.

- •1.2. Роль моделирования в процессе научного исследования

- •1.3. Понятие о подобии объектов

- •1.4. Математическое подобие объектов. Обзор способов определения коэффициентов подобия

- •1.5. Понятие о научном эксперименте, принцип максимального правдоподобия математических моделей

- •1.6. Понятие о методе максимального правдоподобия

- •1.7. Методика вычисления коэффициентов уравнения регрессии с помощью матричной алгебры

- •1.8. Моделирование объектов и систем, не допускающих активных экспериментов.

- •1.9. Проблема оценки правдоподобия моделей не существующих (проектируемых) систем.

1.7. Методика вычисления коэффициентов уравнения регрессии с помощью матричной алгебры

Для решения системы дифференциальных уравнений, приведенной в предыдущем параграфе, с помощью матричной алгебры необходимо:

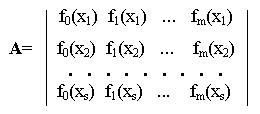

- представить полученные в результате опыта данные в следующем виде:

i = yi - [ 0f0(xi) + 1f1(xi) + ... + mfm(xi)], i = 1, ... , s, (1.15)

где s - число опытов в эксперименте;

- ввести и определить конструктивную (структурную) матрицу:

- ввести и определить транспонированную матрицу параметров:

' = ( 0, 1, ..., m);

- ввести и определить матрицу-столбец значений yi, i=1,...,s:

- представить систему (1.15) и функцию в матричной форме:

(последнее уравнение получено с учетом

того, что

![]()

- продифференцировать последнее выражение

функции по каждому

параметру i ,

в результате чего будет получена

следующая система уравнений:

![]()

- решить данную систему, выполняя следующие действия:

![]()

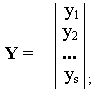

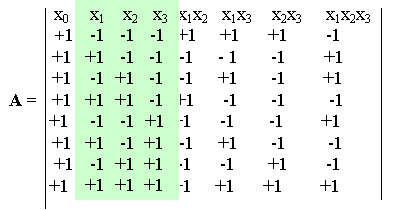

Для получения решения ^ необходимо, чтобы строки матрицы A' были линейно зависимы. Если при решении данной задачи использовать для представления уравнения регрессии формулу

то

вместо выражения fj(xi) можно

использовать выражение XKj , при

этом вычисления могут быть существенно

упрощены.

то

вместо выражения fj(xi) можно

использовать выражение XKj , при

этом вычисления могут быть существенно

упрощены.

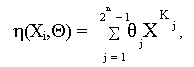

Пример. Пусть некоторый показатель исследуемого процесса представляет собой случайную величину Y = F(x1, x2, x3). Тогда функция регрессии i, , представляющая собой математическое ожидание E{yi}, i = 1,...,s, можно представить в вид полинома

i, = 0 + 1x1 + 2x2 + 3x3 + 4x1x2 + 5x1x3 + 6x2x3 + 7x1x2x3 .

При этом заглавная строка структурной матрицы A будет иметь следующий вид:

x0 , x1, x2, x3, x1x2, x1x3 x2x3 x1x2x3,

а сама матрица A, представляющая собой план проведения эксперимента, приобретает следующий вид: Таблица 1.1

Данная таблица обладает следующими свойствами:

- добавлена фиктивная переменная x0 для приведения свободного коэффициента 0 к общему виду;

- значения переменных xj, j {0, 1, 2, 3} определены на множестве {-1, +1}, где -1 замещает наименьшее, а +1 - наибольшее значение переменной xj из области допустимых ее значений;

- комбинации значений независимых переменных x1, x2, x3 в данном случае представлены всеми возможными элементами декартового произведения {-1, +1} {-1, +1} {-1, +1}, которое называется полным или насыщенным планом эксперимента;

- значения таблицы, представляющие нелинейные члены полинома ( i, ), получаются в результате перемножения значений переменных x1, x2, x3 в соответствующих столбцах таблицы;

- число строк s матрицы А соответствует наименьшему количеству опытов, необходимому для вычисления коэффициентов (в данном примере s = 23, что соответствует количеству искомых параметров j);

- матрица А должна обладать следующими свойствами:

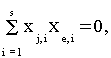

симметричности -

j = 1,2,...,7,

j = 1,2,...,7,

нормализованности

-

ортогональности -

e{1,...,7}, ej,

xj,i - функция из

заглавной строки таблицы 1.1, представляющая

собой комбинацию переменных x1,x2,x3.

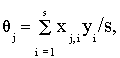

При наличии перечисленных свойств

матрицы А коэффициенты

j определяются по формуле

e{1,...,7}, ej,

xj,i - функция из

заглавной строки таблицы 1.1, представляющая

собой комбинацию переменных x1,x2,x3.

При наличии перечисленных свойств

матрицы А коэффициенты

j определяются по формуле

а дисперсия этих параметров - по

формуле

2 { j} =

2 {yi} / s. Приведенная

методика годится для оценки параметров

любой многофакторной функции

i,

. Классическим примером применения

метода максимального правдоподобия

является задача определения (уточнения)

параметров орбиты космического аппарата

[8]

.

а дисперсия этих параметров - по

формуле

2 { j} =

2 {yi} / s. Приведенная

методика годится для оценки параметров

любой многофакторной функции

i,

. Классическим примером применения

метода максимального правдоподобия

является задача определения (уточнения)

параметров орбиты космического аппарата

[8]

.

Примечание. Использование вычислительной процедуры, реализующей метод наименьших квадратов с целью получения оценок коэффициентов модели, которые удовлетворяли бы условиям несмещенности, состоятельности и эффективности, предполагает выполнение следующих условий [9]:

* независимые переменные представляют собой неслучайный набор чисел таких, что их среднее значение и дисперсия конечны,

* случайные ошибки i имеют нулевую среднюю и конечную дисперсию

![]()

* между независимыми переменными отсутствует корреляция и автокорреляция,

* случайная ошибка не коррелированна с независимыми переменными,

* случайная ошибка подчинена нормальному закону распределения,

* зависимость между входными (независимыми) переменными и выходными (зависимыми) линейна.