- •1.1 Что такое погрешности числа и вычислений.

- •1.2. Дайте определение погрешности.

- •1.4. Укажите формы записи абсолютной погрешности.

- •1.14. Привести формы записи числа с фиксированной и плавающей запятой. Привести примеры записи.

- •1.15. Что такое сомнительные и верные числа числа. Способы их вычисления.

- •1.24. Понятие вычислительного эксперимента.

- •1.27. Сколько значащих цифр в числе 1223.0034

- •1.28. Как влияет способ представления чисел в эвм на точность результатов.

- •3.1. Назовите приближенные методы решения систем нелинейных уравнений

- •3.6.Основные понятия итерационного процесса

- •3.20.Правило останова итерационных методов решения нелинейных уравнений

- •Метод простых итераций (метод Якоби) для решения систем нелинейных уравнений

- •Метод Ньютона для решения систем нелинейных уравнений

- •4.10 Нормой матрицы l называют такое вещественное число, которое удовлетворяет следующим условиям:

- •4.11 Примеры норм матриц

- •4.18. В чем сущность метода итерации для решения слау, как еще называют этот метод.

- •Метод Зейделя

- •Вычисление определителей методом Гаусса

- •5.1 Обыкновенное дифференциальное уравнение и уравнение в частных производных

- •5.2 Задача Коши и краевая задача

- •5.3 Методы Рунге-Кутта

- •5.7 Решение систем дифференциальных уравнений

- •5.8 Дайте определение задачи Коши

- •5.9 Дайте определение краевой задачи

- •5.10 Приведите классификацию дифференциальных уравнений

- •5.20 Методы Рунге для решении задачи Коши (идея и особенности)

- •5.21 Метод Эйлера для решения задачи Коши

- •5.22 Принцип Рунге для оценки шага при решении задачи Коши

- •5.23 Источники погрешности методов Рунге - Кутта

- •6.1 Основные задачи аппроксимации функций

- •6.2 Понятие интерполяции данных, критерий интерполяции

- •6.4 Фильтрация и сглаживание данных

- •6.5 Регрессионное уравнение

- •6.6 Метод наименьших квадратов

- •6.7 Экстраполяция данных (прогноз данных)

- •6.8 Показатели эффективности аппроксимации

- •6.9 Решение задач аппроксимации в пакете MathCad

- •6.10 Приведите понятие аппроксимации функций

- •6.11 Приведите понятие интерполирования данных (глобальная и локальная интерполяция)

- •6.12 Что такое сглаживание данных

- •6.17 В чем состоит основная идея сплайн аппроксимации.

- •6.18 Критерий метода наименьших квадратов

- •6.20. Процедуры интерполирования данных в ппп MathCad

- •6.21 Понятие регрессионного уравнения

- •6.22 Что такое базисные функции? Пример базисных функций.

- •6.23 Суть метода наименьших квадратов

- •6.24 Понятие аппроксимации

- •6.25. Показатели эффективности приближения данных

4.18. В чем сущность метода итерации для решения слау, как еще называют этот метод.

Метод простых итераций или метод Якоби

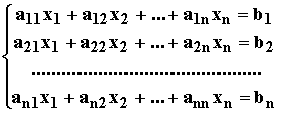

Рассмотрим неоднородную систему линейных алгебраических уравнений (СЛАУ)

(1)

(1)

Для получения итерационных формул метода простых итераций из первого уравнений СЛАУ (3.6) выражается x1, из второго – x2, из последнего n-го уравнения – xn. В результате получим систему

x1= (b1- a12x2 - a13x3 - … - a1n xn) / a11;

x2 = (b2– a21x1 – a23x3 - … - a2n xn) / a22;

………………………………………….

xn = (bn– an1x1 – an2x2 - … - an n-1 xn-1) / ann.

Или в общем виде

, i=1, n |

|

k=1,2, …до тех пор пока |

x(k)-x(k-1) . |

|

Достаточным условием сходимости решения системы (1) является диагональное преобладание матрицы A:

. |

|

На каждом шаге происходит приближение корней СЛАУ к истинным значениям.

4.19 |

Сформулируйте достаточные условия сходимости метода Зейделя для решения СЛАУ. |

Обычно

процесс Зейделя сходится быстрее, чем

метод Якоби. Бывает, что процесс Зейделя

сходится, когда простая итерация

расходится и, т.п. Правда, бывает и

наоборот. Во всяком случае, достаточные

условия сходимости для метода Якоби

достаточны и для сходимости метода

Зейделя. Если выполняется достаточное

условие сходимости для системы

(i

= 1, 2, …n).

(i

= 1, 2, …n).

– по строкам, то

в методе Зейделя выгодно расположить

уравнения

так, чтобы первое уравнение системы имело наименьшую сумму модулей коэффициентов:

.

.

Достаточным условием сходимости решения системы A·x = f, является то, что матрица A является матрицей с преобладающими диагональными элементами, то есть

4.20 |

Назовите особенности метода Зейделя. |

Является модификацией метода Якоби и отличается от него, тем, что для вычисления корня, на к+1 итерации используются корни в формуле Якоби уже вычисленное на этой, к+1 итерации.

Сходимость метода Зейделя выше, чем в методе Якоби, однако существуют СЛАУ, для которых метод Якоби сходится, а метод Зейделя расходится. В этом случае существует собственное условие сходимости Зейделя определяет.

Т: Пусть А вещественная положительная определенная матрица, тогда метод Зейделя сходится при любых начальных приближениях.

4.21 |

Назовите функции для решения систем уравнений в Mathcad и особенности их применения. |

Для решения СЛАУ в ППП MathCad используется процедура lsolve. Рассмотрим применение процедуры на следующим примере:

Решением этой система являются значения х1=3, х2=2.

В пакете Mathcad найти решение этой системы можно так:

.

Отметим, что задав матрицу A и вектор b вектор неизвестных x можно найти решив непосредственно векторно-матричное уравнение

.

4.22 |

Метод Зейделя для решения СЛАУ |

Метод Зейделя

Этот метод представляет собой некоторую модификацию метода простой итерации. Основная его идея заключается в том, что при вычислении (k+1)-го приближения неизвестной xi учитываются уже вычисленные ранее (k+1)-е приближения (x1 x2, ..., xi-1).

Пусть дана приведенная линейная система:

(i = 1, 2, …n). (1)

Выберем

произвольно начальные приближения

корней

,

стараясь, конечно, чтобы они в какой-то

мере соответствовали неизвестным x1,

x2,

x3,

..., xn.

,

стараясь, конечно, чтобы они в какой-то

мере соответствовали неизвестным x1,

x2,

x3,

..., xn.

Предположим,

что k-е

приближение

корней известно, тогда в соответствии

с идеей метода будем строить (k+1)

– е приближение по следующим формулам:

корней известно, тогда в соответствии

с идеей метода будем строить (k+1)

– е приближение по следующим формулам:

(2)

(k = 0, 1, 2,...).

Обычно процесс Зейделя сходится быстрее, чем метод Якоби. Бывает, что процесс Зейделя сходится, когда простая итерация расходится и, т.п. Правда, бывает и наоборот. Во всяком случае, достаточные условия сходимости для метода Якоби достаточны и для сходимости метода Зейделя. Если выполняется достаточное условие сходимости для системы (1) – по строкам, то в методе Зейделя выгодно расположить уравнения (2) так, чтобы первое уравнение системы имело наименьшую сумму модулей коэффициентов:

. (3)

4.23 |

Основная идея метода Гаусса с выбором главного элемента |

1. На каждом шаге преобразования выбирается максимальный по модулю элемент аpq, р-ая строка главная аpq-главный

2.

для всех строк, кроме главной находится

сомножитель

3. Каждой неглавной строке добавляем главную умножающую на сомножитель mi, в результате q-ый столб нулевой, вычеркиваем p-ую строку и q-ый столбец

4. Повторяем процедуру (n-1) раз

5. Составляем матрицу из вычеркнутых строк, она не треугольного вида, однако строка последнего преобразования содержит только один элемент, предпоследнего 2-а и т.д. в этом порядке и вычисляем неизвестное хi

4.24 |

Вычисление обратной матрицы по методу Гаусса |

Вычисление обратной матрицы методом Гаусса

Пусть дана неособенная матрица

A = [aij] (i,j = 1,2, ..., n).

Необходимо найти её обратную матрицу

A-1 = [xij] (i,j = 1,2, ..., n).

Вспомним основное соотношение линейной алгебры:

A·A-1 = E,

где Е – единичная матрица.

Перемножая матрицы A и A-1, получаем n2 уравнений относительно n2 неизвестных xij:

(i,j

= 1, 2, ..., n),

(i,j

= 1, 2, ..., n),

где

Таким образом, получим n систем линейных уравнений для j = 1, 2, ..., n, имеющих одну и ту же матрицу коэффициентов A и различные столбцы - свободные члены, которые можно одновременно решить методом Гаусса.

4.25 |

Основные классы методов решения СЛАУ |

Методы решения СЛАУ

Разделяют на две группы:

1) прямые

2) итерационные

1. Прямые позволяют получить решение за конечное число шагов (достоинство метода), не накапливают ошибки вычисления

недостатки: 1) применимы лишь к матрицам ограниченной размерности (200)

2) требуют хранения всей матрицы системы, на каждом шаге

3) плохо работают с разряженными (неплотными (много нулей)) матрицами

к ним относятся: метод Гаусса, Крамера, Жордан, метод главных компонентов.

2. итерационны

недостатки: 1) нельзя заранее определить количество шагов (итераций)

2) методы накапливают погрешность

достоинства: 1) применимы к системам любой размерности

2) работают со слабо заполненными матрицами

относятся: 1) метод простых итераций (Якоби)

2) Зейделя

3) Релаксации

4.26 |

Вычисление определителя по методу Гаусса |