- •Математическая статистика и теоретические основы судовождения

- •Математическая статистика и теоретические основы судовождения

- •Содержание

- •Вспомогательные сведения из математики

- •Некоторые правила и приемы приближенных вычислений

- •Тригонометрические функции малых углов

- •Предельные величины аргумента при заданной точности вычислений тригонометрических функций

- •Интерполяция

- •Функция в табличном виде

- •Обозначения к формулам и

- •Сферическая тригонометрия

- •Основные определения и понятия

- •Взаимополярные треугольники

- •Теоремы сферической тригонометрии

- •Решение сферических треугольников

- •Математический анализ и обработка навигационной информации

- •Случайные величины

- •Числовые характеристики случайных величин

- •Основные законы распределения случайных величин

- •Системы случайных величин

- •Случайные функции, случайные процессы

- •Использование методов математической статистики в судовождении

- •Статистические оценки числовых характеристик случайных величин

- •Погрешности навигационной информации

- •Обработка измерений навигационных параметров

- •Доверительная оценка случайной величины

- •Оценка точности функции измеренных аргументов

- •Обоснование метода выбора обсервации

- •Навигационная информация

- •Навигационные параметры

- •Изолинии навигационных параметров

- •Обобщенный метод линий положения

- •Градиент навигационного параметра

- •Определение места судна обобщенным методом линий положения

- •Оценка точности места судна

- •Оценка точности обсервации по двум независимым линиям положения

- •Влияние систематической погрешности в линиях положения на обсервованное место

- •Эллипс погрешностей

- •Вероятности нахождения судна в различных эллипсах

- •Расчет элементов эллипса погрешностей

- •Круговая погрешность места судна

- •Обработка избыточной информации при определении места судна

- •Использование избыточной информации при определении места судна

- •Совместный учет счисления и обсервации

- •Последовательный метод наименьших квадратов

- •Оптимальный фильтр Калмана

- •Меры повышения безопасности мореплавания

- •Требования имо к точности судовождения

- •Минимальные требования к морским пользователям

- •Оценка навигационной безопасности в стесненных для плавания районах

- •Приложение 1. Вопросы к контрольной работе № 1

- •Приложение 2. Вопросы к контрольной работе № 2

- •Литература

- •Математична статистика I теоретичнi засади судноводiння

- •65029, М. Одеса, Дідріхсона,8, корп.7

- •Служебное произведение

- •Математическая статистика и теоретические основы судовождения

- •Одесса – 2011

Системы случайных величин

Под системой понимают две или несколько случайных величин, рассматриваемых совместно. Например, значения крена, дифферента и рыскания в данный момент, погрешности в широте и долготе и т.п. Для двух случайных величин Х и Y система геометрически обычно представляется плоскостью, на которой можно перебрать все возможные сочетания х и y . Такие сочетания будут случайными, как и сами величины.

Рассмотрим три различных варианта таких сочетаний, которые показаны на рис. 3.5.

Системы случайных величин

На рис. 3.5 а) каждому значению Х может соответствовать любое значение Y.

На рис. 3.5 b) каждому значению Х соответствует определенный интервал, в котором может находиться Y. Причем, этот интервал при увеличении Х смещается вверх по оси Y.

Наконец, на рис. 3.5 с) каждому значению Х соответствует всего одно значение Y. В этом случае говорят о жесткой зависимости между Х и Y. Такую зависимость называют функциональной

Во втором случае зависимость просматривается, но она не такая однозначная, как функциональная. Такую зависимость называют стохастической.

В первом же случае нет никакой зависимости, т.е Х и Y независимы.

Таким образом, системы случайных величин различаются степенью зависимости или теснотой связи.

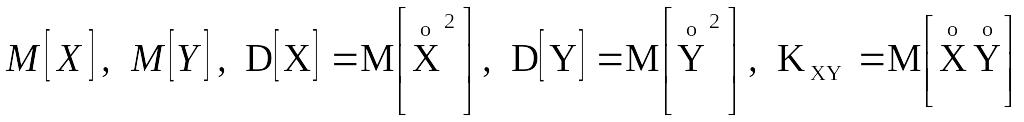

Достаточно полно система двух случайных величин может быть охарактеризована математическими ожиданиями Х и Y, их дисперсиями, а также математическим ожиданием произведения центрированных случайных величин:

.

.

где

![]() − центрированные относительно

математических ожиданий случайные

величины.

− центрированные относительно

математических ожиданий случайные

величины.

Первые две характеристики представляют средние значения случайных величин, и называются характеристиками положения, вторая пара (дисперсии) отражает разброс по осям Х и Y, последняя характеристика называется корреляционным моментом и является показателем тесноты связи или меры взаимозависимости этих величин.

Для дискретных случайных величин корреляционный момент выражается формулой , для непрерывных − .

![]() ;

;

.

.

Корреляционный момент имеет размерность произведения случайных величин. Чтобы перейти к безразмерной характеристике, его делят на произведение средних квадратических отклонений, в результате чего получают коэффициент корреляции

.

.

Коэффициент корреляции может быть в пределах от 0 до ±1. Чем ближе коэффициент корреляции к 1, тем теснее зависимость. Для функциональной зависимости r = 1, для независимых величин r = 0. Стохастическую зависимость называют также корреляционной.

Здесь следует заметить, что для независимых Х и Y корреляционный момент (и коэффициент корреляции) равен 0, но обратное утверждение верно только для нормально распределенных величин, т.е. у некоторых зависимых систем (распределенных не по нормальному закону), он может быть равен 0.

Коэффициент корреляции характеризует линейную зависимость, причем, со знаком «+» положительную корреляцию (при возрастании Х возрастает Y, рис. 3.5 b) ) и со знаком «-» − отрицательную корреляцию (обратная зависимость).

Если зависимость может быть представлена уравнением прямой, то r = 1 (рис. 3.5 с)).

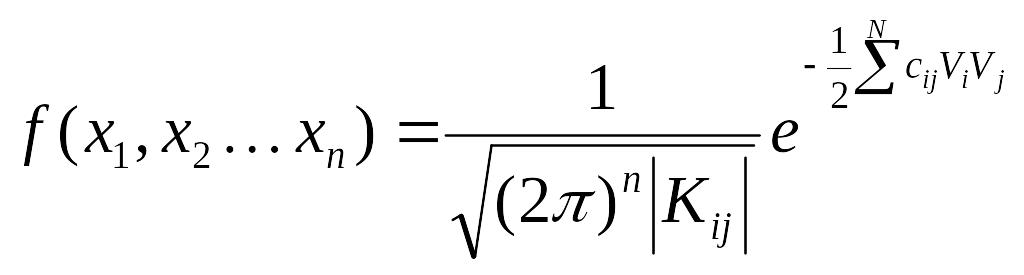

Дисперсии случайных величин и корреляционный момент составляют так называемую корреляционную матрицу

![]() .

.

Матрица может быть записана для любого количества случайных величин и, так как Kху =Kух , иногда ее представляют верхней от диагонали дисперсий частью.

Обычно достаточно знать только взаимозависимость случайных величин безотносительно к их разбросу. Для этого все элементы корреляционной матрицы делят на произведение соответствующих средних квадратических отклонений. Тогда вместо корреляционных моментов будут стоять коэффициенты корреляции, а по диагонали − единицы. Такая матрица называется нормированной корреляционной матрицей

![]() .

.

Нормальный закон распределения для системы случайных величин

Плотность распределения системы величин f (x,у) определяется на основании теоремы умножения законов распределения и равна произведению плотности распределения одной величины на условную плотность распределения другой величины. Под условной понимают плотность распределения при условии, что другая величина приняла заданное значение.

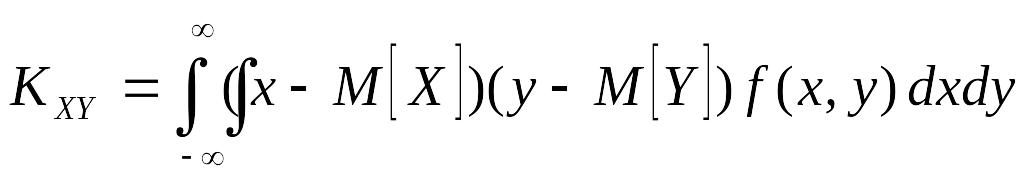

Для произвольного количества случайных величин х1, х2 …. хп плотность вероятности их совместного появления равна

.

.

где:

![]() − определитель корреляционной матрицы;

− определитель корреляционной матрицы;

V = xi − x − отклонение случайной величины от математического ожидания;

cij − элементы матрицы, обратной к корреляционной;

n − количество случайных величин;

N = п2 − общее число слагаемых.

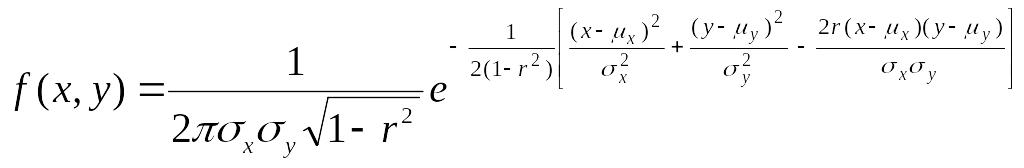

В принятых ранее обозначениях плотность распределения системы двух любых случайных величин можно записать в виде

.

.

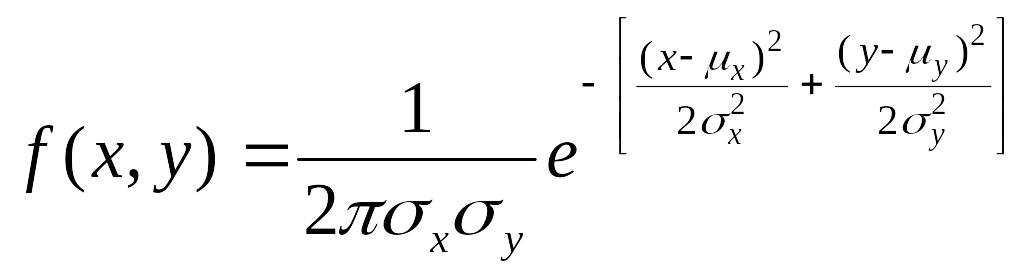

Если величины независимы, коэффициент корреляции r равен 0, выражение (5.23) упрощается:

.

.

Нормальный закон распределения системы в виде и используется при оценке точности обсервации соответственно по зависимым и независимым навигационным параметрам.