- •Тема 4. Пропускная способность каналов связи.

- •4.1. Пропускная способность (информационная емкость) дискретного канала без памяти.

- •4.2. Информационная емкость двоичного симметричного канала без памяти.

- •4.3. Информационная емкость непрерывных каналов.

- •4.4. Основные теоремы кодирования для канала с помехами.

Тема 4. Пропускная способность каналов связи.

4.1. Пропускная способность (информационная емкость) дискретного канала без памяти.

Пусть,

как и ранее, на вход дискретного канала

без памяти (ДКБП) поступает последовательность

символов

![]() ,

где

,

где![]() принадлежат некоторому множеству

(алфавиту)X,

а

принадлежат некоторому множеству

(алфавиту)X,

а

![]() .

На выходе канала наблюдается

последовательность

.

На выходе канала наблюдается

последовательность

![]() ,

принадлежащая множеству

,

принадлежащая множеству![]() .

В соответствии с определением ДКБП

переходные вероятности задаются

соотношением

.

В соответствии с определением ДКБП

переходные вероятности задаются

соотношением

![]() ,

,

где

в стационарном случае

![]()

вероятность превращения входного

символа

вероятность превращения входного

символа

![]() в выходной

в выходной![]() (переходная вероятность на символ) не

зависит от дискретного времени

(переходная вероятность на символ) не

зависит от дискретного времени![]() ,

т.е.

,

т.е.![]() ,

где

,

где![]() и

и![]() .

Покажем, что при этом пропускная

способность канала определяется только

алфавитами входных и выходных символов

и переходной вероятностью

.

Покажем, что при этом пропускная

способность канала определяется только

алфавитами входных и выходных символов

и переходной вероятностью![]() на символ.

на символ.

Ансамбли

входных

![]() и выходных

и выходных![]() последовательностей можно рассматривать

как произведения ансамблей

последовательностей можно рассматривать

как произведения ансамблей![]() и

и![]() соответственно, где

соответственно, где![]() и

и![]() ,

,![]() – ансамбли входных и выходных символов

вi-й

момент времени, причем, как указывалось

ранее,

– ансамбли входных и выходных символов

вi-й

момент времени, причем, как указывалось

ранее,

![]() и

и![]() для любыхi.

Тогда согласно правилу аддитивности

энтропии (2.20)

для любыхi.

Тогда согласно правилу аддитивности

энтропии (2.20)

![]()

и свойству не убывания энтропии по мере роста объема наблюдений (2.17)

![]() ,

,

справедлива оценка

![]() . (4.1)

. (4.1)

С

другой стороны, при заданных входных

символах

![]() выходные символы

выходные символы![]() ДКБП независимы и в силу аддитивности

энтропии

ДКБП независимы и в силу аддитивности

энтропии

![]() .

.

Таким

образом,

![]() ,

откуда в соответствии с (2.30) следует,

что верхняя граница средней взаимной

информации на символ (или информационная

емкость) ДКБП, определяется как

,

откуда в соответствии с (2.30) следует,

что верхняя граница средней взаимной

информации на символ (или информационная

емкость) ДКБП, определяется как

![]() , (4.2)

, (4.2)

где

учтено, что

![]() определяется лишь статистикой

определяется лишь статистикой![]() отдельного

символа.

отдельного

символа.

Убедимся,

что равенство в (4.2) достигается тогда,

когда ансамбли

![]() статистически независимы. Для ДКБП

данное условие выполняется, если входные

символы статистически независимы, т.е.

если

статистически независимы. Для ДКБП

данное условие выполняется, если входные

символы статистически независимы, т.е.

если![]() .

Действительно, по теореме умножения

вероятностей

.

Действительно, по теореме умножения

вероятностей

![]() ,

,

так что

![]() .

.

Как

и утверждалось, независимость символов

входной последовательности гарантирует

независимость символов выходной, а

значит, совпадение всех условных энтропий

![]() с безусловной

с безусловной![]() и равенство в соотношении (4.1). Тем самым

обеспечивается и равенство

и равенство в соотношении (4.1). Тем самым

обеспечивается и равенство![]() ,

максимизация правой части которого по

распределению

,

максимизация правой части которого по

распределению![]() даст правую часть (4.2). Это означает, что

средняя взаимная информация на символ

даст правую часть (4.2). Это означает, что

средняя взаимная информация на символ![]() (точнее, ее верхняя грань) в реальности

максимизируется до предела, указываемого

(4.2), и, тем самым, информационная емкость

ДКБП

(точнее, ее верхняя грань) в реальности

максимизируется до предела, указываемого

(4.2), и, тем самым, информационная емкость

ДКБП

![]() . (4.3)

. (4.3)

Поскольку

![]() ,

из полученного результата следует, что

информационная емкость ДКБП при заданных

входном и выходном алфавитах зависит

только от символьной переходной

вероятности

,

из полученного результата следует, что

информационная емкость ДКБП при заданных

входном и выходном алфавитах зависит

только от символьной переходной

вероятности![]() :

энтропия

:

энтропия![]() определяется лишь распределением

определяется лишь распределением![]() ,

по которому осуществляется максимизация,

а

,

по которому осуществляется максимизация,

а![]() зависит помимо распределения

зависит помимо распределения![]() только от

только от![]() .

.

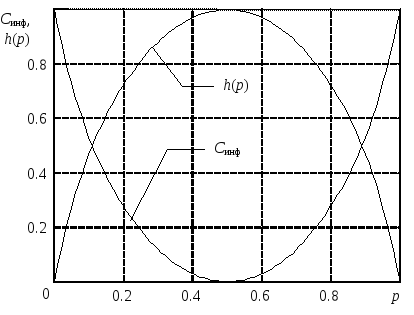

4.2. Информационная емкость двоичного симметричного канала без памяти.

Проиллюстрируем сказанное на примере ДСК без памяти (ДСКБП), задаваемого моделью, представленной на рис. 1.4, и описываемого переходными вероятностями

![]() ,

,![]() .

.

Пусть

![]() – вероятность появления на входе канала

– вероятность появления на входе канала![]() .

Тогда согласно (2.13)

.

Тогда согласно (2.13)

![]() ,

,

поскольку

при любом

![]() на выходе канала возможны только два

состояния с вероятностямиp

и

на выходе канала возможны только два

состояния с вероятностямиp

и

![]() ,

и значит,

,

и значит,

![]() .

.

Таким

образом, условная энтропия

![]() не зависит от распределения вероятностей

на входе, поэтому максимизация

не зависит от распределения вероятностей

на входе, поэтому максимизация![]() сводится к максимизации только

сводится к максимизации только![]() 1.

1.

В

соответствии с (2.4) максимум

![]() ,

равный 1, достигается при равной

вероятности выходных символов. Поскольку

,

равный 1, достигается при равной

вероятности выходных символов. Поскольку

![]() ,

,

![]() ,

,

то

данное требование автоматически

удовлетворяется при равновероятности

входных символов, т.е.

![]() .

В итоге информационная емкость ДСКБП

.

В итоге информационная емкость ДСКБП

![]() . (4.4)

. (4.4)

|

|

|

Рис. 4.1 |