Классификация букв алфавита на основе нейронных сетей / ПЗ_Каримов

.doc

|

Продолжение таблицы 2

Из анализа таблицы 2 следует, что оптимальной структурой сети является: • комплем. Гауссова функция для блока 1; • комплем. Гауссова функция для блока 2; • количество скрытых нейронов – 58(29 в каждом из блоков);

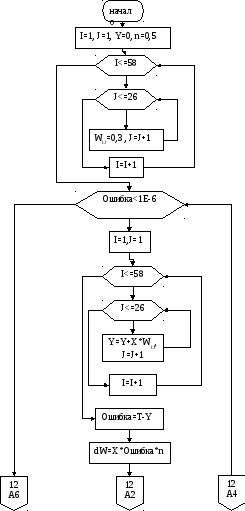

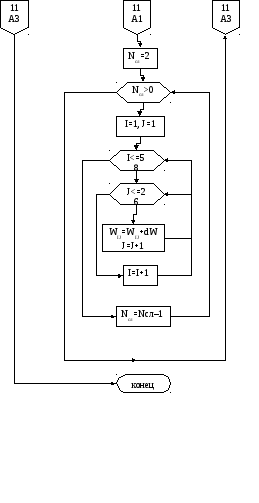

2.3. Блок-схема алгоритма обучения

Блок-схема алгоритма обучения с обратным распространением ошибки:

|

||||||||||

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|||||||||

|

13 |

||||||||||

|

|

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

14 |

|

|

|

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

15 |

|

|

2.4. Формирование исходных данных

Для формирования исходных данных был выбран английский алфавит и шрифт Arial. Затем был использован редактор шрифтов Softy для разбиения букв сеткой 10х10 и составления вектора размерности 100, в котором нули соответствуют незакрашенной ячейке, единицы – закрашенной. Последовательное занесение значений ячеек в вектор производилось сверху вниз, слева направо. Выходной вектор имеет размерность 26, в нем номер позиции единицы соответствует номеру буквы. Таким образом был создан файл “alphavit.xls” в котором 26 входных и 26 выходных векторов. Данный файл прилагается в электронном виде к пояснительной записке.

2.5. Выбор параметров обучения

Выбор параметров обучения основан на анализе результатов эксперимента для сети Ворда с двумя скрытыми блоками, имеющими разные передаточные функции, с обходным соединением, с количеством скрытых нейронов равном 58.

Таблица 3 Выбор скорости обучения

Из анализа таблицы 3 следует, что оптимальная скорость обучения равна 0,5. Проанализируем теперь зависимость обучаемости сети от момента при выбранной скорости обучения. |

|||||||||||||||||||||||||

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

||||||||||||||||||||||||

|

16 |

|||||||||||||||||||||||||

|

Таблица 4 Выбор момента

Из анализа таблицы 4 следует, что оптимальное значение момента равно 0,1. Таким образом оптимальными параметрами обучения для данной сети являются:

|

||||||||||||||||

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|||||||||||||||

|

17 |

||||||||||||||||

|

3. Анализ качества обучения

Для проверки способностей к обобщению на вход сети подаются зашумленные последовательности входных сигналов. Процент зашумления показывает, какое количество битов входного вектора было инвертировано по отношению к размерности входного вектора. Исходные и выходные файлы для анализа качества обучения: noise4.xls и noise4.out – для 4%; noise7.xls и noise7.out – для 7%; noise10.xls и noise10.out – для 10%. В силу большой размерности таблиц, содержащих входные и выходные вектора, данные файлы прилагаются к пояснительной записке в электронном виде. Из предложенных таблиц видно, что при зашумлении до 7% сеть хорошо решает предложенную задачу. При вводе сигналов с уровнем шума 10% обученная сеть выдает неверные значения на всех пяти экзаменационных наборах (т.е. сеть не может отдать предпочтение одной из нескольких букв). Например, при подаче зашумленного вектора, соответствующего букве А, выход сети, соответствующий А равен 1, выход Z – 0,58. При подаче буквы B соответствующий выход равен 0,95, выход G – 0,7. Понизить ошибку можно увеличив размерность сетки, которой разбиваются буквы, например 16х16, тогда размерность входного вектора 256. Кроме того можно понизить среднюю ошибку при обучении сети. Но, несмотря на все выше сказанное, можно сказать, что сеть хорошо обучилась и обладает хорошими способностями к обобщению. |

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

18 |

|

|

Для тестирования сети используем экзаменационные данные из файла “test.xls” с уровнем шума 5 %. Результаты отражены в файле “test.out”, который прилагается к пояснительной записке в электронном виде. Из анализа содержимого файла можно сделать вывод, что обученная сеть справляется с поставленной задачей и обладает хорошей способностью к обобщению.

|

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

19 |

|

|

В данной курсовой работе был решен частный случай задачи классификации букв алфавита на основе нейронных сетей. Задача была решена только для букв английского алфавита написанных шрифтом Arial, написанных 10 размером. Для решения задачи на других данных (других алфавитов, шрифтов, размеров шрифтов) потребуется ввести некоторые изменения: • Увеличить количество записей в файле обучения; • Увеличить количество ячеек, на которые разбивается символ (обычно применяется растр размером 16х16 пикселей); • Уменьшить среднюю ошибку при обучении нейронной сети; • Для применения данной схемы к другим размерам букв нужно нормализовать поступающие на вход сети символы к единому размеру, например 16х16.

|

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

20 |

|

|

Список использованных источников

|

|

|

КР-НГТУ-071900-(02-КТ-1)-15-05 |

Лист |

|

21 |

|