- •Системы искусственного интеллекта

- •1. Общие понятия об искусственном интеллекте.

- •1.1. Предмет исследования искусственного интеллекта.

- •1.2. Проблемы искусственного интеллекта.

- •1.3. История развития систем искусственного интеллекта.

- •1.4. Подходы к построению систем искусственного интеллекта.

- •2. Знания в системах искусственного интеллекта.

- •2.1. Понятие и виды знаний.

- •2.2. Системы баз знаний.

- •2.3. Онтологии.

- •2.4. Методы представления знаний.

- •2.5. Методы приобретения знаний.

- •3. Экспертные системы.

- •3.1. Базовые понятия.

- •3.2. Методика построения эс.

- •4. Искусственная жизнь.

- •4.1. Генетические алгоритмы.

- •4.2. Клеточные автоматы.

- •5. Распознавание образов.

- •5.1. Понятие образа.

- •5.2. Проблема обучения распознаванию образов.

- •5.3. Гипотеза компактности.

- •5.4. Подходы к распознаванию образов.

- •5.5. Обучение и самообучение распознаванию образов.

- •6. Методы обучения распознаванию образов.

- •6.1. Кластерный анализ структуры многомерных данных.

- •6.1.1. Основные понятия кластерного анализа.

- •6.1.2. Общая схема кластеризации.

- •6.1.3. Методы кластеризации.

- •6.2. Метод потенциальных функций.

- •6.3. Метод предельных упрощений.

- •6.4. Коллективы решающих правил.

- •6.5. Метод группового учета аргументов.

6.2. Метод потенциальных функций.

Пусть требуется разделить два непересекающихся образа V1 и V2. Это значит, что нужно найти функцию положительную в точках образа V1 и отрицательную в точках образа V2.

В

процессе обучения с каждой точкой

обучающей последовательности

связывается потенциальная

функция

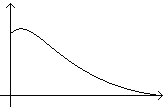

![]() (по аналогии с потенциалом электрического

поля вокруг точечного электрического

заряда, который убывает при удалении

от заряда). Если поле образовано

несколькими зарядами, то потенциал в

каждой точке этого поля равен сумме

потенциалов зарядов. Если заряды

расположены компактной группой, то

потенциал будет максимальным внутри

группы. Тогда могут быть построены

потенциальные функции для каждого

образа:

(по аналогии с потенциалом электрического

поля вокруг точечного электрического

заряда, который убывает при удалении

от заряда). Если поле образовано

несколькими зарядами, то потенциал в

каждой точке этого поля равен сумме

потенциалов зарядов. Если заряды

расположены компактной группой, то

потенциал будет максимальным внутри

группы. Тогда могут быть построены

потенциальные функции для каждого

образа:

![]() ,

,

![]() .

.

В качестве разделяющей функции можно выбрать функцию вида

![]() .

.

Примеры потенциальных функций:

![]() ;

;

где α – параметр функции;

![]() – расстояние

между объектами.

– расстояние

между объектами.

В

процессе обучения предъявляется

обучающая последовательность и на

каждом n-м

такте обучения строится приближение

![]() по следующей процедуре:

по следующей процедуре:

![]() ;

;

![]()

где – положительная константа.

Процесс

обучения останавливается, когда

![]() перестает меняться.

перестает меняться.

6.3. Метод предельных упрощений.

Метод использует подход, при котором, в отличие от построения сложных разделяющих поверхностей в заданных пространствах признаков, формируется такое пространство, в котором процесс распознавания очень прост.

В методе предельных упрощений предполагается, что разделяющая функция задается заранее в виде линейного полинома, а процесс обучения состоит в конструировании такого пространства минимальной размерности, в котором эта функция правильно разделяет обучающую последовательность. Алгоритм построения такого пространства предполагает последовательный отбор тех свойств объектов, которые позволяют правильно решить большинство обучающих примеров. Такой отбор признаков продолжается до тех пор, пока не наступит безошибочное линейное разделение образов на обучающей последовательности.

Для разделения образов выбирается гиперплоскость, описываемая уравнением

или

или

,

где xi

– i-й

признак.

,

где xi

– i-й

признак.

6.4. Коллективы решающих правил.

Этот подход объединяет различные алгоритмы для решения задач распознавания.

Пусть в некоторой ситуации Х принимается решение S. Тогда S = R(X), где R – алгоритм принятия решения в ситуации X. Пусть существует L различных алгоритмов решения задачи, т. е. Sl = Rl(X), где l = 1, ..., L; Sl – решение, полученное алгоритмом Rl.

Множество алгоритмов {R} = {R1, R2, ..., RL} называется коллективом алгоритмов решения задачи (коллективом решающих правил), если на множестве решений Sl в любой ситуации Х определено решающее правило F, т. е. S = F(S1, S2, ..., SL, X). Алгоритмы Rl называются членами коллектива, Sl – решение l-го члена коллектива, а S – коллективное решение. Функция F определяет способ обобщения индивидуальных решений для получения решения коллектива S.

Выбор правила осуществляется взвешиваньем его компетентности в решаемой задаче. Например, вес решающего правила Rl может определяться соотношением

где Bl – область компетентности решающего правила Rl.

Веса

решающих правил выбираются так, что

![]() для всех возможных значений X.

для всех возможных значений X.

Такой подход представляет собой двухуровневую процедуру распознавания: на первом уровне определяется принадлежность образа той или иной области компетентности, а на втором – вступает в силу решающее правило, компетентность которого максимальна в найденной области.