- •7 Регресійний аналіз

- •7.1 Попередній аналіз даних

- •7.2 Припущення, які використовує регресійний аналіз

- •7.3 Вибір вигляду функції для монотонних процесів

- •7.4 Метод найменших квадратів для оцінки параметрів функції регресії

- •Властивості регресії

- •7.5 Оцінка якості моделі

- •7.6 Критерій Фішера для оцінки адекватності моделі

- •7.7 Перевірка значущості коефіцієнтів регресії

- •7.8 Функції Excel для побудови регресійних залежностей

- •Розв’язання

- •7.9 Парна регресія в матричній формі

- •7.10 Метод найменших квадратів при оцінюванні параметрів поліномів

- •Розв’язання

- •7.11 Множинний регресійний аналіз

- •7.11.1 Матричний спосіб оцінки параметрів множинної регресії

- •7.11.2 Перевірка значущості коефіцієнтів регресії

- •7.11.3 Перевірка якості моделі. Скоригований коефіцієнт детермінації

- •7.11.4 Парна й часткова кореляції

- •Розв’язання.

- •7.12 Методи побудови багатофакторної регресійної моделі

- •7.12.1 Вибір "найкращого" рівняння регресії

- •7.12.2 Метод усіх можливих регресій

- •7.12.3 Метод виключень

- •7.12.4 Кроковий регресійний метод

- •Питання і завдання до розділу 7

- •Лабораторна робота Тема. Парний регресійний аналіз

- •Лабораторна робота Тема. Множинний регресійний аналіз

- •8 Дисперсійний аналіз

- •8.1 Однофакторний дисперсійний аналіз

- •Розв’язання.

- •Питання і завдання до розділу 8

- •Лабораторна робота Тема. Однофакторний дисперсійний аналіз

- •9 Ранговий аналіз

- •9.1 Коефіцієнт рангової кореляції Кенделла (Кендалла)

- •9.2 Коефіцієнт рангової кореляції Спірмена

- •Розв’язок.

- •9.3 Коефіцієнт конкордації

- •Питання і завдання до розділу 9

7.3 Вибір вигляду функції для монотонних процесів

При моделюванні монотонних процесів (зростаючих або спадних), коли число спостережень n невелике, може бути використана одна з таких регресійних функцій, що залежать від двох параметрів:

1)

![]() 2)

2)

![]() 3)

3)

![]()

4)![]() 5)

5)![]() 6)

6)![]()

7)

![]() 8)

8)

![]() 9)

9)

![]()

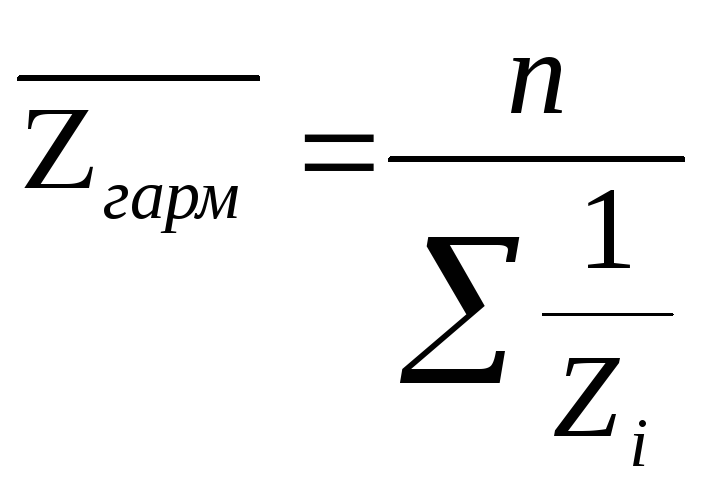

Ці

залежності примітні тим, що якщо табличні

значення задовольняють одне із цих

рівнянь, то й середні значення

![]() та

та

![]() також його задовольняють. При цьому в

ролі

також його задовольняють. При цьому в

ролі

![]() та

та

![]() може бути середнє арифметичне, геометричне

й гармонічне:

може бути середнє арифметичне, геометричне

й гармонічне:

![]() ,

, ![]() ,

,

.

.

|

N |

|

|

|

|

Вигляд функції |

|

1 |

х(ар) |

Y(ар) |

|

|

|

|

2 |

х(геом) |

Y(ар) |

|

|

|

|

3 |

|

Y(ар) |

|

|

|

|

4 |

х(ар) |

Y(геом) |

|

|

|

|

5 |

х(геом) |

Y(геом) |

|

|

|

|

6 |

х(гарм) |

Y(геом) |

|

|

|

|

7 |

х(ар) |

y(гарм) |

|

|

|

|

8 |

х(геом) |

Y(гарм) |

|

|

|

|

9 |

х(гарм) |

y(гарм) |

|

|

|

Для

вибору вигляду функції регресії

обчислюють

![]() для

для

![]() у такий спосіб:

у такий спосіб:

![]() =

=![]() , якщо

, якщо

![]() збігається з одним із вузлів xi.

Якщо

збігається з одним із вузлів xi.

Якщо

![]()

![]() ,

то

,

то

![]() .

.

Як критерій вибору кращої функціональної залежності використовують

![]()

Після того, як обрано вигляд функції, модель перетворюють до лінійного вигляду, якщо це необхідно.

7.4 Метод найменших квадратів для оцінки параметрів функції регресії

Після

того як обрано вигляд функції регресії

![]() ,

необхідно знайти невідомі параметри

а0,

а1,

…, аm.

,

необхідно знайти невідомі параметри

а0,

а1,

…, аm.

Метод найменших квадратів полягає в наступному: коефіцієнти а0, а1, …, аm вибираються таким чином, щоб

![]() .

.

Сума квадратів відхилень експериментальних значень yi від розрахованих за рівнянням регресії в точках хi повинна бути мінімальною.

Для випадку лінійної функції

![]() .

.

![]() ,

,

![]() – необхідна умова існування екстремуму.

– необхідна умова існування екстремуму.

Отримаємо систему рівнянь

(7.3)

(7.3)

або

Функція S необмежена зверху, обмежена знизу, має тільки одну критичну точку 1-го роду, може досягати в ній тільки мінімуму.

Розв’язуючи систему рівнянь, знаходимо

Використовуючи коефіцієнт кореляції, можна записати

(7.4)

(7.4)

Властивості регресії

-

Регресійна пряма проходить через точку (

).

).

Ми визначили параметри лінійної регресії a1, a0 (7.4), отже рівняння лінійної регресії таке

![]() . (7.5)

. (7.5)

З рівняння (7.4)

![]() .

(7.6)

.

(7.6)

Віднімаючи від (7.5) рівняння (7.6), отримаємо

![]() .

(7.7)

.

(7.7)

Отже

бачимо, що оцінювана лінія регресії

проходить через центр (![]() ).

Рівняння (7.7) можна записати у вигляді

).

Рівняння (7.7) можна записати у вигляді

![]() .

.

-

Обчислимо

:

:

![]() .

.

Сума відхилень всіх точок від прямої дорівнює 0. Цю властивість використовують для перевірки обчислень. Розглянемо, з яких частин складаються відхилення рівнянь.

![]() .

(7.8)

.

(7.8)

У

статистиці різницю

![]() називають загальним

відхиленням заданої випадкової величини.

називають загальним

відхиленням заданої випадкової величини.

![]() – відхилення,

які можна пояснити, виходячи з регресійної

залежності. Дійсно, якщо x

змінюється, ці відхилення можна знайти

за рівнянням регресії.

– відхилення,

які можна пояснити, виходячи з регресійної

залежності. Дійсно, якщо x

змінюється, ці відхилення можна знайти

за рівнянням регресії.

![]() –

називають

непоясненими

відхиленнями, тобто

відхиленнями, які не можна пояснити за

допомогою регресійної прямої.

–

називають

непоясненими

відхиленнями, тобто

відхиленнями, які не можна пояснити за

допомогою регресійної прямої.

Зведемо (7.8) у квадрат і обчислимо суму за всіма значеннями і:

;

;

Розділимо на n:

;

;

![]() .

.

Оскільки модель відображає вплив на результативну ознаку лише частину реальних факторів, регресійний аналіз пояснює тільки частину дисперсії відгуку (загальної дисперсії).

Загальна дисперсія = дисперсія, що пояснюється регресійним аналізом + залишкова дисперсія.

![]() ,

,

![]() ,

,

де 2заг – загальна дисперсія;

2регр – дисперсія, що пояснюється регресією;

2зал – дисперсія помилок.