- •Введение

- •Глава 1. Предел функции

- •1.1. Определение предела

- •1.2. Операции над пределами

- •1.3. Замечательные пределы

- •1.4. Примеры

- •1.5. Варианты заданий

- •1.6. Контрольные вопросы

- •Глава 2. Производная и дифференциал

- •2.1 Понятие производной

- •2.2. Геометрический и физический смысл производной

- •2.3. Таблица производных

- •2.4. Основные правила дифференцирования

- •2.5. Производные высших порядков

- •2.6. Дифференциал функции

- •2.7. Геометрический смысл и свойства дифференциала

- •Дифференциал сложной функции

- •2.8. Дифференциалы высших порядков

- •2.9. Примеры

- •2.10. Варианты заданий

- •2.11. Контрольные вопросы

- •Глава 3. Исследование функций и построение графиков

- •3.1. Промежутки монотонности и знакопостоянства

- •3.2. Экстремумы функции

- •3.3. Выпуклость и вогнутость функции. Точка перегиба

- •3.4. Асимптоты

- •Вертикальные асимптоты

- •Наклонные и горизонтальные асимптоты

- •3.5.Общая схема исследования функции и построение графиков

- •3.6. Примеры

- •3.7. Варианты заданий

- •3.8. Контрольные вопросы

- •Глава 4. Функции нескольких переменных

- •4.1. Определение функции нескольких переменных

- •4.2. Частные производные

- •4.3. Полный дифференциал

- •4.5. Примеры

- •4.6. Варианты заданий

- •4.7. Контрольные вопросы

- •Глава 5. Численное дифференцирование

- •5.1. Формулы для вычисления первой производной

- •5.2. Формулы второй производной

- •5.3. Примеры

- •5.4. Варианты заданий

- •5.5. Контрольные вопросы

- •Глава 6 Основы интерполяции

- •6.1. Постановка задачи

- •Интерполяционные формулы конечных разностей

- •6.3. Интерполяционные формулы центральных разностей

- •6.4. Интерполирование функции с не равноотстоящими узлами

- •6.5. Варианты заданий

- •6.6. Контрольные вопросы

- •Глава 7. Неопределенный интеграл

- •7.1. Первообразная функция и неопределенный интеграл

- •7.2. Основные свойства неопределенного интеграла

- •7.3. Таблица простейших интегралов

- •7.4. Основные методы интегрирования

- •7. 1. Непосредственное интегрирование

- •7. 2. Метод подстановки (замена переменной)

- •7. 3. Интегрирование по частям

- •7.5. Примеры

- •7.6. Варианты заданий

- •7.7. Контрольные вопросы

- •Глава 8. Определенный интеграл

- •8.1. Основные понятия и свойства определенного интеграла

- •Свойства определенного интеграла

- •8.2. Основные методы интегрирования

- •8.2.1. Формула Ньютона-Лейбница

- •8.2.2. Метод подстановки

- •8.2.3. Интегрирование по частям

- •8.3. Примеры

- •8.4. Варианты заданий

- •8.5. Биологические, физические и медицинские приложения интеграла

- •8.5.1. Примеры задач прикладного характера.

- •8.5.2. Примеры решения задач.

- •8.5.3. Варианты заданий

- •Глава 9. Численное интегрирование

- •9.1. Формула прямоугольников

- •9.2. Формула трапеций

- •9.3. Метод средних

- •9.4. Формула Симпсона

- •9.5. Примеры

- •9.6. Варианты заданий

- •9.7. Контрольные вопросы

- •Глава 10. Дифференциальные уравнения

- •10.1. Основные определения

- •10.2. Уравнения с разделяющимися переменными

- •10.3. Однородные уравнения первого порядка

- •10.4. Линейные уравнения первого порядка

- •1. Метод вариаций произвольной постоянной (метод Лагранжа).

- •2. Метод подстановки (метод Бернулли).

- •9.5. Примеры

- •I. Метод Лагранжа

- •II. Метод Бернулли

- •1. Метод вариации произвольной постоянной

- •2. Метод подстановки

- •10.6. Варианты заданий

- •10.7. Применение дифференциальных уравнений в биологии и медицине.

- •10.8. Варианты заданий

- •10.9. Контрольные вопросы

- •Глава 11. Численные методы решения дифференциальных уравнений

- •11.1. Метод Эйлера

- •11.2. Метод Рунге – Кутта

- •11.3. Примеры

- •11.4. Варианты заданий

- •11.4. Контрольные вопросы

- •Глава 12. Элементы теории вероятностей

- •12.1. Случайное событие

- •12.2. Комбинаторика

- •12.3. Вероятность случайного события

- •Закон сложения вероятностей

- •12.5. Варианты заданий

- •12.6. Условная вероятность, закон умножения вероятностей

- •12.7. Варианты заданий

- •12.8. Формулы полной вероятности и Байеса

- •12.9. Варианты заданий

- •12.10. Формулы Бернулли, Пуассона и Муавра-Лапласа

- •12.11. Варианты заданий

- •12.2. Случайные величины

- •12.2.1. Закон распределения случайной величины

- •12.2.2. Функция распределения случайных величин

- •12.2.3. Числовые характеристики дискретной случайной величины

- •12.2.4. Плотность вероятности непрерывных случайных величин

- •12.2.5. Нормальный закон распределения

- •12.3. Варианты заданий

- •12.4. Контрольные вопросы

- •Глава 13. Статистический анализ результатов исследований

- •13.1. Основные понятия математической статистики

- •13.1. Варианты заданий

- •13.2. Статистические оценки параметров распределения.

- •13.2.1. Характеристики положения

- •13.2.2. Характеристики рассеяния вариант вокруг своего среднего

- •13.3. Варианты заданий

- •13.4. Оценка параметров генеральной совокупности по ее выборке

- •13.4.1. Точечная оценка параметров генеральной совокупности

- •13.5. Варианты заданий

- •13.6. Интервальная оценка параметров генеральной совокупности

- •13.7. Варианты заданий

- •13.8. Контрольные вопросы

- •Глава 14. Корреляционный и регрессионный анализ

- •14.1. Функциональная и корреляционная зависимости

- •14.2. Коэффициент линейной корреляции и его свойства

- •14.3. Проверка гипотез выборочного коэффициента линейной корреляции

- •14.4. Выборочное уравнение линейной регрессии. Метод наименьших квадратов

- •14.5. Нелинейная регрессия

- •14.6. Варианты заданий

- •14.7. Контрольные вопросы

- •Приложение

- •Критические значения выборочного коэффициента корреляции

- •Критерий Колмогорова – Смирнова Точные и асимптотические границы для верхней грани модуля разности истинной и эмпирической функции распределения

- •Распределение Пирсона (х2 – распределение)

- •Распределение Фишера – Снедекора (f-распределение)

- •Библиографический список

- •Содержание

- •Глава 1. Предел функции 4

- •Глава 2. Производная и дифференциал 10

- •Глава 13. Статистический анализ результатов исследований 163

- •Глава 14. Корреляционный и регрессионный анализ 183

14.4. Выборочное уравнение линейной регрессии. Метод наименьших квадратов

При проведении современных клинических исследований обычно нет недостатка в информации: каждому пациенту соответствует целое множество различных клинических показателей и данных.

В них могут быть завуалированы некоторые соотношения, основные черты которых и позволяют выявлять методы регрессионного анализа.

При этом задача регрессионного анализа состоит в подборе упрощенной аппроксимации этой связи с помощью математической модели.

Регрессионный анализ имеет в своем распоряжении специальные процедуры проверки, является ли выбранная математическая модель адекватной для описания имеющихся данных.

Чаще всего регрессионный анализ используется для прогноза, то есть предсказания значений ряда зависимых переменных по известным значениям других переменных.

Выше указывалось, что результаты наблюдений, приведенные в двумерной выборке:

|

xi |

x1 |

x2 |

x3 |

x4 |

x5 |

|

yi |

y1 |

y2 |

y3 |

y4 |

y5 |

можно представить в виде корреляционного поля точек (рис. 14.3), где каждая точка соответствует отдельным значениям х и у.

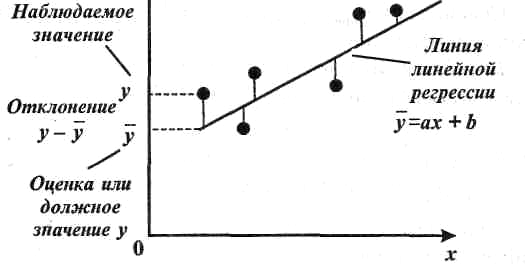

Рис. 14.3. Метод наименьших квадратов

В результате получается диаграмма рассеяния, позволяющая судить о форме и тесноте связи между варьирующими признаками. Довольно часто эта связь может быть аппроксимирована прямой линией (рис. 14.3).

Регрессия - это функция, позволяющая по величине одного признака X находить среднее ожидаемое (должное) значение другого признака Y, корреляционно связанного с X.

В линейной математической модели уравнение линейной регрессии имеет вид:

![]() ,

,

где а и b - параметры линейной регрессии;

а - это коэффициент регрессии, показывающий, насколько в среднем величина одного признака Y изменяется при изменении на единицу меры другого признака X, корреляционно связанного с Y. Чем больше a - угловой коэффициент прямой а= tg α, тем круче прямая, то есть быстрее изменяется Y.

b

- свободный

член в уравнении, определяет

![]() ;

при x

= 0.

;

при x

= 0.

![]() -

это предсказанное (должное) значение

Y

для данного

х при

определенных значениях регрессионных

параметров.

-

это предсказанное (должное) значение

Y

для данного

х при

определенных значениях регрессионных

параметров.

Параметры линейной регрессии определяют методом наименьших квадратов - это способ подбора параметров регрессионной модели, согласно которому сумма квадратов отклонений вариант от линии регрессии должна быть минимальна:

![]()

Это эффективный метод, позволяющий уменьшить влияние ошибок измерений.

Теперь

определяют должные величины

![]() ,

наносят эти

точки и соединяют их прямой линией.

,

наносят эти

точки и соединяют их прямой линией.

Достоинство корреляционно-регрессионного анализа - наглядное представление о форме и тесноте связи. Регрессия выражает корреляционную зависимость в виде функционального отношения и дает более полную информацию.

Была исследована зависимость между ростом (X) и массой (Y), у 200 животных и рост, и масса подчиняются нормальному закону распределения. На рис. 3а видно, что эта зависимость линейная: чем больше рост, тем больше масса.

Из этой совокупности выберем выборку объема п = 10 (рис. 13.4б). Сохранилась ли эта зависимость массы от роста? На рис. 13.4б изображены 4 прямые, аппроксимирующие эту зависимость. Какую прямую можно считать наилучшей?

Рис 14.4. Зависимость между ростом (X) и массой (Y) у животных

Ответ: Да, сохранилась. Прямая I - не годится - все точки оказались по одну сторону от нее. Прямая II – слишком круто устремляется вверх.

Лучше прямые III и IV, а из них лучше та, которая ближе ко всем точкам выборки, то есть относительно которой разброс точек минимален.

Согласно

методу наименьших квадратов лучше

представляет зависимость

![]() от х

прямая IV.

от х

прямая IV.

По данным примера № 2:

|

Xi |

31 |

32 |

33 |

34 |

35 |

35 |

40 |

41 |

42 |

46 |

|

Yi |

7,8 |

8,3 |

7,6 |

9,1 |

9,6 |

9,8 |

11,8 |

12,1 |

14,7 |

13,0 |

Рассчитать

параметры уравнения регрессии

![]() по формулам:

по формулам:

![]()

![]()

Решение:

![]()

![]()

![]()

![]()

![]()

Именно это уравнение задает прямую IV в задаче № 6.

В примере № 2 был рассчитан коэффициент корреляции между ростом (X) и массой (Y) некоторых животных, а в примере № 7 было составлено уравнение линейной регрессии.

Как вы думаете, если поменять х и у, то изменится ли уравнение регрессии и коэффициент корреляции?

Ответ: r - останется прежним, r = 0,925 - он симметричен, а уравнение регрессии получится другим. Получается, что связь роста с массой одна, а роста с массой - другая. Регрессионный анализ асимметричен - это мешает его использовать для характеристики силы связи.

Провести корреляционно-регрессионный анализ. Построить корреляционное поле точек, проверить значимость (α ≤ 0,05) коэффициента корреляции между переменными X и Y и построить линию регрессии.

Изучали зависимость между содержанием вещества X в ткани С и приростом концентрации вещества Y в крови у пациентов, получавших препарат А.

Результаты наблюдений приведены в виде двумерной выборки объема 10:

|

xi |

1,15 |

1,9 |

3 |

5,34 |

5,4 |

7,7 |

7,9 |

9,03 |

9,37 |

10,18 |

|

yi |

0,99 |

0,98 |

2,6 |

5,92 |

4,33 |

7,68 |

9,8 |

9,47 |

10,64 |

12,9 |

Результаты расчета на компьютере:

r

= 0,94;

tнабл

= 6,17;

![]() = 0,579 + 1,1354 ∙

х

= 0,579 + 1,1354 ∙

х

Решение:

Н0: rген = 0; Н1: rген ≠ 0.

Найдем из таблицы tкрит = 2,31; α ≤ 0,05;

f = 10 - 2 = 8.

Сравним: tнабл > tкрит(α, f); 6,17 > 2,31.

Отвергается H0 принимается H1.

Имеется очень сильная линейная корреляционная связь между признаками r = 0,94 (α ≥ 0,05).

Построим корреляционное поле точек (рис. 13.5).

Рис. 13.5. График решения задачи 9

Рассчитаем должные величины:

при

x

= 0,

![]() = -0,576;

= -0,576;

при

х = 1,

![]() = 0,556.

= 0,556.

Нанесем линию регрессии на график.