лекции сапр петраков / 4.Динамический анализ

.docЛекция 4

Методы решения ММ БИС во временной области.

(динамический анализ)

Задача Коши

Пусть

![]() (t)

= f(

(t)

= f(![]() ,t)

(1)

,t)

(1)

при условии x(a)=x0

при

![]() .

.

Основное предположение относительно (1) состоит в том, что удовлетворяет условию Липшеца (в равномерной метрике)

![]() для всех

для всех

![]() и для всех компонент векторов. При этом

можно доказать единственность решения

задачи.....

и для всех компонент векторов. При этом

можно доказать единственность решения

задачи.....

Задача интегрирования с начальными условиями носит название задачи Коши.

Для нахождения

![]() (t)

численными методами интегрирования

разделим интервал времени [a,b]

на небольшие приращения. Каждое приращение

hк=tк

называется величиной шага.

(t)

численными методами интегрирования

разделим интервал времени [a,b]

на небольшие приращения. Каждое приращение

hк=tк

называется величиной шага.

Цель численного интегрирования –

нахождение

![]() (t)

для моментов времени

(t)

для моментов времени

t1, t2,

t3 , ... ,

tk

, где ti+1

= ti

+ hi

(hi

- шаг интегрирования). Численный метод

не позволяет найти точное решение,

поэтому обозначим вычисленное значение

при t=tk

через

![]() k.

Равенство

k.

Равенство

![]() k=||

k=||![]() (tk)

–

(tk)

–

![]() k||

называют локальной ошибкой при t=tk.

Локальная ошибка состоит из двух

компонент – методической ошибки и

ошибки округления в предположение, что

значение х на предыдущем шаге известно

точно.

k||

называют локальной ошибкой при t=tk.

Локальная ошибка состоит из двух

компонент – методической ошибки и

ошибки округления в предположение, что

значение х на предыдущем шаге известно

точно.

Методическую ошибку называют также алгоритмической, поскольку она зависит от вида численного алгоритма.

Как методическая, так и ошибка округления могут накапливаться с увеличением числа шагов. Поэтому для сравнения точности двух алгоритмов необходимо сравнивать их в одни и те же моменты времени tk при одном и том же начальном состоянии.

Локальная ошибка округления зависит от типа вычислительной машины, т.е. она не может быть уменьшена для данной машины, однако различные методы по разному влияют на ошибку округления. Важно помнить, что общая ошибка округления при t=tk не равна сумме локальных ошибок округления, возникающих на каждом шаге.

Метод, обладающий свойством уменьшения ошибки округления при увеличении числа шагов, называется численно-устойчивым. В противном случае он численно-неустойчив.

Граница методической ошибки часто

обозначается как «О», а сама

методическая ошибка как

![]() м=

О(hp)

при h

0.

м=

О(hp)

при h

0.

Таким образом, методическая ошибка стремится к 0 с такой же скоростью, как и hp. Методы классифицируются по критерию «порядок метода p».

В качестве примера рассмотрим линейный многошаговый метод интегрирования, обобщенное выражение которого основано на представлении дифференциальных уравнений разностными уравнениями вида:

![]() (2)

(2)

Данное уравнение получено на основе теоремы о среднем.

Теорема о среднем:

![]() (3)

(3)

Из общего выражения (2) можно получить формулу явного метода Эйлера (ЯМЭ), задав 0=0; k=1; 1=1; 1=1 .

При этом

![]() - ЯМЭ.

(4)

- ЯМЭ.

(4)

Подставив в выражение (2) 0=1;

k=1; 1=1;

1=0

получим формулу неявного метода

Эйлера (НЯМЭ)

![]() (5)

(5)

Подставив в выражение (2) 0=1=1/2; k=1; 1=1 получим формулу метода трапеций

![]() (6)

(6)

Оценка локальной методической погрешности ЯМЭ и НЯМЭ

Разложим функцию в ряд Тейлора:

![]()

где t < < a при t < a;

a< < t при a < t.

Определим погрешность

![]() (7)

(7)

где первое слагаемое – это точное

значение, а второе - приближенное. Будем

считать, что на предыдущем шаге решение

точное. Отсюда

![]() .

.

Получим формулу локальной методической ошибки для явного метода Эйлера.

Заменив в формуле

![]() .

.

![]() заменим на производную

заменим на производную

![]() (см.

формулу (1)), получим

(см.

формулу (1)), получим

xn+1

= xn

+ h![]() (8)

(8)

Поскольку при вычислении локальной методической ошибки значение переменной на предыдущем шаге задается точно, перейдем к следующей формуле

xn+1

= x(tn)

+ h

![]() .

(9)

.

(9)

Разложим функцию в ряд Тейлора в окрестности точки xn с точностью до члена второго порядка малости

![]() (10)

(10)

где tn < < tn+1

tn+1 – tn = h

Сравнивая выражения (9) и (10) с учетом формулы (7) получим локальную методическую ошибку

![]() (11)

(11)

Заметим, что локальная методическая ошибка М довольно велика, поэтому для получения приемлемой точности с помощью явного метода Эйлера необходимо выбирать очень маленькую величину шага.

Аналогично выведем формулу локальной методической ошибки для неявного метода Эйлера.

![]() (12)

(12)

Поскольку при вычислении локальной методической ошибки значение переменной на предыдущем шаге задается точным, перейдем к следующей формуле

![]() (13)

(13)

Разложим функцию в ряд Тейлора в окрестности точки xn+1 с точностью до члена второго порядка малости:

![]() (14)

(14)

tn < < tn+1

Отсюда:

![]() (15)

(15)

Следовательно

![]() (16)

(16)

Явный и неявный методы Эйлера можно классифицировать как методы Тэйлора первого порядка. Локальная методическая ошибка определяется второй производной, следовательно, эти методы имеют низкую точность.

Для повышения точности методов необходимо интегрировать с малой величиной шага. Для оценки локальной методической погрешности требуется определить вторую производную.

Вторую производную можно вычислить, используя теорему о среднем (формула (3)).

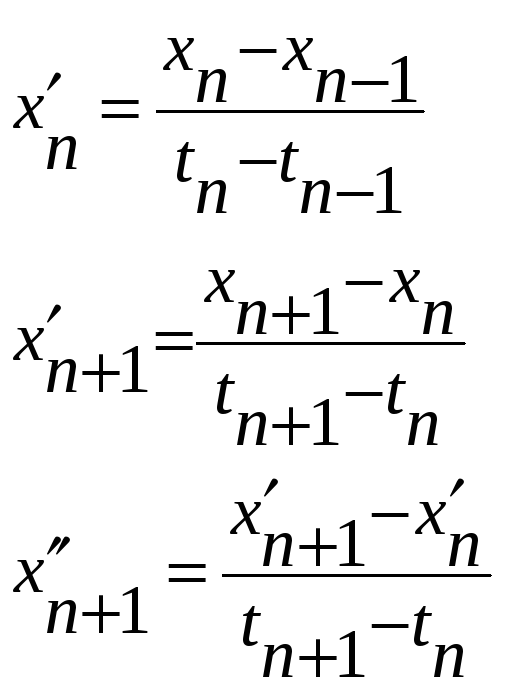

Вычисление второй производной

Иллюстрируется рисунком 1

Рис. 1. Иллюстрация вычисления второй производной

Если принять

![]() ,

то выражение для второй производной

будет иметь вид:

,

то выражение для второй производной

будет иметь вид:

![]() (17)

(17)

Подставив формулу (17) в выражения для локальной методической ошибки ЯМЭ и НЯМЭ:

![]()

получим следующее выражение:

![]() (18)

(18)

Управление величиной шага интегрирования

-

Пусть на n-ом шаге интегрирования величина шага - hn

-

Определяем вектор локальной методической ошибки

Максимальная погрешность

Максимальная погрешность

3. Если max > заданное, то шаг отбрасываем и пытаемся проинтегрировать, уменьшив шаг в два раза

4. Если max ≤ заданное , то hn+1 = hn , если 0.25 заданное ≤ max ≤ заданное ,

hn+1 = 2hn, если max < 0.25 заданное.