Istoria_VT

.pdf

суперкомпьютер IBM Sequoia

Ливерморская Национальная Лаборатория США и IBM объявили об успешном запуске суперкомпьютера Blue Gene/L в полной конфигурации, с 65536 процессорами, и об установлении нового рекорда производительности, равного 280,6 терафлопс. Это более чем вдвое лучше прежнего достижения, 136,8 терафлопс, показанного этим же суперкомпьютером в половинной конфигурации. Еще один весьма производительный компьютер, построенный IBM, – ASC Purple, обладающий вычислительной мощностью порядка 100 терафлопс.

Система Sequoia, содержащая 1,6 млн процессорных ядер IBM Power, память емкостью 1,6 петабайт и 98 304 вычислительных узлов, будет размещаться в 96 стойках размером с холодильник. Несмотря на огромную мощность, компьютер будет использовать энергию в 17 раз эффективнее, чем Blue Gene/L. Финансировать покупку машины будет Национальное управление по

ядерной безопасности США.

12-терафлопной системы ASCI White IBM.

(Суперкомпьютер IBM p690)

Такие компании как IBM, Hewlett-Packard, Sun Microsystems, Cray и Silicon Graphics

постоянно соперничают за первенство в области самых мощных суперкомпьютеров. Производительность современных суперкомпьютеров измеряется в TFlop/s (триллионах операций в секунду), но это, разумеется, не предел и производительность следующего поколения суперкомпьютеров будет измеряться уже в PFlop/s, т.е. они будут еще в сто раз быстрее (1 Pflop/s = 103 Tflop/s). Главный инженер IBM Roadrunner project между тем заявил, что компания собирается пробить этот барьер, запустив свой новый суперкомпьютер. Он займет площадь в 1 829 кв.метров при общем весе 226 тонн, а для обеспечения его работы понадобится 91 км кабеля!..

Темпы развития суперкомпьютеров

В1997 г. Intel выпустила ASCI Red - 1,334 терафлопс.

В2000 г. первым стал компьютер ASCI White корпорации IBM - 4,938 терафлопс), а затем

7,226 терафлопс.

В2002 г. японская компания NEC запустила Earth Simulator - 35,86 терафлопс.

В2004 г. на первое место в мире вышел суперкомпьютер компании IBM Blue Gene/L - 36,01 терафлопс.

26 октября 2004 г. выходит новый суперкомпьютер Columbia фирмы Silicon Graphics - 42,7

терафлопс, с последующим увеличением до 51,87 терафлопс.

Вноябре 2004 г. IBM выпускает Blue Gene/L - 70,72 терафлопс.

Виюня 2008 года IBM построила Roadrunner - 1,105 петафлопа.

(6500 двухъядерных процессоров AMD Opteron и почти 13 000 процессоров IBM Cell 8i), с последовательной высокоскоростной шиной Infiniband. Потребление - 3,9 Мегаватт.

Стоимость - 133 млн. долларов, Cray XT5 Jaguar, с производительностью 1,059 петафлопа

(45000 процессоров, в том числе 4-х ядерных Оптерон АМД и 362 терабайтам ОЗУ и 10 петабайтам ПЗУ) на 2-м месте. На 3-м IBM Blue Gene/P - 294912 процессора PowerPC 450 core 850 МГц, мощность - 825,5 терафлопс. Объем ЗУ - 144 ТБ. Р= 2,2 МВт.

С2009.11 — по 2010.10 на 1-м месте Cray Jaguar - 1759,00 max, 2331,00 pic терафлопс

С2010.11 — по 2011.06 Tianhe-1A China’s National University of Defense Technology 2566,00, 4701,00

Тфлопс

С2011.06 - K computer RIKEN 88128×8 SPARC64 VIIIfx Fujitsu RIKEN Япония, 10510.00 и 11280.38 Тфлопс

В перспективе производительность будет расти довольно быстро за счет увеличения числа процессорных ядер и средней частоты процессоров. Кроме того, для решения прикладных проблем в суперкомпьютерах будут использовать и специализированные (например, графические процессоры, разработанные Nvidia и ATI), будут также новые уникальные архитектурные решения, заметно повысится коэффициент полезного действия за счет развития программных средств.

В данной таблице представлена первая десятка 38-й по счёту редакции списка Top500, опубликованного в ноябре 2011 года

|

Rmax |

|

Компьютер |

Произ |

|

|

Поло |

Rpeak |

Название |

водит |

Место, страна, год |

||

Число процессорных ядер |

||||||

жение |

(Tflops) |

|

ель |

|

||

|

|

|

|

|||

|

|

|

|

|

|

10510.00

1 11280.38

2 2566,00

4701,00

31759,00

2331,00

41271,00

2984,30

51192,00

2287,63

61110,00

1365,81

71088,00

1315,33

81054,00

1288,63

91050,00

1254,55

101042,00

1375,78

K computer

Tianhe-1A

Jaguar

Nebulae

TSUBAME 2.0

Cielo

Pleiades

Hopper

Tera-100

Roadrunner

RIKEN

88128×8 SPARC64 VIIIfx

NUDT TH MPP

186368(X5670 2,93ГГц 6C, NVIDIA

GPU, FT-1000 8C)

Cray XT5

224162 (Opteron)

Dawning TC3600 Blade System

120640 (Xeon/Nvidia Tesla)

HP ProLiant SL390s G7

55680 Xeon 6C X5670 + 64960 Nvidia

Tesla

Cray XE6

142272 Opteron

Altix

111104 Xeon, InfiniBand

Cray XE6 12 ядер 2,1 ГГц

153408

Bull bullx super-node S6010/S6030

138368

IBM BladeCenter QS22/LS21

122400 (Cell/Opteron)

Fujitsu |

RIKEN |

|

Япония, 2011 |

||

|

||

|

Национальный суперкомпьютерный |

|

NUDT |

центр в Тяньцзине |

|

|

Китай, 2010 |

|

Cray |

Окриджская национальная лаборатория |

|

США, 2009 |

||

|

||

Dawnin |

Национальный суперкомпьютерный |

|

центр (Шэньчжэнь) |

||

g |

||

Китай, 2010 |

||

|

||

NEC/H |

Институт технологий, Токио |

|

P |

Япония, 2010 |

|

Cray |

Los Alamos National Laboratory |

|

США, 2010 |

||

|

||

SGI |

Ames Research Center |

|

США, 2011 |

||

|

||

Cray |

НDOE/SC/LBNL/NERSC |

|

США, 2010 |

||

|

||

Bull SA |

Комиссариат атомной энергетики |

|

Франция, 2010 |

||

|

||

|

Лос-Аламосская национальная |

|

IBM |

лаборатория |

|

|

США, 2009 |

Sun представила суперкомпьютерную технологию Constellation

Семейства разноплановых компьютеров, объединенных под общей маркой Constellation. Основным и самым масштабных элементом системы станет не совсем обычная высокоемкая производительная система координации, которая будет управлять данными, обрабатываемыми до 3 456

вычислительных ядер в суперкомпьютере.

В Sun говорят, что Constellation станет своего рода мозгом для работы вычислительных систем.

Разрабатывалась новинка в сотрудничестве с Университетом Техаса и техасским суперкомпьютерным центром TACC (Texas Advanced Computing Center), расположенным в Остине (штат Техас, США).

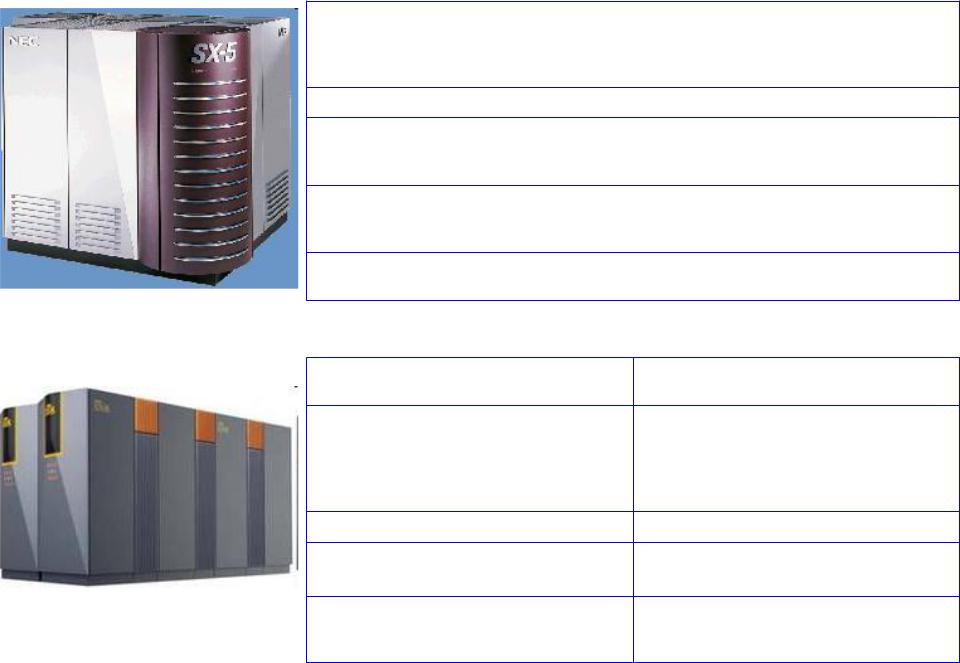

NEC, SX-5. Параллельный векторный суперкомпьютер (PVP).

|

векторно-конвейерный SMP- |

|

Узел |

суперкомпьютер, объединяющий до 16 |

|

индивидуальных векторных процессоров |

||

|

||

|

8 Gflop/s |

|

Память |

Объем памяти каждого узла - до 128GB, |

|

|

Система может включать до 32 узлов, |

|

Масштабируемость |

обеспечивая совокупную пиковую |

|

|

производительность до 4 TFlop/s. |

|

|

Для связи узлов используется |

|

Коммутатор |

высокоскоростной коммутатор (IXS |

|

|

Internode Crossbar Switch). |

|

Системное ПО |

Используется операционная система |

|

SUPER-UX. |

||

|

||

|

|

|

NEC, SX-8R. Параллельный векторный суперкомпьютер (PVP). |

||

Класс архитектуры |

Параллельный векторный |

|

суперкомпьютер (PVP). |

||

|

||

|

векторно-конвейерный SMP- |

|

|

суперкомпьютером, объединяющим от 1 |

|

Узел |

до 8 индивидуальных векторных |

|

|

процессоров с пиковой векторной |

|

|

производительностью 35.2 Gflop/s. |

|

Память |

Объем памяти каждого узла - до 256 GB, |

|

Масштабируемость |

Система может включать до 512 узлов. |

|

Производительность до 144 Tflop/s. |

||

|

||

|

Используется операционная система |

|

Системное ПО |

SUPER-UX с улучшенной поддержкой |

|

|

SSI (Single System Image). |

|

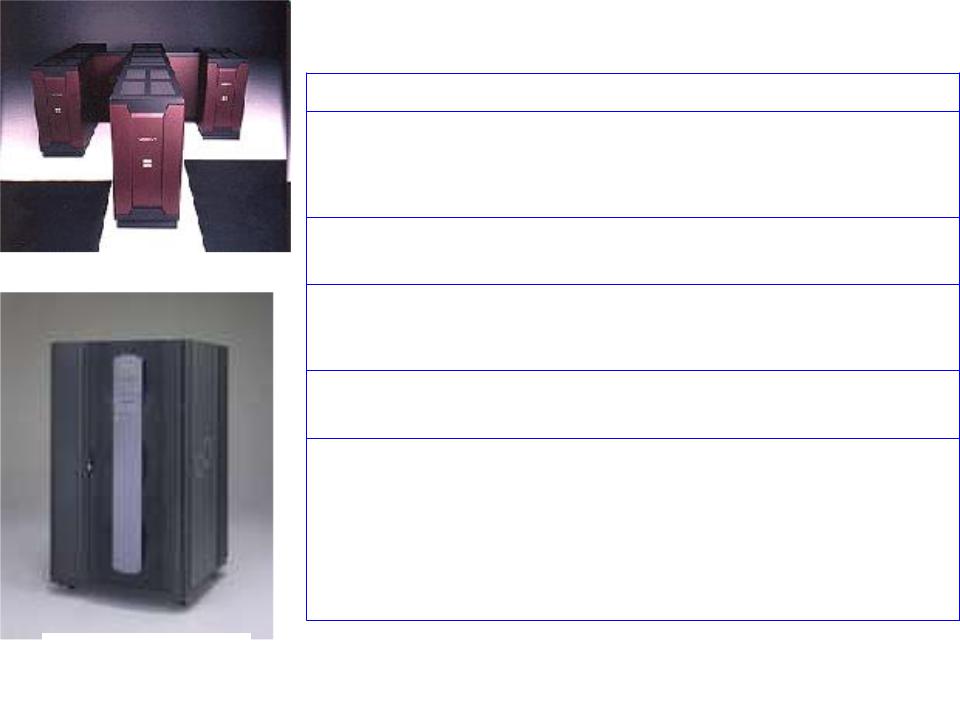

Fujitsu VPP500 0

Параллельный векторный суперкомпьютер (PVP).

Модификации |

VPP300, VPP700, VPP500 0 |

|

|

Для VPP5000: VU состоит из 4 |

|

|

конвейеров, пиковая |

|

Процессорный элемент |

производительность - 9.6 |

|

|

GFLOP/sec. Объем памяти - до |

|

|

16GB. |

|

|

Для VPP5000: до 512 PE, суммарная |

|

Масштабируемость |

пиковая производительность до 4.9 |

|

|

TFLOP/sec. |

|

|

Пропускная способность каналов |

|

Коммутатор |

коммутатора: для VPP700 - |

|

615MB/sec, для VPP5000 - |

||

|

||

|

1.6GB/sec. |

|

|

Используется операционная система |

|

Системное ПО |

UXP/V, основанная на UNIX System |

|

|

VR4. |

|

|

Среди средств разработки |

|

|

поставляются: |

|

|

распараллеливающий и |

|

|

векторизующий компилятор |

|

Средства программирования |

Fortran90/VPP, оптимизированная |

|

|

для VPP библиотека |

|

|

математических подпрограмм |

|

|

SSLII/VPP, библиотеки передачи |

|

|

сообшений MPI-2 и |

|

|

|

Fujitsu PrimePower 2500

Производитель |

Fujitsu |

|

|

|

|

Класс архитектуры |

Многопроцессорные сервера с общей памятью(SMP). |

|

|

|

|

Назначение |

Сервер масштаба предприятия(Enterprise Server) |

|

|

|

|

Partitions (разделы) |

до 15 независимых физических, до 15 дополнительных |

|

|

|

|

Процессоры |

от 8 до 128 SPARC64-V, тактовая частота 1.35GHz, L1 кэш 256KB, |

|

L2 кэш 8MB |

||

|

||

|

|

|

Пропускная способность шины |

133 GB/sec |

|

|

|

|

Память |

2GB - 512GB ECC SDRAM |

|

|

|

|

Дисковые накопители |

внутренние 9,34TB (32 PCI/Disk box), внешние 147GB * 4 диска на |

|

PCI/Disk box, поддерживается горячая замена |

||

|

||

|

|

|

Слоты ввода-вывода |

PCI до 320, встроенный SCSI контроллер UltraWide |

|

|

|

|

Операционная система |

Solaris 8, 9 |

|

|

|

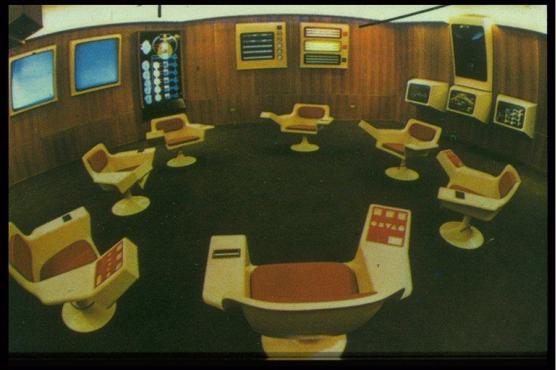

Киберсин (англ. Cybersyn) — проект централизованного компьютерного управления плановой экономикой,

реализуемый в Чили при президенте

Сальвадоре Альенде в 1970—1973 годах.

Проект осуществлялся под руководством британского теоретика исследования операций Стаффорда Бира. После прихода к власти в Чили коалиции Народное единство во главе с Сальвадором Альенде в 1970 г., новое правительство обратилось с предложением к английскому кибернетику Стаффорду Биру о создании информационной системы по управлению экономикой страны.

Стаффорд Бир дает свое согласие и лично возглавляет проект, с 1971 г. находясь непосредственно в Чили. Управляющая программа созданной системы получила название Cyberstrider, она была написана чилийскими инженерами в сотрудничестве с британскими учеными. С помощью телексов система соединила 500 предприятий в сеть Cybernet. Вся информация в реальном времени поступала в комнату управления, которая находилась в Президентском дворце «Ла Монеда» в Сантьяго. В системе было предусмотрено четыре уровня контроля (фирма, отрасль, сектор экономики, глобальный уровень) и она обладала алгедонической обратной связью. Если на низшем уровне проблема не разрешалась за определённый интервал времени, то автоматически происходила её эскалация на более высокий уровень принятия решения (до глобального).

В 1972 г. во время всеобщей национальной стачки, с помощью Киберсина правительство организовало снабжение столицы продовольствием с помощью 200 грузовиков, оставшихся верными правительству, в обход бастующих 50.000 водителей.

После путча 1973 года центр управления Киберсина был разрушен, поскольку новое правительство сочло данный проект непривлекательным[1].

Earth Simulator

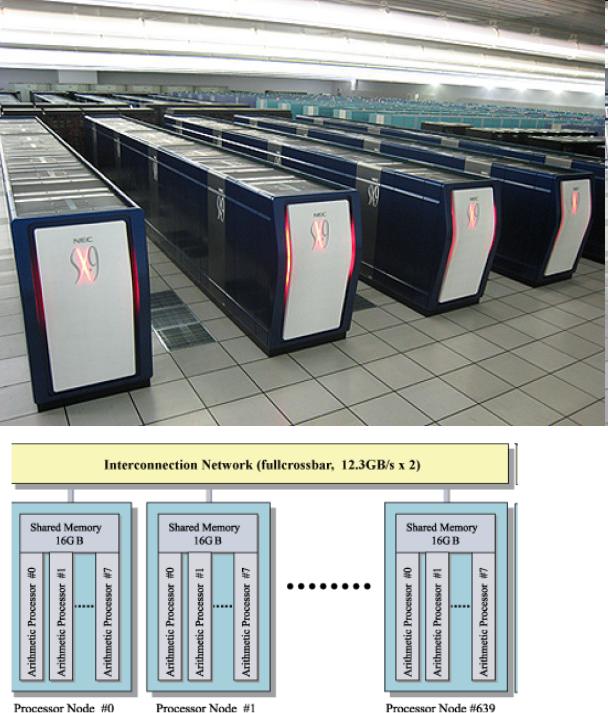

Созданный компанией NEC для Агентства по Исследованию Космоса Японии, Научно-исследовательского института Атомной энергии Японии и центра Japan Marina Science and Technology, Earth Simulator (ES) был самым быстрым суперкомпьютером в мире с 2002 до 2004.

Earth Simulator содержит 640

процессорных узлов, соединенных между собой через высокоскоростной переключатель. В состав узла входят 8 векторных арифметических процессоров, работающих над общей для каждого узла оперативной памятью, коммуникационный процессор и процессор для операций ввода/вывода. Оперативная память каждого узла разделена на 2048 банков и имеет объем 16 Гбайт. Пиковая производительность одного арифметического процессора равна 8 Гфлопс, поэтому пиковая производительность всего компьютера, объединяющего 640*8=5120 процессоров, равна 40 Тфлопс.