- •1. Спектральная плотность конечной последовательности. Ряд Фурье.

- •2. Формулы дпф и одпф. Свойства дпф.

- •3. Дпф конечной последовательности. Дпф периодической последовательности.

- •4. Теорема Котельникова в частотной области. Восстановление аналогового сигнала по отсчётам дпф. Усечённый ряд Котельникова.

- •5. Разрешение по частоте. Восстановление спектральной плотности конечной последовательности.

- •6. Выделение гармоник полезного сигнала по отсчётам дпф. Первый и второй критерии. Выбор значений порогов по первому и второму критериям.

- •7. Растекание спектра. Методы борьбы с растеканием спектра.

- •8. Улучшение различения дискретных гармоник с близко расположенными частотами. Условия для различения дискретных гармоник с близко расположенными частотами.

- •9. Вычисление круговой и линейной свёртки с помощью дпф.

- •10. Секционированные свёртки. Методы их вычисления.

- •12. Бпф и обпф. Алгоритм вычисления с прореживанием по частоте.

- •13. Многоскоростные системы. Система однократной децимации.

- •14. Многоскоростные системы. Система однократной интерполяции.

- •15. Многоскоростные системы. Система однократной передискретизации.

- •16. Полифазная структура системы однократной интерполяции.

- •17. Полифазная структура системы однократной децимации.

- •18. Банки фильтров. Полифазная структура банка фильтров анализа.

- •19. Банки фильтров. Полифазная структура банка фильтров синтеза.

- •20. Спм. Определение и свойства. Теорема Винера-Хинчина.

- •21.Обработка случайного процесса лдс. Соотношение вход/выход для акф и спм.

- •22. Алгоритм моделирования случайного процесса с требуемой акф.

- •23. Основные методы спектрального анализа. Основные показатели качества оценок спм.

- •24. Метод периодограмм. Метод периодограмм Даньелла.

- •25. Метод периодограмм Бартлетта. Метод периодограмм Уэлча

- •27. Параметрические методы. Достоинства методов. Этапы расчёта оценки спм.

- •28. Модели параметрических методов и их назначение. Структурная схема и ру этих моделей.

- •29. Метод Юла-Уолкера. Метод Бёрга. Достоинства и недостатки.

- •30. Ковариационный метод и модифицированный ковариационный метод. Достоинства и недостатки.

- •31. Влияние порядка ар-модели на оценку спм. Критерий Байеса.

- •32. Влияние длины последовательности на оценку спм параметрическими методами.

- •33. Адаптивный фильтр. Структура аф.

- •38. Фильтр Винера. Достоинства и недостатки.

- •39. Алгоритм lms. Достоинства и недостатки.

- •40. Алгоритм rls. Достоинства и недостатки.

39. Алгоритм lms. Достоинства и недостатки.

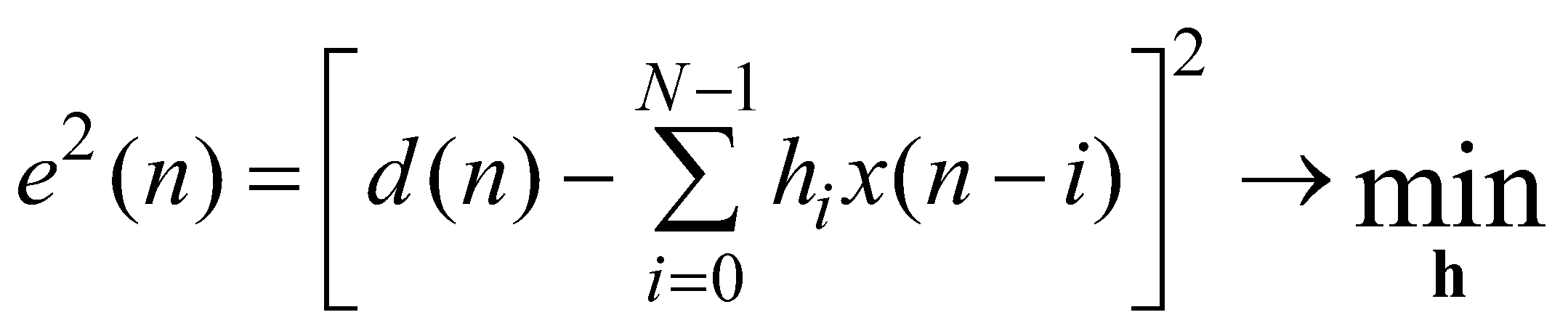

В алгоритме LMS в качестве критерия наилучшего приближения выходного сигнала к образцовому сигналу выбирается минимум квадрата сигнала ошибки (17.2) —(17.3):

.

.

Вектор

находится в результате решения

оптимизационной задачи — поиска

минимума функции

![]() ,

которая зависит от

времени:

,

которая зависит от

времени:

![]() .

.

Для поиска минимума используют итерационную (пошаговую) процедуру.

На

каждом шаге вычисляется

![]() - вектор

оценок

параметров АФ, смещаемый относительно

вектора

- вектор

оценок

параметров АФ, смещаемый относительно

вектора

![]() на величину, пропорциональную градиенту

на величину, пропорциональную градиенту

![]() функции

:

функции

:

![]() ,

(17.11)

,

(17.11)

где

![]() —

шаг

адаптации

(задается пользователем).

—

шаг

адаптации

(задается пользователем).

Градиентом функции называют ее частные производные по всем :

![]() ,

.

,

.

В квадратных скобках имеем частные производные данной функции по всем i h в момент времени n:

![]() .

.

Подставляя в (17.11), получаем рекуррентную формулу:

![]() ,

(17.12)

,

(17.12)

где

![]() —

вектор отсчетов входного сигнала

—

вектор отсчетов входного сигнала

![]() .

.

Начальные

значения параметров АФ

![]() по

умолчанию нулевые.

по

умолчанию нулевые.

Шаг адаптации выбирается из условия

![]() ,

(17.13)

,

(17.13)

где:

![]() —

среднеквадратичное

значение входного сигнала

длины L;

—

среднеквадратичное

значение входного сигнала

длины L;

— длина КИХ-фильтра

Значение шага адаптации выбирают из компромиссных соображений:

скорость сходимости оценки параметров АФ (скорость приближения к оптимальным параметрам

в фильтре Винера) с ростом

растет и скорость сходимости;

в фильтре Винера) с ростом

растет и скорость сходимости;но одновременно с ростом начинает расходиться значение дисперсии сигнала ошибки по сравнению с фильтром Винера, для которого она минимальна.

Обычно значение выбирают равным половине максимального шага в (17.13).

Если значение средней мощности невозможно оценить заранее, используют модификацию алгоритма LMS — нормированный алгоритм NLMS, где шаг адаптации зависит от времени:

![]() .,

.,

Шаг

![]() нормируется к энергии сигнала

на текущем интервале

нормируется к энергии сигнала

на текущем интервале

![]() :

:

![]() ,

,

где

![]() —

энергия сигнала (произведение строки

на столбец);

—

энергия сигнала (произведение строки

на столбец);

![]() —

фиксированное значение шага, влияющее

на сходимость алгоритма адаптации,

обычно

—

фиксированное значение шага, влияющее

на сходимость алгоритма адаптации,

обычно

![]() ;

;

![]() —

малая положительная константа,

определяющая максимальное значение

—

малая положительная константа,

определяющая максимальное значение

![]() при нулевом сигнале.

при нулевом сигнале.

В начале процесса адаптации наблюдается переходный процесс, когда дисперсия сигнала ошибки много большей, чем по его окончании — в установившемся режиме.

Достоинство алгоритма LMS — простота: на каждом шаге в (17.12) выполняется N операций умножения-сложения.

Недостаток алгоритма LMS —относительно медленная сходимость к оптимальным параметрам : длина переходного процесса и дисперсия сигнала ошибки, больше, чем в алгоритме RLS.

40. Алгоритм rls. Достоинства и недостатки.

В алгоритме LMS в качестве критерия наилучшего приближения выходного сигнала к образцовому сигналу выбирается минимум суммы квадратов сигнала ошибки (17.2) —(17.3):

![]() .

.

Вектор

находится в результате решения

оптимизационной задачи — поиска

минимума целевой функции

![]() ,

которая не зависит от

времени:

,

которая не зависит от

времени:

Минимум достигается при равенстве нулю частных производных по всем :

![]() .

.

Выполним замену в вне квадратных скобок:

![]() .

.

Перенесем сумму с неизвестными параметрами в левую часть:

![]() .

.

Получили

соотношение, совпадающее с точностью

до множителя

![]() с соотношением (17.6) для фильтра Винера.

Следовательно, на его основе могут быть

получены параметры АФ

с соотношением (17.6) для фильтра Винера.

Следовательно, на его основе могут быть

получены параметры АФ

При этом отсутствие множителя (усреднения) означает, что не требуется вычислять АКФ, а можно использовать непосредственно отсчеты сигналов и .

Вывод рекуррентной формулы для вычисления параметров АФ достаточно сложен и приводится в новой книге.

Достоинство алгоритма RLS — оптимальные параметры АФ в установившемся режиме. Длительность переходного процесса, быстрее, чем в LMS, а дисперсия сигнала ошибки установившемся режиме, минимально достижимая.

Недостаток алгоритма RLS — существенно больший объем вычислений, следовательно, большая вычислительная сложность по сравнению с алгоритмом LMS.