- •Раздел 1. Обзор источников научно-технической информации по теме исследования 5

- •Раздел 2. Описание процедуры проведенного научного исследования 7

- •Введение

- •Раздел 1. Обзор источников научно-технической информации по теме исследования

- •Раздел 2. Описание процедуры проведенного научного исследования

- •Этап 3. Интерпретация полученных в исследовании результатов

- •Заключение

- •Список используемых источников

- •Приложение а

Этап 3. Интерпретация полученных в исследовании результатов

Для интерпретации полученных результатов была использована конфигурация chroma_fft. Этот конфигурационный файл представляет собой настройки для программы openSMILE, которая используется для анализа аудиоданных и извлечения различных характеристик звука. В данном случае, файл вычисляет музыкальные характеристики интенсивности для каждого из 12 полутонов из аудиофайла и сохраняет их в формате CSV [3].

Для определения данных значений openSMILE использует алгоритм transformFFT. Это компонент программы openSMILE, который выполняет преобразование Фурье (FFT) над входными данными. Преобразование Фурье является важным инструментом в анализе сигналов и позволяет перейти из временной области в частотную. Алгоритм расчета характеристик речи можно описать следующим образом [4]:

Подготовка входных данных:

Принимается набор данных, обычно временной ряд амплитуд аудиосигнала.

Размер входного набора данных обычно является степенью двойки, поскольку алгоритм FFT эффективнее работает с такими размерами.

Разделение на части:

Входной временной ряд разбивается на отрезки фиксированной длины, которые обычно представляют собой фреймы.

Применение оконной функции:

Каждый фрейм данных может быть умножен на оконную функцию для уменьшения искажений, вызванных краевыми эффектами.

Обычно используются различные типы окон, такие как Гауссово, Хэмминга, Ханна и другие.

Выполнение преобразования Фурье:

Для каждого фрейма данных применяется FFT.

FFT разлагает сигнал из временной области на его частотные составляющие.

Результатом FFT является спектр сигнала, который представлен комплексными числами (модуль и фаза).

Результаты FFT:

Мода FFT представляет собой амплитудный спектр сигнала.

Фаза FFT представляет собой фазовый спектр сигнала.

Обработка результатов:

Результаты FFT могут быть использованы для анализа спектральных характеристик сигнала, таких как выделение основных частот, вычисление спектральных плотностей мощности и так далее [5].

Таким образом, компонент transformFFT в openSMILE осуществляет преобразование Фурье над входными данными, что позволяет анализировать их в частотной области.

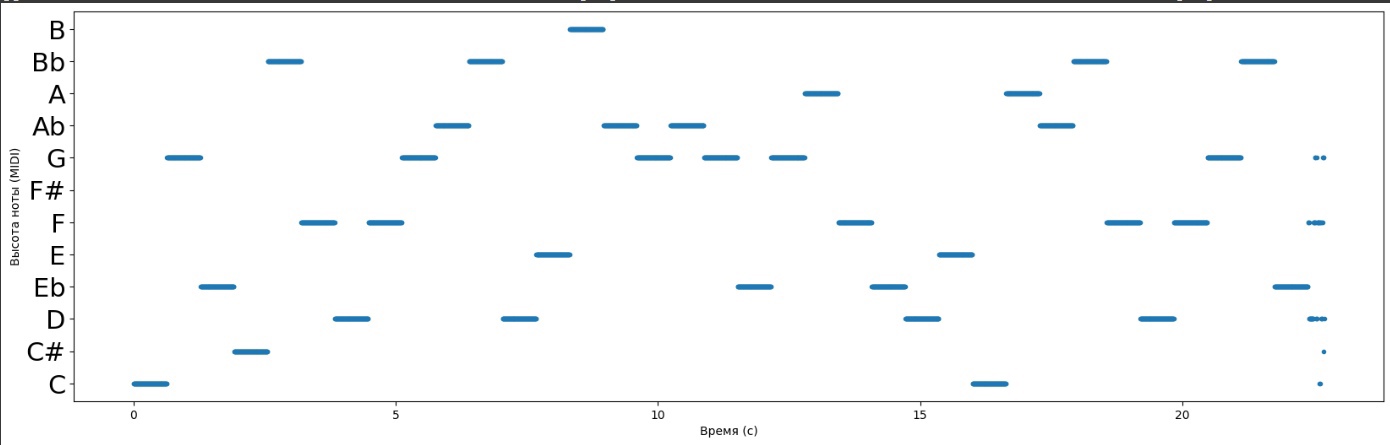

Далее, для вывода данных, полученных после применения конфигурации, на графиках, был написан алгоритм на Python, который определял несущую ноту в каждом промежутке времени - из 12 интенсивностей выбиралась наибольшая и данный максимум был приведен к формату ноты от С до B. Таким образом, в результате получается график с основными нотами из аудиофайла. Код данного алгоритма представлен в приложении А.

Благодаря алгоритму, описанному выше, программа позволяет получить список данных, которые можно визуализировать и более точно получать качественные и количественные выводы. Разберем несколько примеров из выборки, в которых упражнения сыграли роль для человека и где нет.

В первом примере испытуемый спел песню до распевки и повторил куплет после упражнений. На рисунке 3 представлено сравнение графиков нот в пении испытуемого до и после упражнений.

Рисунок 3 – Визуализация взятых нот до и после упражнений первого испытуемого

На примере строчки первой песни «Ночкой темной тихо поедем» можно разобрать изменение голоса:

Красным цветом на первом графике выделен диапазон 3 нот, который после распевания сократился до одной ноты D(ре). Голос до упражнений дрожал и прыгал по нотам разного диапазона, а после выровнялся.

Зеленым цветом на первом графике выделен диапазон нот, который плавно поднимаясь переходит в Ab(ля бемоль), на втором же графике обследуемый стабильно поет G(соль) в некоторый момент переходя на Ab. В данном случае голос также выровнялся и перестал дрожать. Можно заметить, что в данном промежутке испытуемый тянул одну ноту, предположительно это был конец слова «пойдем».

В остальных промежутках происходят аналогичные изменения.

Как видно из исследования первого испытуемого, распевание действительно помогло. После упражнений возросла тональность, а большая часть аудиозаписи находятся на четырёх нотах, в отличие от пения до распевания, где сложно выделить основные ноты, имеется большое количество переходов. Можно заключить, что пение стало ровнее и четче. Рассмотрим еще один пример, в котором распев помог улучшить итоговый результат (рисунки 4-5).

Рисунок 4 - Визуализация взятых нот до упражнения второго испытуемого

Рисунок 5 - Визуализация взятых нот после упражнения второго испытуемого

Визуализация аудиосигнала второго испытуемого показала заметный результат. Главное отличие от пения до распевания заключается в плавном переходе между нотами. Если до упражнений различия между используемыми нотами в худшем случае составлял две октавы, то после распевов испытуемый стал лучше контролировать свои голосовые связки и на выходе получился удовлетворительный результат. Количество часто используемых нот снизился с трёх до двух.

Однако в исследовании участвовали испытуемые, которые после выполнения упражнений получили результат, который практически не отличается от пения до упражнений (рисунки 6-7).

Рисунок 6 - Визуализация взятых нот до упражнения третьего испытуемого

Рисунок 7 - Визуализация взятых нот после упражнения третьего испытуемого

На данном примере видно, что разброс по нотам у испытуемого практически не изменился после упражнений. На обоих рисунках сложно выделить определенные ноты, на которых пел испытуемый. Можно сделать вывод, что не всем людям помогает распевание. Большинство испытуемых заметно улучшили свои результаты, остальные не получили заметных изменений.

Вклад участников учебного научного коллектива в выполнение работ по этапам 5 и 6 показан в таблице 4.

Таблица 4 – Результаты деятельности участников научного коллектива по этапам 5, 6

ФИО (роль) |

Описание достигнутого результата |

Лобанов Виктор Михайлович |

Разрабатывал алгоритм для визуализации полученных данных, обрабатывал аудиофайлы с помощью библиотеки openSMILE, участвовал в анализе полученных данных |

Белякин Павел Михайлович |

Описывал полученные результаты, участвовал в анализе полученных данных |

Жовтяк Максим Олегович |

Участвовал в анализе полученных данных, помогал при описании полученных результатов |

Анастасьева Валерия Николаевна |

Описывала методику обработки аудиофайлов, участвовала в анализе полученных данных |

Бородина Анастасия Петровна |

Помогала при описании методики обработки аудиофайлов, участвовала в анализе полученных данных |