lab1_machine

.docxГУАП

КАФЕДРА № 41

ОТЧЕТ ЗАЩИЩЕН С ОЦЕНКОЙ

ПРЕПОДАВАТЕЛЬ

Ассистент |

|

|

|

В.В. Боженко |

должность, уч. степень, звание |

|

подпись, дата |

|

инициалы, фамилия |

ОТЧЕТ О ЛАБОРАТОРНОЙ РАБОТЕ №1 |

ИНТЕРПОЛЯЦИЯ ФУНКЦИИ |

по курсу: МАШИННОЕ ОБУЧЕНИЕ |

|

РАБОТУ ВЫПОЛНИЛ

СТУДЕНТ ГР. № |

4016 |

|

|

|

М.О. Жовтяк |

|

|

|

подпись, дата |

|

инициалы, фамилия |

Санкт-Петербург 2023

Цель работы

Цель: обучить нейронную сеть для выполнения операции интерполяции при заданном входном векторе и цели.

Вариант задания

Задание: Обучение однослойной нейронной сети прямого

распространения для выполнения операции интерполяции при заданном входном векторе и цели (результата). Ошибка обучения MSE должна быть не более 0,1.

Вариант 14. Вариант отображен на рисунке 1.

![]()

Рисунок 1 – Вариант задания

Ссылка на Jupyter Notebook:

https://colab.research.google.com/drive/1gC6jEgW_olAJ_hr9uUTwFqet8uY2Fbco?usp=sharing

Ход выполнения работы

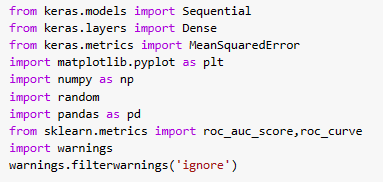

Импортируются библиотеки, необходимы для создания искусственных нейронных сетей, а также сторонние библиотеки для представления этих данных. Это продемонстрировано на рисунке 2.

Рисунок 2 – Импорт библиотек

Визуализируется заданная по варианту функция. Это продемонстрировано на рисунке 3.

Рисунок 3 – Визуализация исходной функции

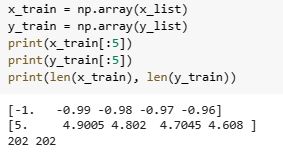

Так как результат для любых входных данных будет одинаковым, то список с разметкой данных содержит одинаковые элементы. Данные преобразуются в списки Numpy, так как Keras не работает с стандартными списками списками. Это продемонстрировано на рисунке 4.

Рисунок 4 – Подготовка тестовых данных

Формируется модель Sequential с одним скрытым слоем, содержащим 1500 нейронов. На вход данной модели поступает одно значение Y, а на выходе аналогично значение Y. Информация о модели продемонстрирована на рисунке 5.

Рисунок 5 – Информация о модели обучения

После создания модели её можно начать обучать. Обучение длится в 50 эпох, веса обновляются после прохода 32 элементов из массива x_train. Это продемонстрировано на рисунке 6.

Рисунок 6 – Обучение модели данных

Из результатов видно, что ошибка MSE ниже 0.1. На мой взгляд, неплохой результат, поэтому попробуем сравнить выводимый результат с исходным графиком.

Строится график величины ошибки. Его можно увидеть на рисунке 7.

Рисунок 7 – График величины ошибки

Строятся графики со случайными расположениями Y модели и исходными для сравнения. Это продемонстрировано на рисунке 10.

Рисунок 10 – Результат работы модели обучения

Предсказанный график идеально наложился на исходный. Это значит, что модель обучилась правильно.

Вывод

В ходе лабораторной работы мной была обучена однослойная нейронная сеть прямого распространения для интерполяции при заданном входном списке и результате работы. Была построена модель с одним скрытым слоем, в котором находится 1500 нейронов, обрабатывающая значение поступающее значение Y. После обучения результаты сравнивались с исходным заданным графиком, где оба графика наложились друг на друга. Это значит, что модель правильно обучилась и способна выполнять свои задачи.

В ходе работы проблем не возникло.