- •Искусственный интеллект. Определения искусственного интеллекта. История развития искусственного интеллекта

- •Предпосылки развития науки искусственного интеллекта

- •Парадигмы искусственного интеллекта. Тест Тьюринга

- •Подходы к созданию интеллектуальных систем.

- •Направления развития искусственного интеллекта

- •Области применения искусственного интеллекта

- •Интеллектуальные системы. Основные понятия и определения. Структура интеллектуальной системы.

- •Модели и методы знаний. Структуры памяти эвм. Информационные структуры для хранения данных.

- •Модели представления данных.

- •Концепция знаний.

- •Модели представления знаний. Логические и сетевые модели.

- •Модели представления знаний. Продукционные и фреймовые модели.

- •Графы сетей Петри Скучная и непонятная теория из лекций

- •Наглядный пример Пример 1

- •Пример 2

- •Сети Петри: дерево достижимых разметок.

- •Оценка свойств сетей Петри на основе матричных уравнений.

- •Алгебра сетей Петри: операции над сетями Петри.

- •Расширения сетей Петри: ингибиторные, приоритетные, временные.

- •Способы описания сетей Петри.

- •Методы анализа сетей Петри. Задачи анализа.

- •Методы анализа сетей Петри. Дерево достижимых разметок.

- •Методы анализа сетей Петри. Анализ на основе матричных методов.

- •Проектирование сложных вычислительных структур. Структурный подход.

- •Матричные структуры. Преимущества матричных структур.

- •Примеры проектирование структур матричных процессоров на основе проекций процессорных элементов.

- •Построение параллельных матричных систем на примере умножения двух матриц.

- •Глубокое обучение. Принцип действия глубокого обучения. Геометрическая интерпретация глубокого обучения.

- •История машинного обучения. Вероятностное моделирование. Метод опорных векторов. Деревья решений.

- •Математические основы нейронных сетей.

- •Нейронные сети. Представление данных.

- •Нейронные сети. Представление данных. Примеры.

- •Нейронные сети. Операции с тензорами. Примеры.

- •Сверточные нейронные сети. Эффект границ. Шаг свертки.

- •Основные задачи в сфере компьютерного зрения.

- •Сверточные нейронные сети. Модульность, иерархия, многократное использование

- •Рекурентные нейронные сети. Класс задач, решаемых рекурентными нейронными сетями.

- •Рекурентные нейронные сети. Обработка естественных языков.

- •Генеративное глубокое обучение. Художественная обработка изображений.

- •Генетические алгоритмы. Основные понятия.

Сверточные нейронные сети. Эффект границ. Шаг свертки.

Можно заметить, что выходные ширина и высота карт признаков могут отличаться от входных. На то есть две причины:

- эффекты границ, которые могут устраняться дополнением входной карты признаков;

- использование шага свертки.

Эффекты границ и дополнение

На слайде изображена карта признаков 5 × 5 (всего 25 клеток). Существует всего девять клеток, в которых может находиться центр окна 3 × 3, образующих сетку 3 × 3. Следовательно, карта выходных признаков будет иметь размер 3×3. Она получилась немного сжатой: ровно на две клетки вдоль каждого измерения.

При этом можно увидеть, как проявляется эффект границ на более раннем примере: изначально у нас имелось 28 × 28 входов, количество которых после первого сверточного слоя сократилось до 26 × 26.

Допустимые местоположения шаблонов 3 × 3 во входной карте признаков 5 × 5

Чтобы получить выходную карту признаков с теми же пространственными размерами, что и входная карта, можно использовать дополнение.

Дополнение заключается в добавлении соответствующего количества строк и столбцов с каждой стороны входной карты признаков, чтобы можно было поместить центр окна свертки в каждую входную клетку. Для окна 3 × 3 нужно добавить один столбец справа, один столбец слева, одну строку сверху и одну строку снизу. Для окна 5 × 5 нужно добавить две строки.

Дополнение входной карты признаков 5 × 5, чтобы получить 25 шаблонов 3 × 3

Шаг свертки

Другой фактор, который может влиять на размер выходной карты признаков, — шаг свертки.

В общем случае расстояние между двумя соседними окнами является настраиваемым параметром, который называется шагом свертки и по умолчанию равен 1.

На слайде представлено, как извлекаются шаблоны 3 × 3 сверткой с шагом 2 из входной карты 5 × 5.

Использование шага 2 означает уменьшение ширины и высоты карты признаков за счет уменьшения разрешения в два раза.

Шаблоны 3 × 3 свертки с шагом 2 × 2

Основные задачи в сфере компьютерного зрения.

Классификация изображений

Цель — присвоить изображению одну или несколько меток. Это может быть однозначная классификация (изображение можно отнести только к одной категории) или многозначная (изображению можно присвоить несколько меток, в зависимости от наличия на нем объектов из разных категорий.

Сегментация изображений

Цель — сегментировать, или разбить, изображение на непересекающиеся области, каждая из которых представляет некоторую категорию.

Обнаружение объектов

Цель — нарисовать прямоугольники (которые называют ограничивающими рамками) вокруг интересующих объектов на изображении и связать каждый прямоугольник с некоторым классом. Автопилот автомобиля, например, может использовать модель обнаружения объектов для наблюдения за автомобилями, пешеходами и знаками, попадающими в поле зрения своих камер

Сверточные нейронные сети. Модульность, иерархия, многократное использование

Есть универсальный рецепт, помогающий упростить сложную систему: нужно лишь структурировать всю аморфную мешанину в модули, организовать модули в иерархию и многократно использовать одни и те же модули в разных местах по мере необходимости («многократное использование» — еще один термин для обозначения абстракции в этом контексте).

Формула «модульность — иерархия — многократное использование» лежит в основе системной архитектуры практически во всех областях, где в принципе используется термин «архитектура». На ней базируется любая сложная система, будь то собор, ваше собственное тело, завод по производству автомобилей или нейронная сеть.

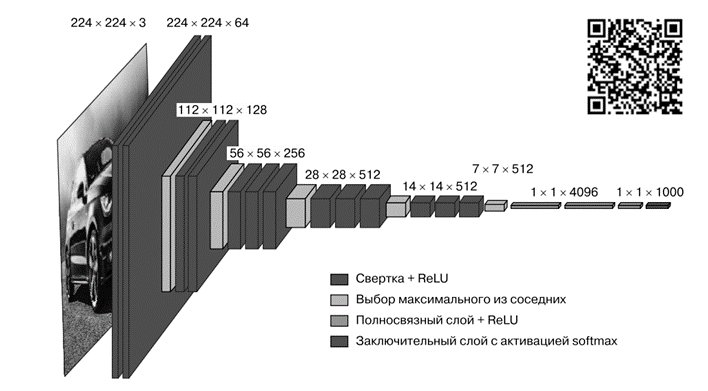

Точно так же архитектура модели глубокого обучения в первую очередь связана с разумным применением принципов модульности, иерархии и повторного использования. Все популярные сверточные архитектуры не только структурированы по слоям — их слои также организованы в повторяющиеся группы, называемые блоками или модулями.

Кроме того, большинство сверточных сетей имеют пирамидальную структуру (иерархию признаков). Число фильтров растет с глубиной слоя, а размер карт признаков, соответственно, уменьшается.

Архитектура VGG16: обратите внимание на повторяющиеся блоки слоев и пирамидальную структуру карт признаков