1

Тема 3. Разделяющие функции для случая нормальной плотности

Как мы видели, классификация с минимальным уровнем ошибки может осуществляться посредством разделяющих функций вида

di (x) ln p(x | Ci ) ln P(Ci ) .

Это выражение легко оценивается в случае, когда многомерная плотность p(x | Ci ) нормальна

di (x) 12 (x - mi )T Σi 1 (x - mi ) n2 ln 2 12 ln Σi ln P(Ci ) .

Рассмотрим этот результат в частных случаях.

3.1. Случай 1: Σi 2I .

Простейшая ситуация

- признаки статистически независимы;

-они имеют одинаковую дисперсию 2 .

Ковариационная матрица становится диагональной - произведение 2

на единичную матрицу I.

Геометрия: выборки данных попадают внутрь одинаковых гиперсфер с центром mi (вектор средних значений).

Упрощается расчет

- определителя и матрицы: Σi 2n ,

- обратной i : Σi 1 12 I .

|

|

|

|

|

|

|

|

|

|

|

2 |

||

В выражении di (x) |

можно пренебречь несущественными постоянными |

||||||||||||

|

1 |

ln |

|

n |

|

|

|

|

|||||

|

|

|

|

|

|

||||||||

слагаемыми |

|

Σi |

и |

|

ln 2 (не зависят от i). В результате разделяющие |

||||||||

2 |

|||||||||||||

|

|||||||||||||

|

|

|

|

2 |

|

|

|

|

|||||

|

|

|

|

|

|

|

|||||||

функции принимают простой вид: |

|

|

|

|

|||||||||

|

|

|

|

|

|

di (x) |

|

|

x - mi |

|

2 |

ln P(Ci ) , |

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

2 2 |

|

||||

где

.

.

евклидова норма, т. е.

евклидова норма, т. е.

x - mi

x - mi

2 (x - mi )T (x - mi ) .

2 (x - mi )T (x - mi ) .

А. Если все априорные вероятности Р(Ci) равны, то слагаемым ln P(Ci )

можно пренебречь.

Оптимальное решающее правило формулируется очень просто:

чтобы определить класс вектора x , следует измерить евклидово расстояние

x - mi

x - mi

от х до каждого из c векторов средних значений и отнести х к классу,

от х до каждого из c векторов средних значений и отнести х к классу,

соответствующему ближайшему среднему значению.

Такой классификатор называют классификатором по минимуму расстояния. Если каждый из векторов средних значений считать эталоном

для образов своего класса, то это по существу будет процедура сравнения с

эталоном.

|

Б. |

Если априорные вероятности не равны, |

то квадрат расстояния |

||||

x - m |

i |

|

|

|

2 |

должен быть нормирован по дисперсии 2 |

и смещен на величину |

|

|

||||||

|

|

|

|

|

|

|

|

ln P(Ci ) .

В случае одинаковой близости х к двум различным векторам средних значений следует предпочесть класс, априорно более вероятный.

3

Можно упростить вид решающей функции: раскрытие квадратичной

формы (x - mi )T (x - mi ) приводит к квадратичной функции х:

d |

(x) |

1 |

|

xT x 2mT x mT m |

ln P(C ) , |

||

|

2 |

||||||

i |

|

2 |

|

i |

i i |

i |

|

|

|

|

|

|

|

|

|

Квадратичным членом xT x можно пренебречь.

В результате получаем эквивалентную линейную разделяющую функцию вида

di (x) wTi x + wi0 ,

wi 12 mi ,

wi0 21 2 mTi mi ln P(Ci ) .

При условии равенства всех Р(Ci) :

di (x) mTi x 12 mTi mi , i 1, 2,...M . (di (x) max) ,

т.е. образ x относится к классу i, если di (x) d j (x) для всех j i .

Классификатор, основанный на использовании линейных разделяющих функций, называется линейной машиной. Он использует для представления каждого класса в виде одной точки (эталона).

4

Поверхности решений

Поверхности решений в случае линейной машины явятся частями гиперплоскостей, определяемых линейными уравнениями di (x) d j (x) .

Для данного частного случая это уравнение можно записать в виде

|

wT (x x |

) 0 или |

(wT x wT x |

) , |

|

0 |

|

0 |

|

где |

w mi m j , |

|

|

|

|

|

|

1 |

|

|

|

) |

|

|

|

|

2 |

|

|

|

|

|

ln |

P(C ) |

(m |

|

m |

|

x |

|

|

(m |

|

+ m |

|

|

|

|

|

|

|

|

i |

|

). |

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||

|

0 |

|

2 |

|

i |

j |

|

|

|

m |

i |

m |

j |

|

|

|

2 |

|

P(C j ) |

|

i |

j |

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

Отметим следующее. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

1. Это уравнение |

определяет ортогональную вектору w mi m j |

||||||||||||||||||||||

гиперплоскость, проходящую через точку х0, т.е. гиперплоскость,

разделяющая Ri и Rj , будет ортогональна прямой, соединяющей их средние значения.

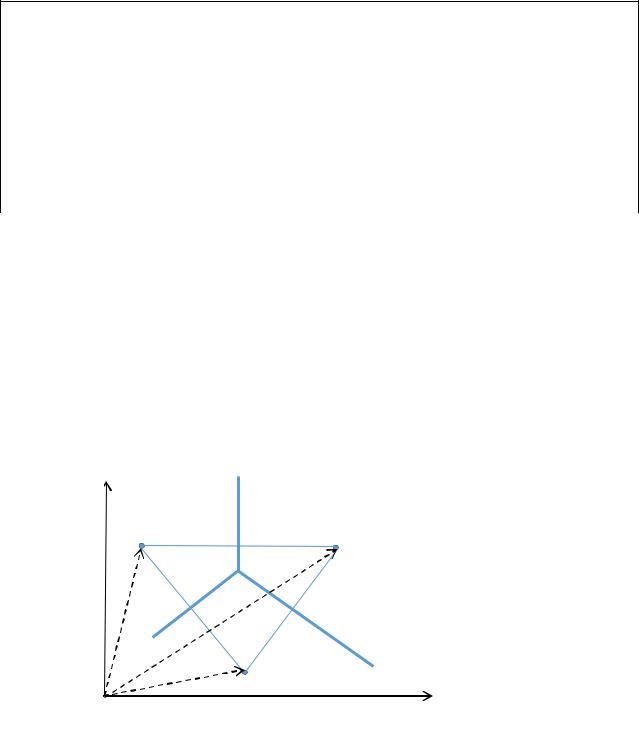

x2

R1 |

R2 |

|

a)

R3

x1

5

Такое представление справедливо для случая нормального распределения с

равными дисперсиями по каждой координате.

X

w

(m1-m2)

b)

W-весовой |

X0 |

вектор |

Рис.1. Границы областей решений при использовании классификатора по минимуму

расстояния: a)трѐхклассовая задача; b) двухклассовая задача.

2.Если P(Ci ) P(Cj ) , то точка х0 находится посередине, а

гиперплоскость проходит через середину отрезка, соединяющего средние значения перпендикулярно ему (рис. 1).

3. |

|

|

Если |

P(Ci ) P(Cj ) , то точка |

x0, смещается, |

удаляясь от |

более |

|||||

вероятного среднего значения. |

|

|

|

|

||||||||

4. |

Если |

дисперсия |

2 мала |

по |

сравнению с квадратом расстояния |

|||||||

|

|

mi m j |

|

|

|

2 , то |

положение |

границы |

областей решений |

сравнительно |

мало |

|

|

|

|

|

|||||||||

зависит от значений априорных вероятностей.

6

Построение решающего правила

(классификатором по минимуму расстояния)

Решающее правило (P(C1 ) P(C 2 )) будет иметь следующий вид.

Разделяющая функция

wT (x x0 ) 0 или (wT x wT x0 ) ,

где |

w m1 m2 |

и вектор

x0 12 (m1 + m2 ).

Или

d(x) d1(x) d2 (x) wT x - a 0 ,

a wT x0 xT0 w 12 (m1 + m2 )T w.

Тогда дискриминантную функцию можно привести к стандартному виду

D(X) WтX a 0,

где W – весовой вектор единичной длины; a – пороговая величина. Для этого разделим все члены выражения на

m1 m2

m1 m2

,

,

.

.

- норма (длина вектора).

- норма (длина вектора).

В этом случае (так как WтX X сosα ) процедура распознавания заключается в вычислении проекции вектора X на направление весового вектора W и

сравнении полученной величины с порогом a.

7

X |

|W| = 1 |

|

α

W

a

|X| сos α

Рис.2. К определению D(X)

Ясно, что разделяющая гиперплоскость проходит перпендикулярно к W на расстоянии a от начала координат.

Тогда весовой вектор

|

W |

|

|

|

|

m1 m2 |

|

, |

||||||

|

|

|

|

|

m m |

2 |

|

|

||||||

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

1 |

|

|

|

|

||

и порог |

a |

1 |

(m + m |

|

)T W . |

|||||||||

|

|

|||||||||||||

|

2 |

|

|

|

|

1 |

2 |

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

||

И решающее правило принимает вид

WT X < a , то класс R1 ;

WT X > a , то класс R2 .

Алгоритм распознавания (2 класса)

1.Вычислить весовой вектор w (w1, w2 ,..., wn ) .

2.Пронормировать этот вектор ( ww ), сделав его единичным вектором

W.

3.Спроектировать точки обоих классов на прямую линию, определяемую положением W, и построить их одномерные гистограммы.

4.Найти точку на этой прямой (порог a).

5.Определить разделяющую гиперплоскость WT X a 0 и соответствующий алгоритм распознавания.

8

Для трѐхклассовой задачи возможны несколько вариантов решений.

1. Использовать di (x) mTi x |

1 |

mTi mi , |

i 1,2,...M |

(di (x) max) . |

|

2 |

|||||

|

|

|

|

2.Используя метод главных компонент, найти наиболее удаленный

(или более плотно сгруппированный) класс, отделив его от двух остальных (1 этап). Затем решить задачу классификации двух оставшихся классов (2 этап).

3.Строить решающие функции для каждой пары соседних классов.