Учебное пособие 800326

.pdf

A 1 |

7 |

3,56. |

|||

|

|

|

|

||

S |

1,965 |

||||

|

|||||

С ростом A пикфактор резко увеличивается. Большое значение пикфактора нежелательно и не всегда допустимо, поскольку связано с неоправданной тратой времени и ресурсов на раскрытие маловероятных, а, иногда, и малозначащих состояний объекта.

Если использовать неоптимальный в данном случае дихотомический алгоритм поиска с деревом, показанным на рис. 5.3, то среднее число измерений (алгоритмическая скрытность) R log2 A 3, что в полтора раза больше потен-

циального значения.

На рис. 6.5 показаны КСН для оптимального последовательного (кривая 1) и дихотомического (кривая 2) алгоритмов при тех же параметрах, что и рис. 6.4. Отклонение от оптимальности поиска приводит к повышению скрытности и снижению информативности первых измерений.

Рис. 6.5

6.3.2. Равномерное распределении вероятностей состояний объекта

Пусть X – симметричное множество возможных равновероятных состояний объекта со значением A 2n , где n – це-

лое число, Pi 1/ A , i 1, A . В этом случае оптимальным яв-

ляется дихотомический алгоритм поиска, дерево которого при A 8 показано на рис. 5.3. Исходная энтропия множества со-

стояний H (X ) log2 A n . При равномерном распределении |

59 |

нет нужды рассматривать для усреднения все варианты ветвей дерева поиска, так как они одинаковы.

Нетрудно показать, что средняя энтропия состояний H (N) имеет вид

|

|

|

|

|

|

|

H (N) |

H (X ) N при |

N |

1, log2 A , |

(6.17) |

||

и декремент неопределенности равен единице. |

|

|||||

|

Зависимость H (N) от N |

|||||

|

показана на рис. 6.6. С информа- |

|||||

|

ционной точки зрения дихото- |

|||||

|

мический поиск в симметричном |

|||||

|

множестве |

X является наиболее |

||||

|

эффективным. При дихотомиче- |

|||||

|

ском поиске длина всех путей |

|||||

|

поиска |

в |

дизах одинакова и |

|||

|

пикфактор |

|

1, то есть и с этой |

|||

Рис. 6.6 |

точки зрения свойства алгоритма |

|||||

|

наиболее благоприятны. |

|

||||

Если при равномерном распределении вероятностей использовать неоптимальный последовательный алгоритм поиска, то повысится скрытность (алгоритмическая) которая равна

|

1 |

A 1 |

A 1 |

|

|

A 1 |

A |

1 |

. |

(6.18) |

|||

R |

|

i |

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

||||

|

A i 1 |

A |

2 |

|

A |

|

|

|

|||||

При A 8 получим R |

4,375 диз, а в пределе при A |

из |

|||||||||||

(6.18) следует известное соотношение |

|

|

|

|

|||||||||

|

|

R |

|

A |

1 |

. |

|

|

|

|

(6.19) |

||

|

|

2 |

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|||

Отношение алгоритмической скрытности |

R к потенци- |

||||||||||||

|

|

|

60 |

|

|

|

|

|

|

|

|

|

|

альной S можно назвать избыточностью |

используемого |

алгоритма поиска и определить ее в виде

RS . (6.20)

В рассматриваемом случае S log2 A и с учетом (6.19) получим

1 |

|

A 1 |

A 1 |

. |

(6.21) |

|

|

|

|

|

|

||

log2 A |

2 |

|

A |

|

||

Зависимость (A) показана на рис. 6.7а. Как видно, из-

быточность алгоритма последовательного поиска возрастает при увеличении A .

Рис. 6.7

На рис. 6.7б представлены КСН для дихотомического (кривая 1) и последовательного (кривая 2) поиска. В данном случае переход к последовательному перебору состояний резко ухудшает информационную эффективность поиска.

61

Глава 7. СКРЫТНОСТЬ ПЕРВОГО И ВТОРОГО РОДА

7.1.Скрытность первого рода

Впредыдущих главах рассматривались ситуации, в кото-

рых при единственном реасобытии и отсутствии ошибок

измерения всегда можно построить алгоритм поиска и обеспечить достоверное выявление всех состояний объекта с нулевой неопределенностью (энтропией) результата.

Однако на практике это не всегда возможно. В измерительном канале присутствуют помехи, которые приводят к ошибочным измерениям. Они могут исправляться в ходе дополнительных (проверочных) измерений, однако всегда останется некоторая неуверенность в результате поиска. Помимо реасобытия могут наблюдаться и другие, близкие по свойствам (например, маскирующие сигналы), и тогда разведка не приведет к правильному результату при сколь угодно продолжительном поиске.

Таким образом, в общем случае оптимальный алгоритм поиска должен проектироваться так, чтобы обеспечивать минимум двоичных измерений для выявления реасобытия с заданной достоверностью, если она достижима. Вероятность правильного обнаружения реасобытия будем называть дове-

рительной и обозначать Pдов

Полученную скрытность объекта (алгоритмическую или потенциальную) будем называть скрытностью первого рода и обозначать R1 или S1 соответственно. Она характеризует

фактические затраты, необходимые для решения задачи поиска.

7.2. Скрытность второго рода

Если вероятность правильного выявления реасобытия xr

меньше единицы, то с ненулевыми остаточными вероятно62

стями Pостi истинным может быть другое значение xi .

На рис. 7.1 показан пример такого распределения вероятностей (в логарифмическом масштабе) при условии обнаружения реасобытия x4

с вероятностью Pдов 0.9 ,

A 8 .

Оставшаяся после завершения поиска неопределенРис.7.1 ность характеризуется оста-

точной энтропией

|

A |

|

H ост |

Pостi log2 Pостi . |

(7.1) |

i1

Вобщем случае она зависит от характеристик объекта, алгоритма поиска и значения реасобытия.

При заданной величине Pдов для найденного xr максимум H ост имеет место при равных вероятностях всех остальных состояний объекта,

|

|

Pдов при |

i |

r, |

|

|

||

Pостi |

1 |

Pдов |

|

|

|

. |

(7.2) |

|

|

при |

i |

r |

|

||||

|

|

A |

1 |

|

|

|||

|

|

|

|

|

|

|

||

Тогда наибольшее возможное значение остаточной энтропии равно

Hост max  Pдов log2 Pдов (1 Pдов )log2 (1 Pдов ) (1 Pдов )log2 (A 1) . (7.3)

Pдов log2 Pдов (1 Pдов )log2 (1 Pдов ) (1 Pдов )log2 (A 1) . (7.3)

63

Зависимости Hост max от доверительной вероятности Pдов и арсенала множества состояний A показаны на рис. 7.2.

Рис.7.2

Как видно, наибольшее значение остаточной энтропии уменьшается с повышением доверительной вероятности обнаружения состояния объекта и уменьшением A .

Величина H ост характеризует неопределенность о реасо-

бытии после окончания поиска, когда измерения прекращаются и принято окончательное решение. Тогда ее можно рас-

сматривать как остаточную энтропийную скрытность объ-

екта – скрытность второго рода S2 , которая оценивает ми-

нимально необходимое число гипотетических двоичных измерений, которые необходимо было бы произвести для точного выявления реасобытия, если бы поиск продолжался безошибочно. Тогда с учетом (7.1) получим

|

A |

|

S2 H ост |

Pостi log2 Pостi . |

(7.4) |

|

i 1 |

|

Для объединения скрытностей первого S1 |

и второго S2 |

|

рода в единую оценку скрытности объекта удобно ввести понятие комплексной скрытности S , определив ее равенством

64

S S1 jS2 , |

(7.5) |

где j

1 - мнимая единица. Все эти виды скрытности из-

1 - мнимая единица. Все эти виды скрытности из-

меряются в двоичных измерениях.

В отличии от скрытности первого рода остаточная скрытность характеризует условные (фиктивные) затраты на поиск, который никогда не реализуется, и для него отсутствует необходимость в разработке оптимальных алгоритмов. Поэтому для ее оценки вполне подходит остаточная энтропия (7.4).

7.3. Симптомы

На практике весьма часто приходится иметь дело не с недоступными непосредственно для осмотра или исследования состояниями, а с определенными признаками состояний. Условимся называть их симптомами в широком понимании этого слова в разных областях приложения.

В квартире погас свет. Это может быть следствием ряда факторов, определяющих обстановку: неисправности электролампы, предохранителя, выключателя и т.д. Темнота в квартире является зримым синдромом неисправности сети; конкретная причина подлежит выявлению.

Один и тот же симптом может быть следствием ряда факторов xi, определяющих состояние объекта или обстановки и наоборот. Повышенная температура, головная боль – симптомы заболевания, которое не всегда может быть выявлено путем даже самых тщательных исследований.

Радиолокационный сигнал в виде отметки на экране индикатора может быть вызван действительным появлением цели в зоне наблюдения, но может быть вызван выбросом напряжения шума на выходе приемника. Общепринятыми стали перекочевавшие из радиолокации в связь и другие области выражения «ложная тревога» и «пропуск сигнала».

Сигналы с разными параметрами, несущими частотами, например xi , являются симптомами действия станций в диа-

65

пазоне, но не всегда отражают истинную обстановку из-за помех или умышленных ложных излучений.

Будем, как и прежде, обозначать множество состояний

объекта через X {xi }, i 1, A , множество симптомов – через Y {y j }, j 1, B . Мощности этих множеств могут быть раз-

ными, как по числу элементов, так и по вызывающих их причинам и физическим обстоятельствам.

7.4. Вероятности симптомов и их скрытность

Симптомы далеко не всегда лежат «на поверхности», часто для их выявления требуются более или менее сложные и трудоемкие измерения (анализы). В связи с этим возникает вопрос об оптимизации поисковых процедур в пространстве симптомов.

На рис. 7.3а в виде двух столбцов символов в кружках представлены множества X и Y с их элементами xi и yi . Их объединяют так называемые переходные (условные) вероят-

ности |

P( yi / xi ) |

и |

P(xi |

/ yi ) . Здесь |

P( yi / xi ) |

Pj / i - вероят- |

ность симптома |

yi |

при состоянии объекта xi |

. Матрица пере- |

|||

ходных |

вероятностей |

P( yi / xi ) при |

А=В=4 |

приведена для |

||

примера на рис. 7.3б. Значения P( yi |

/ xi ) P( j / i) указаны в |

клетках на перекрестках i-ых строк |

и j-ых столбцов. Сама |

матрица обозначена через [Pj / i ] . |

|

При известном законе распределения вероятностей состояний объекта P(xi ) и матрице [Pj / i ] вероятности симпто-

мов (их закон распределения) можно найти по формуле полной вероятности

|

A |

|

P( y j ) Pj |

P(xi )P( y j / xi ). |

(7.5) |

|

i 1 |

|

|

66 |

|

Потенциальная энтропийная скрытность множества симптомов вычисляется по формуле

B |

|

|

S (Y ) |

P( y j ) log P( y j ). |

(7.6) |

j |

1 |

|

Рис. 7.3

Симптомы рассматриваются при этом как состояния y j

некоторого объекта Y , отделенного от Х. Скрытность (7.6) указывает , как и в случае с Х , на минимально необходимое, в среднем, число двоичных измерений (диз) для раскрытия симптомов (скрытность первого рода).

При отсутствии помех и неоднозначности состояния xi и симптомы yi на диаграмме рис. 7.4а связаны между собой

прямыми линиями без перекрещиваний, что может быть выражено равенством

P( y j |

) |

P(xi ) при j |

i, |

(7.7) |

||

0 |

при j |

i. |

||||

|

|

|

||||

Матрица переходных вероятностей принимает при этом

67

диагональный вид (рис. 7.4б) с единицами по диагоналям и нулями в других клетках.

Рис. 7.4

7.5. Апостериорные вероятности состояний исследуемого объекта после измерений

При измерениях (анализах) мы устанавливаем симптомы yi состояний исследуемого объекта Х с заданным априорным

законом распределения вероятностей P(xi ) . Выявленные симптомы по мере их раскрытия меняют наши представления о состояниях xi (их вероятностях). Мы стремимся к выяснению интересующих нас деталей обстановки до пределов воз-

можного. |

Условные вероятности состояний объекта xi |

при |

|||

симптоме |

yi являются апостериорными вероятностями со- |

||||

стояний xi |

и определяются равенством (формула Байеса) |

|

|||

|

P(xi / y j ) |

P(xi )P( y j |

/ xi ) |

|

|

|

|

|

, |

(7.8) |

|

|

P( yi ) |

|

|||

|

|

|

|

|

|

или, с учетом (7.5),

68

P(xi / y j ) |

P(xi )P( y j |

/ xi |

) |

. |

(7.9) |

A |

|

|

P(xi )P( y j / xi )

i 1

Апостериорная вероятность xi определяется, как видно, удельным вкладом P(xi )P( y j / xi ) в сумму вкладов в P( y j ) всех xi с учетом переходных вероятностей в знаменателе вы-

ражения (7.9). Рассматриваемое как функция целочисленной переменной i , это выражение представляет закон распределения апостериорных вероятностей состояний исследуемого объекта Х. Значение P(xi / y j ) в (7.9) зависит от степени соот-

ветствия симптомов истинным состояниям объектов. Если при j i P( yi / xi ) 1 , то P( y j / xi ) 0 при j i и каждому симптому соответствует единственное состояние. В этом случае апостериорные и априорные распределения вероятностей совпадают. На практике симптомы отбираются исходя из степени их взаимосвязи с выявляемыми состояниями, а в противном случае их использование нецелесообразно.

В табл. 7.1 приведен пример априорного закона распределения вероятностей состояний объекта Pi P(xi ) при А=4.

Таблица 7.1

xi |

1 |

2 |

3 |

4 |

|

|

|

|

|

P(xi ) |

0,5 |

0,2 |

0,2 |

0,1 |

|

|

|

|

|

На рис. 7.5 представлена матрица переходных вероятностей [Pj / i ] симптомов и состояний, а на рис. 7.6 – диаграммы

апостериорных вероятностей P(xi / y j ) , полученных согласно (7.9).

69

Рис. 7.5

Рис.7.6

Как видно из рис 7.6.а, признак x1 сильно статистически связан с симптомом y1 (вероятность их совпадения 0,917).

Аналогичные выводы следуют и из диаграмм на рис. 7.6б – рис. 7.6г, но с меньшими вероятностями. Если реасобытие определяется по максимальной апостериорной вероятности симптома, то ее значение является доверительной вероятностью Pдов принятого решения.

По окончании поиска симптомов остается неопределен70

ность относительно соответствующего состояния, которая характеризуется условной энтропией

|

A |

|

H ( X / y j ) |

P(xi / y j ) log2 P(xi / y j ) . |

(7.10) |

|

i 1 |

|

Она представляет собой остаточную скрытность состояния после завершения поиска симптомов,

S2 |

Hост H ( X / y j ) . |

(7.11) |

|

На рис. 7.7 показана зависи- |

|

|

мость энтропии (7.10) от номера |

|

|

найденного симптома y j |

для рас- |

|

сматриваемого примера. Как вид- |

|

|

но, остаточная скрытность тем |

|

|

выше, чем меньше доверительная |

|

|

вероятность результата поиска, что |

|

|

согласуется с результатами иссле- |

|

|

дований максимальной |

остаточ- |

|

ной энтропии, показанными на |

|

Рис. 7.7 |

рис. 7.2а. |

|

|

При диагональной матрице пе- |

|

реходных вероятностей типа рис. 7.4б апостериорное распределение имеет вид

P( y j / xi ) |

1 |

при |

i |

j, . |

(7.12) |

|

0 |

при |

i |

j. |

|

В этом случае каждому симптому |

y j |

однозначно (с довери- |

|||

тельной вероятностью Pдов |

1) соответствует состояние x j , и |

||||

после выявления симптома неопределенность состояния (остаточная скрытность) равна нулю.

71

Если |

же |

все |

переходные вероятности одинаковы, |

P( y j / xi ) |

1/ A, то согласно (7.9) апостериорные вероятности |

||

состояний |

P(xi |

/ y j ) |

P(xi ) не зависят от выявленного сим- |

птома. Это означает, что симптомы не содержат информации о состояниях и обнаруженный в процессе поиска симптом не позволяет судить об имеющемся состоянии.

Апостериорные распределения типа рис. 7.6 сами по себе могут служить наглядным и численно обоснованным выражением результатов исследования объекта и обстановки.

7.6. Информационные характеристики и остаточная неопределенность

Исходная неопределенность H (X ) состояний объекта определяется выражением (4.1),

|

A |

|

H ( X ) |

P(xi ) log2 P(xi ) . |

(7.13) |

|

i 1 |

|

После выявления симптома в процессе поиска условная энтропия состояний, усредненная по симптомам, с учетом

(7.10) равна

B |

A |

|

H ( X / Y ) |

P( y j ) P(xi / y j ) log P(xi / y j ) . |

(7.14) |

j 1 |

i 1 |

|

Это средняя остаточная неопределенность (скрытность второго рода S2 ) состояний, обусловленная неоднозначностью со-

ответствия симптомов и состояний объекта. Если между симптомами и состояниями имеется однозначное соответствие (7.12), то остаточная неопределенность равна нулю. Если же статистическая взаимосвязь между ними отсутствует, то есть

72

P(xi / y j ) P(xi ) , |

(7.15) |

тогда остаточная энтропия равна исходной,

H(X / Y) H(X ) , |

(7.16) |

и после завершения поиска неопределенность состояний не снижается.

В результате поиска наблюдатель получает общее количество информации, равное

I (X ,Y) H(X ) H(X /Y ) . |

(7.17) |

Оно зависит от вероятностных свойств состояний и матрицы переходных вероятностей (взаимосвязи симптомов и состояний) и изменяется от нуля до H (X ) .

В теории информации доказано, что безусловная энтропия не меньше условной, то есть количество информации неотрицательно. Там же показано, что

I(X ,Y) H(Y) H(Y / X ) . |

(7.18) |

Безусловные и условные вероятности и энтропии симптомов зависят как от свойств состояний, так и от матрицы переходных вероятностей.

Величина H(Y) является энтропийной скрытностью симптомов (скрытностью первого рода S1 ) и характеризует за-

траты на их безошибочное выявление.

Следует иметь в виду, что энтропийные скрытности первого и второго рода в данном случае относятся к различным множествам симптомов и состояний соответственно.

73

7.7. Отгадывание

В том случае, когда получение информации о состоянии объекта невозможно из-за дефицита времени, сильных помех или обрыва измерительного канала, остается еще шанс его отгадывания.

Возможны две стратегии в этой задаче – неприцельное и прицельное отгадывание.

Неприцельное отгадывание предполагает равновероятный выбор реасобытия xr (путем «слепого» выбора из урны биле-

тика с |

надписью |

xr ). Обозначим вероятность этого через |

|||

Q(xr ) |

1/ A . Вероятность того, что выбранное xr |

действи- |

|||

тельно |

|

является |

реализовавшимся событием, |

равна |

|

|

|

|

|

||

P(xr ),i |

1, A . Вероятность этого по теореме умножения веро- |

||||

ятностей независимых событий равна произведению P(xr )Q(xr ) . Поскольку совпадение может иметь место при любом xr , для вычисления вероятности отгадывания необхо-

димо усреднить это произведение по всем реасобытиям. Тогда вероятность отгадывания равна

|

A |

1 |

A |

1 |

(7.19) |

PОТГ |

P(xi )Q(xr ). |

|

P(xi ) |

|

|

|

A |

||||

|

i 1 |

A i 1 |

|

||

Отсюда следует, что независимо от закона распределения вероятностей состояний объекта P(xi ) вероятность непри-

цельного отгадывания равна 1/ A . Она убывает по гиперболическому закону с увеличением ассортимента возможных состояний А.

Если распределение вероятностей реасобытий существенно неравномерно, то целесообразней использовать прицельное отгадывание.

В этом случае в качестве реасобытия выбирается наиболее вероятное значение xi , в соответствии с чем вероятность

74

прицельного отгадывания может быть представлена в выражением

|

PОТГ max P(xi ). |

(7.20) |

|

|

Для распределения вида (6.11), (6.12) |

|

|

|

P(x ) |

2 i |

(7.21) |

|

i |

|

|

при |

1 вероятность отгадывания равна PОТГ |

0,5 . Это зна- |

|

чительно больше по сравнению с (7.19) при больших А.

При прицельном отгадывании и заданном распределении вероятностей P(xi ) всегда будет выбираться то состояние, для которого выполняется условие (7.20).

При отгадывании скрытность первого рода S1 равна нулю, так как поиск не проводится, а остаточная скрытность S2 максимальна и равна исходной энтропии состояний H (X ) .

75

Глава 8. СКРЫТНОСТЬ ОБЪЕКТОВ С НЕПРЕРЫВНЫМ МНОЖЕСТВОМ СОСТОЯНИЙ

8.1. Особенности непрерывных множеств состояний

Непрерывным (континуальным) является такое множество состояний объекта X , в котором на любом конечном интервале находится бесконечное множество значений состояния. Точки непрерывного множества расположены «вплотную» друг к другу, а вероятность p выбора конкретного зна-

чения состояния бесконечно мала (стремится к нулю).

При оценке скрытности состояний объекта с конечном числом состояний ее величина пропорциональна log(p) и

стремится к бесконечности при p 0 . Таким образом, рас-

смотренный математический аппарат оказывается неприемлемым для анализа скрытности состояний с непрерывным множеством значений.

8.2. Плотность вероятностей

В теории вероятностей [2] при описании статистических свойств непрерывных случайных величин x используется

плотность вероятностей w(x) .

Определим функцию распределения вероятностей F(x) значения непрерывной вещественной случайной величины  как вероятность того, что

как вероятность того, что  x . Эта величина конечна и изменяется от 0 при

x . Эта величина конечна и изменяется от 0 при

до 1 при

до 1 при  . Тогда вероятность p(x) попадания значения случайной величины в беско-

. Тогда вероятность p(x) попадания значения случайной величины в беско-

нечно малый интервал dx от x |

до x |

dx равна |

|

p(x) F(x |

dx) |

F(x) , |

(8.1) |

и ее значения бесконечно малы.

Для перехода к конечным функциям используется плот76

ность вероятностей w(x) случайной величины, определяемая выражением

w(x) |

p(x) |

|

F(x dx) |

F(x) |

. |

(8.2) |

dx |

|

dx |

|

|||

|

|

|

|

|

И числитель, и знаменатель в выражении (8.2) бесконечно малы, а их отношение может быть любым положительным числом.

По определению функции распределения вероятностей получим условие нормировки

w(x)dx 1 . |

(8.3) |

При заданной плотности вероятностей w(x) функция распределения вероятностей F(x) определяется выражением

|

x |

|

F (x) |

w( )d . |

(8.4) |

Вероятность попадания значения случайной величины в интервал от x1 до x2 равна

|

x2 |

|

P(x1 x x2 ) |

w(x)dx. |

(8.5) |

x1

Из (8.2) следует

p(x) w(x)dx , |

(8.6) |

77

тогда полагая dx сколь угодно малой, но конечной величиной, при анализе скрытности непрерывных состояний можно использовать результаты анализа, полученные для дискрет-

ных |

значений |

состояния, рассматривая затем предел при |

dx |

0 . |

|

|

В качестве |

примера рассмотрим нормальную (гауссов- |

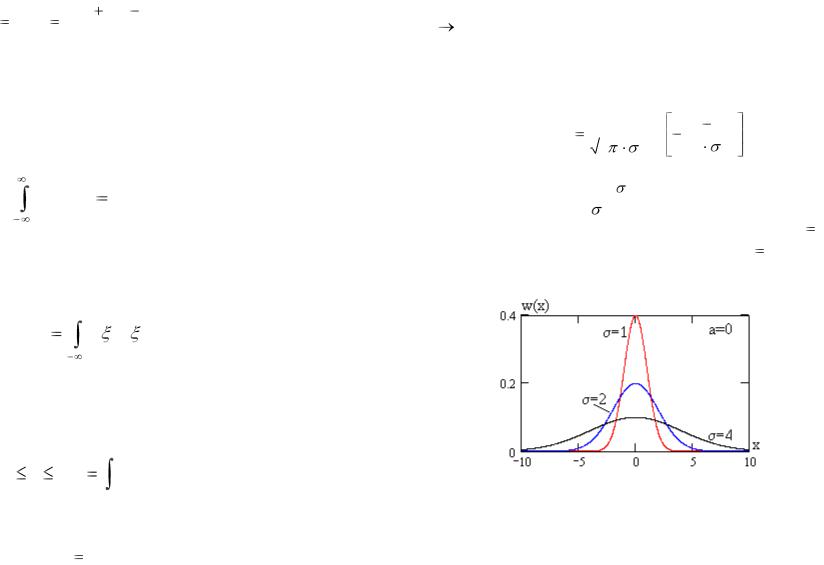

скую) непрерывную случайную величину, плотность вероятностей которой имеет вид

w(x) |

1 |

|

|

exp |

(x a)2 |

, |

(8.7) |

||

|

|

|

|

2 |

2 |

||||

2 |

|

||||||||

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|||

где a - среднее значение, а |

- среднеквадратическое откло- |

||||||||

нение (СКО). Величину |

|

2 называют дисперсией случайной |

|||||||

величины. Зависимости |

w(x) |

при нулевом среднем a |

0 и |

||||||

различных СКО  показаны на рис.8.1, а при

показаны на рис.8.1, а при  1 и различных a - на рис. 8.2.

1 и различных a - на рис. 8.2.

Рис. 8.1

Как видно, среднее значение a определяет центр функции распределения вероятностей, а СКО – ширину кривой (область разброса значений случайной величины). При отклонении x от среднего плотность вероятностей резко уменьша-

78