- •Раздел 2. Информация и информационные процессы.

- •Тема 2.2: «Принципы обработки информации компьютером. Арифметические и логические основы работы компьютера. Алгоритмы и способы их описания. Этапы решения задач с использованием компьютера»

- •1. Программный принцип работы компьютера

- •2. Арифметические и логические основы работы компьютера.

- •3 Алгоритмы и способы их описания

- •3.1 Алгоритмы и свойства алгоритмов

- •Модель — алгоритм — программа

- •3.2 Способы описания алгоритмов

- •Элементы блок-схем

- •Структура программы, записанная на языке Pascal

- •4. Этапы решения задач на компьютере

- •5. Переход от неформального описания к формальному (формальная и неформальная постановка задачи, переход от реальной задачи к информационной модели)

Николаева Г.П.

«Информатика и ИКТ» для студентов 1 курса

Раздел 2. Информация и информационные процессы.

Тема 2.2: «Принципы обработки информации компьютером. Арифметические и логические основы работы компьютера. Алгоритмы и способы их описания. Этапы решения задач с использованием компьютера»

1. Программный принцип работы компьютера

В основу построения подавляющего большинства компьютеров положены следующие общие принципы, сформулированные в 1945 г. американским ученым Джоном фон Нейманом.

1. Принцип программного управления. Из него следует, что программа состоит из набора команд, которые выполняются процессором автоматически друг за другом в определенной последовательности.

Выборка программы из памяти осуществляется с помощью счетчика команд. Этот регистр процессора последовательно увеличивает хранимый в нем адрес очередной команды на длину команды.

А так как команды программы расположены в памяти друг за другом, то тем самым организуется выборка цепочки команд из последовательно расположенных ячеек памяти.

Если же нужно после выполнения команды перейти не к следующей, а к какой-то другой, используются команды условного или безусловного переходов, которые заносят в счетчик команд номер ячейки памяти, содержащей следующую команду. Выборка команд из памяти прекращается после достижения и выполнения команды «стоп».

Таким образом, процессор исполняет программу автоматически, без вмешательства человека.

2. Принцип однородности памяти. Программы и данные хранятся в одной и той же памяти. Поэтому компьютер не различает, что хранится в данной ячейке памяти — число, текст или команда. Над командами можно выполнять такие же действия, как и над данными.

3. Принцип адресности. Структурно основная память состоит из перенумерованных ячеек; процессору в произвольный момент времени доступна любая ячейка.

Отсюда следует возможность давать имена областям памяти, так, чтобы к запомненным в них значениям можно было впоследствии обращаться или менять их в процессе выполнения программ с использованием присвоенных имен.

Компьютеры, построенные на этих принципах, относятся к типу фон-неймановских.

Но существуют компьютеры, принципиально отличающиеся от фон-неймановских. Для них, например, может не выполняться принцип программного управления, т.е. они могут работать без “счетчика команд”, указывающего текущую выполняемую команду программы. Для обращения к какой-либо переменной, хранящейся в памяти, этим компьютерам не обязательно давать ей имя. Такие компьютеры называются не-фон-неймановскими.

2. Арифметические и логические основы работы компьютера.

Арифметические основы

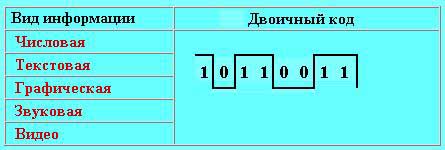

Компьютер может обрабатывать числовую, текстовую, графическую, звуковую и видео информацию. Возникает вопрос: "Как, каким образом компьютер обрабатывает столь различающиеся по восприятию человеком виды информации?"

Все эти виды информации кодируются в последовательности электрических импульсов: есть импульс (1), нет импульса (0), т.е. в последовательности нулей и единиц. Такое кодирование информации в компьютере называется двоичным кодированием, а логические последовательности нулей и единиц – машинным языком. Эти цифры можно рассматривать как два равновероятных состояния (события). При записи двоичной цифры реализуется выбор одного из двух возможных состояний (одной из двух цифр) и, следовательно, она несет количество информации, равное 1 биту.

Важно, что каждая цифра машинного двоичного кода несет информацию в 1 бит. Таким образом, две цифры несут информацию 2 бита, три разряда – 3 бита и т.д. Количество информации в битах равно количеству цифр двоичного машинного кода. Числа могут быть записаны в естественной или экспоненциальной форме. Естественной формой называется привычная нам, обычная запись чисел, например, 3,14, 2001 и т.д.

Экспоненциальная форма чисел обычно используется для записи либо очень больших, либо очень маленьких чисел, которые в обычной естественной форме содержат большое количество незначащих нулей (например, 1000000 = 1 • 106, 0,000001 = 0,1 • 10-5 ).

В языках программирования и в компьютерных приложениях при записи чисел в экспоненциальной форме вместо основания системы счисления 10 пишут букву Е, вместо запятой – точку и знак умножения не ставится (например, 1000000 = 1Е6, 0,000001 = 0.1Е-5

Например, для кодирования одного символа требуется 1 байт информации. Если рассматривать символы как возможные события, то можно вычислить, какое количество различных символов можно закодировать:

N = 2I = 28 = 256.

Такое количество символов вполне достаточно для представления текстовой информации, включая прописные и заглавные буквы русского и латинского алфавита, цифры, знаки, графические символы и т.д.

Кодирование заключается в том, что каждому символу ставится в соответствие уникальный десятичный код от 0 до 255 или соответствующий ему двоичный код от 00000000 до 11111111. Таким образом, человек различает символы по их начертанию, а компьютер – по их коду.

При вводе в память компьютера текстовой информации происходит ее двоичное кодирование, символ преобразуется в его двоичный код. Пользователь нажимает на клавиатуре клавишу с символом и в память компьютера поступает последовательность из восьми электрических импульсов (двоичный код символа). Код символа хранится в оперативной памяти компьютера, где занимает одну ячейку.

Логические основы

Над возможностями применения логики в технике ученые и инженеры задумывались уже давно.

Рассмотрите в электронном учебнике раздел «Логические операции».

Недостатками контактных схем являлись их низкая надежность и быстродействие, большие размеры и потребление энергии. Поэтому попытка использовать такие схемы в ЭВМ не оправдала себя. Появление вакуумных и полупроводниковых приборов позволило создавать логические элементы с быстродействием от 1 миллиона переключателей в секунду. Именно такие электронные схемы нашли свое применение в качестве элементной базы ЭВМ.

Что такое логический элемент компьютера?

Вся теория, изложенная для контактных схемах, была перенесена на электронные схемы. Элементы, реализующие базовые логические операции, назвали базовыми логическими элементами или вентилями. Как при строительстве дома применяют различного рода типовые блоки – кирпичи, рамы, двери и т.п., так и при разработке компьютера используют типовые электронные схемы. Каждая схема состоит из определенного набора типовых электронных элементов.

Логический элемент компьютера – это часть электронной логической схемы, которая реализует элементарную логическую функцию.

Тысячи микроскопических электронных переключателей в кристалле интегральной схемы сгруппированы в системы, выполняющие логические операции, т.е. операции с предсказуемыми результатами, и арифметические операции над двоичными числами. Соединенные в различные комбинации, логические элементы дают возможность компьютеру решать задачи, используя язык двоичных кодов.