- •Введение

- •1. Случайные события и вероятность

- •1.1. Пространство элементарных событий. Случайные события. Алгебра событий

- •1.2. Классическое определение вероятности. Статистическое определение вероятности

- •1.3. Элементы комбинаторики. Некоторые содержательные задачи

- •1.4. Аксиоматическое введение вероятности

- •1.5. Теоремы о вероятностях случайных событий

- •1.6. Формула полной вероятности и формула Байеса

- •1.7. Геометрические вероятности

- •1.8. Схема независимых испытаний Бернулли. Формула Бернулли. Формула Пуассона. Локальная и интегральная теоремы Муавра-Лапласа

- •Вопросы для самопроверки

- •2. Случайные величины

- •2.1. Случайные величины. Случайные величины дискретного типа. Ряд распределения. Функция распределения

- •2.2. Случайная величина непрерывного типа. Плотность вероятности распределения случайной величины

- •2.3. Числовые характеристики случайной величины. Математическое ожидание и дисперсия, их свойства

- •2.4. Пуассоновский поток событий

- •Вопросы для самопроверки

- •3. Системы случайных величин

- •3.1. Закон распределения системы двух случайных величин. Функция распределения, плотность распределения системы двух случайных величин

- •3.2. Условные законы распределения. Зависимые и независимые случайные величины

- •3.3. Числовые характеристики системы двух случайных величин. Корреляционный момент. Коэффициент корреляции

- •Вопросы для самопроверки

- •4. Функции случайных величин

- •4.1. Преобразование случайных величин (случай двух переменных)

- •4.2. Распределение суммы, разности, произведения и частного двух случайных величин

- •4.3. Преобразование случайных величин (случай одной переменной)

- •4.5. Распределение Стьюдента

- •Вопросы для самопроверки

- •5. Закон больших чисел

- •5.1. Неравенства Чебышева

- •5.2. Теорема Чебышева

- •5.3. Теорема Бернулли

- •5.4. Центральная предельная теорема

- •Вопросы для самопроверки

- •6. Случайные процессы. Марковские случайные процессы. Системы массового обслуживания

- •6.1. Случайные процессы

- •6.2. Марковские случайные процессы. Марковские цепи

- •6.3. Марковские процессы с дискретными состояниями и непрерывным временем. Уравнения Колмогорова

- •6.4. Процессы гибели и размножения

- •6.5. Потоки случайных событий

- •6.6. Приложения марковских процессов

- •6.7. Системы массового обслуживания

- •6.8. Системы массового обслуживания с отказами Одноканальная смо с отказами

- •6.9. Системы массового обслуживания с очередями

- •Вопросы для самопроверки

- •7. Математическая статистика

- •7.1. Генеральная совокупность и выборка. Статистический ряд. Статистическая функция распределения. Гистограмма

- •7.2. Точечные оценки параметров генеральной совокупности по выборочным совокупностям, их свойства. Точечные оценки для математического ожидания и дисперсии случайной величины

- •7.3. Интервальные оценки. Доверительный интервал. Нахождение доверительных интервалов для математического ожидания и дисперсии нормального распределения случайной величины

- •1. Доверительный интервал для оценки математического ожидания нормального распределения случайной величины с известным

- •2. Доверительный интервал для оценки математического ожидания нормального распределения с неизвестным

- •3. Доверительные интервалы для оценки среднего квадратического отклонения нормального распределения

- •7.4. Построение прямых линий регрессии по выборочным данным

- •1. Нахождение параметров выборочных уравнений прямой линии регрессии по несгруппированным данным

- •2. Нахождение параметров выборочных уравнений прямой линии регрессии по сгруппированным данным

- •7.5. Нахождение оценки для коэффициента корреляции двух случайных величин

- •7.6. Статистическая проверка гипотез. Статистическая гипотеза. Нулевая и конкурирующая гипотеза. Статистический критерий. Критическая область

- •7.7. Проверка гипотезы о значимости выборочного коэффициента корреляции

- •7.8. Проверка гипотезы о распределении генеральной совокупности. Критерий 2 Пирсона

- •7.10. Сравнение генеральных средних двух нормально распределенных случайных величин (малые независимые выборки)

- •7.11. Сравнение двух дисперсий нормальных генеральных совокупностей

- •7.12. Сравнение наблюдаемой относительной частоты с гипотетической вероятностью наступления события

- •Вопросы для самопроверки

- •8. Варианты контрольной paбoты № 1 по теории вероятностей вариант 1

- •Вариант 2

- •Вариант 3

- •Вариант 4

- •Вариант 5

- •Вариант 6

- •Вариант 7

- •Вариант 8

- •Вариант 9

- •Вариант 10

- •9. Варианты контрольной работы № 2 по случайным процессам и математической статистике вариант 1

- •Вариант 2

- •Вариант 3

- •Вариант 4

- •Вариант 5

- •Вариант 6

- •Вариант 7

- •Вариант 8

- •Вариант 9

- •Вариант 10

- •Приложение

- •Суммарные вероятности для распределения Пуассона

- •Критические точки распределения Стьюдента

- •Библиографический список

2. Случайные величины

2.1. Случайные величины. Случайные величины дискретного типа. Ряд распределения. Функция распределения

До сих пор мы имели дело со случайными событиями, которые являются качественной характеристикой опыта со случайным исходом. Количественной характеристикой его является случайная величина.

Случайной величиной будем называть переменную величину Х, которая в результате испытания принимает числовые (действительные) значения случайным образом, причем вероятности этих значений считаются известными.

Примеры. Число выпадений ''герба'' при n бросаниях; число попаданий в мишень при m выстрелах из орудия; число дефектных изделий в партии из k штук; число вызовов, поступающих на телефонную станцию в течение суток; ошибка при измерении дальности радиолокатором; рост при обследовании определенной совокупности людей; время безотказной работы телевизора; оценка на экзамене.

Случайные величины принято обозначать заглавными буквами латинского алфавита – X, Y, Z и т.д.

Более строгое определение случайной величины заключается в следующем.

Определение 2.1.1. Случайной величиной

называется однозначная функция X(ω),

определенная на Ω, для которой множество

вида

![]() ,

т.е. является множеством, элементы

которого являются случайными событиями

для любого

,

т.е. является множеством, элементы

которого являются случайными событиями

для любого

![]() .

.

Определение 2.1.2. Случайная величина называется случайной величиной дискретного типа, если множество ее возможных значений является конечным или счетным множеством.

Простейшей формой закона распределения случайной величины дискретного типа является ряд распределения, представляющий собой таблицу, в которой перечислены возможные значения случайной величины и соответствующие им вероятности:

Х |

х1 |

х2 |

... |

хn |

P |

p1 |

p2 |

... |

pn |

Здесь pi = Р(Х = хi),

i =![]() (вероятность того, что случайная величина

Х принимает значение xi).

При этом

(вероятность того, что случайная величина

Х принимает значение xi).

При этом

![]() pi

= 1.

pi

= 1.

Определение 2.1.3. Функцией распределения случайной величины Х называется функция, определенная на (-∞,∞) и определяемая равенством

F(x) = P(X < x). (2.1.1)

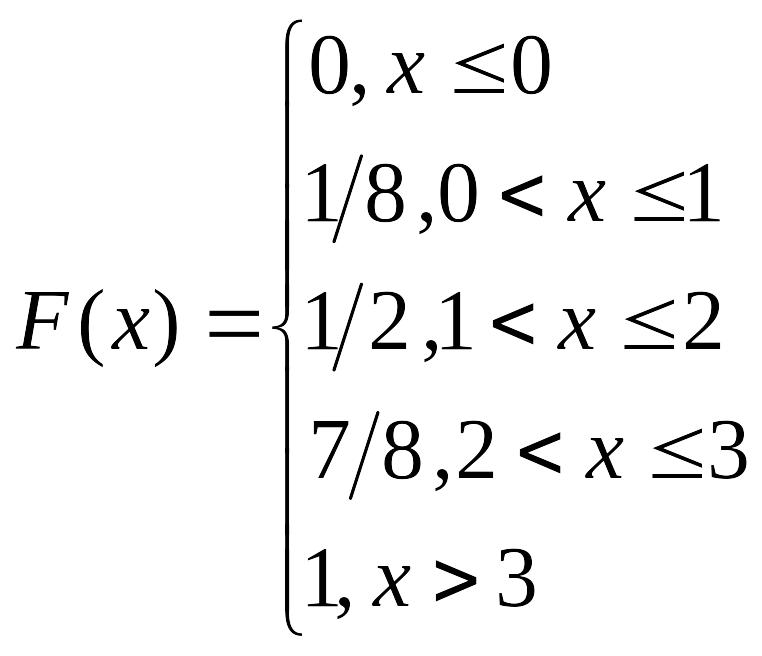

Задача 2.1.1. Построить ряд распределения, а также функцию распределения числа выпадений ''герба'' при трех бросаниях ''правильной'' монеты.

Решение.

В этой задаче Х – число выпадений

''герба'' при трех бросаниях монеты.

Значения, которые может принимать эта

случайная величина Х – 0, 1, 2, 3. Вероятности

этих значений вычисляются по формуле

Бернулли: Р3(0)

=

![]() (1/2)0(1/2)3

= 1/8;

Р3(1)

=

(1/2)0(1/2)3

= 1/8;

Р3(1)

=

![]() (1/2) (1/2)2

= 3/8; Р3(2)

=

(1/2) (1/2)2

= 3/8; Р3(2)

=

![]() (1/2)2 (1/2)

= 3/8; Р3(3)

=

(1/2)2 (1/2)

= 3/8; Р3(3)

=

![]() (1/2)3 (1/2)0

= 1/8.

(1/2)3 (1/2)0

= 1/8.

Ряд распределения этой случайной величины имеет вид

Х |

0 |

1 |

2 |

3 |

. |

Р |

1/8 |

3/8 |

3/8 |

1/8 |

На основе определения 2.1.3 и ряда распределения можем найти функцию распределения:

График функции F(x) представлен на рис. 2.1.1.

x

x

Рис. 2.1.1

Примеры случайных величин дискретного типа

1. Случайная величина биномиального типа

В схеме независимых испытаний Бернулли случайной величиной является Х – число ''успехов'' в n независимых испытаниях; она и называется случайной величиной с биномиальным законом распределения. Значения, которые может принимать эта случайная величина – 0, 1, 2, ..., n; вероятности этих значений вычисляются по формуле Бернулли:

![]() .

.

Ряд распределения этой случайной величины имеет вид

Х |

0 |

1 |

2 |

3 |

... |

n |

. |

Р |

Pn(0) |

Pn(1) |

Pn(2) |

Pn(3) |

... |

Pn(n) |

2. Случайная величина с геометрическим законом распределения

Случайной величиной с геометрическим законом распределения называется Х – число испытаний до первого ''успеха'' в схеме независимых испытаний Бернулли. Ряд распределения этой случайной величины имеет вид

X |

1 |

2 |

3 |

... |

k |

... |

. |

Р |

р |

qp |

q2p |

... |

qk-1p |

... |

3. Случайная величина, распределенная по закону Пуассона

Случайной величиной, распределенной по закону Пуассона, называется случайная величина Х, принимающая любые целые неотрицательные значения, вероятности которых вычисляются по формуле Пуассона:

Р(k) =

![]() , k

= 0, 1, 2, ... .

, k

= 0, 1, 2, ... .

Здесь

![]() –

параметр этого распределения. Известно,

что случайная величина, распределенная

по закону Пуассона, является предельным

случаем биномиального распределения

при n

–

параметр этого распределения. Известно,

что случайная величина, распределенная

по закону Пуассона, является предельным

случаем биномиального распределения

при n![]()

![]() и p

0

(np = ).

и p

0

(np = ).

Ряд распределения этой случайной величины имеет вид

Х |

0 |

1 |

2 |

... |

K |

... |

. |

P |

|

|

|

... |

|

... |

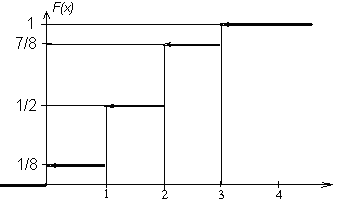

Свойства функции распределения случайной величины

Свойство 1. Функция распределения является неубывающей функцией на (‑ , ).

Доказательство. Требуется доказать,

что для

![]() .

.

В

Рис. 2.1.2

Запись А = {X < x2} обозначает случайное событие, заключающееся в том, что случайная величина Х принимает значения, меньшие х2; аналогично раскрываются случайные события В и С. Тогда, очевидно, А = В + С, и по теореме сложения для несовместных событий имеем:

Р(А) = Р(В + С) = Р(В) + Р(С), Р(Х < х1) = Р(Х < х1) + + Р(x1 X < x2), откуда имеем

F(x2)=F(x1)

+ P(x1

![]() X < x2). (2.1.5)

X < x2). (2.1.5)

Из (2.1.5) очевидно, что F(x1) F(x2).

Свойство 2. Р(x1 X < x2) = F(x2) - F(x1).

Доказательство. Следует из равенства (2.1.5).

Свойство 3. Функция распределения

F(x) случайной

величины непрерывна слева в

![]() х

(–

,

),

т.е. F(x – 0)

= F(x).

х

(–

,

),

т.е. F(x – 0)

= F(x).

Свойство 4. Для

х

![]() (-∞,∞)

Р(Х x)

= F(х + 0).

(-∞,∞)

Р(Х x)

= F(х + 0).

Свойство 5. Р(x1 X x2) = F(х2 + 0) – F(x1).

Доказательство. Аналогично доказательству свойства 1 введем случайные события: А = {X x2}, В = {X < x1}, C= {x1 X x2}. Тогда имеем

Р(А) = Р(В) + Р(С), или Р(Х х2) = Р(Х < х1) + Р(x1 X x2),

но Р(Х x2) = F(x2 + 0), Р(Х < х1) = F(x1), и тогда Р(x1 X x2) = F(x2 + 0) – F(x1). Свойство 6. F(–∞) = 0, F(+∞) = 1.

Здесь под символами F(-

)

и F(+

)

понимаем следующие пределы:

![]() ,

,

![]() .

.

Доказательство очевидно, если заметить, что F(–∞) = P(X < –∞) = 0;

F(+∞) = P(X < ∞) = 1.