- •1. Введение в интеллектуальные системы.................................................................7

- •2. Разработка систем, основанных на знаниях ........................................................36

- •3. Теоретические аспекты инженерии знаний..........................................................55

- •4. Технологии инженерии знаний.............................................................................. 95

- •5. Новые тенденции и прикладные аспекты

- •6. Программный инструментарий разработки систем, основанных на знаниях............................................................................................................................194

- •7. Пример разработки системы, основанной на знаниях ................................….226

- •8. Представление данных и знаний в Интернете...................................................257

- •9. Интеллектуальные Интернет-технологии..........................................................300

- •1. Введение в интеллектуальные системы

- •1.1. Краткая история искусственного интеллекта

- •1.1.1. Предыстория

- •1.1.2. Зарождение нейрокибернетики

- •1.1.3. От кибернетики «черного ящика» к ии

- •1.1.4. История искусственного интеллекта в России

- •1.2. Основные направления исследований в области искусственного интеллекта

- •1.2.1. Представление знаний и разработка систем, основанных на знаниях (knowledge-based systems)

- •1.2.2. Программное обеспечение систем ии (software engineering for Al)

- •1.2.3. Разработка естественно-языковых интерфейсов и машинный перевод (natural language processing)

- •1.2.4. Интеллектуальные роботы (robotics)

- •1.2.5. Обучение и самообучение (machine learning)

- •1.2.6. Распознавание образов (pattern recognition)

- •1.2.7. Новые архитектуры компьютеров (new hardware platforms and architectures)

- •1.2.8. Игры и машинное творчество

- •1.2.9. Другие направления

- •1.3. Представление знаний и вывод на знаниях

- •1.3.1. Данные и знания

- •1.3.2. Модели представления знаний

- •1.3.3. Вывод на знаниях

- •1.4. Нечеткие знания

- •1.4.1. Основы теории нечетких множеств

- •123456789 10 Рис. 1.7. Формирование нечетких множеств

- •1.4.2. Операции с нечеткими знаниями

- •1.5. Прикладные интеллектуальные системы

- •2. Разработка систем, основанных на знаниях

- •2.1. Введение в экспертные системы. Определение и структура

- •2.2. Классификация систем, основанных на знаниях

- •2.2.1. Классификация по решаемой задаче

- •2.2.2. Классификация по связи с реальным временем

- •2.2.3. Классификация по типу эвм

- •2.2.4. Классификация по степени интеграции с другими программами

- •2.3. Коллектив разработчиков

- •2.4. Технология проектирования и разработки

- •2.4.1. Проблемы разработки промышленных эс

- •2.4.2. Выбор подходящей проблемы

- •2.4.3. Технология быстрого прототипирования

- •2.4.4. Развитие прототипа до промышленной эс

- •2.4.5. Оценка системы

- •2.4.6. Стыковка системы

- •2.4.7. Поддержка системы

- •3. Теоретические аспекты инженерии знаний

- •3.1. Поле знаний

- •3.1.1. О языке описания поля знаний

- •3.1.2. Семиотическая модель поля знаний

- •3.1.3. «Пирамида» знаний

- •3.2. Стратегии получения знаний

- •3.3. Теоретические аспекты извлечения знаний

- •3.3.1. Психологический аспект

- •3.3.2. Лингвистический аспект

- •3.3.3. Гносеологический аспект извлечения знаний

- •3.4. Теоретические аспекты структурирования знаний

- •3.4.1. Историческая справка

- •3.4.2. Иерархический подход

- •3.4.3. Традиционные методологии структурирования

- •3.4.4. Объектно-структурный подход (осп)

- •4. Технологии инженерии знаний

- •4.1. Классификация методов практического извлечения знаний

- •4.2. Коммуникативные методы

- •4.2.1. Пассивные методы

- •4.2.2. Активные индивидуальные методы

- •4.2.3. Активные групповые методы

- •4.3. Текстологические методы

- •4.4. Простейшие методы структурирования

- •4.4.1. Алгоритм для «чайников»

- •4.4.2. Специальные методы структурирования

- •4.5. Состояние и перспективы автоматизированного приобретения знаний

- •4.5.1. Эволюция систем приобретения знаний

- •4.5.2. Современное состояние

- •4.6. Примеры методов и систем приобретения знаний

- •4.6.1. Автоматизированное структурированное интервью

- •4.6.2. Имитация консультаций

- •4.6.3. Интегрированные среды приобретения знаний

- •4.6.4. Приобретение знаний из текстов

- •5. Новые тенденции и прикладные аспекты инженерии знаний

- •5.1. Латентные структуры знаний и психосемантика

- •5.1.1. Семантические пространства

- •5.1.2. Методы многомерного шкалирования

- •5.1.3. Использование метафор для выявления «скрытых» структур знаний

- •5.2. Метод репертуарных решеток

- •5.2.1. Основные понятия

- •5.2.2. Методы выявления конструктов Метод минимального контекста

- •5.2.3. Анализ репертуарных решеток

- •5.2.4. Автоматизированные методы

- •5.3. Управление знаниями

- •5.3.1. Что такое «управление знаниями»

- •5.3.2. Управление знаниям и корпоративная память

- •5.3.3. Системы omis

- •5.3.4. Особенности разработки omis

- •5.4. Визуальное проектирование баз знаний как инструмент познания

- •5.4.1. От понятийных карт к семантическим сетям

- •5.4.2. База знаний как познавательный инструмент

- •5.5. Проектирование гипермедиа бд и адаптивных обучающих систем

- •5.5.1. Гипертекстовые системы

- •5.5.2. От мультимедиа к гипермедиа

- •5.5.3. На пути к адаптивным обучающим системам

- •6. Программный инструментарий разработки систем, основанных на знаниях

- •6.1. Технологии разработки программного обеспечения - цели, принципы, парадигмы

- •6.1.1. Основные понятия процесса разработки программного обеспечения (по)

- •6.1.2. Модели процесса разработки по

- •6.1.3. Инструментальные средства поддержки разработки систем по

- •6.2. Методологии создания и модели

- •6.3. Языки программирования для ии и языки представления знаний

- •6.4. Инструментальные пакеты для ии

- •6.5. WorkBench-системы

- •7. Пример разработки системы, основанной на знаниях

- •7.1. Продукционно-фреймовый япз pilot/2

- •7.1.1. Структура пилот-программ и управление выводом

- •7.1.2. Декларативное представление данных и знаний

- •7.1.3. Процедурные средства языка

- •7.2. Психодиагностика – пример предметной области для построения экспертных систем

- •7.2.1. Особенности предметной области

- •7.2.2. Батарея психодиагностических эс «Ориентир»

- •7.3. Разработка и реализация

- •7.3.1. Архитектура системы и ее база знаний

- •7.3.2. Общение с пользователем и опрос испытуемых

- •7.3.3. Вывод портретов и генерация их текстовых представлений

- •7.3.4. Помощь и объяснения в эс «Cattell»

- •8. Представление данных и знаний в Интернете

- •8.1. Язык html и представление знаний 8.1.1. Историческая справка

- •8.1.2. Html - язык гипертекстовой разметки Интернет-документов

- •8.1.3. Возможности представления знаний на базе языка html

- •8.2. Онтологии и онтологические системы

- •8.2.1. Основные определения

- •8.2.2. Модели онтологии и онтологической системы

- •8.2.3. Методологии создания и «жизненный цикл» онтологий

- •8.2.4. Примеры онтологий

- •8.3. Системы и средства представления онтологических знаний

- •8.3.1. Основные подходы

- •8.3.2. Инициатива (ка)2 и инструментарий Ontobroker

- •Средства спецификации онтологий в проекте Ontobroker

- •Формализм запросов

- •Формализм представления и машина вывода

- •Аннотация Web-страниц онтологической информацией

- •8.3.3. Проект shoe - спецификация онтологий и инструментарий Общая характеристика проекта

- •Спецификации онтологий и инструментарий shoe

- •Формализм представления и машина вывода

- •Аннотация Web-документов на базе онтологии

- •Формализм запросов

- •8.3.4. Другие подходы и тенденции

- •9. Интеллектуальные Интернет-технологии

- •9.1. Программные агенты и мультиагентные системы

- •9.1.1. Историческая справка

- •9.1.2. Основные понятия

- •9.2. Проектирование и реализация агентов и мультиагентных систем

- •9.2.1. Общие вопросы проектирования агентов и mac

- •9.2.2. Инструментарий AgentBuilder

- •9.2.3. Система Bee-gent

- •9.3. Информационный поиск в среде Интернет

- •9.3.1. Машины поиска

- •9.3.2. Неспециализированные и специализированные поисковые агенты

- •9.3.3. Системы интеллектуальных поисковых агентов

- •Autonomy и Web compass - системы интеллектуального поиска и обработки информации

- •Проект системы marri

- •Прототип системы OntoSeek

- •(Onto)2 - агент поиска и выбора онтологий

9.3. Информационный поиск в среде Интернет

По-видимому, не будет большим преувеличением утверждение о том, что конец XX века - это время новых информационных технологий, «живущих» в глобальных и локальных сетях, наиболее яркими представителями, которых являются Интернет и интранет. В настоящее время уже ни у кого нет сомнений в том, что Интернет является de facto всемирным хранилищем информации практически по всем аспектам жизни человечества. Так же как и то, что эффективный доступ к этой информации в связи с экспоненциальным ростом объема Интернет-ресурсов становится все более сложным и трудоемким [Cowie et al., 1996]. И не столько с технической точки зрения, сколько с точки зрения поиска и анализа информации.

С другой стороны, как уже отмечалось в предыдущем параграфе, важнейшими из областей практического использования агентных технологий являются сбор информации, ее фильтрация и использование для принятия решений.

Учитывая вышесказанное, цель данного параграфа в обсуждении проблем представления и обработки информации в сети Интернет на основе использования парадигмы многоагентных систем, а также обзор уже существующих в этой области приложений.

Авторы отдают себе отчет, что при этом за рамками такого обсуждения остаются многие важные применения агентных технологий, но вынуждены ограничиться данной тематикой в силу ограничений на объем данного издания и время его подготовки.

9.3.1. Машины поиска

Пространство WWW уже сегодня содержит огромное количество HTML-документов, причем не только тексты, но и графику, видео, звук и т. д. Гипертекстовые связи между Web-документами и/или их частями отражают отношения между отдельными информационными фрагментами, представленными в сети. Броузеры, поддерживающие HTML-стандарты, обеспечивают представление материалов пользователям и навигацию по ссылкам для доступа к документам, распределенным по сети. Однако поиск информации в настоящее время поддержан существенно слабее и в большинстве случаев базируется на использовании ключевых слов и ограниченного числа типов машин поиска.

Машины поиска, по-видимому, являются в Интернете самым распространенным и доступным ресурсом для извлечения информации. При этом, как правило, используются два типа сетевых роботов: спайдеры (spiders) и индексы (indexes). Спайдеры, иногда называемые также ботами (bots, от робот-robots), перемещаются по Web от сайта к сайту. Некоторые из них перемещаются от сервера к серверу беспорядочно, другие используют приоритеты, такие, например, как посещаемость сайта. Оказавшись на сайте, спайдер посылает отчет поисковой машине и продолжает индексирование. Индексы используются для ускорения поиска и сбора информации. Некоторые поисковые механизмы индексируют содержание страниц полностью, другие - только отдельные их части, такие, например, как заголовки документов.

Основными характеристиками машин поиска являются язык запросов пользователя, представление исходных и выходных документов, время индексации и поиска, объем индекса. Существенной характеристикой машин поиска является также качество представления результатов. Наиболее популярные поисковые машины в настоящее время - AltaVista (http://www.altavista.com и/или http: //altavista.ru), Exite (http://www.excite.com), Infoseek (http://www.infoseek. com), Lycos (http://www.lycos.com), WebCrawler (http://www.webcrawler. com), Yahoo! (http://www.yahoo.com) и некоторые другие. Примером полнотекстовой системы поиска с учетом морфологии русского языка является система Яndex (http://www.yandex.ru). Сравнительный анализ достоинств и недостатков машин поиска можно найти в работе [CompTek, 2000a], а русскоязычных машин поиска - в работе [CompTek, 2000b].

Как правило, поисковые машины обеспечивают интерфейс типа меню, с помощью которого пользователь может скомпоновать запрос на поиск информации, используя ключевые слова и/или фразы и логические связки И-ИЛИ-НЕ. Большинство машин поиска находят огромное количество «релевантных» страниц по запросу пользователя. Каждый найденный документ обычно ранжируется по степени его корреляции с запросом. Релевантность каждого документа оценивается с помощью различных технологий, например учета частоты появления на странице искомых слов. Некоторые поисковые механизмы используют дополнительно другие факторы, такие как частота посещения страницы и/или близость расположения друг к другу искомых терминов.

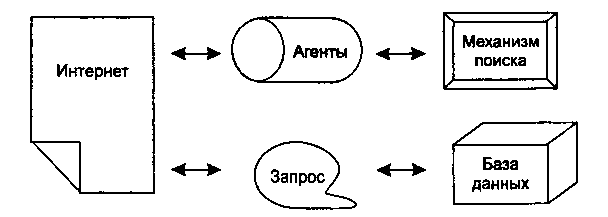

Типичную организацию машин поиска можно рассмотреть на примере системы WebCrawler (рис. 9.6), разработанной в университете Вашингтон (Сиэтл, США).

Рис. 9.6. Общая архитектура системы WebCrawler

WebCrawler начинает процесс поиска новых сайтов с известных ему документов и переходит по ссылкам на другие страницы. Он рассматривает сетевое пространство как ориентированный граф и использует алгоритм обхода графа, работая в следующем цикле [Cheong, 1996]:

• найти новый документ;

• отметить документ как извлеченный;

♦ расшифровать ссылки с этого документа;

♦ проиндексировать содержание документа.

Поисковый механизм работает в двух режимах: поиск документов в реальном времени и индексирование документов.

Этим сервисом определяется, какие документы и какие типы документов нужно найти и извлечь из сети. Звуковые файлы, картинки, двоичные файлы и т. п. - не извлекаются. Ошибочно извлеченные файлы будут проигнорированы на стадии индексирования. В режиме индексирования система строит индекс информации из найденных документов, в режиме поиска - находит документы, максимально соответствующие запросу пользователя.

Агенты в системе WebCrawler отвечают за извлечение документов из сети. Для выполнения этой работы поисковый механизм находит свободного агента и передает ему задание на поиск. Агент приступает к работе и возвращает либо содержание документа, либо объяснение, почему данный документ нельзя доставить. Агенты запускаются как отдельные процессы, что позволяет изолировать основной процесс работы системы от ошибок и проблем с памятью. Одновременно используется до 15 агентов.

В базе данных хранятся метаданные документов, связи между документами, полнотекстовый индекс, другая служебная информация. База обновляется каждый раз, когда поступает новый документ. Для отсечения семантически незначимых слов используется стоп-словарь, словам из документа приписывается вес, равный частоте их появления в данном тексте, деленной на частоту появления слова в ссылках на другие документы. Такой индекс позволяет быстро находить по заданному слову ссылки на документы его содержащие. Целиком URL (ссылки на документы в сети) не запоминаются. Вместо этого вся нужная информация помещается в специальные объекты. Каждый объект запоминается в отдельном В-дереве: документы - в одном, серверы - в другом, а ссылки - в третьем. Такое разделение данных позволяет быстро определить неиспользуемые или часто используемые серверы.

Аналогичным образом устроены и другие машины поиска. Характеризуя их в целом, можно отметить, что это глобальные поисковые механизмы, охватывающие до 90 % ресурсов Интернета. Они не могут настраиваться на предпочтения пользователя и не имеют средств анализа информации, а их сетевым роботам становится все труднее справляться с постоянным ростом ресурсов Интернета. Главной задачей машин поиска, по сути, является индексация ресурсов глобальной сети, а также поддержка и расширение соответствующих баз данных. Фактически в базах данных машин поиска хранится информация о том, где и что лежит в сети. Поэтому можно считать, что существующие машины поиска обеспечивают низкоуровневый сервис для клиентских поисковых программ более высокого уровня.