- •Лекция 10. Способы представления исходной информации в интеллектуальных системах

- •10. 1 Обучение на основе примеров

- •10.2 Типы значений признаков:

- •10.3 Ранговая или порядковая шкала значений признаков

- •10.5 Выборка к-

- •10.6 Кластерный анализ

- •10.6.1 Пример процедуры кластерного анализа: .

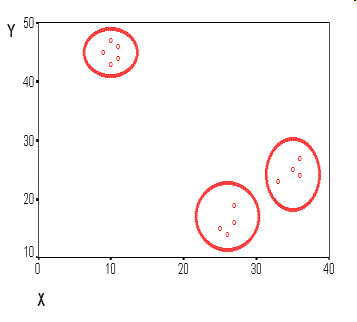

- •10.6.2 Диаграмма рассеивания

- •10.6.3 Способы определения меры расстояния между кластерами

- •10.6.4 Работа кластерного анализа опирается на два предположения.

- •10.6.5 Рассмотрим пример.

- •10.6.6 Способы нормирования исходных данных: .

- •10.6.9 Пример вертикальной дендрограммы

- •10.6.10 Методы объединения или связи

- •Метод ближнего соседа или одиночная связь.

- •Метод Варда (Ward's method).

- •Метод наиболее удаленных соседей или полная связь.

- •Метод невзвешенного попарного среднего

- •Метод взвешенного попарного среднего

- •Невзвешенный центроидный метод

- •10.7 Задача обучения «без учителя»

- •10.8 Алгоритм, основанный на понятии порогового расстояния

- •10.8.1 Пример работы алгоритма, основанного на вычислении порогового расстояния.

- •Лекция 11. Алгоритмы обучения без учителя

- •11.1 Алгоритм maxmin

- •11.2 Алгоритм «к средних»

- •11.2.1 Пример работы алгоритма «к средних»

- •11.2.2 Проблемы алгоритма k-средних:

- •11.9. 1 Метод эталонных образов

- •11.9.2 Метод эталонных образов

- •13.2 Программированное обучение. Автор б.Ф. Скиннер

- •13.3 Основные формы программирования

- •13.3.1 Линейная программа

- •13.3.2 Разветвленная форма. Норман а. Кроудер

- •13.4 Автоматизация программированного обучения

- •13.5 Искусственный интеллект

- •13.6 Задача-максимум создания Искусственного Интеллекта

- •13.7 Автоматизированная обучающая система «Контакт»

- •13.8 Аос эвос и атос

- •13.9 Аос садко

- •13.10 Plato

- •13.11 В общем об обучающих системах

- •13.12 Интеллектуальные обучающие системы (иос)

- •13.12.1 Четыре этапа развития иос

- •13.12.2 Принципы организации и реализации интеллектуальных систем электронного обучения

- •13.13. 1 Особенности Образования Web 2.0 или Образования 2.0

- •13.14 Семантический Web (Web 3.0)

- •13.14. 1 Основыне принципы Образования 3.0

- •13.15 Иос на осве субз

- •13.16 Алгоритм муравья

- •13.17 Модель обучения в общем виде

- •13.18 Этапы создания иос от специалистов

- •13.19 Состав группы для разработки иос

10.2 Типы значений признаков:

Значения, которые могут принимать признаки объекта, относятся к трем основным типам:

количественные или числовые,

качественные

шкалированные.

В случае числовых признаков на множестве значений признаков может быть введена метрика, позволяющая дать количественную оценку значения признака. Часто такие значения являются результатом измерений физических величин, таких, как длина, вес, температура и др.

10.3 Ранговая или порядковая шкала значений признаков

В случае, если признаки могут иметь качественный характер, но при этом их значения можно упорядочить друг относительно друга, говорят, что такие значения образуют ранговую или порядковую шкалу.

Примерами таких шкал порядка могут быть ряды типа {большой, средний, маленький} или {горячий, теплый, холодный}. С помощью таких шкал порядка можно судить, какой из двух объектов является наилучшим, но нельзя оценить, сколь близки или далеки эти объекты по некоторому критерию.

Третий случай заключается в том, что значения признаков имеют чисто качественный характер, связать эти значения между собой не удается. Примерами таких значений могут быть цвет = {красный, желтый, зеленый} или материал = {стекло, дерево, пластмасса, железо}.

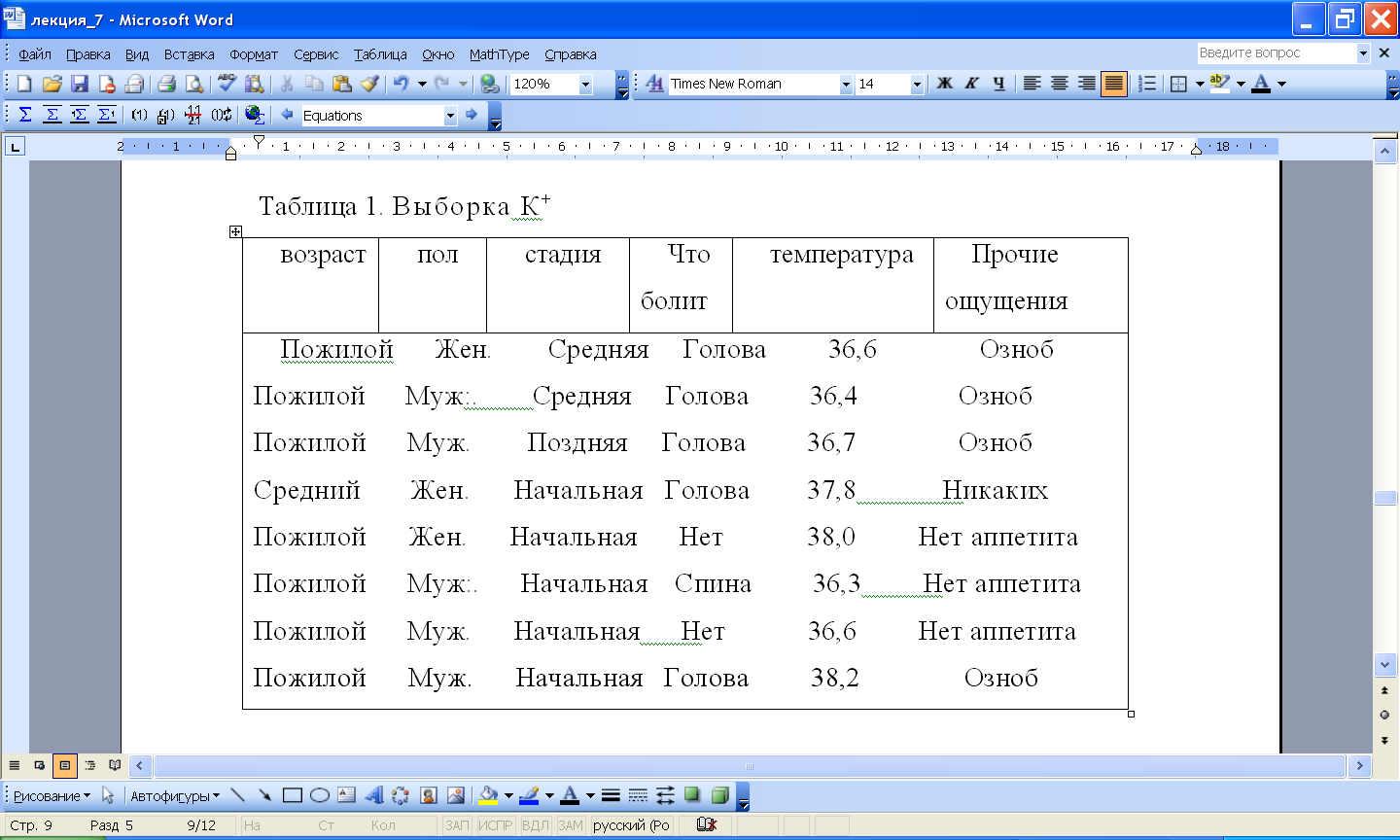

10. 4 Выборка К+

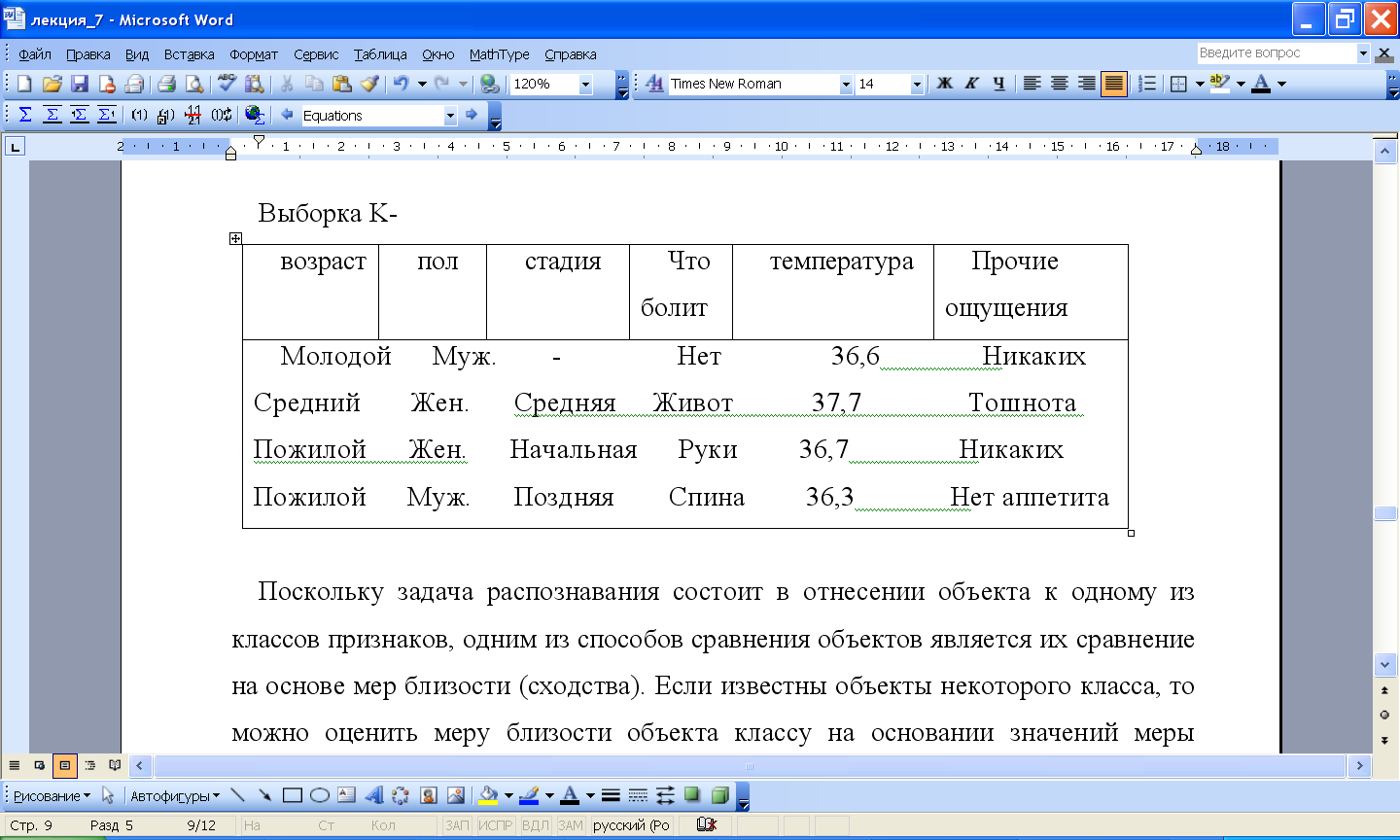

10.5 Выборка к-

10.6 Кластерный анализ

Термин кластерный анализ, впервые введенный Трионом (Tryon) в 1939 году, включает в себя более 100 различных алгоритмов.

В отличие от задач классификации, кластерный анализ не требует априорных предположений о наборе данных, не накладывает ограничения на представление исследуемых объектов, позволяет анализировать показатели различных типов данных (интервальным данным, частотам, бинарным данным). При этом необходимо помнить, что переменные должны измеряться в сравнимых шкалах.

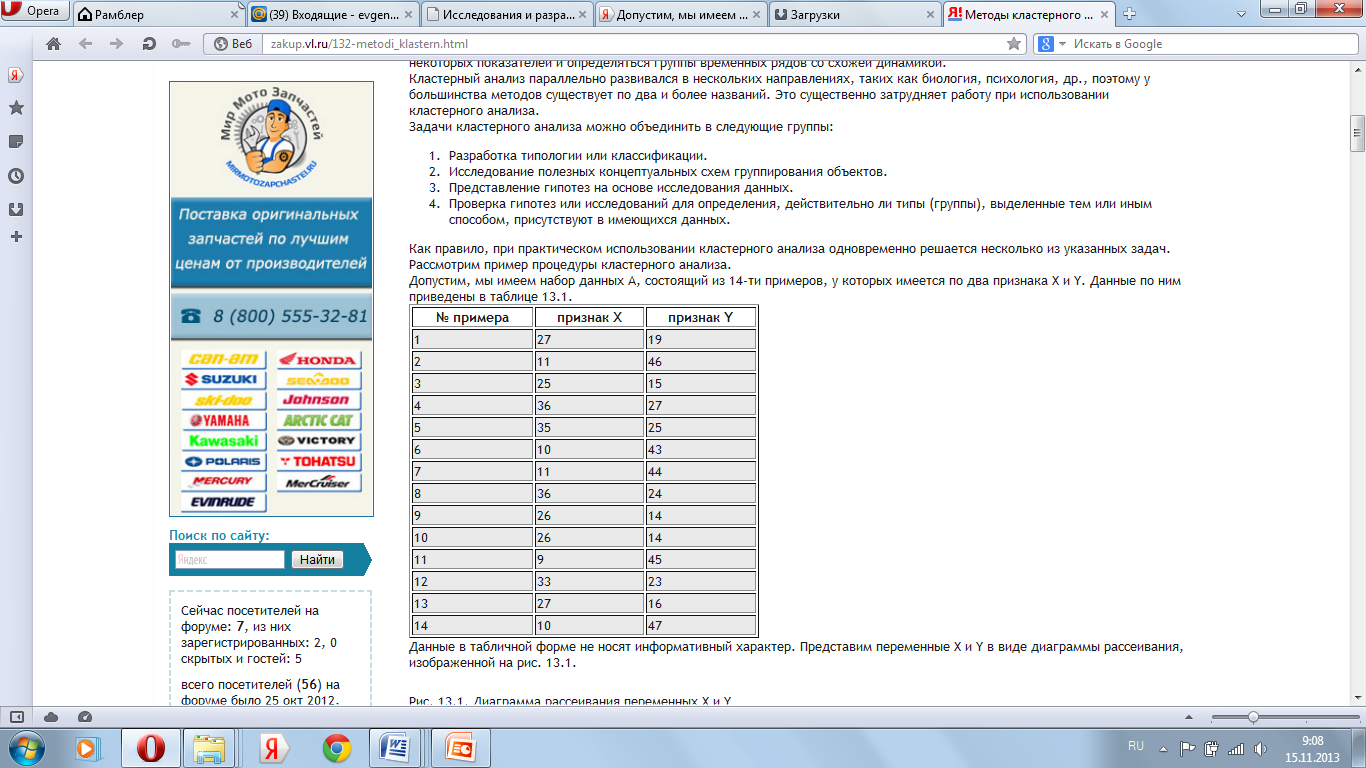

10.6.1 Пример процедуры кластерного анализа: .

Допустим, мы имеем набор данных А, состоящий из 14-ти примеров, у которых имеется по два признака X и Y. Данные по ним приведены в таблице.

Данные в табличной форме не носят информативный характер. Представим переменные X и Y в виде диаграммы рассеивания

10.6.2 Диаграмма рассеивания

На рисунке мы видим несколько групп "похожих" примеров. Примеры (объекты), которые по значениям X и Y "похожи" друг на друга, принадлежат к одной группе (кластеру); объекты из разных кластеров не похожи друг на друга.

Критерием для определения схожести и различия кластеров является расстояние между точками на диаграмме рассеивания. Это сходство можно "измерить", оно равно расстоянию между точками на графике. Способов определения меры расстояния между кластерами, называемой еще мерой близости, существует несколько.

10.6.3 Способы определения меры расстояния между кластерами

Наиболее распространенный способ - вычисление евклидова расстояния между двумя точками i и j на плоскости, когда известны их координаты X и Y:

![]()

Кластер имеет следующие математические характеристики:

- центр,

- радиус,

- среднеквадратическое отклонение,

- размер кластера.

Центр кластера - это среднее геометрическое место точек в пространстве переменных.

Радиус кластера - максимальное расстояние точек от центра кластера.

Кластеры могут быть перекрывающимися. Такая ситуация возникает, когда обнаруживается перекрытие кластеров. В этом случае невозможно при помощи математических процедур однозначно отнести объект к одному из двух кластеров. Такие объекты называют спорными.

Спорный объект - это объект, который по мере сходства может быть отнесен к нескольким кластерам.

Размер кластера может быть определен либо по радиусу кластера, либо по среднеквадратичному отклонению объектов для этого кластера. Объект относится к кластеру, если расстояние от объекта до центра кластера меньше радиуса кластера. Если это условие выполняется для двух и более кластеров, объект является спорным.

Неоднозначность данной задачи может быть устранена экспертом или аналитиком.