- •Предисловие

- •Введение

- •Концептуальные основы информационных процессов.

- •О понятии «Информация» [1,2]

- •1.2. Виды и свойства информации [2].

- •1.3. Этапы обращения информации [1].

- •1.4. Информационные системы [1].

- •1.5. Система передачи информации [1].

- •1.6. Уровни проблем передачи информации [1].

- •1.7. О смысле «Теории информации» в системе связи [1].

- •2. Математические основы теории вероятностей [6,4].

- •2.1. Случайное событие и вероятность.

- •2.2 Случайные величины и их вероятностные характеристики.

- •Случайные функции и их вероятностное описание.

- •2.4 Корреляционные характеристики случайных процессов.

- •Дифференциальный; 2) интегральный;

- •3) Плотность вероятностей.

- •Дифференциальный; 2) интегральный; 3) числовой.

- •Свойства энтропии [1,3 и др.].

- •Условная энтропия и ее свойства [1,2 и др.].

- •Свойства условной энтропии

- •Энтропия непрерывного источника информации (дифференциальная энтропия) [1, 2 и др.].

- •Передача информации от дискретного источника [1 и др.].

- •Передача информации от непрерывного источника [1 и др.].

- •Основные свойства количества информации [1 и др.].

- •4. Информационные характеристики источника сообщений и канала связи.

- •4.1. Введение [1 и др.].

- •4.2. Информационные характеристики источника дискретных сообщений.

- •4.2.1 Модели источника дискретных сообщений [1 и др.].

- •4.2.2 Свойства эргодических последовательностей знаков [1 и др.].

- •4.2.3 Избыточность источника [1 и др.].

- •4.2.4 Производительность источника дискретных сообщений [1 и др.].

- •4.3. Информационные характеристики дискретных каналов связи.

- •4.3.1 Модели дискретных каналов [1, 4, 5 и др.].

- •Скорость передачи информации по дискретному каналу [1 и др.].

- •Пропускная способность дискретного канала без помех [1 и др.].

- •Пропускная способность дискретного канала с помехами [1 и др.].

- •Информационные характеристики непрерывных каналов связи [1 и др.].

- •Согласование физических характеристик сигнала и канала [1 и др.].

- •Согласование статистических свойств источника сообщений и канала связи [1 и др.].

- •4.6 Контрольные вопросы к разделам 3 и 4 в форме «Задание – тест» тема: «Количественная оценка информации».

- •1) Бод; 2) бит (двоичная цифра); 3) байт.

- •1) Сумма; 2) произведение; 3) разность.

- •1) Безусловной энтропией; 2) условной энтропией;

- •3) Совместной энтропией.

- •1) Объем алфавита;

- •2) Объем алфавита и вероятности создания источником отдельных знаков; 3) вероятности создания источником отдельных знаков.

- •1) Нестационарным; 2) стационарным; 3) постоянным.

- •1) Нестационарным; 2) стационарным; 3) постоянным.

- •1) С памятью; 2) без памяти; 3) регулярный.

- •1) С памятью; 2) без памяти; 3) регулярный.

- •1) Симметричный; 2) несимметричный; 3) условный.

- •1) Симметричный; 2) несимметричный; 3) условный.

- •1) Максимальная скорость; 2) пропускная скорость; 3) предел скорости.

- •1) Уменьшается; 2) увеличивается; 3) не изменяется.

- •1) Уменьшается; 2) увеличивается; 3) не изменяется.

- •5.2. Классификация кодов [4 и др.].

- •5.3. Представление кодов [4 и др.].

- •5.4. Оптимальное (эффективное) статистическое кодирование [3 и др.].

- •5.4.1 Методы эффективного кодирования некоррелированной последовательности знаков [1 и др.].

- •Методика построения кода Шеннона – Фано [1].

- •Методика построения кода Хаффмена [2 и др.].

- •5.4.2 Свойство префиксности эффективных кодов [1 и др.].

- •5.4.3 Методы эффективного кодирования коррелированной последовательности знаков.

- •5.4.4 Недостатки системы эффективного кодирования.

- •1) Номер разряда;

- •2) Множитель, принимающий целочисленные значения;

- •3) Количество разрядов.

- •Всякий блочный код можно представить таблицей:

- •Всякий блочный код можно представить таблицей:

- •Литература:

- •Содержание

Пропускная способность дискретного канала с помехами [1 и др.].

При наличии помех соответствие между множествами символов на входе и выходе канала связи перестает быть однозначным. Среднее количество информации I(S, Z), передаваемое по каналу одним символом, определяется в этом случае соотношением

![]() (4.12)

(4.12)

Если статистические связи между символами отсутствуют, энтропия сигнала на выходе линии связи равна

![]() (4.13)

(4.13)

При наличии статистической связи энтропию определяют с использованием цепей Маркова. Поскольку алгоритм такого определения ясен и нет необходимости усложнять изложение громоздкими формулами, ограничимся здесь только случаем отсутствия связей.

Апостериорная энтропия характеризует уменьшение количества переданной информации вследствие возникновения ошибок. Она зависит как от статистических свойств последовательностей символов, поступающих на вход канала связи, так и от совокупности переходных вероятностей, отражающих вредное действие помехи.

Если объем алфавита входных символов Z равен m1, а выходных символов S – m2, то

![]() (4.14)

(4.14)

Подставив выражения (4.13) и (4.14) в (4.12) и проведя несложные преобразования, получим среднее количество информации

(4.15)

(4.15)

Скорость передачи информации по каналу с помехами

(4.16)

(4.16)

Считая скорость манипуляции VT предельно допустимой при заданных технических характеристиках канала, величину I(S,Z) можно максимизировать, изменяя статистические свойства последовательностей символов на входе канала посредством преобразователя (кодера канала). Получаемое при этом предельное значение CД скорости передачи информации по каналу называют пропускной способностью дискретного канала связи с помехами:

![]() (4.17)

(4.17)

где p(z) – множества возможных распределений вероятностей входных сигналов.

Важно подчеркнуть, что при наличии помех пропускная способность канала определяет наибольшее количество информации в единицу времени, которое может быть передано со сколь угодно малой вероятностью ошибки.

Показано [6], что к пропускной способности канала связи с помехами можно приблизиться, кодируя эргодическую последовательность букв источника сообщений блоками такой длины, при которой справедлива теорема об асимптотической равновероятности длинных последовательностей.

Произвольно малая вероятность ошибки оказывается достижимой только в пределе, когда длина блоков становится бесконечной.

При удлинении кодируемых блоков возрастает сложность технической реализации кодирующих и декодирующих устройств и задержка в передаче сообщений, обусловленная необходимостью накопления требуемого числа букв в блоке. В рамках допустимых усложнений на практике при кодировании могут преследоваться две цели: либо при заданной скорости передачи информации стремятся обеспечить минимальную ошибку, либо при заданной достоверности – скорости передачи, приближающуюся к пропускной способности канала.

Предельные возможности канала никогда не используются полностью. Степень его загрузки характеризуется коэффициентом использования канала

![]() ,

(4.18)

,

(4.18)

где Ru(Z) – производительность источника сообщений; СД – пропускная способность канала связи.

Поскольку нормальное функционирование канала возможно, как показано далее, при изменении производительности источника в пределах 0≤ Ru(Z)≤ СД, λ теоретически может изменятся в пределах от 0 до 1.

Пример 4.4 Определить пропускную способность двоичного симметричного канала (ДСК) со скоростью манипуляции VT в предположении независимости передаваемых символов.

Запишем соотношение (4.14) в следующем виде:

![]()

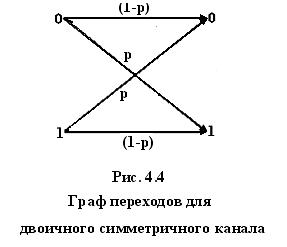

Воспользовавшись обозначениями на графе (рис. 4.4), можем записать

Так как p(0) + p(1) =1, то

![]()

Величина H(Z|S) не зависит от вероятностей входных символов, что является следствием симметрии канала.

Следовательно, пропускная способность

![]()

Максимум H(Z) достигается при равенстве вероятностей появления символов, он равен 1. Отсюда

![]() (4.19)

(4.19)

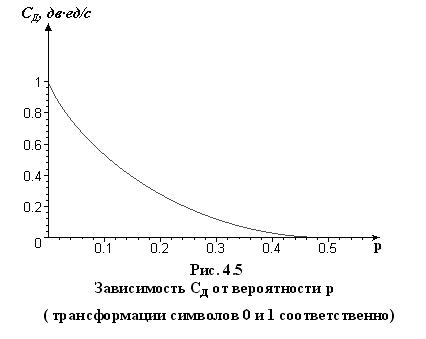

График зависимости пропускной способности ДСК от p показан на рис. 4.5. При увеличении вероятности трансформации символа с 0 до ½ СД(p) уменьшится от 1 до 0. Если p=0, то шум в канале отсутствует и его пропускная способность равна 1. При p=1/2 канал бесполезен, так как значения символов на приемной стороне с равным успехом можно устанавливать по результатам подбрасывания монеты (герб – 1, решетка – 0). Пропускная способность канала при этом равна нулю.