- •Предисловие

- •Введение

- •Концептуальные основы информационных процессов.

- •О понятии «Информация» [1,2]

- •1.2. Виды и свойства информации [2].

- •1.3. Этапы обращения информации [1].

- •1.4. Информационные системы [1].

- •1.5. Система передачи информации [1].

- •1.6. Уровни проблем передачи информации [1].

- •1.7. О смысле «Теории информации» в системе связи [1].

- •2. Математические основы теории вероятностей [6,4].

- •2.1. Случайное событие и вероятность.

- •2.2 Случайные величины и их вероятностные характеристики.

- •Случайные функции и их вероятностное описание.

- •2.4 Корреляционные характеристики случайных процессов.

- •Дифференциальный; 2) интегральный;

- •3) Плотность вероятностей.

- •Дифференциальный; 2) интегральный; 3) числовой.

- •Свойства энтропии [1,3 и др.].

- •Условная энтропия и ее свойства [1,2 и др.].

- •Свойства условной энтропии

- •Энтропия непрерывного источника информации (дифференциальная энтропия) [1, 2 и др.].

- •Передача информации от дискретного источника [1 и др.].

- •Передача информации от непрерывного источника [1 и др.].

- •Основные свойства количества информации [1 и др.].

- •4. Информационные характеристики источника сообщений и канала связи.

- •4.1. Введение [1 и др.].

- •4.2. Информационные характеристики источника дискретных сообщений.

- •4.2.1 Модели источника дискретных сообщений [1 и др.].

- •4.2.2 Свойства эргодических последовательностей знаков [1 и др.].

- •4.2.3 Избыточность источника [1 и др.].

- •4.2.4 Производительность источника дискретных сообщений [1 и др.].

- •4.3. Информационные характеристики дискретных каналов связи.

- •4.3.1 Модели дискретных каналов [1, 4, 5 и др.].

- •Скорость передачи информации по дискретному каналу [1 и др.].

- •Пропускная способность дискретного канала без помех [1 и др.].

- •Пропускная способность дискретного канала с помехами [1 и др.].

- •Информационные характеристики непрерывных каналов связи [1 и др.].

- •Согласование физических характеристик сигнала и канала [1 и др.].

- •Согласование статистических свойств источника сообщений и канала связи [1 и др.].

- •4.6 Контрольные вопросы к разделам 3 и 4 в форме «Задание – тест» тема: «Количественная оценка информации».

- •1) Бод; 2) бит (двоичная цифра); 3) байт.

- •1) Сумма; 2) произведение; 3) разность.

- •1) Безусловной энтропией; 2) условной энтропией;

- •3) Совместной энтропией.

- •1) Объем алфавита;

- •2) Объем алфавита и вероятности создания источником отдельных знаков; 3) вероятности создания источником отдельных знаков.

- •1) Нестационарным; 2) стационарным; 3) постоянным.

- •1) Нестационарным; 2) стационарным; 3) постоянным.

- •1) С памятью; 2) без памяти; 3) регулярный.

- •1) С памятью; 2) без памяти; 3) регулярный.

- •1) Симметричный; 2) несимметричный; 3) условный.

- •1) Симметричный; 2) несимметричный; 3) условный.

- •1) Максимальная скорость; 2) пропускная скорость; 3) предел скорости.

- •1) Уменьшается; 2) увеличивается; 3) не изменяется.

- •1) Уменьшается; 2) увеличивается; 3) не изменяется.

- •5.2. Классификация кодов [4 и др.].

- •5.3. Представление кодов [4 и др.].

- •5.4. Оптимальное (эффективное) статистическое кодирование [3 и др.].

- •5.4.1 Методы эффективного кодирования некоррелированной последовательности знаков [1 и др.].

- •Методика построения кода Шеннона – Фано [1].

- •Методика построения кода Хаффмена [2 и др.].

- •5.4.2 Свойство префиксности эффективных кодов [1 и др.].

- •5.4.3 Методы эффективного кодирования коррелированной последовательности знаков.

- •5.4.4 Недостатки системы эффективного кодирования.

- •1) Номер разряда;

- •2) Множитель, принимающий целочисленные значения;

- •3) Количество разрядов.

- •Всякий блочный код можно представить таблицей:

- •Всякий блочный код можно представить таблицей:

- •Литература:

- •Содержание

4.2.4 Производительность источника дискретных сообщений [1 и др.].

Под производительностью источника сообщений подразумевают количество информации, вырабатываемое источником в единицу времени. Эту характеристику источника называют также скоростью создания сообщений или потоком входной информации. Поскольку возможное воздействие помех на источник сообщений принято учитывать эквивалентным изменением характеристик модели канала связи, то производительность источника сообщений равна энтропии источника, приходящейся на единицу времени.

Длительность выдачи знаков источником в каждом из состояний в общем случае может быть различной. Обозначим длительность выдачи знака zi, формируемого источником в состоянии Sq, через τqzi. Тогда средняя длительность выдачи источником одного знака

![]() (4.5)

(4.5)

Производительность источника Rи(z) теперь можно выразить формулой

![]() (4.6)

(4.6)

Как следует из (4.5), повышение производительности источника возможно не только за счет увеличения энтропии, но и за счет снижения средней длительности формирования знака. Длительность знаков желательно выбирать обратно пропорциональными вероятностям их появления.

Если длительность выдачи знака не зависит от состояния источника, для всех знаков одинакова и равна τ, то τи=τ. Выражение для Rи(z) принимает вид

![]() (4.7)

(4.7)

Наибольшая производительность источника в этом случае достигается при максимальной энтропии.

4.3. Информационные характеристики дискретных каналов связи.

4.3.1 Модели дискретных каналов [1, 4, 5 и др.].

Дискретным каналом называют совокупность средств, предназначенных для передачи дискретных сигналов. Такие каналы широко используются, например, при передачи данных, в телеграфии, радиолокации.

Дискретные сообщения, состоящие из последовательности знаков алфавита источника сообщений (первичного алфавита) z1, z2, …, zl, преобразуются в кодирующем устройстве в последовательность символов. Объем m алфавита символов (вторичного алфавита) u1, u2, …, um, как правило, меньше объема l алфавита знаков, но они могут и совпадать.

Материальным воплощением символа является элементарный сигнал, получаемый в процессе манипуляции – дискретного изменения определенного параметра переносчика информации. Элементарные сигналы формируются с учетом физических ограничений, накладываемых конкретной линией связи. В результате манипуляции каждой последовательности символов ставится в соответствии сложный сигнал. Множество сложных сигналов конечно. Они различаются числом, составом и взаимным расположением элементарных сигналов.

Термины «элементарный сигнал» и «символ», так же как «сложный сигнал» и «последовательность символов», в дальнейшем будут использоваться как синонимы.

Информационная модель канала с помехами задается множеством символов на его входе и выходе и описанием вероятностных свойств передачи символов. В общем случае канал может иметь множество состояний и переходить из одного состояния в другое как с течением времени, так и в зависимости от последовательности передаваемых символов.

В каждом состоянии канал характеризуется матрицей условных вероятностей p(si/zi) того, что переданный символ zi будет воспринят на выходе как символ si. Значения вероятностей в реальных каналах зависят от многих различных факторов: свойств сигналов, являющихся физическими носителями символов (энергия, вид модуляции и т.д.), характер и интенсивность воздействующих на канал помех, способа определения сигнала на приемной стороне.

При наличии зависимости переходных вероятностей канала от времени, что характерно для всех реальных каналов, он называется нестационарным каналом связи. Если эта зависимость несущественна, используется модель в виде стационарного канала, переходные вероятности которого не зависят от времени. Нестационарный канал может быть представлен рядом стационарных каналов, соответствующих различным интервалам времени.

Канал называется с «памятью» (с последействием), если переходные вероятности в данном состоянии канала зависят от его предыдущих состояний. Если переходные вероятности постоянны, т.е. канал имеет только одно состояние, он называется стационарным каналом без памяти. Под k-ичным каналом подразумевается канал связи, у которого число различных символов на входе и выходе одинаково и равно k.

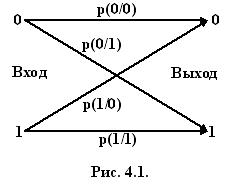

Стационарный дискретный двоичный канал без памяти однозначно определяется четырьмя условными вероятностями: p(0/0), p(1/0), p(0/1), p(1/1). Такую модель канала принято изображать в виде графа, представленного на рис. 4.1. где p(0/0) и p(1/1) – вероятности неискаженной передачи символов, а p(0/1) и p(1/0) – вероятности искажения (трансформация) символов 0 и 1 соответственно.

Граф – модель стационарного двоичного канала без памяти

Если вероятности искажения символов можно принять равными, т.е. p(0/1)≈p(1/0)=q, то такой канал называют двоичным симметричным каналом [при p(0/1)≠p(1/0) канала называется несимметричным]. Символы на его выходе правильно принимают с вероятностью p и неправильно – с вероятностью 1-p=q. Математическая модель упрощается.

Именно этот канал исследовался наиболее интенсивно не столько в силу своей практической значимости (многие реальные каналы описываются им весьма приближенно), сколько в силу простоты математического описания.

Важнейшие результаты, полученные для двоичного симметричного канала, распространены на более широкие классы каналов.

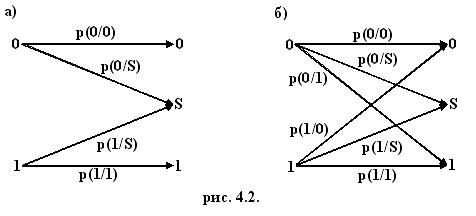

Следует отметить еще одну модель канала, которая в последнее время приобретает все большее значение. Это дискретный канал со стиранием. Для него характерно, что алфавит выходных символов отличается от алфавита входных сигналов. На входе, как и ранее, символы 0 и 1, а на выходе канала фиксируются состояния, при которых сигнал с равным основанием может быть отнесен как к единице, так и к нулю. На месте такого символа не ставится ни нуль, ни единица: состояние отмечается дополнительным символом стирания S. При декодировании значительно легче исправить такие символы, чем ошибочно определенные.

На рис. 4.2. приведены модели стирающего канала при отсутствии (рис. 4.2, а) и при наличии (рис. 4.2, б) трансформации символов.

Граф-модель стационарного двоичного канала без памяти со стиранием.