- •1.Коньюнкция условий и разбиение пространства входа.

- •Композиция нечетких отношений.

- •Нечеткое инверсное управление и нечеткая система управления с внутренней моделью

- •Алгоритм жесткой кластеризации.

- •Операции над нечеткими множествами. Модификаторы.

- •8. Проектирование нечетких контроллеров (метод Мамдани)

- •2. Нечеткий контроллер с двумя входами и одним выходом

- •9.Нечеткая система управления с плановым изменением коэффициента.

- •10. Оценка параметров заключений по (мнк)

- •11. Адаптивные нейронные нечеткие системы инференции (anfis)

- •12.Импликация Мамдани. Внешнее произведение.Таблица импликаци

- •13. Нечеткая идентификация. Структура и параметры.

- •14. Нечеткий логический вывод для нескольких правил и нескольких входов.

- •Несколько входов (многомерная лингвистическая модель)

- •16. Функциональная схема нечеткого контроллера

- •17. Отношения между нечеткими множествами

- •18. Алгоритм нечеткой кластеризации с-средних

- •19. Моделирование статических объектов упр-я как аппроксимация функций с помощью нейронных сетей (есть только для динамических объектов)((((((((

- •20. Анализ устойчивости тс модели объекта управления в пространстве состояний.

- •22. Нечеткий логический вывод с исп-м отношений. Пример

- •24. Визуализация алгоритма нечеткого логического вывода.

- •25. Понятия о нечетких множествах

- •26. Обучение нейронной сети. Общие сведения.

- •27. Упрощение алгоритма нечеткого логического вывода.

- •28. Обратное распространение ошибки

- •29. Визуализация нечеткого логического вывода.Аккумуляция.

- •30. Параметры алгоритма с-средних

- •31. Проектирование нечетких контроллеров (метод Мамдани)

- •32. Нечеткая логика. Логические связки.

- •33.Проектирование нечетких контроллеров(метод Мамдани). Многомерный нечеткий контроллер.

- •34. Алгоритм обучения anfis

- •35. Максиминная композиция нечетких отношений. Внутренне произведение. Пример.

- •36. Преобразование вход-выход. Кривая управления. Пов-ть управления.

- •37. Табличное изменение коэффициента усиления (супервизорное управление)

- •38. Алгоритм нечеткой кластеризации Густафсона–Кесселя.

- •39. Генетические алгоритмы

- •40. Извлечение правил с помощью кластеризации

- •41.Нечеткий сумматор для контроллеров с 2 входами и 1 выходом

- •42. Нейросетевое прямое и косвенное адаптивное управление с эталонной моделью

- •43. Обратное распространение ошибки. Обновление весовых коэф-в скрытых слоев. Локальные градиенты.

- •44. Модель Такаги-Сугено как квазилинейное устройство

- •45. Контроллер типа Такаги-Сугено

- •46. Нейросетевое управление с адаптивной линеаризацией обратной связью

- •48. Такаги-Сугено модель оу в пространстве состояний

- •49. Нечеткие множества. Синглтоны и лингвистические переменные.

- •50. Моделирование нелинейных динамических оу с помощью нейронных сетей

- •51. Структура интеллектуальной системы управления

- •52. Многослойная нейронная сеть

- •53. Дефаззификация. Методы дефаззификации.

- •54. Нейронная сеть с радиальными базисными функциями

- •56. Синтез нечеткой обратной связи

- •57. Линейные матричные неравенства, основные понятия.

- •58. Аппроксимация функций (моделирование) с помощью нейронных сетей (персептронов)

- •59. Классификация генетических нечетких систем

- •60. Синтез нейронных нечетких сетей. Структура anfis

- •19. Моделирование статических объектов управления как аппроксимация функций с помощью нейронных сетей.

- •Адаптивные нейронные нечеткие системы интерференции (anfis). . Синтез нечетких нейронных сетей

- •5.1. Введение

- •Адаптивные нейронечеткие системы инференции (anfis)

- •Импликация Мамдани. Внешнее произведение. Таблица импликации.

- •Нечеткая идентификация. Структура и параметры

- •Нечеткий логический вывод для нескольких правил и нескольких входов.

- •1. Настройка пид-регулятора

- •3. Перенос параметров пид-регулятора в нечеткий контроллер

- •Анализ устойчивости тс модели объекта управления в пространстве состояний. Анализ устойчивости тс модели объекта

- •1. Настройка пид-регулятора

- •Нечеткий логический вывод (инференция). Пример.

- •Визуализация нечеткого логического вывода. Агрегирование условий и активизация заключений.

- •Математическая модель нейрона. Математическая модель нейрона

- •Нечеткое управление с предсказанием.

- •Визуализация нечеткого логического вывода. Аккумуляция заключений.

- •5.1. Введение

- •Алгоритм обучения anfis

- •Максиминная композиция нечетких отношений. Внутреннее произведение. Пример.

- •Преобразование вход-выход для нечетких контроллеров. Кривая управления и поверхность управления.

- •2.4. Преобразование вход-выход

- •Табличное изменениекоэффициентаусиления (супервизорное управление).

- •2.8. Табличное изменение коэффициента усиления (супервизорное управление)

- •Алгоритм нечеткой кластеризации Густафсона-Кесселя.

- •Генетические алгоритмы. Генетические алгоритмы

- •Модель Такаги-Сугено как квазилинейное (аффинное) устройство. Модель Такаги-Сугено как квазилинейное устройство

- •Контроллер типа Такаги-Сугено.

- •Деффазификация. Методы деффазификации.

- •2.2.5. Дефаззификация

- •Теорема б универсальной аппроксимации.

- •Такаги-Сугено модель объекта управления в пространстве состояний.

- •Табличный контроллер. Билинейная интерполяция.

- •2.3. Табличный контроллер

- •Моделирование нелинейных динамических объектов управления с помощью нейронных сетей.

- •Моделирование нелинейных динамических процессов (объектов)

- •Упрощение алгоритма нечеткого логического вывода.

- •Обратное распространение ошибки. Обновление весовых коэффициентов выходного слоя.

- •4.6. Обратное распространение ошибки

- •Структура интеллектуальной системы управления.

- •Многослойная нейронная сеть. Многослойная нейронная сеть

- •5.1. Введение

- •Структура anfis

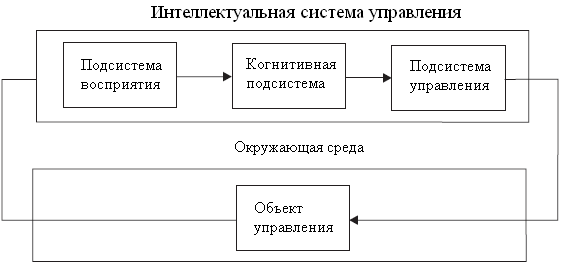

51. Структура интеллектуальной системы управления

И нтеллектуальная

система управления включает в себя

несколько подсистем (рис. 1).

нтеллектуальная

система управления включает в себя

несколько подсистем (рис. 1).

Подсистема восприятия

Эта система собирает информацию об объекте и об окружающей среде и преобразует ее в форму, удобную для использования когнитивной (познавательной) подсистемой. Основными элементами первой являются:

а) набор датчиков, которые обеспечивают исходные данные об объекте и об окружающей среде,

б) устройств обработки сигналов, которые преобразует информацию в удобную для дальнейшего использования форму,

в) интеграция данных, которая использует многомерное пространство данных для получения описания объекта и его окружения. Ключевой технологией здесь является распознавание образов.

Когнитивная (познавательная) подсистема

Когнитивная подсистема связана с принятием решения в условиях неопределенности. Ключевые операции включают в себя:

а) Нечеткий логический вывод (умозаключение), используя

1. базу знаний системы,

2. нечеткую логику;

б) Стратегию планирования, используя

1. вычисление оптимальной стратегии.

2. адаптивный поиск и генетические алгоритмы,

3. разработку и программирование (планирование) траектории движения;

в) Обучение, используя

1. супервизорное обучение в нейронных сетях,

2. несупервизорное обучение в нейронных сетях,

3. адаптивное обучение.

Подсистема управления

Исполнительные устройства применяют сигналы, полученные от познавательной подсистемы, чтобы перевести объект в желаемое состояние, В случае отказа исполнительного устройства (или датчика) интеллектуальная система управления должна обладать способностью искусно перестроить стратегию управления. В этом курсе мы рассмотрим главным образом процессы, связанные с когнитивной подсистемой. Следовательно, в данном курсе будет уделено внимание трем технологиям:

- технологии нечеткой логики, ориентированной на обработку логико-лингвистических моделей представления знаний с помощью продукционных (базовых) знаний и нечетких множеств. Эти технологии 1) обладают способностью фаззифицировать сложные ОУ в рамках лингвистических правил, 2) позволяют избежать применения сложных математических моделей, 3) создают долговременную память, тем самым имеют свойства обучения, 4) снижают уровень неопределенности при работе со сложными моделями;

- технологии нейросетевых структур с неявной формой представления знаний, скрытых в архитектуре сети, параметрах нейронов и связей. Эти технологии позволяют обучать нейронные сети онлайн и офлайн и настраивать их параметры;

- технологии нейронечетких систем, ориентированной на объединение в себе достоинств нейронных систем и систем с нечеткой логикой.

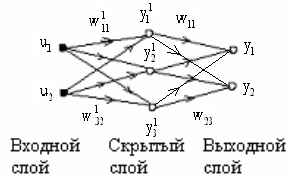

52. Многослойная нейронная сеть

М ногослойная

нейронная сеть включает в себя один

или несколько скрытых слоев, нейроны

которых называют скрытыми нейронами

(рис. 1). Граф на рис. 6 изображает

многослойную сеть с одним скрытым

нейроном. Когда мы говорим, что сеть

состоит из N слоев, мы

учитываем лишь скрытые слои и выходной

слой. Входной слой при этом не учитывается,

т.к. его узлы не отражают никаких действий

вычислительного характера. Однослойная

нейронная сеть, таким образом, состоит

из одного выходного слоя.

ногослойная

нейронная сеть включает в себя один

или несколько скрытых слоев, нейроны

которых называют скрытыми нейронами

(рис. 1). Граф на рис. 6 изображает

многослойную сеть с одним скрытым

нейроном. Когда мы говорим, что сеть

состоит из N слоев, мы

учитываем лишь скрытые слои и выходной

слой. Входной слой при этом не учитывается,

т.к. его узлы не отражают никаких действий

вычислительного характера. Однослойная

нейронная сеть, таким образом, состоит

из одного выходного слоя.

Найдем математическую модель

двухслойной сети, полагая, что в каждом

слое используется одна и та же

активационная

функция (функция активации f)

и что число входов n

и число выходов m.

Считаем, что скрытый слой содержит c

нейронов. Для двухслойной

нейронной сети, представленной на рис.

6, n=m=2,

c=3.

Ради простоты мы не показываем смещения

нейронов. В нейронах скрытого слоя,

во-первых, вычисляется взвешенная сумма

входных сигналов u1

и u2

, так что

внутренний сигнал

i-го

нейрона этого слоя определяется как

.

(4a).

Затем используется нелинейная

активационная функция f,

чтобы вычислить

выходной

сигнал i-го

нейрона скрытого слоя

.

(4a).

Затем используется нелинейная

активационная функция f,

чтобы вычислить

выходной

сигнал i-го

нейрона скрытого слоя

.

(4b)

.

(4b)

Заметим, что активационные функции вводят в нейронную сеть нелинейности и при этом придают ей устойчивость в работе. Выходной сигнал активационной функции в общем случае проходит непосредственно на выход i-го нейрона скрытого слоя (хотя имеются исключения, когда используется динамический фильтр), после чего он поступает на входы нейронов следующего слоя посредством весовых коэффициентов. Для двухслойной сети следующим слоем является выходной слой, так что внутренний сигнал j-го нейрона этого слоя определяется как

.

(4c)

.

(4c)

Затем с помощью активационной функции выходного слоя окончательно формируется выходной сигнал j-го нейрона, другими словами, j-й выходной сигнал нейронной сети

.

(4d)

.

(4d)

Несмотря на простоту рассмотренной структуры, эта модель нейронной сети весьма универсальна. Показано, что нейронная сеть с одним скрытым слоем, может аппроксимировать любую непрерывную функцию с любой степенью точности (если имеется достаточное число нейронов в скрытом слое). Следует сказать, что нейронная сеть с двумя скрытыми слоями может аппроксимировать всецело любую функцию.

Различают два режима работы нейронной сети рабочий режим и режим обучения.

В рабочем режиме имеет место прямое распространение сигнала от входа к выходу. Хотя применяются нейронные сети с обратной связью, мы ограничимся лишь изучением многослойной сети с однонаправленным распространением входного сигнала (персептрона). В режиме обучения используется как прямое, так и обратное распространение сигнала, которое сводится к тому, что сигнал ошибки e=d-y=(e1,…,em) между желаемым d=(d1,…,dm) и действительным y=(y1,…,ym) значениями выхода используется для подстройки весов и смещений выходного и скрытого слоев.