- •Содержание

- •Информатика. Предмет информатики. Основные задачи информатики.

- •Информация – Свойства, Классификация. Показатели качества информации

- •Информация - от латинского слова informatio, что в переводе обозначает сведение, разъяснение, ознакомление.

- •Информация - снятая неопределенность наших знаний

- •Сообщение - наименьший элемент языка, имеющий идею или смысл, пригодный для общения.

- •Классификация информации по разным признакам

- •Меры и единицы количества и объема информации. Энтропия

- •Формы и способы представления информации. Системы счисления

- •Сводная таблица переводов целых чисел

- •Умножение

- •Диапазоны значений целых чисел без знака

- •Диапазоны значений целых чисел со знаком

- •2. А положительное, b отрицательное и по абсолютной величине больше, чем а.

- •3. А положительное, b отрицательное и по абсолютной величине меньше, чем а.

- •Кодирование информации (текст, числа, цвет, графика, звук)

- •Способы кодирования информации

- •Логические основы эвм. Логические операции. Законы логического вывода

- •Вопросы для самопроверки:

- •Глава2. Технические средства реализации информационных процессов История развития вычислительной техники

- •В 1924 году Холлерит создал фирму ибм (ibm, International Business Machines Corporation).

- •I поколение эвм

- •Второе поколение компьютеров, использующее транзисторы, появилось в 1955

- •Третье поколение эвм 1968 - 1973

- •Четвертое поколение эвм 1974 – ……….

- •Технические характеристики эвм четвертого поколения

- •Классификация компьютеров

- •Самый быстрый компьютер по данным сайта

- •1572864 Кол-во ядер

- •1572864 Гб памяти

- •Персональные компьютеры

- •Десктоп

- •Моноблок

- •Ноутбуки

- •Понятие и основные виды архитектуры эвм

- •1. Принцип программного управления. Из него следует, что программа состоит из набора команд, которые выполняются процессором автоматически друг за другом в определенной последовательности.

- •Состав и назначение основных элементов персонального компьютера, их характеристики

- •Устройства ввода/вывода данных, их разновидности и основные характеристики

- •Вопросы для самопроверки:

- •Глава 3. Программные средства реализации информационных процессов Понятие программного обеспечения Системное программное обеспечение: назначение, возможности, структура

- •Развитие операционных систем:

- •Прикладное программное обеспечение

- •Вопросы для самопроверки:

- •Глава 4. Офисные приложения

- •Вопросы для самопроверки:

- •Глава 5. Базы данных

- •Назначение и основы использования систем искусственного интеллекта

- •Вопросы для самопроверки:

- •Глава 6. Локальные и глобальные сети эвм

- •2. Hub (концентратор):

- •Bridle (Мост):

- •4. Router (маршрутизатор):

- •5. Switch (коммутатор):

- •Html- язык разметки гипертекста

- •Вопросы для самопроверки:

- •Глава 7. Основы защиты информации и сведений, составляющих государственную тайну. Методы защиты информации

- •Государство

- •Нормативные документы в области информационной безопасности

- •Выписка из уголовного кодекса рф (1 января 1997 года)

- •Угроза информационной безопасности государства

- •2. Техногенные :

- •3. Стихийные угрозы

- •5.Системы резервного копирования

- •6.Системы бесперебойного питания.

- •7.Антивирусные средства

- •8.Межсетевые экраны

- •4. По особенностям алгоритма вируса

- •Вопросы для самопроверки:

- •Раздел II. Моделирование, алгоритмизация и программирование Глава 1. Модели решения функциональных и вычислительных задач

- •Вопросы для самопроверки:

- •Глава 2. Алгоритмизация и программирование. Технологии программирования

- •Логическая структура любого алгоритма может быть представлена комбинацией трех базовых структур: следование, ветвление, цикл.

- •Вопросы для самопроверки:

- •Глава 3. Языки программирования

- •Логические типы данных

- •Вопросы для самопроверки:

- •Глоссарий

- •Список рекомендуемой литературы

Меры и единицы количества и объема информации. Энтропия

Единицы измерения количества информации служат для измерения объёма информации — величины, исчисляемой логарифмически. Это означает, что когда несколько объектов рассматриваются как один, количество возможных состояний перемножается, а количество информации — складывается

Первичные единицы

Объёмы информации можно представлять как логарифм количества состояний. Наименьшее целое число, логарифм которого положителен - 2. Соответствующая ему единица - бит - является основой исчисления информации в цифровой технике.

Бит в теории информации – количество информации, необходимое для различения двух равновероятных сообщений (типа "орел"—"решка", "чет"—"нечет" и т.п.).

1 бит – величина,

уменьшающая неопределенность в два

раза

Единицы информации

бит |

б |

1 |

байт |

Б |

8 бит |

килобит |

кбит (кб) |

1 000 бит |

килобайт |

КБайт (KБ) |

1024 байта |

мегабит |

мбит (мб) |

1 000 килобит |

мегабайт |

МБайт (МБ) |

1024 килобайта |

гигабит |

гбит (гб) |

1 000 мегабит |

гигабайт |

ГБайт (ГБ) |

1024 мегабайта |

терабит |

тбит (тб) |

1 000 гигабит |

терабайт |

ТБайт (ТБ) |

1024 гигабайт |

Почему в 1 байте 8 бит?

8-битные байты были приняты в System/360, из-за использования BCD-формата представления чисел: одна десятичная цифра (0-9) требует 4 бита (тетраду) для хранения; один 8-битный байт может представлять две десятичные цифры. 6-битные байты могут хранить только по одной десятичной цифре, два бита остаются незадействованными.

По другой версии, 8-битный размер байта связан с 8-битным же числовым представлением символов в кодировке EBCDIC.

По третьей версии, из-за двоичной системы кодирования в компьютерах наиболее выгодными для аппаратной реализации и удобными для обработки данных являются длины слов кратные степеням 2, в том числе и 1 Байт = 23 = 8 битов, системы и компьютеры с длинами слов не кратными степеням 2 отпали из-за невыгодности и неудобства

Меры информации

Мера Хартли H = log2N (бит).

Мера Шеннона

увеличение меры Шеннона свидетельствует об уменьшении энтропии (увеличении порядка) системы;

уменьшение меры Шеннона свидетельствует об увеличении энтропии (увеличении беспорядка) системы.

Неопределенность

Максимальная неопределенность предполагает наличие нескольких равновероятных альтернатив (вариантов), т.е. ни один из вариантов не является более предпочтительным.

Минимальная неопределенность равна 0

Энтропия (H) – мера неопределенности, выраженная в битах. Так же энтропию можно рассматривать как меру равномерности распределения случайной величины.

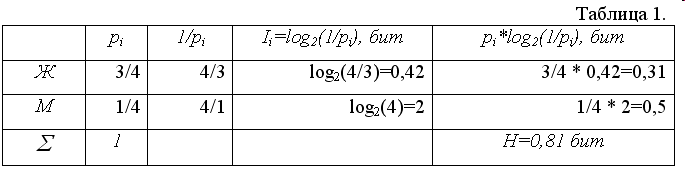

Пример:

Пусть в некотором учреждении состав работников распределяется так: ¾ - женщины, ¼ - мужчины. Тогда неопределенность, например, относительно того, кого вы встретите первым, зайдя в учреждение, будет рассчитана рядом действий.

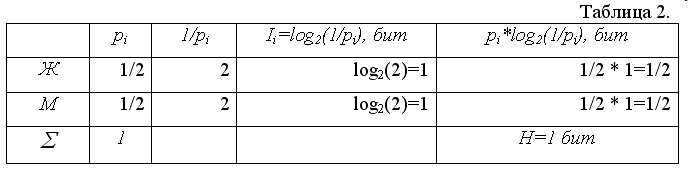

Если же априори известно, что мужчин и женщин в учреждении поровну (два равновероятных варианта), то при расчете по той же формуле мы должны получить неопределенность в 1 бит. Проверка этого предположения проведена в таблице.

Количество информации I и энтропия H характеризуют одну и ту же ситуацию, но с качественно противоположенных сторон. I – это количество информации, которое требуется для снятия неопределенности H