- •С одержание

- •Методы безусловной оптимизации

- •Нахождение стационарной точки

- •2.Методы прямого поиска безусловной оптимизации

- •2.1. Метод поиска по симплексу

- •2.2. Метод поиска Хука-Дживса

- •2.3. Метод сопряженных направлений Пауэлла

- •3.Нахождение безусловного экстремума градиентными методами

- •3.1. Метод Коши

- •3.2. Метод Ньютона

- •3.3. Метод сопряженных градиентов

- •3.4 Квазиньютоновский метод

- •Заключение.

- •Библиографический список:

3.1. Метод Коши

Описание алгоритма:

В методе Коши или методе наискорейшего спуска в качестве направления поиска выбирается направление антиградиента.

-

градиент функции

-

градиент функции

Алгоритм метода выглядит следующим образом:

,

где

,

где

- градиент.

- градиент.

Значение

на каждой итерации вычисляется путем

решения задачи одномерного поиска

экстремума

вдоль направления градиента

на каждой итерации вычисляется путем

решения задачи одномерного поиска

экстремума

вдоль направления градиента

.

Если в качестве

взять некоторое положительное число,

то получится простейший градиентный

алгоритм:

.

Если в качестве

взять некоторое положительное число,

то получится простейший градиентный

алгоритм:

Одно из главных достоинств метода Коши является его устойчивость, так как всегда выполняется условие:

Однако вблизи экстремума скорость сходимости алгоритма становится недопустимо низкой, так как вблизи экстремума значение градиента стремится к нулю.

Алгоритм метода:

Шаг 1. Задать: 1. Начальную точку х(0) ;

2. Условие окончания поиска. Перейти к шагу 2.

Шаг 2. Вычислить направление поиска в виде антиградиента функции

s(x(k) ) = - ∇f(x(k) );

.

Перейти к шагу 3.

.

Перейти к шагу 3.

Шаг 3. Найти новое приближение

, где - величина шага относительно текущего приближения. Перейти к шагу4.

Шаг 4. Проверка условия окончания поиска.

Да: закончить поиск;

Нет: перейти к шагу 2.

Ход решения:

Исходные данные:

Шаг 1.

- начальная точка (начальное приближение);

Вычислим компоненты градиента:

Шаг 2.

Шаг 3. Начальное приближение

1. Новое приближение определим по формуле:

Шаг 2.

Находим

по аналогии с прошлым методом

по аналогии с прошлым методом

Шаг 3.

отсюда:

отсюда:

;

;

.

.

.

Приравняв его к нулю, находим

.

Приравняв его к нулю, находим

;

;

2.

Далее найдем точку:

Шаг 2.

Шаг 3.

отсюда:

;

;

.

.

.

Приравняв его к нулю, находим

.

Приравняв его к нулю, находим

3.

Далее найдем точку:

Шаг 2.

Шаг 3.

отсюда:

;

;

.

.

.

Приравняв его к нулю, находим

.

Приравняв его к нулю, находим

4.

Далее найдем точку:

Шаг 2.

Шаг 3.

отсюда:

;

;

.

.

.

Приравняв его к нулю, находим

.

Приравняв его к нулю, находим

После

4 итераций найдено достаточно точное

значение минимума, при котором значение

целевой функции в точке

,

,

.

.

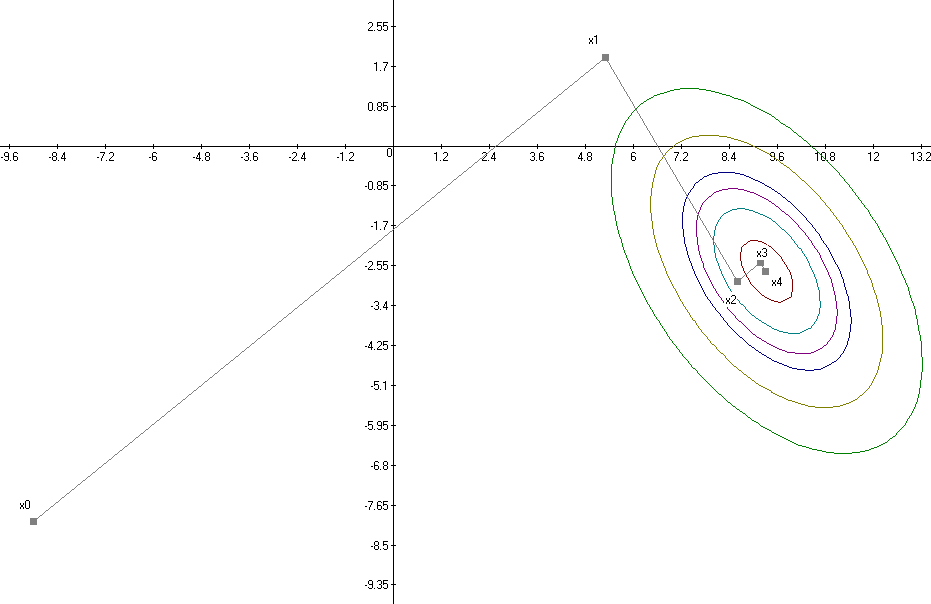

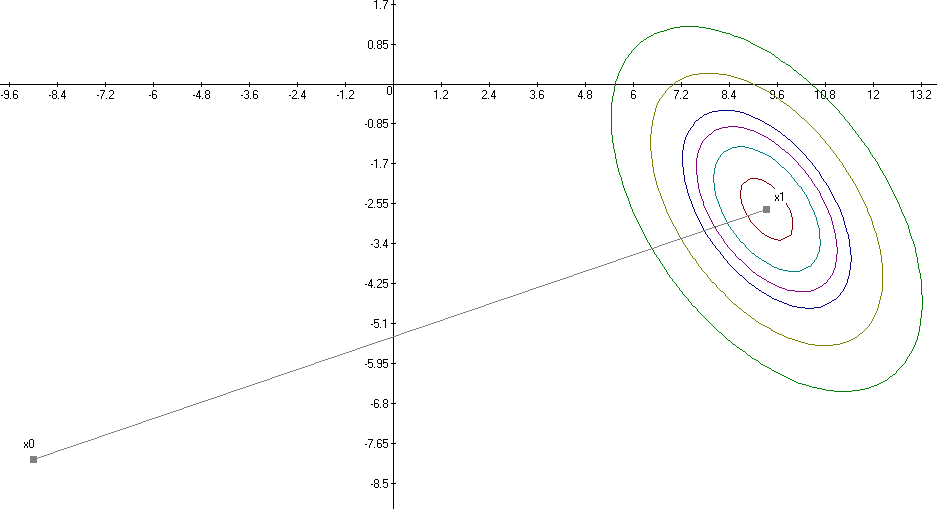

рис.5 Графическое пояснение метода Коши

3.2. Метод Ньютона

Описание алгоритма:

Этот метод использует информацию о вторых производных целевой функции. Эта информация появляется при квадратичной аппроксимации целевой функции, когда при её разложении в ряд Тейлора учитываются члены ряда до второго порядка включительно. Алгоритм метода выглядит следующим образом:

,

где:

,

где:

-

гессиан (матрица Гессе)

-

гессиан (матрица Гессе)

В случае, когда гессиан положительно определён, направление по методу Ньютона оказывается направлением спуска.

Алгоритм метода:

Шаг 1. Задать: начальную точку х(0). Перейти к шагу 2.

Шаг 2. Вычислить направление поиска в виде

s(x(k))

= –

.

.

Шаг 3. Найти новое приближение (являющееся решением задачи для квадратичной функции)

x(k+1) = x(k) + s(x(k)) = x(k) – .

Шаг 4. Проверка на условие окончания вычислений.

Да: закончить процесс;

Нет: перейти к шагу 2.

Ход решения:

Исходные данные:

- целевая функция;

Шаг 1.

- начальная точка;

Шаг 2.

Шаг 3.

;

;

Таким

образом, точка минимума

,

значение функции в которой

найдена за одну итерацию.

,

значение функции в которой

найдена за одну итерацию.

рис.6 Графическое пояснение метода Ньютона