- •1. Нестационарные по математическому ожиданию и стационарные процессы.

- •2. Понятие, предмет, задачи эконометрики.

- •3. Основные этапы развития эконометрики.

- •4. Особенности эконометрического метода.

- •5. Стохастика - детерминированный характер социально - экономических явлений.

- •7. Основные этапы моделирования связи методом корреляционно-регрессионного анализа.

- •8. Выбор объекта исследования при построении эконометрической модели.

- •9. . Выбор факторов, включаемых в систему, при построении эконометрической модели.

- •10. Сбор исходной информации при построении эконометрической модели.

- •11. Первичная статистическая обработка при построении эконометрической модели.

- •12. Построение двухмерной линейной модели корреляционно-регрессионного анализа.

- •13. Проверка значимости коэффициентов простой линейной регрессии и адекватности регрессионной модели.

- •14. Оценка существенности параметров линейной регрессии с помощью дисперсионного анализа.

- •15.Нелинейная регрессия

- •16. Множественная линейная регрессия: задача и основные предположения.

- •17. Выбор формы уравнения множественной регрессии.

- •18. Проверка значимости результатов множественной регрессии.

- •19. Метод наименьших квадратов для множественной линейной регрессии.

- •20. Геометрическая интерпретация метода наименьших квадратов.

- •21. Статистические свойства оценок параметров, теорема Гаусса - Маркова.

- •22. Парные, частные коэффициенты корреляции, совокупные коэффициенты множественной корреляции и детерминации. Понятие и связь между ними.

- •24. Использование коэффициента детерминации r2 и f-критерия для проверки статистических гипотез о параметрах регрессии.

- •25. Предпосылки метода наименьших квадратов. Гомоскедастичность дисперсии остатков. Гетероскедастичность.

- •2) Нулевая средняя величина остатков, т.Е.

- •4. Отсутствие автокорреляции остатков. Значения остатков распределены независимо друг от друга.

- •26. Обобщенный метод наименьших квадратов.

- •Сущность обобщённого мнк

- •27. Взвешенный метод наименьших квадратов.

- •28. Регрессионные модели с переменной структурой (фиктивные переменные).

- •29. Экономическая интерпретация многофакторной регрессионной модели.

- •30. Понятие мультиколлинеарности, ее значение при отборе факторов.

- •31. Расчет ошибки репрезентативности и доверительных интервалов при построении моделей.

- •32. Методы исключения тенденции во временных рядах.

- •33. Скользящая средняя и метод центрирования.

- •34. Автокорреляция. Тесты на автокорреляцию остатков (критерий Дарбина-Уотсона).

- •35. Оценивание при наличии автокорреляции остатков.

- •36. Прогнозирование в регрессионных моделях. Хуета какая то

- •37. Система линейных одновременных уравнений и ее идентификация.

- •38. Приведенная форма структурной модели.

- •39Идентификация параметров структурной и приведенной форм модели.

- •40. Оценивание параметров структурной формы модели.

- •42. Двушаговый метод оценки параметров систем одновременных уравнений.

- •43. Экономически значимые примеры систем одновременных уравнений.

- •45. Типы динамических эконометрических моделей. Модели с распределенным лагом и модели авторегрессии.

- •46. Интерпретация моделей: краткосрочный, промежуточный и долгосрочный мультипликаторы.

- •48. Метод Алмон. Метод Койка. Метод главных компонент. Метод Алмон

19. Метод наименьших квадратов для множественной линейной регрессии.

Метод

наименьших квадратов. Общий

смысл оценивания по методу наименьших

квадратов заключается в минимизации

суммы квадратов отклонений наблюдаемых

значений зависимой переменной от

значений, предсказанных моделью. Более

точно, оценки наименьших квадратов (НК)

параметра q получаются минимизацией

функции Q по ![]() ,

где:

,

где:

Q

= ![]() [Yi -

fi(

)]2

[Yi -

fi(

)]2

Отметим,

что fi(

)

- это известная функция

, Yi = fi(

)

+ ![]() i,

где i =

от 1 до n,

i -

это случайные величины (например,

погрешности измерений), средние которых

обычно полагаются равными 0.

i,

где i =

от 1 до n,

i -

это случайные величины (например,

погрешности измерений), средние которых

обычно полагаются равными 0.

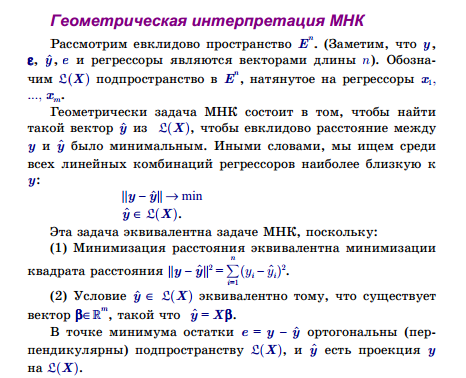

20. Геометрическая интерпретация метода наименьших квадратов.

21. Статистические свойства оценок параметров, теорема Гаусса - Маркова.

Если предпосылки метода наименьших квадратов, то оценки, полученные по МНК, обладают следующими свойствами:

Оценки параметров являются несмещенными, т. е. M(b1) = β1, M(b0) = β0 (математические ожидания оценок параметров равны их теоретическим значениям). Это вытекает из того, что M(εi) = 0, и говорит об отсутствии систематической ошибки в определении положения линии регрессии.

Оценки параметров состоятельны, так как дисперсия оценок параметров при возрастании числа n наблюдений стремится к нулю D(b0) → 0, D(b1) → 0 при n → ∞ . По другому говоря, при увеличении объема выборки надежность оценок увеличивается (b1 наверняка близко к β1, b0 — близко к β0).

Оценки параметров эффективны, т. е. они имеют наименьшую дисперсию по сравнению с другими оценками данных параметров, линейными относительно величин yi.

22. Парные, частные коэффициенты корреляции, совокупные коэффициенты множественной корреляции и детерминации. Понятие и связь между ними.

Парные коэффициенты корреляции. Для измерения тесноты связи между двумя из рассматриваемых переменных (без учета их взаимодействия с другими переменными) применяются парные коэффициенты корреляции. Методика расчета таких коэффициентов и их интерпретации аналогичны линейному коэффициенту корреляции в случае однофакторной связи.

Коэффициент частной корреляции измеряет тесноту линейной связи между отдельным фактором и результатом при устранении воздействия прочих факторов модели.

Для случая зависимости Y от двух факторов можно вычислить 2 коэффициента частной корреляции:

(2-ой

фактор ![]() фиксирован);

фиксирован);

Совокупный коэффициент множественной корреляции или индекс множественной корреляцииопределяет тесноту совместного влияния факторов на результат:

Связь: Частный коэффициент корреляции в отличие от коэффициента (полного) парной корреляции между явлениями показывает тесноту связи после устранения изменений, обусловленных влиянием третьего явления на оба коррелируемых признака (из значений корреляционных признаков вычитаются линейные оценки в связи с третьим признаком).

24. Использование коэффициента детерминации r2 и f-критерия для проверки статистических гипотез о параметрах регрессии.