- •Содержание

- •Автокорреляция случайного возмущения. Причины. Последствия.

- •Алгоритм проверки адекватности парной регрессионной модели.

- •Алгоритм проверки значимости регрессора в парной регрессионной модели

- •4. Алгоритм теста Голдфелда-Квандта на наличие (отсутствие) гетероскедастичности случайных возмущений.

- •5. Алгоритм теста Дарбина-Уотсона на наличие (отсутствие) автокорреляции случайных возмущений.

- •6.Гетероскедастичность случайного возмущения. Причины.

- •7.Динамическая модель из одновременных линейных уравнений (привести пример)

- •8.Идентификация отдельных уравнений системы одновременных уравнений: порядковое условие.

- •Необходимое условие идентифицируемости

- •9. Индивидуальная оценка значения зависимой переменной

- •10. Интервальная оценка индивидуального значения зависимой переменной

- •11.Классическая парная регрессионная модель. Спецификация модели.

- •12.Коэффициент детерминации в регрессионной модели.

- •13.Ковариация, коэффициент корреляции и индекс детерминации.

- •14.Количественные характеристики взаимосвязи пары случайных переменных

- •15.Коэффициент корреляции и индекс детерминации.

- •16.Линейная модель множественной регрессии

- •17.Метод наименьших квадратов: алгоритм метода; условия применения

- •18.Метод показателей информационной ёмкости

- •19.Методы подбора переменных в модели множественной регрессии

- •20.Методы сглаживания временного ряда.

- •21, 52. Модели временных рядов

- •22.Модели с бинарными фиктивными переменными

- •23.Модели с частичной корректировкой

- •24.Настройка модели с системой одновременных уравнений.

- •25, 26. Нелинейная модель множественной регрессии Кобба-Дугласа. Оценка её коэффициентов

- •27.Нормальный закон распределения как характеристика случайной переменной

- •28.Обобщённый метод наименьших квадратов

- •29, 30. Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение

- •31. Определение соответствия распределения случайных возмущений нормальному закону распределения

- •32. Основные числовые характеристики вектора остатков в классической множественной регрессионной модели.

- •33.Отражение в модели влияния неучтённых факторов

- •34.Отражение в эконометрических моделях фактора времени

- •35, 36, 45.Оценивание линейной модели множественной регрессии в Excel

- •37.Оценивание регрессионной модели с фиктивной переменной наклона

- •38.Оценка коэффициентов модели Самуэльсона-Хикса

- •39. Оценка параметров множественной регрессионной модели методом наименьших квадратов

- •40. Оценка параметров парной регрессионной модели методом наименьших квадратов

- •41. Оценка статистической значимости коэффициентов модели множественной регрессии.

- •Ситуации

- •42. Подбор переменных в модели множественной регрессии на основе метода оценки информационной ёмкости.

- •43. Подбор переменных в модели множественной регрессии методом «снизу вверх»

- •44. Подбор переменных в модели множественной регрессии методом исключения переменных («сверху вниз»).

- •46. Последствия гетероскедастичности. Тест gq

- •47. Применение теста Стьюдента в процедуре подбора переменных в модели множественной регрессии

- •48. Применение фиктивных переменных при исследовании сезонных колебаний: спецификация модели, экономический смысл параметров при фиктивных переменных

- •49. Принципы спецификации эконометрических моделей и их формы

- •50. Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности

- •51. Прогнозирование экономических переменных. Проверка адекватности модели

- •53.Регрессионные модели с фиктивными переменными.

- •54.Свойства временных рядов

- •55.Составление спецификации модели временного ряда.

- •56, 57. Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам.

- •58.Спецификация моделей со случайными возмущениями и преобразование их к системе нормальных уравнений.

- •59.Способы корректировки гетероскедастичности. Метод взвешенных наименьших квадратов.

- •60.Статистические свойства оценок параметров парной регрессионной модели

- •61.Статистические характеристики выборки и генеральной совокупности статистических данных. Их соотношения.

- •62.Схема Гаусса – Маркова

- •63.Теорема Гаусса-Маркова

- •64. Тест ошибочной спецификации Рамсея.

- •Тест Стьюдента

- •66, 67. Типы переменных в эконометрических моделях. Структурная и приведённая формы спецификации эконометрических моделей.

- •68. Устранение автокорреляции в парной регрессии

- •70. Фиктивная переменная наклона: назначение; спецификация

- •71.Функция регрессии как оптимальный прогноз

- •72.Характеристики сервиса «Описательная статистика».

- •73. Метод наибольшего прадоподобия

- •Последовательность решения:

- •74. Что такое стационарный процесс

- •75. Эконометрика, её задача и метод.

- •76.Экспоненциальное сглаживание временного ряда

- •77. Этапы построения эконометрических моделей

- •78. Этапы решения экономико-математических задач.

56, 57. Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам.

В моделях, нелинейных по параметрам, например степенных или показательных, непосредственное применение МНК для их оценки невозможно, так как необходимым условием применимости МНК является линейность по коэффициентам уравнения регрессии. В данном случае преобразованием, которое приводит уравнение регрессии к линейному виду, является логарифмирование. Логарифмические модели: Y = AXb, где А и b— параметры модели. Прологарифмируем обе части данного уравнения: ln(Y)=ln(A) + b*ln(X) = a+b*ln(X), где а= ln(A) (*). Спецификация, соответствующая (*) называется двойной логарифмической моделью: ln(Y)= a+ b*ln(X)+u, поскольку и эндогенная переменная, и регрессор используются в логарифмической форме. Введем обозначения: Y*=ln(Y), X*=ln(X)

Y*=a+b*X+u

Получаем спецификацию линейной модели, к которой при соответствующем включении случайного возмущения применим МНК.

В моделях, нелинейных по оцениваемым параметрам, но приводимых к линейному виду, МНК применяется к преобразованным уравнениям. Пусть получена МНК-оценка моделиY*=a+b*X+u:

y*=ā + bx+u

(Sā) (Sb) (Su)

Коэффициенты исходной модели и их стандартные ошибки вычисляются с учетом замены.

Нелинейный МНК. В общем случае оценка нелинейных по параметрам уравнений выполняется с помощью так называемого нелинейного метода наименьших квадратов (НМНК).

Обозначим нелинейное по параметрам уравнение регрессии f(X, ß) (X— матрица рсгрсссоров,ß — вектор параметров). Параметры уравнений в данном методе подбираются таким образом, чтобы максимально приблизить кривую f(X, ß) к результатам

наблюдений эндогенной переменной Y. Таким образом, здесь, как и в обычном

МНК, минимизируется сумма квадратов отклонений:

F= 2

(**)

2

(**)

Если продифференцировать F по параметрам и приравнять производные нулю, то получим нелинейную систему нормальных уравнений. В случае линейного уравнения регрессии нормальные уравнения представляли собой систему линейных уравнений, решение которой не составляло труда.

Нелинейный метод наименьших квадратов сводится к задаче минимизации функции (**) нескольких переменных ß=(ß1,…,ßn)

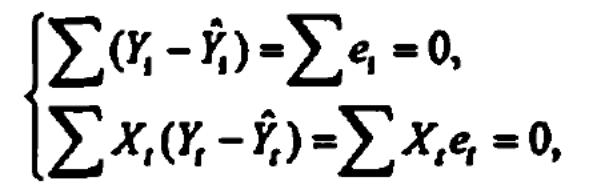

58.Спецификация моделей со случайными возмущениями и преобразование их к системе нормальных уравнений.

Один из принципов спецификации - включение в спецификацию экономической модели случайных возмущений. На практике не всегда удается учесть влияние всех факторов на изучаемую переменную (например, в функции спроса учесть возрастные особенности потребителя), выбрать правильную форму математической зависимости между экономическими переменными (например, нелинейную вместо линейной), безошибочно выполнить измерения (правильно провести опрос). Поэтому необходимо включать некоторые случайные величины, называемые случайные возмущения.

Y = f(x)+ε , где f(x)- часть эндогенной переменной, объясняемая значением экзогенной переменной Х; ε – случайное возмущение. Для того чтобы среди множества уравнений регрессии выбрать одно, необходим критерий отбора. При оценивании параметров регрессионных моделей наиболее часто применяется МНК. Его оценки обладают свойствами несмещённости, состоятельности, эффективности:

(1)

(1)

То есть оценки параметров должны быть подобраны таким образом, чтобы сумма квадратов случайных возмущений стремилась к минимуму

![]() (2)

(2)

Для нахождения минимума дифференцируем (1):

Получаем стандартную форму нормальных уравнений:

Из

которых находим параметры.

Из

которых находим параметры.