- •1. Предмет теории вероятностей. Понятие случайного события.

- •2. Основные типы событий, алгебра событий.

- •3.Понятие вероятности события. Классическое, статистическое и геометрическое определение вероятности. Свойства вероятностей.

- •Элементы комбинаторики. Схемы выбора без возвращения и с возвращением.

- •Урны и шарики

- •Урновая схема: выбор без возвращения, с учетом порядка

- •Урновая схема: выбор без возвращения и без учета порядка

- •Урновая схема: выбор с возвращением и с учетом порядка

- •Урновая схема: выбор с возвращением и без учета порядка

- •Теорема сложения вероятностей.

- •Сумма и произведение совместных событий и их геометрическая интерпретация.

- •Зависимые и независимые события. Теорема умножения вероятностей.

- •8.Формула полной вероятности.

- •9. Формула Бейеса.

- •10. Формула (схема) Бернулли.

- •11. Предельные теоремы в схеме Бернулли. Формула Пуассона и условия её применимости.

- •Предельные теоремы для схем Бернулли

- •Пуассоновское приближение

- •Нормальное приближение

- •О применимости предельных теорем в схеме Бернулли

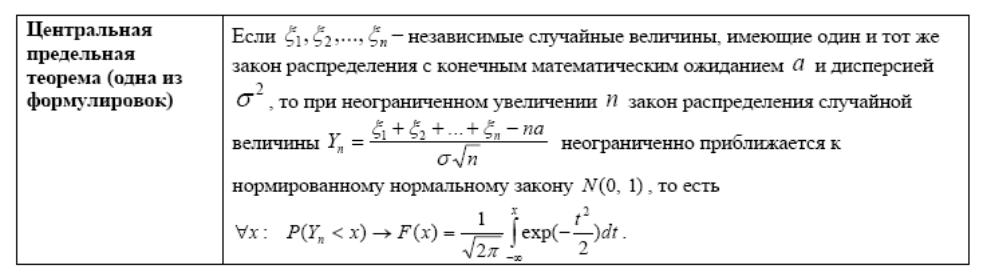

- •12. Локальная и интегральная теорема Муавра-Лапласа.

- •13. Дискретные случайные события и возможности их описания.

- •15. Функция распределения и её свойства. Вероятность попадания случайной величины на заданный интервал.

- •16. Плотность распределения и её свойства. Вероятностный и геометрический смысл плотности распределения.

- •17. Математическое ожидание случайной величины и его свойства.

- •18. Дисперсия и среднее квадратическое отклонение случайной величины. Свойства дисперсии. Производящая функция.

- •19. Мода и медиана. Моменты случайных величин. Асимметрия и эксцесс. Квантили распределения.

- •20. Математическое ожидание и дисперсия числа появления события в независимых опытах.

- •21. Непрерывная случайная величина. Числовые характеристики непрерывных случайных величин.

- •Кривая распределения вероятностей.

- •22. Закон равномерного распределения.

- •23. Экспонентный закон распределения.

- •24. Нормальное распределение. Функция Лапласа. Вероятность попадания в заданный интервал.

- •25. Функция распределения двумерной случайной величины.

- •26. Плотность распределения вероятностей двумерной случайной величины и её свойства.

- •27. Зависимость и независимость двух случайных величин. Числовые характеристики двумерной с.В. Математическое ожидание и дисперсия.

- •28. Корреляционный момент. Коэффициент корреляции. Свойства ковариации и коэффициента корреляции.

- •Свойства ковариации Править

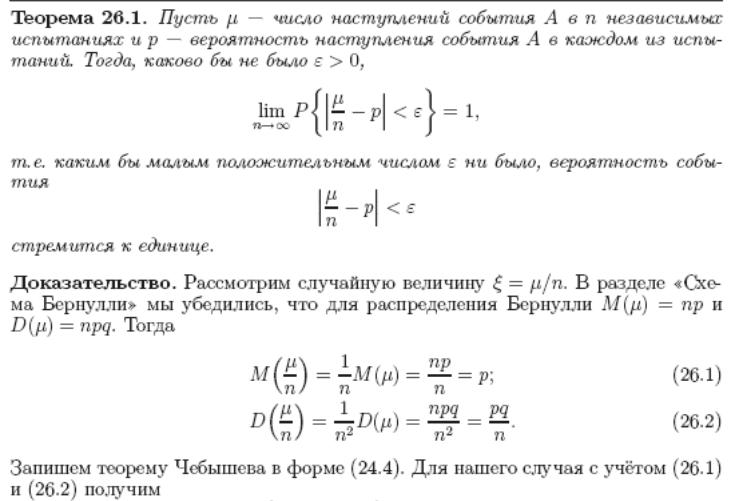

- •29. Предельные теоремы теории вероятностей. Неравенство и теория Чебышева

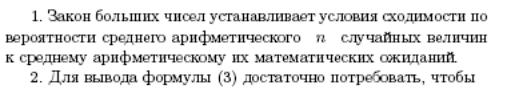

- •31. Центральная предельная теорема.

- •32. Математическая статистика. Основные понятия.

- •33. Генеральная совокупность и выборка. Характеристики выборки. Способы отбора.

- •34. Статистическое распределение выборки.

- •35. Эмпирическая функция распределения.

- •36. Полигон и гистограмма.

- •37. Статистические оценки параметров распределения.

- •39. Точечная и интервальная оценки. Доверительный интервал. Методики нахождения точечных оценок.

- •40. Метод статистических гипотез.

28. Корреляционный момент. Коэффициент корреляции. Свойства ковариации и коэффициента корреляции.

Коэффициентом ковариации называется выражение:

cov(X,Y)=M[(X-MX)(Y-MY)]=M[XY-XMY-YMX+MX•MY]=MXY-2MX•MY+MX•MY=MXY-MX•MY

Если случайные величины XY независимы, то их коэффициент ковариации равен нулю, обратное в общем случае неверно.

Коэффициентом корреляции случайных величин X и Y называется число:

![]()

X*=(X-MX)/σx Y*=(Y-MY)/σy

D(X±Y)=M[X±Y-M(X±Y)]2=M[X±Y-MX∓MY]2=M[(X-MX)±(Y-MY)]2=M[(M-MX)2±2(X-MX)(Y-MY)+(Y-MY)2]=M(X_MX)2±2M(X-MX)(Y-MY)+M(Y-MY)2=DX±cov(XY)+DY

Следствие:

Если X и Y независимы, то коэффициент ковариации равен 0 и следовательно

D(X±Y)=DX±DY

Свойства коэффициента корреляции

1. -1≤pxy≤1 2. Если |pxy|=1, то с вероятность 1 X и Y связаны линейно. То есть, если коэффициент корреляции |pxy|=1, то результаты опыта лежат на прямой

В общем случае Y можно представить в виде

y=ax+b+z DZ=σy2(1-pxy)2

Коэффициент корреляции является мерой близости линейной связи между случайными величинами X и Y: чем ближе коэффициент корреляции по модулю к 1, тем более тесно результаты конкретного испытания над X и Y соотносятся с прямой ax+b.

Свойства ковариации Править

Ковариация симметрична:

![]() .

.

В силу линейности математического ожидания, ковариация может быть записана как

![]() .

.

Пусть

случайные

величины, а

случайные

величины, а

их

две произвольные линейные

комбинации.

Тогда

их

две произвольные линейные

комбинации.

Тогда

![]() .

.

В частности ковариация (в отличие от коэффициента корреляции) не инварианта относительно смены масштаба, что не всегда удобно в приложениях.

Ковариация случайной величины с собой равна дисперсии:

![]() .

.

Если

независимые

случайные величины, то

независимые

случайные величины, то

![]() .

.

Обратное, вообще говоря, неверно.

Неравенство Коши — Буняковского:

![]() .

.

29. Предельные теоремы теории вероятностей. Неравенство и теория Чебышева

![]()

Неравенство Чебышева.

Неравенство Чебышева, используемое для доказательства дальнейших теорем, справед-ливо как для непрерывных, так и для дискретных случайных величин. Докажем его для дискретных случайных величин.

Теорема 13.1(неравенство Чебышева). p( | X – M(X)| < ε ) ≥ D(X) / ε². (13.1)

Доказательство. Пусть Х задается рядом распределения

Х |

х1 |

х2 |

… |

хп |

р |

р1 |

р2 |

… |

рп |

Так как события |X – M(X)| < ε и |X – M(X)| ≥ ε противоположны, то р ( |X – M(X)| < ε ) + + р ( |X – M(X)| ≥ ε ) = 1, следовательно, р ( |X – M(X)| < ε ) = 1 - р ( |X – M(X)| ≥ ε ). Найдем р ( |X – M(X)| ≥ ε ).

D(X) = (x1 – M(X))²p1 + (x2 – M(X))²p2 + … + (xn – M(X))²pn . Исключим из этой суммы те слагаемые, для которых |X – M(X)| < ε. При этом сумма может только уменьшиться, так как все входящие в нее слагаемые неотрицательны. Для определенности будем считать, что отброшены первые k слагаемых. Тогда

D(X) ≥ (xk+1 – M(X))²pk+1 + (xk+2 – M(X))²pk+2 + … + (xn – M(X))²pn ≥ ε² (pk+1 + pk+2 + … + pn).

Отметим, что pk+1 + pk+2 + … + pn есть вероятность того, что |X – M(X)| ≥ ε, так как это сумма вероятностей всех возможных значений Х, для которых это неравенство справедливо. Следовательно, D(X) ≥ ε² р(|X – M(X)| ≥ ε), или р (|X – M(X)| ≥ ε) ≤ D(X) / ε². Тогда вероятность противоположного события p( | X – M(X)| < ε ) ≥ D(X) / ε², что и требо-валось доказать.

Теоремы Чебышева и Бернулли.

Теорема 13.2 (теорема Чебышева). Если Х1, Х2,…, Хп – попарно независимые случайные величины, дисперсии которых равномерно ограничены ( D(Xi) ≤ C), то для сколь угодно малого числа ε вероятность неравенства

![]()

будет сколь угодно близка к 1, если число случайных величин достаточно велико.

Замечание. Иначе говоря, при выполнении этих условий

![]()

Доказательство.

Рассмотрим новую случайную величину

![]() и найдем ее математическое ожидание.

Используя свойства математического

ожидания, получим, что

и найдем ее математическое ожидание.

Используя свойства математического

ожидания, получим, что

![]() .

Применим к

.

Применим к

![]() неравенство Чебышева:

неравенство Чебышева:

Так как рассматриваемые случайные

величины независимы, то, учитывая условие

теоремы, имеем:

Так как рассматриваемые случайные

величины независимы, то, учитывая условие

теоремы, имеем:

![]() Используя этот результат, представим

предыдущее неравенство в виде:

Используя этот результат, представим

предыдущее неравенство в виде:

![]() Перейдем к пределу при

Перейдем к пределу при

![]() :

:

![]() Поскольку вероятность не может быть

больше 1, можно утверждать, что

Поскольку вероятность не может быть

больше 1, можно утверждать, что

Теорема доказана.

Следствие.

Если

Х1, Х2, …, Хп

– попарно независимые случайные величины

с равномерно ограничен-ными дисперсиями,

имеющие одинаковое математическое

ожидание, равное а, то для любого

сколь угодно малого ε > 0 вероятность

неравенства

![]() будет как угодно близка к 1, если число

случайных величин достаточно велико.

Иначе говоря,

будет как угодно близка к 1, если число

случайных величин достаточно велико.

Иначе говоря,

![]() .

.

Вывод: среднее арифметическое достаточно большого числа случайных величин прини-мает значения, близкие к сумме их математических ожиданий, то есть утрачивает характер случайной величины. Например, если проводится серия измерений какой-либо физической величины, причем: а) результат каждого измерения не зависит от результатов остальных, то есть все результаты представляют собой попарно независимые случайные величины; б) измерения производятся без систематических ошибок (их математические ожидания равны между собой и равны истинному значению а измеряемой величины); в) обеспечена определенная точность измерений, следовательно, дисперсии рассматривае-мых случайных величин равномерно ограничены; то при достаточно большом числе измерений их среднее арифметическое окажется сколь угодно близким к истинному значению измеряемой величины.

Теоремы Маркова и Бернулли.