- •1.История развития статистики как науки.

- •2.Понятие предмета и метода статистики.

- •4. Теоретические основы статистики как науки. Отрасли статистики.

- •5.Статистическое наблюдение.Этапы его проведения. Общая характеристика.

- •6.Методология статистического наблюдения: цель, объект, единица, программа, место и время наблюдения.

- •7.Формы,виды и способы наблюдений. Характеристика.

- •8.Ошибки ст наблюдения.

- •9.Сводка и группировка статистических данных. Задачи, решаемые с помощью метода группировок.

- •10.Виды ст группировок. Хар-ка. Примеры.

- •11.Ряды распределения. Их виды. Построение дискретных и интервальных вар рядов.

- •12. Графический анализ вариационных рядов.

- •13. Статистические таблицы. Характеристика и классификация.

- •14.Правила построения и анализ статистических таблиц.

- •15.Понятия и виды статистических показателей.

- •16.Абсол ст показатели.

- •17.Отн пок. Их виды и взаимосвязь.

- •18. Средние показатели. Их сущность и значение.

- •19. Виды средних и способы их вычисления.

- •20. Средняя арифметическая и гармоническая. Правила выбора формы средней.

- •Виды средней арифметической величины

- •Основные свойства средней арифметической

- •21. Структурные средние. Общая характеристика, анализ и интерпретация.

- •Квартиль

- •22.Понятие вариации и её значение в экономических исследованиях.

- •23.Абсолютные показатели вариации.

- •24. Относительные показатели вариации.

- •25. Виды дисперсий и правила их сложения.

- •26. Понятие о закономерностях распределения. Изучение формы распределения.

- •Понятие о закономерностях статического распределения.

- •27. Выборочное наблюдение. Понятие, характеристика, значение в соц-эк исследованиях.

- •28. Способы, методы и виды формирования выборочной совокупности.

- •29. Ошибки выборочного наблюдения. Средняя и предельная.

- •30. Определение оптимального объема выборки. (формулы в тетради)

- •31. Оценка результатов выборочного наблюдения и распространение их на генеральную совокупность.

- •32. Малая выборка: понятие, характеристика, сфера применения. Ошибка малой выборки.

- •33. Основные понятия корреляционного и регрессионного анализа.

- •34. Понятия взаимосвязанных признаков как предмет статистического изучения связи. Задачи статистического изучения связи.

- •35. Выбор формы управления регрессии для анализа экономических явлений. Оценка параметров управления регрессии.

- •Оценка параметров уравнения регреcсии. Пример

- •36. Статистические характеристики тесноты связи: эмпирическое корреляционное отношение, линейный коэффициент корреляции, коэффициент детерминации.

- •37. Методы изучения связи альтернативных признаков. Коэффициенты ассоциации, контингенции и взаимной сопряженности. Анализ и интерпретация.

- •38.Изучение зависимости между количественными признаками. Ранговые показатели связи.

- •39. Понятие и классификация рядов динамики

- •40. Правила построения ряда динамики.

- •41. Показатели анализа ряда динамики

- •42. Структура ряда динамики. Проверка ряда на наличие тренда.

- •43. Анализ сезонных колебаний.

- •44. Элементы прогнозирования и интерполяции.

- •45. Понятие об индексах. Значение индексов в анализе социально- экономических явлений.

- •46. Общий порядок построения индексов. Отчётные и базисные данные. Сопоставление с базой как основа индексного анализа, формы (относительная и разностная) этого сопоставления.

- •47. Индексы индивидуальные и общие. Их классификация.

- •48. Сводные индексы в агрегатной и средних формах.(тетрадь) Сводные индексы

- •Агрегатные индексы

- •49. Индексы среднего уровня вторичного признака (индекс переменного состава, индекс постоянного состава, индекс структурных сдвигов). Их взаимосвязь, порядок построения, соц-эк смысл.

- •5. Индексы постоянного состава и их практическое применение

- •6. Индекс структурных сдвигов

- •50. Важные экономические индексы, их взаимосвязи.

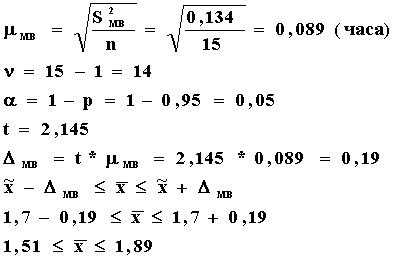

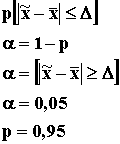

32. Малая выборка: понятие, характеристика, сфера применения. Ошибка малой выборки.

В процессе статистических исследований нередко приходится ограничивать объем

выборки, особенно в тех случаях, когда исследования единиц совокупности

приводит к их разрушению.

В статистике доказано, что даже в выборке весьма малого объема (20-30, а иногда

4-5 единиц) позволяют получить приемлемые для анализа результаты. Проблема

малых выборок была решена в 1908г. английским статистиком У.Гассетом (псевдоним

Студент). Он сумел определить зависимость между величиной доверительного

коэффициента t, а так же численностью малой выборки n с одной стороны, и

вероятностью нахождения ошибки выборки в заданных пределах с другой стороны.

Эта зависимость получила название – распределение Стьюдента. Для

упрощения расчетов имеются специальные таблицы значений критериев Стьюдента

(стр. 372 «Практикума по теории статистики»).

n=n-1 – число степеней свободы.

Малая выборка определяется по формуле

|

|

|

|

||

|

|

|

|

||

|

|

|

|

|

|

|

|

Средняя ошибка малой выборки

|

Дисперсия малой выборки

- число степеней свободы.

Пример: Ежедневные затраты времени 15 работников на поездки туда и

обратно составляют в среднем 1,7 часа. Определить пределы, в которых находится

среднее время поездки на работу и обратно.

|

n=15

![]() =1,7

часа

=1,7

часа

S2=0,134

P=0,95

33. Основные понятия корреляционного и регрессионного анализа.

Исследуя природу, общество, экономику, необходимо считаться со взаимосвязью наблюдаемых процессов и явлений. При этом полнота описания так или иначе определяется количественными характеристиками причинно-следственных связей между ними. Оценка наиболее существенных из них, а также воздействия одних факторов на другие является одной из основных задач статистики.

Формы проявления взаимосвязей весьма разнообразны. В качестве двух самых общих их видов выделяют функциональную (полную) икорреляционную (неполную) связи. В первом случае величине факторного признака строго соответствует одно или несколько значений функции. Достаточно часто функциональная связь проявляется в физике, химии. В экономике примером может служить прямо пропорциональная зависимость между производительностью труда и увеличением производства продукции.

Корреляционная связь (которую также называют неполной, или статистической) проявляется в среднем, для массовых наблюдений, когда заданным значениям зависимой переменной соответствует некоторый ряд вероятных значений независимой переменной. Объяснение тому – сложность взаимосвязей между анализируемыми факторами, на взаимодействие которых влияют неучтенные случайные величины. Поэтому связь между признаками проявляется лишь в среднем, в массе случаев. При корреляционной связи каждому значению аргумента соответствуют случайно распределенные в некотором интервале значения функции.

Например, некоторое увеличение аргумента повлечет за собой лишь среднее увеличение или уменьшение (в зависимости от направленности) функции, тогда как конкретные значения у отдельных единиц наблюдения будут отличаться от среднего. Такие зависимости встречаются повсеместно. Например, в сельском хозяйстве это может быть связь между урожайностью и количеством внесенных удобрений. Очевидно, что последние участвуют в формировании урожая. Но для каждого конкретного поля, участка одно и то же количество внесенных удобрений вызовет разный прирост урожайности, так как во взаимодействии находится еще целый ряд факторов (погода, состояние почвы и др.), которые и формируют конечный результат. Однако в среднем такая связь наблюдается – увеличение массы внесенных удобрений ведет к росту урожайности.

По направлению связи бывают прямыми, когда зависимая переменная растет с увеличением факторного признака, и обратными, при которых рост последнего сопровождается уменьшением функции. Такие связи также можно назвать соответственно положительными и отрицательными.

Относительно своей аналитической формы связи бывают линейными инелинейными. В первом случае между признаками в среднем проявляются линейные соотношения. Нелинейная взаимосвязь выражается нелинейной функцией, а переменные связаны между собой в среднем нелинейно.

Существует еще одна достаточно важная характеристика связей с точки зрения взаимодействующих факторов. Если характеризуется связь двух признаков, то ее принято называть парной. Если изучаются более чем две переменные – множественной.

Указанные выше классификационные признаки наиболее часто встречаются в статистическом анализе. Но кроме перечисленных различают также непосредственные, косвенные и ложные связи. Собственно, суть каждой из них очевидна из названия. В первом случае факторы взаимодействуют между собой непосредственно. Для косвенной связи характерно участие какой-то третьей переменной, которая опосредует связь между изучаемыми признаками. Ложная связь – это связь, установленная формально и, как правило, подтвержденная только количественными оценками. Она не имеет под собой качественной основы или же бессмысленна.

По силе различаются слабые и сильные связи. Эта формальная характеристика выражается конкретными величинами и интерпретируется в соответствии с общепринятыми критериями силы связи для конкретных показателей.

В наиболее общем виде задача статистики в области изучения взаимосвязей состоит в количественной оценке их наличия и направления, а также характеристике силы и формы влияния одних факторов на другие. Для ее решения применяются две группы методов, одна из которых включает в себя методы корреляционного анализа, а другая – регрессионный анализ. В то же время ряд исследователей объединяет эти методы в корреляционно-регрессионный анализ, что имеет под собой некоторые основания: наличие целого ряда общих вычислительных процедур, взаимодополнения при интерпретации результатов и др.

Поэтому в данном контексте можно говорить о корреляционном анализе в широком смысле – когда всесторонне характеризуется взаимосвязь. В то же время выделяют корреляционный анализ в узком смысле – когда исследуется сила связи – и регрессионный анализ, в ходе которого оцениваются ее форма и воздействие одних факторов на другие.

Задачи собственно корреляционного анализа сводятся к измерению тесноты связи между варьирующими признаками, определению неизвестных причинных связей и оценке факторов оказывающих наибольшее влияние на результативный признак.

Задачи регрессионного анализа лежат в сфере установления формы зависимости, определения функции регрессии, использования уравнения для оценки неизвестных значении зависимой переменной.

Решение названных задач опирается на соответствующие приемы, алгоритмы, показатели, применение которых дает основание говорить о статистическом изучении взаимосвязей.

Следует заметить, что традиционные методы корреляции и регрессии широко представлены в разного рода статистических пакетах программ для ЭВМ. Исследователю остается только правильно подготовить информацию, выбрать удовлетворяющий требованиям анализа пакет программ и быть готовым к интерпретации полученных результатов. Алгоритмов вычисления параметров связи существует множество, и в настоящее время вряд ли целесообразно проводить такой сложный вид анализа вручную. Вычислительные процедуры представляют самостоятельный интерес, но знание принципов изучения взаимосвязей, возможностей и ограничений тех или иных методов интерпретации результатов является обязательным условием исследования.

Методы оценки тесноты связи подразделяются на корреляционные (параметрические) и непараметрические. Параметрические методы основаны на использовании, как правило, оценок нормального распределения и применяются в случаях, когда изучаемая совокупность состоит из величин, которые подчиняются закону нормального распределения. На практике это положение чаще всего принимается априори. Собственно, эти методы – параметрические – и принято называть корреляционными.

Непараметрические методы не накладывают ограничений на закон распределения изучаемых величин. Их преимуществом является и простота вычислений.