- •1. Основные понятия.

- •2.Схема дискретного канала.

- •3.Количественное опред инф. Энтропия

- •4.Оптимальное эффективное кодирование.

- •5.Матнматическая модель дискретного канала

- •6.Информационные характеристики дискретного канала .

- •7.Пропускная способность двоичного симметричного канала связи.

- •8.Вероятность ошибки при приеме одиночного символа в двоичном канале без памяти .

- •9.Статистические свойства случайных процессов .

- •10.Информационные характеристики источников аналоговых сообщений

1. Основные понятия.

Информация – это совокупность сведений о явлениях, процессах, предметах окружающего нас мира. Она позволяет выявить суть связей между этими явлениями, понять их и, как следствие, управлять ими. Физически информация содержится в сигналах в том числе и электрических. Упорядоченная совокупность сигналов, позволяющая выявить суть интересующего нас явления, называется сообщением об этом явлении.

Система связи состоит из:предатчика,линии связи,приемник,получатель инф

Чтобы сигнал от источника информации мог попасть к потребителю, между ними должна быть установлена связь – система средств для организации обмена информацией между абонентами.Тот абонент, который передает инф явл источник информации. Частное техническое решение, позволяющее организовывать эту связь, называется каналом связи.Основой любого канала электросвязи является линия связи – направляющая система, среда распространения электрических сигналов, позволяющая канализировать электромагнитные волны определенной структуры, уровня и частотного диапазона в заданном направлении.

Основная проблема связи-помехи. Основная доля помех возникает в линиях связи.

Модуляция - изменение информативных параметров некоторых первичных физических процессов (сигналов), рассматриваемых как носители информации, в соответствии с передаваемой (включаемой и сигнал) информацией.

Демодуляция – восстановление величин, вызвавших изменение параметров носителей при модуляции. Выполняется на принимающей стороне при известных условиях модуляции на передающей стороне.

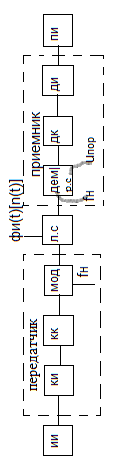

2.Схема дискретного канала.

и и-источник

инф(дискретный ист)

и-источник

инф(дискретный ист)

Он регистрирует (фиксирует) информацию на каком-либо носителе, в результате чего образуется сигнал. Может выполнять в целом первую фазу обращения информации.

ки-кодер ист (кодирует, борются с избыточностью)

кк-кодер канала (борются с помехами)

мод- модулятор сигнала. Изменяет информационные характеристики сигналов-носителей, накладывая на него дискретный сигнал

фи-возд помех n(t)

дем-демодулирует демодулятор. Выполняет выделение дискретного сигнала из сигнала-носителя

р.с-ре.схема

дк-декодер канала декодер канала. Выявляет и/или исправляет ошибки, допущенные при передаче сигнала по линии связи ЛС

ди-декодор источника декодер источника. Декодирует эффективные коды

пи-получатель инф

Fн-несущая частота

Uпор-напряж порога

3.Количественное опред инф. Энтропия

Истич инф бывают:

-аналоговые(голосовое сообщ,видеоизобр)

-дискретными(светофор,клавиатура)

Для того чтоб ист инф был задан,необх указать:

-алфавит источника {A}={a1,a2,a3…..am},

Где а-символ,1…m-объем алф

-объем алф ma

-вер появл символа на выходе источ P(ai)

Можно вычислить:

-кол-во инф в символе Y(ai)

Формула Шеннона для канала без помех.

![]() (бит)

(бит)

Бит - один бит инф содержаться в сообщ о том, что произошло одно из двух равновероятных событий.

Энтропия H(a)-источника или алфавита.

H(a)-ср кол-во инф приход на один символ сообщения.

H-основ инф хар источ информации.

Н зависит: для

источника без помех![]() (бит/символ)-сред

арифм кол-во инф в каждом символе.

(бит/символ)-сред

арифм кол-во инф в каждом символе.

Энтропия обладает следующими свойствами:

-энтропия есть непрерывная функция вероятностей появления символов, т.е. для любого распределения вероятностей выбора символов из алфавита существует свое значение энтропии;

-энтропия источника дискретных сообщений есть величина вещественная, ограниченная, положительная;

-энтропия равна нулю, если с вероятностью единица всегда выбирается один и тот же символ. В этом случае неопределенность в поведении источника сообщений отсутствует;

-энтропия максимальна, если все символы источника появляются независимо и с одинаковой вероятностью:

. Чтобы учесть статистические связи между символами сообщений вводят понятие условной энтропии

![]()

![]() -вер

появл символа

-вер

появл символа ![]() ,

при условии что перед нип появл символ

,

при условии что перед нип появл символ

![]() .

.

Количественно эти потери энтропии характеризуются коэффициентом избыточности

![]()

Под избыточностью понимается наличие в сообщении большего числа букв или в кодовой комбинации большего числа элементов, чем это минимально необходимо для передачи содержащегося в них количества информации