- •160001, Г. Вологда, ул. Челюскинцев, 3.

- •Предисловие

- •Введение

- •Раздел 1. Теория информации

- •Глава 1. Исходные понятия информатики

- •1.1. Начальные определения

- •1.2. Формы представления информации

- •1.3. Преобразование сообщений

- •Контрольные вопросы и задания

- •Глава 2. Понятие информации в теории Шеннона

- •2.1. Понятие энтропии

- •2.1.1. Энтропия как мера неопределенности

- •2.1.2. Свойства энтропии

- •2.1.3. Условная энтропия

- •2.2. Энтропия и информация

- •2.3. Информация и алфавит

- •Контрольные вопросы и задания

- •Глава 3. Кодирование символьной информации

- •3.1. Постановка задачи кодирования, Первая теорема Шеннона

- •3.2. Способы построения двоичных кодов

- •3.2.1. Алфавитное неравномерное двоичное кодирование сигналами равной длительности. Префиксные коды

- •3.2.2. Равномерное алфавитное двоичное кодирование. Байтовый код

- •3.2.3. Алфавитное кодирование с неравной длительностью элементарных сигналов. Код Морзе

- •3.2.4. Блочное двоичное кодирование

- •Контрольные вопросы и задания

- •Глава 4. Представление и обработка чисел в компьютере

- •4.1. Системы счисления

- •4.2. Представление чисел в различных системах счисления

- •4.2.1. Перевод целых чисел из одной системы счисления в другую

- •4.2.2. Перевод дробных чисел из одной системы счисления в другую

- •4.2.3. Понятие экономичности системы счисления

- •4.2.4. Перевод чисел между системами счисления 2 ↔ 8 ↔ 16

- •4.2.5. Преобразование нормализованных чисел

- •4.3. Кодирование чисел в компьютере и действия над ними

- •4.3.1. Кодирование и обработка в компьютере целых чисел без знака

- •4.3.2. Кодирование и обработка в компьютере целых чисел со знаком

- •4.3.3. Кодирование и обработка в компьютере вещественных чисел

- •Контрольные вопросы и задания

- •Глава 5. Передача информации

- •5.1. Общая схема передачи информации в линии связи

- •5.2. Характеристики канала связи

- •5.3. Влияние шумов на пропускную способность канала

- •5.4. Обеспечение надежности передачи и хранения информации

- •5.4.1. Постановка задачи

- •5.4.2. Коды, обнаруживающие ошибку

- •5.4.3. Коды, исправляющие одиночную ошибку

- •5.5. Способы передачи информации в компьютерных линиях связи

- •5.5.1. Канал параллельной передачи

- •5.5.2. Последовательная передача данных

- •5.5.3. Связь компьютеров по телефонным линиям

- •Контрольные вопросы и задания

- •Глава 6. Хранение информации

- •6.1. Классификация данных. Проблемы представления данных

- •6.2. Представление элементарных данных в озу

- •6.3. Структуры данных и их представление в озу

- •6.3.1. Классификация и примеры структур данных

- •6.3.2. Понятие логической записи

- •6.3.3. Организация структур данных в озу

- •6.4. Представление данных на внешних носителях

- •6.4.1. Иерархия структур данных на внешних носителях

- •6.4.2. Особенности устройств хранения информации

- •Контрольные вопросы и задания

- •Раздел 2. Алгоритмы. Модели. Системы

- •Глава 7. Элементы теории алгоритмов

- •7.1. Нестрогое определение алгоритма

- •7.2. Рекурсивные функции

- •7.3. Алгоритм как абстрактная машина

- •7.3.1. Общие подходы

- •7.3.2. Алгоритмическая машина Поста

- •7.3.3. Алгоритмическая машина Тьюринга

- •7.4. Нормальные алгоритмы Маркова

- •7.5. Сопоставление алгоритмических моделей

- •7.6. Проблема алгоритмической разрешимости

- •7.7. Сложность алгоритма

- •Контрольные вопросы и задания

- •Глава 8. Формализация представления алгоритмов

- •8.1. Формальные языки

- •8.1.1. Формальная грамматика

- •8.1.2. Способы описания формальных языков

- •8.2. Способы представления алгоритмов

- •8.2.1. Исполнитель алгоритма

- •8.2.2. Строчная словесная запись алгоритма

- •8.2.3. Графическая форма записи

- •8.2.4. Классификация способов представления алгоритмов

- •8.3. Структурная теорема

- •Контрольные вопросы и задания

- •Глава 9. Представление о конечном автомате

- •9.1. Общие подходы к описанию устройств, предназначенных для обработки дискретной информации

- •9.2. Дискретные устройства без памяти

- •9.3. Конечные автоматы

- •9.3.1. Способы задания конечного автомата

- •9.3.2. Схемы из логических элементов и задержек

- •9.3.3. Эквивалентные автоматы

- •Контрольные вопросы и задания

- •Глава 10. Модели и системы

- •10.1. Понятие модели

- •10.1.1. Общая идея моделирования

- •10.1.2. Классификация моделей

- •Модели структурные и функциональные

- •Модели натурные и информационные

- •Модели проверяемые и непроверяемые

- •Модели по назначению

- •10.1.3. Понятие математической модели

- •10.2. Понятие системы

- •10.2.1. Определение объекта

- •10.2.2. Определение системы

- •10.2.3. Формальная система

- •10.2.4. Значение формализации

- •10.3. Этапы решения задачи посредством компьютера

- •10.4. Об объектном подходе в прикладной информатике

- •Контрольные вопросы и задания

- •Заключение

- •Приложение а. Элементы теории вероятностей

- •А.1. Понятие вероятности

- •А.2. Сложение и умножение вероятностей

- •A.3. Условная вероятность

- •Контрольные вопросы и задания

- •Приложение б. Некоторые соотношения логики

- •Глоссарий

- •Список литературы

- •Содержание

- •Глава 4. Представление и обработка чисел в компьютере 45

- •Глава 5. Передача информации 69

- •Глава 6. Хранение информации 83

- •Раздел 2. Алгоритмы. Модели. Системы 98

- •Глава 7. Элементы теории алгоритмов 99

- •Глава 8. Формализация представления алгоритмов 120

- •Глава 9. Представление о конечном автомате 134

- •Глава 10. Модели и системы 147

1.2. Формы представления информации

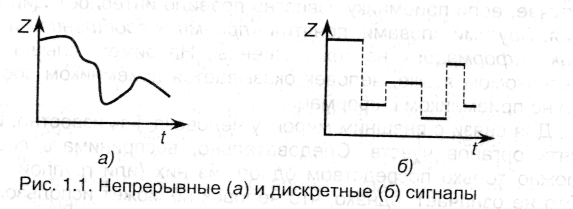

В предыдущем пункте было сказано, что передача информации производится с помощью сигналов, а самим сигналом является изменение некоторой характеристики носителя с течением времени. При этом в зависимости от особенностей изменения этой характеристики (т.е. параметра сигнала) с течением времени выделяют два типа сигналов: непрерывные и дискретные.

Сигнал называется непрерывным (или аналоговым), если его параметр может принимать любое значение в пределах некоторого интервала.

Если обозначить Z - значение параметра сигнала, a t - время, то зависимость 2(1) будет непрерывной функцией (рис.1.1,а).

Примерами непрерывных сигналов являются речь и музыка, изображение, показание термометра (параметр сигнала - высота столба спирта или ртути - имеет непрерывный ряд значений) и пр.

Сигнал называется дискретным, если его параметр может принимать конечное число значений в пределах некоторого интервала.

Пример дискретных сигналов представлен на рис. 1.1,б. Как следует из определения, дискретные сигналы могут быть описаны дискретным и конечным множеством значений параметров {Z}. Примерами устройств, использующих дискретные сигналы, являются часы (электронные и механические), цифровые измерительные приборы, книги, табло и пр.

Поскольку последовательность сигналов есть сообщение, качество прерывности-непрерывности сигналов переносится и на сообщение - существуют понятия «непрерывное сообщение» и «дискретное сообщение». Очевидно, что дискретным будет считаться сообщение, построенное из дискретных сигналов. Гораздо меньше оснований приписывать данное качество самой информации, поскольку информация - категория нематериальная и не может обладать свойством дискретности или непрерывности. С другой стороны, одна и та же информация, как уже было сказано, может быть представлена посредством различных сообщений, в том числе и отличающихся характером сигналов. Например, речь, которую слышим, можно записать в аналоговом виде с помощью магнитофона, а можно и законспектировать посредством дискретного набора букв. По этой причине в информатике существуют и используются сочетания «непрерывная информация» и «дискретная информация». Их нужно понимать только как сокращение полных фраз: «информация, представленная посредством непрерывных сигналов» и «информация, представленная посредством дискретных сигналов» - именно в таком контексте эти понятия будут использоваться в дальнейшем изложении. Поэтому когда заходит речь о видах информации, правильнее говорить о формах ее представления в сообщении или о видах сообщений.

Принципиальным и важнейшим различием непрерывных и дискретных сигналов является то, что дискретные сигналы можно обозначить, т.е. приписать каждому из конечного чисел возможные значения сигнала знак, который будет отличать данный сигнал от другого

Знак - это элемент некоторого конечного* множества отличных друг от друга сущностей.

* Теоретически можно было бы обойтись без требования конечности, однако, это не имело бы никакого практического значения, поскольку за конечное время всегда можно передать только сообщения, построенные из конечного числа знаков.

Природа знака может любой - жест, рисунок, буква, сигнал светофора, определенный звук и т.д. Природа знака определяется носителем сообщения и формой представления информации в сообщении.

Вся совокупность знаков, используемых для представления дискретной информации, называется набором знаков. Таким образом , набор есть дискретное множество знаков.

Набор знаков, в котором установлен порядок их следования, называется алфавитом.

Следовательно, алфавит - это упорядоченная совокупность знаков. Порядок следования знаков в алфавите называется лексикографическим. Благодаря этому порядку между знаками устанавливаются отношения «больше-меньше»: для двух знаков ξ и ψ принимается, что ξ < ψ, если порядковый номер у ξ в алфавите меньше, чем у ψ.

Примером алфавита может служить совокупность арабских цифр 0,1...9 - с его помощью можно записать любое целое число в системах счисления от двоичной до десятичной. Если к этому алфавиту добавить знаки «+» и «-», то сформируется набор знаков, применимый для записи любого целого числа, как положительного, так и отрицательного; правда, этот набор нельзя считать алфавитом, поскольку в нем не определен порядок следования знаков.. Наконец, если добавить знак разделителя разрядов («.» или «,»), то такой алфавит позволит записать любое вещественное число.

Поскольку при передаче сообщения параметр сигнала должен меняться, очевидно, что минимальное количество различных его значений равно двум и, следовательно, алфавит содержит минимум два знака - такой алфавит называется двоичным. Верхней границы числа знаков в алфавите не существует; примером могут служить иероглифы, каждый из которых обозначает целое понятие, и общее их количество исчисляется десятками тысяч.

Знаки, используемые для обозначения фонем человеческого языка, называются буквами, а их совокупность - алфавитом языка.

Сами по себе знак или буква не несут никакого смыслового содержания. Однако такое содержание им может быть приписано - в этом случае знак будет называться символом. Например, массу в физике принято обозначать буквой т - следовательно, т является символом физической величины «масса» в формулах. Другим примером символов могут служить пиктограммы, обозначающие в компьютерных программах объекты или действия.

Таким образом, понятия «знак», «буква» и «символ» нельзя считать тождественными, хотя весьма часто различия между ними не проводят, поэтому в информатике существуют понятия «символьная переменная», «кодировка символов алфавита», «символьная информация» - во всех приведенных примерах вместо термина «символьный» корректнее было бы использовать «знаковый» или «буквенный».

Представляется важным еще раз подчеркнуть, что понятия знака и алфавита можно отнести только к дискретным сообщениям.