- •160001, Г. Вологда, ул. Челюскинцев, 3.

- •Предисловие

- •Введение

- •Раздел 1. Теория информации

- •Глава 1. Исходные понятия информатики

- •1.1. Начальные определения

- •1.2. Формы представления информации

- •1.3. Преобразование сообщений

- •Контрольные вопросы и задания

- •Глава 2. Понятие информации в теории Шеннона

- •2.1. Понятие энтропии

- •2.1.1. Энтропия как мера неопределенности

- •2.1.2. Свойства энтропии

- •2.1.3. Условная энтропия

- •2.2. Энтропия и информация

- •2.3. Информация и алфавит

- •Контрольные вопросы и задания

- •Глава 3. Кодирование символьной информации

- •3.1. Постановка задачи кодирования, Первая теорема Шеннона

- •3.2. Способы построения двоичных кодов

- •3.2.1. Алфавитное неравномерное двоичное кодирование сигналами равной длительности. Префиксные коды

- •3.2.2. Равномерное алфавитное двоичное кодирование. Байтовый код

- •3.2.3. Алфавитное кодирование с неравной длительностью элементарных сигналов. Код Морзе

- •3.2.4. Блочное двоичное кодирование

- •Контрольные вопросы и задания

- •Глава 4. Представление и обработка чисел в компьютере

- •4.1. Системы счисления

- •4.2. Представление чисел в различных системах счисления

- •4.2.1. Перевод целых чисел из одной системы счисления в другую

- •4.2.2. Перевод дробных чисел из одной системы счисления в другую

- •4.2.3. Понятие экономичности системы счисления

- •4.2.4. Перевод чисел между системами счисления 2 ↔ 8 ↔ 16

- •4.2.5. Преобразование нормализованных чисел

- •4.3. Кодирование чисел в компьютере и действия над ними

- •4.3.1. Кодирование и обработка в компьютере целых чисел без знака

- •4.3.2. Кодирование и обработка в компьютере целых чисел со знаком

- •4.3.3. Кодирование и обработка в компьютере вещественных чисел

- •Контрольные вопросы и задания

- •Глава 5. Передача информации

- •5.1. Общая схема передачи информации в линии связи

- •5.2. Характеристики канала связи

- •5.3. Влияние шумов на пропускную способность канала

- •5.4. Обеспечение надежности передачи и хранения информации

- •5.4.1. Постановка задачи

- •5.4.2. Коды, обнаруживающие ошибку

- •5.4.3. Коды, исправляющие одиночную ошибку

- •5.5. Способы передачи информации в компьютерных линиях связи

- •5.5.1. Канал параллельной передачи

- •5.5.2. Последовательная передача данных

- •5.5.3. Связь компьютеров по телефонным линиям

- •Контрольные вопросы и задания

- •Глава 6. Хранение информации

- •6.1. Классификация данных. Проблемы представления данных

- •6.2. Представление элементарных данных в озу

- •6.3. Структуры данных и их представление в озу

- •6.3.1. Классификация и примеры структур данных

- •6.3.2. Понятие логической записи

- •6.3.3. Организация структур данных в озу

- •6.4. Представление данных на внешних носителях

- •6.4.1. Иерархия структур данных на внешних носителях

- •6.4.2. Особенности устройств хранения информации

- •Контрольные вопросы и задания

- •Раздел 2. Алгоритмы. Модели. Системы

- •Глава 7. Элементы теории алгоритмов

- •7.1. Нестрогое определение алгоритма

- •7.2. Рекурсивные функции

- •7.3. Алгоритм как абстрактная машина

- •7.3.1. Общие подходы

- •7.3.2. Алгоритмическая машина Поста

- •7.3.3. Алгоритмическая машина Тьюринга

- •7.4. Нормальные алгоритмы Маркова

- •7.5. Сопоставление алгоритмических моделей

- •7.6. Проблема алгоритмической разрешимости

- •7.7. Сложность алгоритма

- •Контрольные вопросы и задания

- •Глава 8. Формализация представления алгоритмов

- •8.1. Формальные языки

- •8.1.1. Формальная грамматика

- •8.1.2. Способы описания формальных языков

- •8.2. Способы представления алгоритмов

- •8.2.1. Исполнитель алгоритма

- •8.2.2. Строчная словесная запись алгоритма

- •8.2.3. Графическая форма записи

- •8.2.4. Классификация способов представления алгоритмов

- •8.3. Структурная теорема

- •Контрольные вопросы и задания

- •Глава 9. Представление о конечном автомате

- •9.1. Общие подходы к описанию устройств, предназначенных для обработки дискретной информации

- •9.2. Дискретные устройства без памяти

- •9.3. Конечные автоматы

- •9.3.1. Способы задания конечного автомата

- •9.3.2. Схемы из логических элементов и задержек

- •9.3.3. Эквивалентные автоматы

- •Контрольные вопросы и задания

- •Глава 10. Модели и системы

- •10.1. Понятие модели

- •10.1.1. Общая идея моделирования

- •10.1.2. Классификация моделей

- •Модели структурные и функциональные

- •Модели натурные и информационные

- •Модели проверяемые и непроверяемые

- •Модели по назначению

- •10.1.3. Понятие математической модели

- •10.2. Понятие системы

- •10.2.1. Определение объекта

- •10.2.2. Определение системы

- •10.2.3. Формальная система

- •10.2.4. Значение формализации

- •10.3. Этапы решения задачи посредством компьютера

- •10.4. Об объектном подходе в прикладной информатике

- •Контрольные вопросы и задания

- •Заключение

- •Приложение а. Элементы теории вероятностей

- •А.1. Понятие вероятности

- •А.2. Сложение и умножение вероятностей

- •A.3. Условная вероятность

- •Контрольные вопросы и задания

- •Приложение б. Некоторые соотношения логики

- •Глоссарий

- •Список литературы

- •Содержание

- •Глава 4. Представление и обработка чисел в компьютере 45

- •Глава 5. Передача информации 69

- •Глава 6. Хранение информации 83

- •Раздел 2. Алгоритмы. Модели. Системы 98

- •Глава 7. Элементы теории алгоритмов 99

- •Глава 8. Формализация представления алгоритмов 120

- •Глава 9. Представление о конечном автомате 134

- •Глава 10. Модели и системы 147

5.2. Характеристики канала связи

Ограничим дальнейшее рассмотрение каналами связи, передача сообщений по которым осуществляется за счет электрических импульсов - с практической точки зрения, а также для компьютерных линий связи эти каналы представляют наибольший интерес.

Ширина полосы пропускания

Любой преобразователь, работа которого основана на использовании колебаний (электрических или механических) может формировать и пропускать сигналы из ограниченной области частот. Пример с телефонной связью приводился выше. То же следует отнести и к радио и телевизионной связи - весь частотный спектр разделен на диапазоны (ДВ, СВ, KBI, КВII, УКВ, ДМВ), в пределах которых каждая станция занимает свой поддиапазон, чтобы не мешать вещанию других.

Интервал частот, используемый данным каналом связи для передачи сигналов, называется шириной полосы пропускания.

Для построения теории важна не сама ширина полосы пропускания, а максимальное значение частоты из данной полосы (vm), поскольку именно ей определяется возможная скорость передачи информации по каналу.

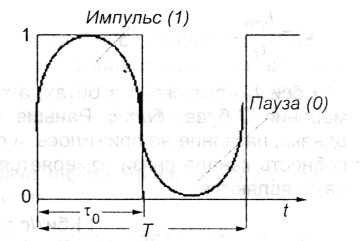

Длительность элементарного импульса может быть определена из следующих соображений. Если параметр сигнала меняется синусоидально, то, как видно из рисунка, за один период колебания Т сигнал будет иметь одно максимальное значение и одно минимальное.

Если аппроксимировать синусоиду прямоугольными импульсами и сместить начало отсчета на уровень минимального значения, получатся, что сигнал принимает всего два значения - максимальное (обозначим его «1») - импульс, и минимальное (можно обозначить «0») - пауза. Импульс и паузу можно считать элементарными сигналами; при выбранной аппроксимации их длительности, очевидно одинаковы и равны:

![]()

Если же импульсы порождаются тактовым генератором, имеющим частоту vm, то

![]()

Таким образом, каждые τ0 секунд можно передавать импульс или паузу, связывая с их последовательностью определенные коды. Использовать сигналы большей длительности, чем τ0, в принципе, возможно (например, 2τ0) - это не приведет к потере информации, хотя снизит скорость ее передачи по каналу. Использование же сигналов более коротких, чем τ0, может привести к информационным потерям, поскольку сигналы тогда будут принимать какие-то промежуточные значения между минимальным и максимальным, что затруднит их интерпретацию.

Таким образом, vm определяет длительность элементарного сигнала τ0, используемого для передачи сообщения.

Пропускная способность канала связи

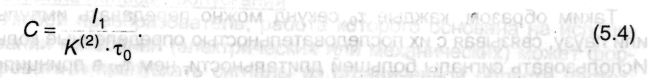

Если с передачей одного импульса связано количество информации Iiтр: а передается оно за время τ0, отношение Iiтр к τ0, очевидно, будет отражать среднее количество информации, передаваемое по каналу за единицу времени - эта величина является характеристикой канала связи и называется пропускной способностью канала С:

![]()

Если Iiтр выражено в битах, а τ0 - в секундах, то единицей измерения С будет бит/с. Раньше такая единица называлась бод, однако, название не прижилось, и по этой причине пропускная способность канала связи измеряется в бит/с. Производными единицами являются:

Величину Iimp в (5.3) можно установить из следующих соображений: если первичный алфавит содержит N знаков с вероятностями появления их в сообщении рi, то по формуле Шеннона (2.17) можно найти среднюю информацию на знак первичного алфавита I1, для представления которого используется двоичный код длиной К(2), то, очевидно,

![]()

При подстановке в (5.3) получаем:

Пример 5.1

Первичный алфавит состоит из трех знаков с вероятностями p1 = 0,2; р2 = 0,7; р3 = 0,1. Для передачи по каналу без помех используются равномерный двоичный код. Частота тактового генератора 500 Гц.

Какова пропускная способность канала?

Число знаков первичного алфавита N = 3. Из (2.17)

I1 = - 0,2∙log20,2 - 0,7∙log20,7 - 0,1log20,1 = 1,16 бит,

К(2) ≥ log2 N = 2. Следовательно, из (5.3) и (5.4) получаем:

![]()

Скорость передачи информации.

Пусть по каналу связи за время t передано количество информации I. Можно ввести величину, характеризующую быстроту передачи информации - скорость передачи информации J:

![]()

Размерностью J, как и С, является бит/с. Каково соотношение этих характеристик? Поскольку τ0 - минимальная длительность элементарного сигнала, очевидно, С соответствует максимальной скорости передачи информации по данной линии связи, т.е. J ≤ С или С = Jmax. Таким образом,

максимальная скорость передачи информации по каналу связи равна его пропускной способности.