- •Интеллектуальные средства измерений

- •Часть I Нейрокомпьютерные сети

- •1 Теоретические основы нейронных сетей

- •1.1 Обзор основных свойств и функций нейронных сетей

- •1.1.1 Свойства искусственных нейронных сетей

- •1.1.2 Обучение нейронных сетей

- •1.1.3 Обобщение

- •1.1.4 Абстрагирование

- •1.1.5 Применимость

- •1.2 Терминология, обозначения и схематическое изображение искусственных нейронных сетей

- •1.3 Структура нейроных сетей

- •1.4 Обучение искусственных нейронных сетей

- •1.4.1 Обзор основных свойств обучения

- •1.4.1.1 Цель обучения

- •1.4.1.2 Обучение с учителем

- •1.4.1.3 Обучение без учителя

- •1.4.1.4 Алгоритмы обучения

- •1.4.2 Процедура обратного распространения

- •1.4.2.1 Сетевые конфигурации

- •1.4.2.2 Многослойная сеть

- •1.4.2.3 Проход вперед

- •1.4.2.4 Обратный проход. Подстройка весов выходного слоя

- •1.4.2.5 Подстройка весов скрытого слоя

- •1.4.2.6 Добавление нейронного смещения

- •1.4.2.7 Импульс

- •1.4.2.8 Паралич сети

- •1.4.2.9 Локальные минимумы

- •1.4.2.10 Размер шага

- •1.4.2.11 Временная неустойчивость

- •1.4.3 Сети встречного распространения

- •1.4.3.1 Структура сети

- •1.4.3.2 Нормальное функционирование

- •1.4.3.2.1 Слои Кохоненна

- •1.4.3.2.2 Слой Гроссберга

- •1.4.3.3 Обучение слоя Кохонена

- •1.4.3.3.1 Предварительная обработка входных векторов

- •1.4.3.3.2 Выбор начальных значений весовых векторов

- •1.4.3.3.3 Режим интерполяции

- •1.4.3.3.4 Статистические свойства обученной сети

- •1.4.3.3 Обучение слоя Гроссберга

- •1.4.3.4 Сеть встречного распространения полностью

- •1.4.4 Стохастические методы

- •1.4.4.1 Использование обучения

- •1.4.4.2 Больцмановское обучение

- •1.4.5 Сети Хопфилда

- •1.4.5.1 Бинарные системы

- •1.4.5.2 Устойчивость

- •1.4.5.3 Ассоциативная память

- •1.4.5.4 Обобщенные сети

1.1.5 Применимость

Искусственные нейронные сети не являются панацеей. Они, очевидно, не годятся для выполнения таких задач, как начисление заработной платы. Похоже, однако, что им будет отдаваться предпочтение в большом классе задач распознавания образов, с которыми плохо или вообще не справляются обычные компьютеры. [4 ].

1.2 Терминология, обозначения и схематическое изображение искусственных нейронных сетей

К сожалению, для искусственных нейронных сетей еще нет опубликованных стандартов и устоявшихся терминов, обозначений и графических представлений. Однако, далее будут представлены наиболее общие обозначения элементов нейросети.

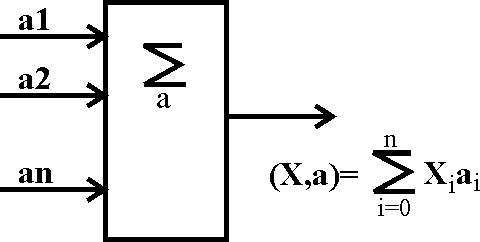

Адаптивный сумматор – вычисляет скалярное произведение вектора входного сигнала X на вектор параметров а.

Рисунок 1 – Адаптивный сумматор

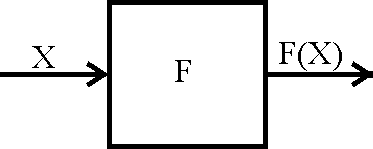

Нелинейный преобразователь сигнала – получает скалярный входной сигнал X и переводит его в F(X).

Рисунок 2 – Нелинейный преобразователь сигналов

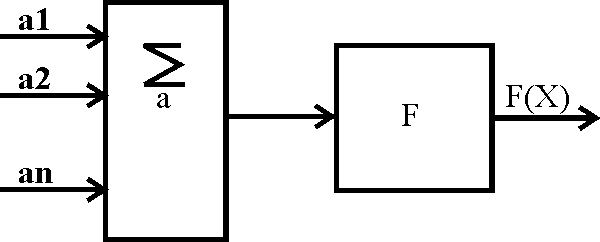

Последовательное соединение адаптивного сумматора с нелинейным преобразователем позволяет получить нейрон.

Рисунок 3 – Элементарный нейрон

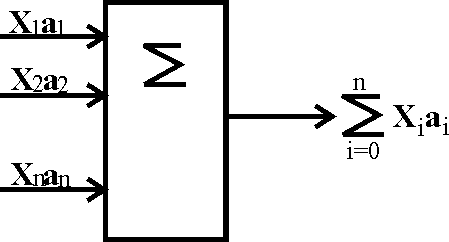

В ряде задач оказывается полезным разложить адаптивный сумматор на набор из n параллельных линейных связей и следующий за ними простой сумматор. Таки образом, появляется ещё один термин.

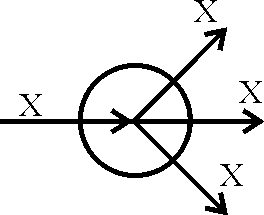

Линейная связь – имеет один настраиваемый параметр a, получает на входе скалярный сигнал X и выдаёт на выходе произведение aX.

![]()

Рисунок 4 – Линейная связь

У простого сумматора нет настраиваемых параметров. Он имеет векторный вход и выдаёт на выходе сумму координат входного сигнала.

Рисунок 5 - Сумматор

Точка ветвления служит для рассылки одного сигнала по нескольким адресам. Она получает скалярный входной сигнал X и передаёт его всем своим выходам.

Рисунок 6 – Точка ветвления

1.3 Структура нейроных сетей

Можно выделить две базовых структуры нейронных сетей:

слоистые сети;

полносвязные сети;

причём, слоистые сети можно охарактеризовать как частный случай полносвязных. Однако, сложившаяся практика разработки и использования этих сетей настолько самостоятельна, что при рассмотрении их можно разделить.

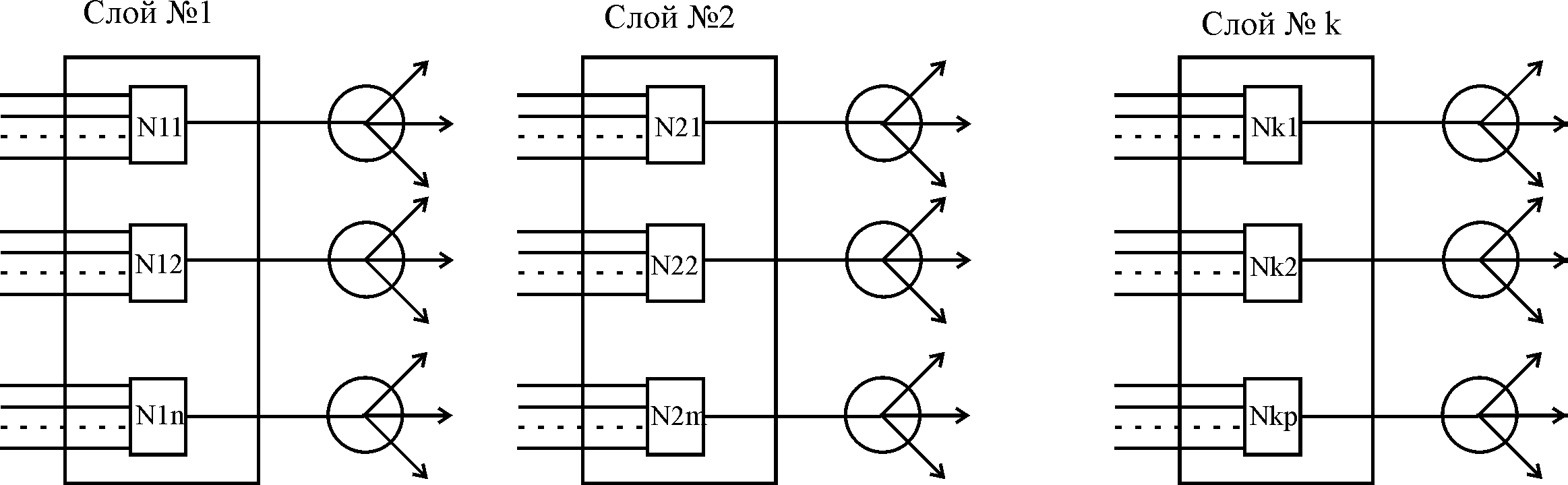

Слоистые сети – это сети, в которых нейроны расположены в несколько слоёв.

Рисунок 7 – Структура слоистых сетей

Нейроны первого слоя (рисунок) получают входные сигнлы, преобразуют их и через точки ветвления передают нейронам второго слоя. Затем срабатывает второй слой и т.д., до kго, который выдаёт выходные сигналы для использования. Если нет дополнительной оговорки, то каждый выходной сигнал i-го слоя подаётся на входы всех нейронов i+1 – го слоя. Число нейронов каждого слоя может быть любым и никак не связанным с числом нейронов в соседних слоях. Стандартный способ передачи сигналов – все нейроны первого слоя получают каждый входной сигнал. Особое распространение получили трёхслойные сети, в которых каждый слой имеет своё наименование: входной, скрытый, выходной.

В полносвязных сетях каждый нейрон передаёт свой выходной сигнал остальным всем нейронам, в том числе и самому себе. Выходными сигналами сети могут быть все или некоторые выходные сигналы нейронов сети после нескольких тактов функционирования этой сети. Все входные сигналы подаются всем нейронам.

Существенное различие между полносвязной и слоистой сетями возникает тогда, когда число тактов функционирования сети заранее не ограничено, так как слоистая сеть так функционировать не может, поскольку требует строго определённого количества тактов, равного числу слоёв.

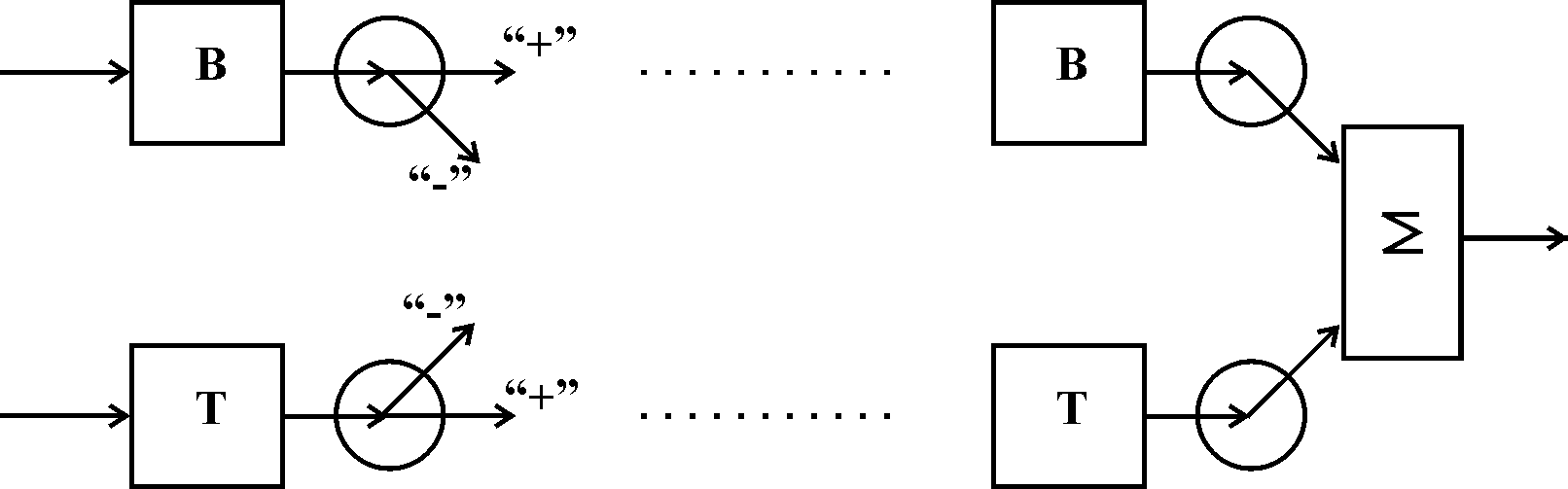

Монотонно слоистые сети – частный случай сетей с дополнительными условиями на связи и элементы. Каждый слой, кроме последнего – выходного, разбит на два блока: возбуждающий (В) и тормозящий (Т). Связи между блоками разделяются на два типа: возбуждающий (+) и тормозящий (-). Если от блока А к блоку С ведут только возбуждающие связи, то это означает, что любой выходной сигнал блока С является монотонной неубывающей функцией любого выходного сигнала блока А. Если же эти связи являются только тормозящими, то любой выходной сигнал блока С является монотонно невозрастающей функцией любого выходного сигнала блока А.

Рисунок 8 – Монотонно – слоистые сети

Организация связей в монотонных сетях следующая – к последнему слою от тормозящего блока идут тормозящие связи, а от возбуждающего блока – возбуждающие связи. Между собой возбуждающие и тормозящие блоки взаимодействуют так: от возбуждающего блока i-1 – го слоя идут возбуждающие связи к возбуждающему блоку i-го слоя и тормозящие к тормозящему блоку i-го слоя. От Т-блока i-1 – го слоя идут возбуждающие связи к Т-блоку i-го слоя и тормозящие к возбуждающему блоку i-го слоя.

Для элементов монотонных сетей необходима монотонная зависимость выходного сигнала элемента от параметров и входных сигналов.

Основное достоинство применения монотонных сетей заключается в том, что существует возможность для каждого параметра и промежуточного сигнала определить характер его влияния на каждый входной и промежуточный сигнал, основываясь только на месте элемента в структуре сети.

В идеале, и входные сигналы разбиваются на два подмножества, одно из которых подаётся нейронам возбуждающего слоя, второе – нейронам тормозящего слоя.

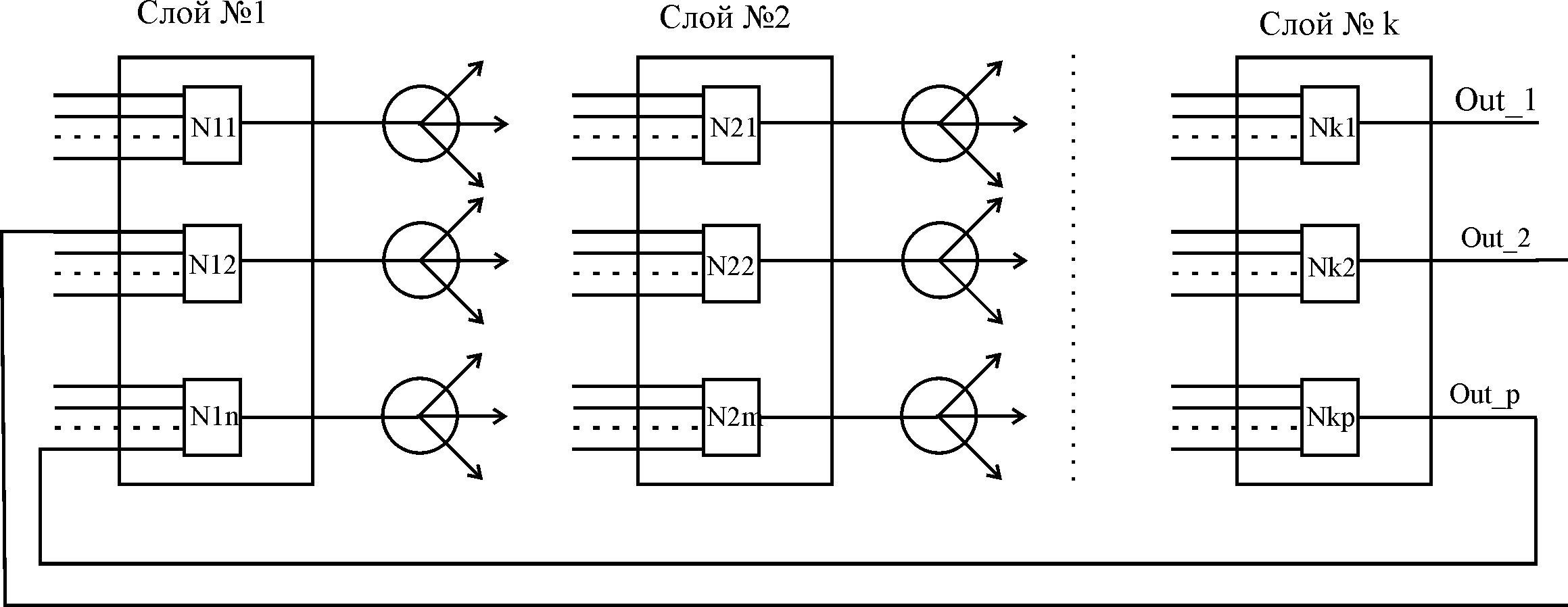

Слоисто – циклические сети

Слоисто – циклические сети отличаются тем, что слои замкнуты в кольцо – последний передаёт свои выходные сигналы первому. Все слои равноправны и могут как получать входные сигналы, так и выдавать выходные. Такие сети, до получения ответа, функционируют неограниченно долго – так же как и полносвязные.

Р исунок

9 – Слоисто – циклические сети

исунок

9 – Слоисто – циклические сети

Как слоистые, так и циклические и полносвязные сети могут функционировать периодически. В сетях с таким функционированием в начальный момент состояние всех нейронов одинаково , выходных сигналов нет, или они некорректны. Подаются входные сигналы, инициирующие действие сети – нулевой такт. Далее, входные сигналы могут подаваться на каждом такте функционирования, на каждом такте могут сниматься выходные сигналы. После k тактов цикл функционирования завершается и сеть возвращается к исходному состоянию, готовая к новому циклу. Однако чаще используется упрощённый вариант, когда в начале цикла преобразований подаются входные сигналы, а выходные сигналы снимаются только через k тактов, где k соответствует количеству слоёв.

К сетям непрерывного функционирования можно отнести только циклические и полносвязные сети. Однако, сети непрерывного функционирования наиболее близко соответствуют имеющимуся представлению о поведении живых существ.

Способы подачи входных сигналов в сеть

Стандартный способ подачи входных сигналов состоит в том, что они подаются на специальные входы элементов.

Другие варианты:

один сигнал – один нейрон – входные сигналы подаются сразу на нелинейные преобразователи, минуя сумматоры, которые используются только для обмена сигналами между нейронами. Данный способ уступает стандартному в том, что требует большего количества нейронов, вынуждает увеличивать число слоёв и тактов;

подача входных сигналов на те же сумматоры, которые служат обмена сигналами внутри сети;

параметрическая подача – выделенному массиву параметров (например веса связи, коэффициенты функции активации нейронов и т.д.) присваиваются значения, равные, или соответствующие входным сигналам.

Способы снятия выходных сигналов

Стандартный способ заключается в том, что некоторые нейроны объявляются выходными и их выходные сигналы в определённые моменты времени считаются входными сигналами сети в целом.

Другие способы:

аддитивное снятие с синапсов – на выход подаются сигналы, приходящие по выделенным связям, уже умноженные на соответствующие веса;

параметрическое снятие выходов – выходными сигналами считаются установившиеся значения выделенных параметров (например веса выделенных связей), т.е. процесс функционирования должен включать изменение выходных синапсов. В обычной постановки задачи это соответствует процессу обучения.