- •Интеллектуальный анализ данных

- •Изучение алгоритмов построения деревьев решений с целью выявления закономерностей

- •Типа «Если – То»

- •(Системы see5/c5 и tree analyzer)

- •Интеллектуальный анализ данных Изучение алгоритмов построения деревьев решений с целью выявления закономерностей типа «Если – То»

- •1 Теоретическая часть

- •1.1 Деревья решений

- •2 Построение деревьев решений — система See5/c5.0

- •Подготовка данных для See5

- •Файл имен переменных

- •Файл данных

- •Файлы тестовых данных (необязательные)

- •Файл стоимости

- •Интерфейс пользователя

- •Построение дерева решений

- •Преобразование дерева решений в набор правил

- •Усиление решения (Boosting)

- •Использование правил для принятия решений

- •Смягчение порогов

- •Дополнительные настройки алгоритма

- •Перекрестная проверка

- •Выборка из больших наборов данных

- •Учет стоимости различных ошибок классификации

- •Предсказанный класс, истинный класс: стоимость ошибки,

- •Детальная проверка и сохранение результатов

- •3 Задание на лабораторную работу

- •Правила подготовки данных для работы в системе See-5 Вариант 1

- •Правила подготовки данных для работы в системе See Вариант 2

- •Подготовка данных в системе Tree_Analyser

- •4 Отчет должен содержать

- •5 Вопросы для защиты

- •Список литературы

Министерство образования Российской Федерации

Уфимский государственный авиационный

технический университет

Кафедра технической кибернетики

Интеллектуальный анализ данных

Изучение алгоритмов построения деревьев решений с целью выявления закономерностей

Типа «Если – То»

(Системы see5/c5 и tree analyzer)

МЕТОДИЧЕСКИЕ УКАЗАНИЯ

к лабораторной работе № 3 по дисциплине

"Системы искусственного интеллекта"

Уфа 2004

Составители: Е.А.Макарова

Е.Ш.Закиева

Э.Р.Габдуллина

УДК 681.5:658.5

Изучение алгоритмов построения деревьев решений с целью выявления закономерностей типа «Если – То». Методические указания к лабораторным работам по курсам «Интеллектуальные автоматизированные системы» и "Моделирование ИАС" /Уфимск. гос. авиац. техн. ун-т; Сост.: Е.А.Макарова, Закиева Е.Ш., Габдуллина Э.Р.- Уфа, 2004.

Интеллектуальный анализ данных Изучение алгоритмов построения деревьев решений с целью выявления закономерностей типа «Если – То»

Цель работы: изучение алгоритмов и методики построения деревьев решений в системах See5/C5 и Tree Analyser с целью выявления закономерностей типа «Если – То»

1 Теоретическая часть

1.1 Деревья решений

Алгоритм CLS для построения деревьев решений (в системе ID3)

Пример. Дана матрица исходных признаков.

|

№кл. |

№об. |

X1 |

X2 |

X3 |

X4 |

X5 |

X6 |

X7 |

X8 |

X9 |

|

1 |

1 |

0 |

1 |

0 |

0 |

1 |

1 |

1 |

0 |

1 |

|

1 |

2 |

1 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

0 |

|

1 |

3 |

0 |

0 |

0 |

1 |

1 |

0 |

1 |

0 |

1 |

|

1 |

4 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

1 |

|

1 |

5 |

1 |

1 |

0 |

1 |

1 |

1 |

0 |

1 |

0 |

|

1 |

6 |

0 |

0 |

1 |

0 |

1 |

0 |

1 |

1 |

1 |

|

1 |

7 |

1 |

1 |

0 |

1 |

0 |

1 |

0 |

1 |

1 |

|

1 |

8 |

0 |

0 |

1 |

1 |

1 |

1 |

1 |

1 |

0 |

|

2 |

9 |

0 |

0 |

1 |

1 |

1 |

1 |

0 |

0 |

1 |

|

2 |

10 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

0 |

|

2 |

11 |

1 |

1 |

1 |

0 |

1 |

1 |

0 |

0 |

0 |

|

2 |

12 |

1 |

0 |

1 |

0 |

0 |

0 |

1 |

1 |

0 |

|

2 |

13 |

1 |

1 |

0 |

1 |

0 |

0 |

0 |

0 |

1 |

|

2 |

14 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

1 |

1 |

|

2 |

15 |

0 |

1 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

|

2 |

16 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

1 |

1 |

|

|

|

3/8 |

4/8 |

4/8 |

5/8 |

6/8 |

6/8 |

6/8 |

6/8 |

5/8 |

|

|

|

3/8 |

6/8 |

6/8 |

5/8 |

6/8 |

4/8 |

4/8 |

4/8 |

5/8 |

Алгоритм построения дерева решений для выявления правил классификации.

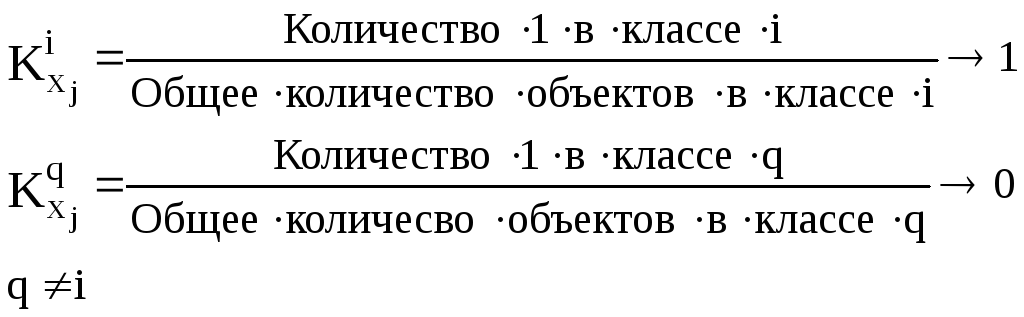

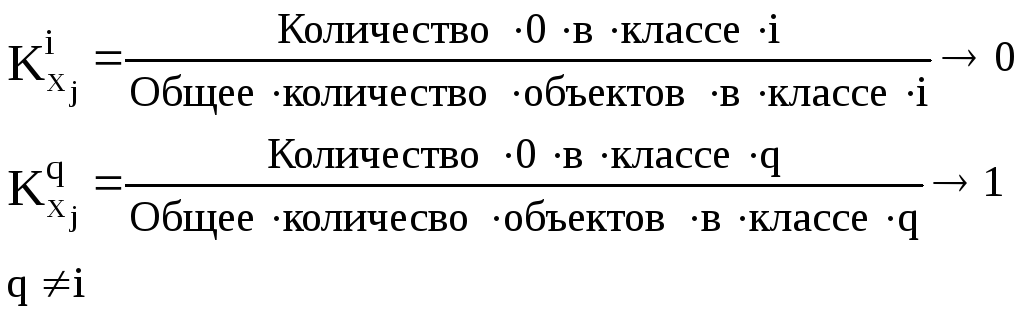

1. Определяется признак с наибольшей дискриминирующей силой.

![]()

Выбираем max Kxj=6/8=>x2 x3 x5 x6 x7 x8

Выбираем одно из них => x5

2.x5=0

|

№кл. |

№об. |

X1 |

X2 |

X3 |

X4 |

X5 |

X6 |

X7 |

X8 |

X9 |

|

1 |

2 |

1 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

0 |

|

1 |

7 |

1 |

1 |

0 |

1 |

0 |

1 |

0 |

1 |

1 |

|

2 |

12 |

1 |

0 |

1 |

0 |

0 |

0 |

1 |

1 |

0 |

|

2 |

13 |

1 |

1 |

0 |

1 |

0 |

0 |

0 |

0 |

1 |

|

2 |

14 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

1 |

1 |

|

2 |

16 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

1 |

1 |

|

|

|

2/2 |

1/2 |

1/2 |

2/2 |

0/2 |

2/2 |

1/2 |

2/2 |

1/2 |

|

|

|

2/4 |

3/4 |

3/4 |

3/4 |

0/4 |

0/4 |

3/4 |

3/4 |

3/4 |

Признак x6 обладает максимальной дискриминирующей силой, поскольку он принимает равные единице одинаковые значения в одном классе и равные нулю, в другом. Значения в разных классах должны быть разные, а внутри класса максимально одинаковые.

или

x6=1 №2,7–кл.1

x6=0 №12,13,14,15,16–кл.2

3.

|

|

X1 |

X2 |

X3 |

X4 |

X5 |

X6 |

X7 |

X8 |

X9 |

|

1 |

0 |

1 |

0 |

0 |

1 |

1 |

1 |

0 |

1 |

|

3 |

0 |

0 |

0 |

1 |

1 |

0 |

1 |

0 |

1 |

|

4 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

1 |

|

5 |

1 |

1 |

0 |

1 |

1 |

1 |

0 |

1 |

0 |

|

6 |

0 |

0 |

1 |

1 |

1 |

0 |

1 |

1 |

1 |

|

8 |

0 |

0 |

1 |

1 |

1 |

1 |

1 |

1 |

0 |

|

|

1/6 |

3/6 |

3/6 |

3/6 |

6/6 |

4/6 |

3/6 |

4/6 |

4/6 |

|

9 |

0 |

0 |

1 |

1 |

1 |

1 |

0 |

0 |

1 |

|

10 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

0 |

|

11 |

1 |

1 |

1 |

0 |

1 |

1 |

0 |

0 |

0 |

|

15 |

0 |

1 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

|

|

1/4 |

3/4 |

3/4 |

2/4 |

4/4 |

4/4 |

1/4 |

1/4 |

2/4 |

Выбираем x7

4.

|

|

X1 |

X2 |

X3 |

X4 |

X5 |

X6 |

X7 |

X8 |

X9 |

|

5 |

1 |

1 |

0 |

0 |

1 |

1 |

0 |

1 |

0 |

|

9 |

0 |

0 |

1 |

1 |

1 |

1 |

0 |

0 |

1 |

|

11 |

1 |

1 |

1 |

0 |

1 |

1 |

0 |

0 |

0 |

|

15 |

0 |

1 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

|

|

1/1 |

1/1 |

0/1 |

1/1 |

1/1 |

1/1 |

0/1 |

1/1 |

0/1 |

|

|

1/3 |

2/3 |

2/3 |

2/3 |

3/3 |

3/3 |

0/3 |

0/3 |

2/3 |

X8=1 №5

X8=0 №9,11,15

5. X7=1

|

|

X1 |

X2 |

X3 |

X4 |

X5 |

X6 |

X7 |

X8 |

X9 |

|

1 |

0 |

1 |

0 |

0 |

1 |

1 |

1 |

0 |

1 |

|

3 |

0 |

0 |

0 |

1 |

1 |

0 |

1 |

0 |

1 |

|

4 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

1 |

|

6 |

0 |

0 |

1 |

0 |

1 |

0 |

1 |

1 |

1 |

|

8 |

0 |

0 |

1 |

1 |

1 |

1 |

1 |

0 |

0 |

|

10 |

0 |

1 |

1 |

0 |

1 |

1 |

1 |

1 |

0 |

|

|

0/5 |

2/5 |

3/5 |

2/5 |

5/5 |

3/5 |

5/5 |

2/5 |

4/5 |

|

|

0/1 |

1/1 |

1/1 |

0/1 |

1/1 |

1/1 |

1/1 |

1/1 |

0/1 |

6. x9=1 №1,3,4,6 7. x9=0 выбираем x2

8. x2=0 №8

9

2,7 12,13,14,16 1,3,4,5,6,8 9,10,11,15

12,13,14,16

5,

9,11,15

1,3,4,6,8

10

2,7

9,10,15

8,10

5

1,3,4,6

8

10

Недостаток алгоритма: все признаки xj должны быть независимые.

Деревья решений - это один из методов автоматического анализа данных (Data Mining). Основные идей были заложены в работах Ховленда и Ханта в 50-60 годах.

Обобщенный алгоритм построения дерева решений.

Постановка задачи классификации

1-ая часть

Дано некоторое обучающее множество Т из n-объектов, каждое из которых характеризуется m-признаками. Дана принадлежность объектов к определенному классу.

Необходимо проинтерпретировать различия между классами различия между классами, то есть определить множество условий принадлежности объекта к определенному классу

2-ая часть

Даны результаты решения задачи в первой постановке и дан неизвестный объект.

Необходимо отнести объект к какому-либо классу.

Постановка задачи для построения дерева решений.

Дано то-же, что и в 1-ом варианте.

Необходимо построить дерево решений, позволяющее разбить все множество Т на подмножества, которые включают в себя лишь объекты одного класса.

Алгоритм предполагает принятие решения в следующих ситуациях:

множество Т содержит примеры, относящиеся к одному классу, тогда это множество Т–лист дерева.

Множество Т пустое, тогда Т это лист дерева. При этом необходимо обратится к другому множеству, отличному от Т. Например к множеству, ассоциированному с родителем.

Множество Т содержит объекты, относящиеся к разным классам. Тогда множество Т разбивается на некоторые другие подмножества. Для этого выбирается один из признаков, который может принимать 2 или более отличных друг от друга значений О1,О2,…Оl Множество Т разбивается на подмножества Т1,Т2,…Тl , где Тi содержит объекты, имеющие значения Оi для выбранного признака. Эта процедура продолжается рекурсивно до тех пор пока конечное множество не будет состоять из объектов одного класса.

Примечания.

Описанный подход имеет название ”разделения и захвата”. Построение сверху-вниз.

Так как в множестве Т было заданно начальное разбиение на классы, то этот алгоритм – обучение с учителем. Сам процесс–индуктивный.

Наиболее распространены 2 алгоритма деревьев решений:

CART–Classification and Regression Tree.

Это алгоритм построения бинарного дерева решений в виде дихотомической классификационной модели, где каждый узел дерева имеет только 2 потомка. Решает задачи классификации и регрессии

С 4.5–усовершенствованная версия ID3 (CLS)-Iterative Dichotomizer

В общем случае количество потомков каждого узла не ограничено.

Минус в том, что он не умеет работать с непрерывным целевым полем. Поэтому решает только задачи классификации.

Проблемы построения деревьев решений.

Определение критериев выбора классифицирующего признака.

1)теоретико-информационный

2)статистический (Gini используется в CART)

![]()

pj–вероятность появления класса j при использовании признака С

2.Определение правил остановки.

Для остановки процесса построения дерева могут быть использованы следующие правила:

1)задается ограничение на глубину (количество уровней)

2)задается условие не тривиальности разбиения.

Не тривиальность–наличие в полученных узла дерева решений такого количества объектов, которое не меньше заданного.

3)статистический метод.

3.Определение правил отсечения.

Так как деревья решений часто сложные, то они трудны для понимания. Ветвистые деревья имеют листья из малого количества объектов. Более предпочтительны деревья из малого количества узлов с листьями, которым соответствует значительное количество объектов.

Для отсечения применяют понятие точности распознавания–это количество правильно классифицированных объектов к общему количеству объектов обучающей выборки.

Ошибка распознавания– это количество не правильно классифицированных объектов к общему количеству объектов обучающей выборки.

Правила отсечения предполагают удаление тех ветвей деревьев, наличие которых приводит к увеличению ошибки. Отсечение идет снизу-вверх.

Точность правила–это доля случаев, когда правило подтверждается среди всех случаев его применения.

Полнота правила– это доля случаев, когда правило подтверждается среди всех случаев его применения.

Пример полного и точного правила: в прямоугольном треугольнике из трех углов имеются два, сумма которых составляет девяносто градусов.

Пример не полного и не точного правила: если у человека на щеке родинка, то он альбинос.

Алгоритм Кора.

Шаг 1. Анализируются все коньюнкции вида T1ΛT2Λ…Tl где Т–элементаные события (факты)

Шаг 2. Среди них выделяются те, которые характерны для одного класса (верны чаще, чем порог 1-), а для другого нет (верны реже, чем ε2). Если коньюнкции эквивалентны, то оставляется либо более короткая либо построенная ранее.

ε1 и ε2 подбираются такие, чтоб общее число коньюнкций не превосходило N.

Шаг 3. Для классификации нового объекта x подсчитывается ni–количество коньюнкций для каждого i-го класса, которые верны для объекта x. Принимается решение о принадлежности x к тому классу, для которого ni=max

Минус: трудоемкость, так как алгоритм основан на полном переборе.

Плюс: хорошо работает на небольших пространствах.

Достоинства и недостатки деревьев решений в целом.

Достоинства:

1.Наглядность и легкая интерпретируемость.

2.Быстрота процесса обучения.

3.Возможность генерации правил в областях, где трудно формализовать знания.

4.Извлечение правил на естественном языке.

5.Высокая точность прогноза.

В настоящее время среди всех методов Data Mining акцент смещен в сторону построения деревьев решений–хорошего инструмента для поддержки принятия решений.

Недостатки:

1. Существует проблема перебора вариантов за приемлемое время.

2.Не исключено, что найденные закономерности являются частными, а общие так и не найдены.