- •2.1. Решающие поверхности и дискриминантные функции

- •2.2. Линейные дискриминантные функции

- •2.2.1. Общая форма лдф

- •2.2.2. Классификация по минимуму расстояния

- •2.2.3. Линейная разделимость

- •2.3. Кусочно-линейные дискриминантные функции (клд)

- •2.3.1.Определение клд и правило ближайшего соседства

- •Случай 3.

- •2.4.Нелинейные дискриминантные функции

- •2.5.2. Емкость φ-машин для классификации образов.

- •2.6. Потенциальные функции как дф

Лекция №2

Непараметрические методы классификации

Алгоритмы распознавания образов часто классифицируют как параметрические и непараметрические. Для некоторых задач бывает априорно известно, что образы характеризуются рядом параметров. Параметрический подход может основываться на дискриминантных функциях, связанных с классом плотностей вероятностей, определяемых относительно малым числом параметров. С другой стороны, существуют другие классификаторы, в которых не делается никаких предположений о характеризующих параметрах. Несмотря на то, что параметризация дискриминантных функций (т.е. коэффициенты многомерных полиномов) используется в непараметрических методах, не предполагается соответствующей формы распределения. В этом состоит отличие от параметрического представления.

В параметрических методах обычно предполагается, что классы образов порождаются многомерными нормальными распределениями. Далее рассмотрим основы построения непараметрических классификаторов.

2.1. Решающие поверхности и дискриминантные функции

Как было показано в лекции 1, каждый образ отображается в виде точки в пространстве образов. Образы, относящиеся к разным классам, попадают в разные области в пространстве классов и, соответственно, могут быть разделены разделяющими поверхностями.

Разделяющие поверхности, называемые решающими поверхностями, могут быть формально определены как поверхности вn-мерном пространстве, которые используются, чтобы разделить известные образы на их соответствующие категории и используются для классификации неизвестных образов.

Такие поверхности можно определить как гиперплоскости, имеющие размерность n-1. Когдаn<1 решающая поверхность представляет собой точку, как показано на рис.2.1., где точка А разделяет классыw1иw2 и точка В — разделяющая точка дляw2иw3.

Рис. 2.1.

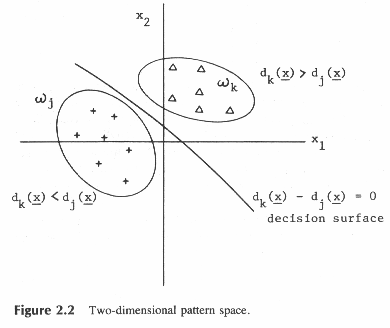

Когда n=2 решающая поверхность становится линией

w1*x1+w2*x2+w2=0

как показано на рис.2.2.

Рис. 2.2.

Когда n=3 — поверхность является плоскостью, дляn=4 или больше — это гиперплоскость

w1*x1+w2*x2+……….wк*xк+wк=0,

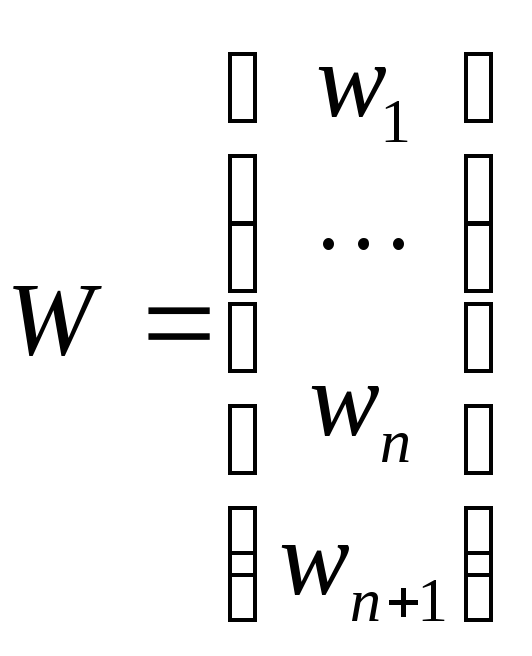

представимая в матричной форме как

Wт*Х=0,

где

,

,

,

,

где Wи Х называютсярасширенным весовым векторомирасширенным вектором образа.

Для удобства скаляр

wn+1добавлен в весовой вектор и,

соответственно, вектор![]()

![]() становится (n+1)-мерным

путем добавленияxn+1=1.

становится (n+1)-мерным

путем добавленияxn+1=1.

Это позволяет представить все линейные дискриминантные функции проходящими через начало координат.

Дискриминантная

функция — это функция d(![]() ),

которая определяет решающую поверхность.

Как показано на рис.2.2. dk(Х) и dj(Х)

— являются дискриминантными функциями

для образа Х в классах k и j соответственно.

),

которая определяет решающую поверхность.

Как показано на рис.2.2. dk(Х) и dj(Х)

— являются дискриминантными функциями

для образа Х в классах k и j соответственно.

d(Х)= dk(Х) - dj(Х)=0 будет уравнением, которое определяет поверхность, разделяющую классы k и j.

Мы можем сказать,

что dk(Х) > dj(Х)![]() x

x![]() wk

,

wk

,![]() j

j![]() k,j=1, 2, 3, …M.

k,j=1, 2, 3, …M.

Система для классификации образа Х показана на рис.2.3.

Рис.2.3. Схематическая диаграмма построения простой классификационной системы .

d1(Х) = d2(Х)

или

d(Х)= d1(Х) – d2(Х)=0

будет определять разделяющую гиперплоскость между двумя классами.

В общем случае для М различных классов требуется М(М-1)/2 разделяющих поверхностей, но некоторые из них избыточны. Вообще, для разделения М классов достаточно М-1 поверхностей.

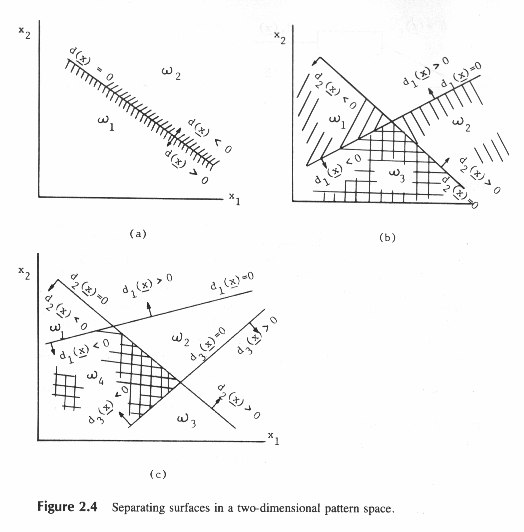

На рис.2.4. показан для двумерного пространства ряд разделяющих поверхностей как функции числа категорий, на которые надо классифицировать.

На рис.2.4а представлена решающая поверхность, разделяющая 2 категории.

Рис.2.4. достаточно понятен.

Здесь есть область d1(Х) < 0; d2(Х) < 0.

Она не принадлежит w1и w2 и может быть названа w3 .

То же самое имеет место на рис.2.4с.

Здесь области:

W1 : d1(Х) > 0;

W2 : d2(Х) > 0; d1(Х) < 0

W3 : d2(Х) < 0; d3(Х) > 0

Область:

d1(Х) < 0

d3(Х) < 0

![]() не определена

не определена

d2(Х) < 0

Пример:для М=2 классов найдем дискриминантную функцию для классификации двух образов на две категории

И

![]()

![]()

Возьмем d(Х) = Х1– ½Х2 – 2 и проверим

d(Х1) =w’*

![]() 1

= (1 – ½ – 2)

1

= (1 – ½ – 2)![]() = -3 < 0

= -3 < 0

d(Х2) =w’*

![]() 2

= (1 – ½ – 2)

2

= (1 – ½ – 2)![]() = +1 > 0

= +1 > 0

Т.е. d(Х) можно использовать как дискриминантную функцию.