- •1. Геофизические факторы, влияющие на распространение радиоволн. Дифракция и интерференция радиоволн вблизи земной поверхности.

- •Поверхностные слои атмосферы. Влияние атмосферы на распространение волн различных диапазонов. Рефракция. Поверхностные и пространственные волны.

- •Электромагнитные слои ионосферы. Влияние ионосферы на распределение волн различных диапазонов.

- •4. Классификация основных видов электросвязи.

- •5. Понятия сигнал, сообщение. Виды сигналов. Обобщенные математические модели сигналов. Характеристики сигнала: длительность, ширина спектра, отношение сигнал-шум. Объем сигнала.

- •6. Математические модели сигналов. Тестовые сигналы. Дельта–функция. Функция Хэвисайда.

- •7. Сигналы управления и связи. Исследование сигналов во временной и частотной области. База сигнала. Простые и сложные сигналы.

- •8. Понятие канала связи. Виды каналов. Классификация каналов. Характеристики канала связи: время действия, полоса пропускания, динамический диапазон. Емкость канала.

- •11. Структура системы передачи информации. Структурная схема. Кодер (декодер), модулятор (модулятор). Передача и прием сигнала

- •12. Помехи. Виды помех. Модели помех. Способы борьбы с помехами.

- •13. Многоканальная система связи. Структурная схема. Способы уплотнения каналов. Групповой тракт.

- •15. Дискретизация (квантование по времени). Частота дискретизации. Равномерная и неравномерная дискретизация. Выбор частоты дискретизации.

- •16. Сигнал с ограниченным спектром. Дискретизация на основе теоремы Котельникова. Функция отсчетов Котельникова.

- •17. Количество информации. Энтропия. Свойства энтропии. Измерение количества

- •19. Разложение по системе тригонометрических функций. Обобщённый ряд Фурье.

- •20. Модуляция. Несущий и модулирующий сигнал. Аналоговая и импульсная модуляция. Виды аналоговой и импульсной модуляции.

- •22. Угловая модуляция. Частотная модуляция. Фазовая модуляция. Спектр сигнала при угловой модуляции.

- •23. Импульсные сигналы. Последовательности видео- и радиоимпульсов. Их основные временные и частотные характеристики.

- •24. Амплитудно-импульсная модуляция (аим). Обобщенная схема построения аим сигнала. Аим 1-го и 2-го рода.

- •25. Импульсная модуляция. Широтно-импульсная модуляция.

- •26. Кодирование и декодирование информации. Знаки различного ранга. Алфавит и основание кода. Основные соотношения для простых кодов.

- •27. Кодирование. Натуральное кодирование. Эффективное кодирование.

- •28. Помехоустойчивое кодирование. Избыточность кода. Информационные и проверочные разряды. Классификация помехоустойчивых кодов: циклические, систематические и др.

- •30. Систематический код. Производящая и проверочная матрица. Уравнения проверки. Опознаватель. Исправляющий вектор.

- •31. Код Хэмминга. Уравнения проверки. Уравнения кодирования (определение проверочных разрядов).

- •32. Частотное уплотнение (разделение) каналов (чу, чрк). Многоканальная система с чу, чрк.

- •33. Временное уплотнение (разделение) каналов (ву, врк). Многоканальная система с ву, врк.

- •34. Системы передачи с шумоподобными сигналами. Разделение сигналов по форме. Системы со свободным доступом к каналу связи.

- •35. Принципы разделения частотно-временной области. Частотно-временная матрица.

- •37. Кодовое уплотнение (разделение) каналов.Метод cdma.

- •38. Сотовые системы связи. Частоты и виды модуляции. Особенности распространения радиоволн сотовой связи: многолучевое распространение, эффект Доплера, эффект замираний.

- •39.Сота. Организация и конфигурация сот. Повтор частот. Секторизация сот.

- •40. Функциональная схема системы сотовой связи. Компоненты. Функции, назначение. Принципы распределения частотных каналов.

- •41. Спутниковая радиосвязь. Основные принципы и службы.

- •43. Геостационарные спутники. Преимущества и недостатки систем связи на основе геостационарных спутников.

- •44. Зоны обслуживания спутниковых систем связи и вещания. Зона видимости. Зона покрытия. Построение зон покрытия.

- •45. Модуляция и уплотнение каналов в спутниковой связи.

- •46. Классификация наземных станций спутниковой связи.

- •47. Автоматизированные системы управления (асу). Основные принципы управления. Иерархические структуры управления.

- •48. Классификация асу. Автоматизированная система управления предприятием (асуп).

- •49. Автоматизированные системы управления технологическими процессами (асутп). Применение эвм в асутп.

- •50. Проектно-конструкторские асу. Основы систем автоматизированного проектирования (сапр).

- •51. Принципы проектирования асу.

16. Сигнал с ограниченным спектром. Дискретизация на основе теоремы Котельникова. Функция отсчетов Котельникова.

Д ля восстановления непрерывного сигнала по конечному числу отсчетов решают задачу предельной дискретизации.

Теорема Котельникова: определение частоты квантования для функции с ограниченным спектром.

Непрерывная функция времени, которая не содержит частот в спектре выше некоторой частоты Fв, полностью определяется конечным числом мгновенных значений x(k,Δt), точек отстоящих друг от друга на интервал времени Δt<=1/2Fв.

Теорема Котельникова позволяет представить любую функцию x(t) в виде суммы бесконечного ряда: , φk(t) – функция Котельникова. , где ωв связана с Fв: ωв=2π Fв. Sinx/x - для нее φk(t)=1.

,

Т – длительность временного интервала,

на котором происходит замена функции

на множество отсчетов.

– длительность временного интервала,

на котором происходит замена функции

на множество отсчетов.

N=T/Δt – количество отсчетов (число степеней свободы восстанавливания функции).

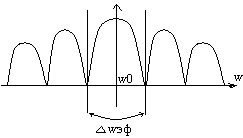

, где - среднеквадратическая ошибка дискретизации; - ошибка связанная с ограничением спектра сигнала частотой ωв. При дискретизации спектральная функция получаемого сигнала будет периодической функцией, имеющей лепестковую структуру. Важным условием является непересечение «соседних» спектральных составляющих, что обеспечиваеися при соблюдении условий теоремы Котельникова.

17. Количество информации. Энтропия. Свойства энтропии. Измерение количества

информации. Энтропия количества информации.

Формула Хартли:

I=log2N.

Имеется n

равновероятных сообщений. С помощью

некоторого алфавита и дискретного

передатчика, необходимо передавать

текст сообщения. Слово из n

малых букв, N

– количество букв алфавита. Тогда число

всех возможных слов равно Nn,

в результате, I=log2Nn=n*log2N.

Формула Хартли является случаем

синтаксического подхода к случаю

измерения количества информации. Формула

Шеннона является случаем вероятностного

подхода к измерению количества информации

или семантического. Для общего случая

по Шеннону, если источник сообщения

имеет конечное число состояний А1,А2,…,Ан,

с соответствующими вероятностями

Р1,Р2,…,Рн.

Тогда энтропия источника: Н(А)=Н(Р1,Р2,…,Рн)=

![]() Энтропия – мера неопределенности

источника нашего знания о состоянии

источника. Количество информации о

некотором объекте есть разность между

априорной и апостериорной энтропии:

I=Hapr-Haposter.

До наблюдения сигнала, несущего информацию

об объекте известно только распределение

вероятностей по возможным состоянии,

т.е.

Энтропия – мера неопределенности

источника нашего знания о состоянии

источника. Количество информации о

некотором объекте есть разность между

априорной и апостериорной энтропии:

I=Hapr-Haposter.

До наблюдения сигнала, несущего информацию

об объекте известно только распределение

вероятностей по возможным состоянии,

т.е.

![]() .

Неопределенность ситуации до определения

сигнала характеризуется его энтропией

объекта, измеряемой по формуле Шеннона:

Н(А)=Н(Р1,Р2,…,Рн)=

.

.

Неопределенность ситуации до определения

сигнала характеризуется его энтропией

объекта, измеряемой по формуле Шеннона:

Н(А)=Н(Р1,Р2,…,Рн)=

.

После приема

сигнала, если нет ошибок отсутствуют

помехи, можно дать точный ответ в каком

состоянии находится объект. Таким

образом неопределенность наших знаний

о состоянии объекта станет равной нулю,

а с другой стороны полученное количество

информации I равное разности энтропий

объекта до и после сигнала. При отсутствии

ошибок количество информации равно

априорной энтропии: n

– число символов послед-ти; m – объем

алфавита.

![]() .

Если в принимаемом сигнале есть ошибка,

тогда об однозначности объекта говорить

невозможно, т.е. энтропия не уменьшилась

до 0. Для определения количества

информации, в этом случае, необходимо

учитывать и апостериорную энтропию.

.

Если в принимаемом сигнале есть ошибка,

тогда об однозначности объекта говорить

невозможно, т.е. энтропия не уменьшилась

до 0. Для определения количества

информации, в этом случае, необходимо

учитывать и апостериорную энтропию.

Свойства энтропии: 1. Непрерывная, неотрицательная функция Pi: Н(Р1,Р2,…,Рн)>=0. Если двоичная система: 0=<Н(Р1,Р2,…,Рн)<=1.

2. Н(А)=0, если существует Pi=1

3. Н(А)→мах, т.е. Н(А)=1, если Pi равны друг другу.

4. Если состояние

объекта образуется совместной реализацией

состояний Ак,

Ве,

к=1,К; е=1,L. Н(АВ)=Н(А)+Н(В). Н(А)=

![]() ,

,

Н(В)=

![]()

18. Ортогональные разложения колебаний. Преобразование сообщений в ортогональные разложения колебаний. Ортонормированная система базисных функций. Большинство сложных сигналов, которые описывают сообщение, сигналы, помехи, состояния и т.д. целесообразно представлять в виде линейных комбинации, более простые сигналы с использованием системы заранее известных функций.

![]() - такое разложение

называют разложением x(t) по системе

базисных функций φi(t).

Требования к системе φi(t):

- такое разложение

называют разложением x(t) по системе

базисных функций φi(t).

Требования к системе φi(t):

1) ортогональность: . При Q=1, систему называют ортонормированной.

, осуществляется по энергии и по мощности: По энергии:

По мощности:

2) условие теплоты:

Базис система является полной в том случае, если среднее квадратическая ошибка аппроксимации может быть доведена до малой величины ε, за счет увеличение членов ряда

.

Для того чтобы представить сигнал х,

необходимо получить коэффициент

разложения ai.

Данная совокупность и есть спектральная

характеристика сигнала в базисе

.

- обобщенный ряд Фурье.

.

Для того чтобы представить сигнал х,

необходимо получить коэффициент

разложения ai.

Данная совокупность и есть спектральная

характеристика сигнала в базисе

.

- обобщенный ряд Фурье.

Относительная

величина ошибки:

![]()