- •1 Обзор современных методов диагностики и лечения панкреатита

- •1.1 Заболевания поджелудочной железы. Описание, причины и классификация заболеваний поджелудочной железы.

- •1.2 Панкреатит

- •1.2.1 Этиология и симптомы панкреатита

- •Острый панкреатит

- •Хронический панкреатит

- •1.2.2 Острый панкреатит

- •1.2.3 Хронический панкреатит

- •1.2.5 Лечение панкреатита

- •1.3 Нейросетевое моделирование систем

- •1.3.1 Основные понятия нейросетевой модели

- •Обучение нейронных сетей

- •Метод Розенблатта

- •Метод Уидроу-Хоффа

- •2 Анализ признаков панкреатита и разработка модели диагностики

- •3.1 Создание программного обеспечения и разработанная структурная схема

- •3.2 Описание информационно-программного обеспечения и основных функциональных блоков

- •4 Организационно-экономическая часть

- •4.1 Оценка целесообразности разработки программного продукта

- •4.2 Выбор и обоснование базовой модели

- •4.3.1 Расчет стоимости основных материалов

- •4.3.3 Расчет текущих расходов и износа оборудования

- •4.3.6 Определение отчислений на социальные нужды

- •4.3.7 Расчет договорной и продажной цены пп

- •4.3.8 Расчет цены потребления

- •4.4.1 Коэффициент цены потребления

- •4.4.2 Техническая прогрессивность нового изделия

- •4.5.6 Расчет относительной экономии капитальных вложений

- •4.5.8 Расчет годового экономического потенциала разработки

- •4.6 Расчет финансово-экономических результатов

- •4.7 Организация продаж программного продукта

- •5.1 Безопасность производственной среды

- •5.1.1 Анализ опасных и вредных факторов

- •5.1.2 Меры защиты от опасных и вредных факторов

- •5.1.2.1 Параметры микроклимата

- •5.1.2.3 Производственное освещение

- •5.1.2.4 Электромагнитное излучение

- •5.1.2.5 Статическое электричество

- •5.1.3 Расчет площади световых проемов при боковом освещении рабочего места врача при работе на эвм

- •5.2 Экологичность проекта

- •5.2.1 Анализ возможных негативных воздействий на врача

- •5.2.2 Мероприятия по защите окружающей среды от действия компьютеров

- •5.3 Чрезвычайные ситуации

- •5.3.1 Оценка возможности возникновения чс и план действий по их ликвидации

- •5.3.2 Пожарная безопасность при работе с компьютером

-

Метод Розенблатта

Данный метод был предложен Ф.Розенблаттом в 1959 г. для НС, названной персептрон (perceptron). Персептрон рассматривался его автором не как конкретное техническое вычислительное устройство, а как модель работы мозга. Нужно заметить, что после нескольких десятилетий исследований современные работы по искусственным нейронным сетям редко преследуют такую цель. Персептрон имеет пороговую функцию активации, его схема представлена на рис.4.

Рисунок 4 – Однослойный персептрон

Процедуру обучения Розенблатта для однослойного персептрона можно представить так:

![]()

где

-

xi — i-тый вход НС;

-

dj — желаемый (идеальный) j-тый выход НС;

-

α — коэффициент (скорость обучения) 0<α≤1

Простейший классический персептрон содержит нейрободобные элементы трех типов, назначение которых в целом соответствует нейронам рефлекторной нейронной сети, рассмотренной в предыдущей лекции. S-элементы формируют сетчатку сенсорных клеток, принимающих двоичные сигналы от внешнего мира.

Розенблатт называл такую нейронную сеть трехслойной, однако по современной терминологии, используемой в этой книге, представленная сеть обычно называется однослойной, так как имеет только один слой нейропроцессорных элементов. Однослойный персептрон характеризуется матрицей синаптических связей W от S- к A-элементам. Элемент матрицы отвечает связи, ведущей от i-го S-элемента к j-му A-элементу.

Были выявлены принципиальные неустранимые ограничения однослойных персептронов, и в последствии стал в основном рассматриваться многослойный вариант персептрона, в котором имеются несколько слоев процессорных элементов.

С сегодняшних позиций однослойный персептрон представляет скорее исторический интерес, однако на его примере могут быть изучены основные понятия и простые алгоритмы обучения нейронных сетей.

Весовые коэффициенты меняются только в том случае, если реальное выходное значение не совпадает идеальным выходным значением.

Полный алгоритм обучения Розенблатта строится следующим образом:

1. Весовые коэффициенты НС инициализируются малыми случайными значениями.

2. Подать на вход НС очередной учебный пример.

3. Если выход НС yj не совпадает с идеальным выходом dj, то происходит модификация весов по (1).

4. Цикл повторяется с п.2 пока весовые коэффициенты перестанут меняться.

-

Метод Уидроу-Хоффа

Персептрон Розенблатта ограничивается бинарными выходами. Уидроу и Хофф изменили модель Розенблатта. Их первая модель - ADALINE (Adaptive Linear Element) имела один выходной нейрон и непрерывную линейную функцию активации нейронов.

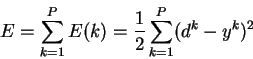

|

|

(2) |

Метод

обучения Уидроу-Хоффа известен еще как

дельта-правило

(delta-rule). Этот метод ставит своей целью

минимизацию функции ошибки

![]() в

пространстве весовых коэффициентов.

в

пространстве весовых коэффициентов.

|

|

(3) |

где

-

-

количество обработанных НС примеров

-

количество обработанных НС примеров

-

E(k) - ошибка для

-го

примера

-го

примера

-

yk - реальный выход НС для

-го

примера

-го

примера

-

dk - желаемый (идеальный) выход НС для

-го

примера .

-го

примера .

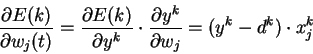

Минимизация

![]() осуществляется

методом градиентного спуска

осуществляется

методом градиентного спуска

![]()

где

Таким образом, весовые коэффициенты изменяются по правилу

|

|

(4) |

Полный алгоритм обучения методом Видроу-Хоффа строится следующим образом:

-

Задать скорость обучения a;(0<a<1) задать минимальную ошибку сети

;

весовые коэффициенты НС инициализируются

малыми случайными значениями.

;

весовые коэффициенты НС инициализируются

малыми случайными значениями.

-

Подать на вход НС очередной учебный пример; рассчитать выход НС

-

Скорректировать веса по (4)

-

Цикл с п.2 повторяется, пока

(где

![]() -

суммарная среднеквадратичная ошибка

НС)

-

суммарная среднеквадратичная ошибка

НС)