- •Часть1. Тематический план дисциплины

- •Часть 2. Конспекты лекций 8

- •Часть 3. Вопросы и задания для практических работ. 79

- •Часть 4. Задания для самостоятельной работы 92

- •Часть 5. Лабораторные работы 97

- •Часть1. Тематический план дисциплины «Основы математической обработки информации»

- •Часть 2. Конспекты лекций

- •1.1. Исторические периоды развития математики.

- •1.2. Основы теории множеств

- •1.2.1. Начальные понятия теории множеств.

- •2.1.3. Основные понятия комбинаторики

- •2) Перестановка из n элементов – это размещение из n элементов по n.

- •2.2. Начальные понятия теории вероятностей

- •2.2.2. Определения вероятности событий

- •3.1. Действия над событиями

- •3.2. Вероятность суммы событий

- •3.3. Вероятность произведения событий.

- •3.4. Вычисление вероятности цепочек языковых элементов.

- •3.5. Формула полной вероятности. Формула Байеса.

- •1 H2) Формула полной вероятности.

- •3.6. Теорема Бернулли

- •3.7. Вероятностное моделирование порождения текста.

- •3.8. Предельные теоремы в схеме Бернулли

- •4.1. Случайная величина (св). Начальные понятия.

- •4.2. Функция распределения св (интегральная функция распределения) f(X)

- •4.3. Функция плотности вероятности нсв f(X)

- •4.4. Числовые характеристики св

- •4.5. Законы распределения случайных величин.

- •1) Биномиальный закон распределения.

- •2) Закон Пуассона

- •3) Нормальное распределение (закон Гаусса)

- •6. Вероятность попадания нсв х в заданный промежуток

- •7. Логнормальное распределение

- •5.1. Система двух случайных величин (двумерная св) (1 час)

- •5.1.1. Начальные понятия.

- •5.1.2. Операции над независимыми случайными величинами

- •5.1.3. Числовые характеристики системы двух св

- •5.2. Предельные теоремы теории вероятностей: Закон больших чисел, Центральная предельная теорема и их значение для лингвистического эксперимента.(1 час)

- •5.2.1. Теорема Чебышева для среднего арифметического случайных величин.

- •6.1. Предмет математической статистики. Генеральная и выборочная совокупность.

- •6.2. Статистическое распределение выборки и его графическое изображение

- •6.2.1. Дискретный статистический ряд

- •6.2.2. Интервальный статистический ряд

- •6.3. Числовые характеристики статистического распределения

- •Лекция 7. Элементы теории статистических оценок и проверки гипотез.

- •7.1 Статистические оценки параметров распределения и их свойства. Оценка параметров генеральной совокупности по выборке

- •7.1.1. Свойства статистических оценок:

- •7.1.2. Точечные оценки математического ожидания, дисперсии и вероятности.

- •7.1.3. Интервальное оценивание параметров.

- •7.1.4. Доверительные интервалы для параметров нормального распределения

- •7.1.5. Число степеней свободы

- •7.1.7. Определение минимально достаточного объёма выборки в грамматических, фонетико-фонологических и лексикологических исследованиях.

- •7.2. Проверка статистических гипотез. Исследование вероятностных свойств языка и статистики текста с помощью метода гипотез.

- •7.2. Проверка статистических гипотез.

- •7.2.1. Статистические гипотезы.

- •7.2.2. Статистический критерий

- •4.2.3. Принцип проверки статистических гипотез

- •7.2.4. Ошибки при проверке гипотез

- •7.2.5. Проверка лингвистических гипотез с помощью параметрических критериев.

- •7.2.6. Проверка гипотез с помощью непараметрических критериев.

- •Часть 3. Вопросы и задания для практических работ.

- •I. Элементы комбинаторики.

- •Часть 4. Задания для самостоятельной работы

- •1. Графический способ.

- •2. Критерий асимметрии и эксцесса.

- •3. Критерий Колмогорова-Смирнова.

- •4. Критерий Пирсона

- •Приложение 1. Значения интегральной функции Лапласа

- •Приложение 2. Критические значения ( распределение Пирсона)

3.7. Вероятностное моделирование порождения текста.

При исследовании механизмов порождения текста результаты отдельного лингвистического исследования не представляют большого интереса. При осуществлении массового эксперимента одно и то же испытание повторяется много раз. Лингвистические единицы выбираются из текста группами фиксированной длины: например, по 10 фонем, по 100 предложений, по 500 словоформ и т.п. Повторяющиеся испытания образуют серии, в каждом из которых интересующее нас событие появляется или не появляется определённое число раз. Например, нас интересует общее число появления слова море в определённом числе предложений (серии) составляющих текст «Евгения Онегина» или другого произведения А.С.Пушкина.

При решении многих теоретических и инженерно-лингвистических задач оказывается необходимым знать вероятность появления определённого числа интересующих исследователя лингвистических единиц в серии. Если образующие серию лингвистические испытания являются независимыми и возможны только два исхода опыта: появление или не появление признака А, то мы можем вычислить вероятность с помощью теоремы Бернулли.

Примером

этой схемы может служить повторная

выборка согласных (А) и гласных (![]() )

фонем из определённого текста. Предположим,

что в некотором тексте длиной в n

фонем

имеется m

гласных

и n-m

согласных. Требуется определить, что

среди извлечённых N

фонем ровно x

окажутся согласными, причём порядок

следования согласной и гласной фонем

безразличен.

)

фонем из определённого текста. Предположим,

что в некотором тексте длиной в n

фонем

имеется m

гласных

и n-m

согласных. Требуется определить, что

среди извлечённых N

фонем ровно x

окажутся согласными, причём порядок

следования согласной и гласной фонем

безразличен.

При составлении алгоритмов пословного машинного перевода и информационного поиска возникают задачи, связанные с прогнозированием появления в сегментах заданной длины определённого числа словоформ, морфем или словосочетаний, принадлежащих к некоторым классам. Формула Бернулли позволяет решать задачи такого типа, при условии, что сохраняется взаимная независимость образующих данный сегмент словоформ.

Пример12Средняя длина простого предложения или синтаксически оформленной части сложного предложения в английских научно-технических текстах лежит между 10 и 11 словоформами. Относительная частота появления существительных в подъязыке английской электроники близка к 1/3(априорная вероятность). Примем, что типовым синтаксически оформленным сегментом в английских научно-технических текстах является простое предложение, а также главное и придаточное предложение длиной в 10 словоформ. Считая появление отдельных словоформ в этих сегментах независимыми событиями текста, определить вероятность того, что из 10 словоупотреблений, составляющих типовой сегмент ровно 2 будут существительными.

3.8. Предельные теоремы в схеме Бернулли

Чтобы получить достаточно достоверные результаты приходится проводить большое число независимых испытаний. При этом величины n и m могут быть велики, что делает вычисление по формуле Бернулли слишком трудоёмким. В таких случаях применяют асимптотические формулы для вычисления биномиальной вероятности при n→∞.

1)

Формула Пуассона

![]() ,

где параметр

,

где параметр

![]() ,

,

применяется при больших n ( n≥100) и малых р (p≤0,1), а≤10

2) Локальная теорема Муавра-Лапласа

![]()

применяется при больших n и р≠0; р≠1.

![]() Выражение

Выражение

![]() называется функцией Гаусса, значения

которой табулированы.

называется функцией Гаусса, значения

которой табулированы.

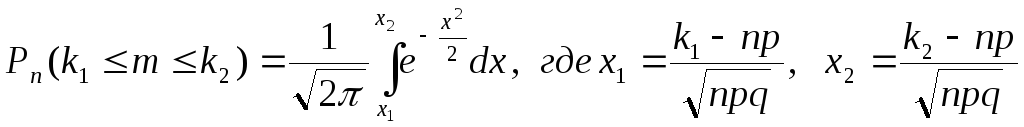

3) Интегральная теорема Муавра-Лапласа

применяется

в тех случаях, когда требуется вычислить

вероятность того, что в n

независимых

испытаниях событие А появится от

![]() до

до

![]() раз

включительно, при больших n

и р≠0; р≠1.

раз

включительно, при больших n

и р≠0; р≠1.

Лекция №4.

Случайная величина.