- •Часть1. Тематический план дисциплины

- •Часть 2. Конспекты лекций 8

- •Часть 3. Вопросы и задания для практических работ. 79

- •Часть 4. Задания для самостоятельной работы 92

- •Часть 5. Лабораторные работы 97

- •Часть1. Тематический план дисциплины «Основы математической обработки информации»

- •Часть 2. Конспекты лекций

- •1.1. Исторические периоды развития математики.

- •1.2. Основы теории множеств

- •1.2.1. Начальные понятия теории множеств.

- •2.1.3. Основные понятия комбинаторики

- •2) Перестановка из n элементов – это размещение из n элементов по n.

- •2.2. Начальные понятия теории вероятностей

- •2.2.2. Определения вероятности событий

- •3.1. Действия над событиями

- •3.2. Вероятность суммы событий

- •3.3. Вероятность произведения событий.

- •3.4. Вычисление вероятности цепочек языковых элементов.

- •3.5. Формула полной вероятности. Формула Байеса.

- •1 H2) Формула полной вероятности.

- •3.6. Теорема Бернулли

- •3.7. Вероятностное моделирование порождения текста.

- •3.8. Предельные теоремы в схеме Бернулли

- •4.1. Случайная величина (св). Начальные понятия.

- •4.2. Функция распределения св (интегральная функция распределения) f(X)

- •4.3. Функция плотности вероятности нсв f(X)

- •4.4. Числовые характеристики св

- •4.5. Законы распределения случайных величин.

- •1) Биномиальный закон распределения.

- •2) Закон Пуассона

- •3) Нормальное распределение (закон Гаусса)

- •6. Вероятность попадания нсв х в заданный промежуток

- •7. Логнормальное распределение

- •5.1. Система двух случайных величин (двумерная св) (1 час)

- •5.1.1. Начальные понятия.

- •5.1.2. Операции над независимыми случайными величинами

- •5.1.3. Числовые характеристики системы двух св

- •5.2. Предельные теоремы теории вероятностей: Закон больших чисел, Центральная предельная теорема и их значение для лингвистического эксперимента.(1 час)

- •5.2.1. Теорема Чебышева для среднего арифметического случайных величин.

- •6.1. Предмет математической статистики. Генеральная и выборочная совокупность.

- •6.2. Статистическое распределение выборки и его графическое изображение

- •6.2.1. Дискретный статистический ряд

- •6.2.2. Интервальный статистический ряд

- •6.3. Числовые характеристики статистического распределения

- •Лекция 7. Элементы теории статистических оценок и проверки гипотез.

- •7.1 Статистические оценки параметров распределения и их свойства. Оценка параметров генеральной совокупности по выборке

- •7.1.1. Свойства статистических оценок:

- •7.1.2. Точечные оценки математического ожидания, дисперсии и вероятности.

- •7.1.3. Интервальное оценивание параметров.

- •7.1.4. Доверительные интервалы для параметров нормального распределения

- •7.1.5. Число степеней свободы

- •7.1.7. Определение минимально достаточного объёма выборки в грамматических, фонетико-фонологических и лексикологических исследованиях.

- •7.2. Проверка статистических гипотез. Исследование вероятностных свойств языка и статистики текста с помощью метода гипотез.

- •7.2. Проверка статистических гипотез.

- •7.2.1. Статистические гипотезы.

- •7.2.2. Статистический критерий

- •4.2.3. Принцип проверки статистических гипотез

- •7.2.4. Ошибки при проверке гипотез

- •7.2.5. Проверка лингвистических гипотез с помощью параметрических критериев.

- •7.2.6. Проверка гипотез с помощью непараметрических критериев.

- •Часть 3. Вопросы и задания для практических работ.

- •I. Элементы комбинаторики.

- •Часть 4. Задания для самостоятельной работы

- •1. Графический способ.

- •2. Критерий асимметрии и эксцесса.

- •3. Критерий Колмогорова-Смирнова.

- •4. Критерий Пирсона

- •Приложение 1. Значения интегральной функции Лапласа

- •Приложение 2. Критические значения ( распределение Пирсона)

6. Вероятность попадания нсв х в заданный промежуток

![]()

![]() или

или

(по определению и свойствам функции F(x) и f(x)).

Если

НСВ Х распределена по нормальному

закону Х~N(a;σ),

вероятность попадания Х в интервал (![]() вычисляется по формуле

вычисляется по формуле

![]()

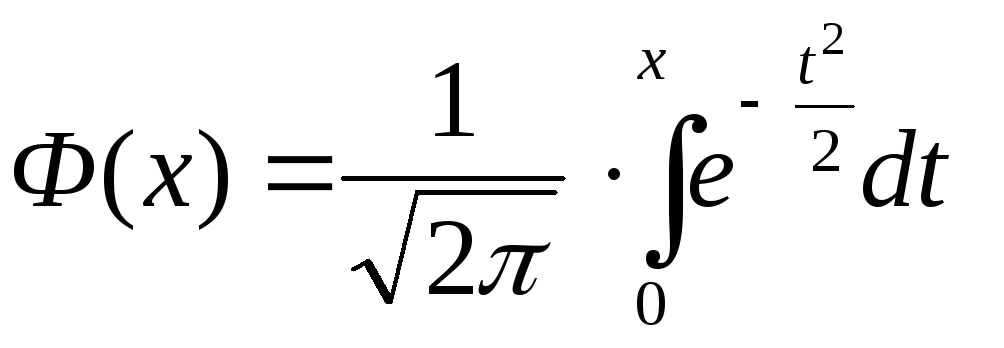

где  - функция Лапласа.

- функция Лапласа.

(значения функции Лапласа можно найти в таблице) .

Свойства

![]() :

:

1.

![]() -

функция

Лапласа нечётная.

-

функция

Лапласа нечётная.

2.

![]() ,

,

![]()

Пример. СВ Х распределена по нормальному закону с параметрами a=2; σ=4: Х~N(2;4).

Найти вероятность того, что СВХ попадёт в промежуток: а)(0;3),б) (4; ∞), в) (-∞;1).

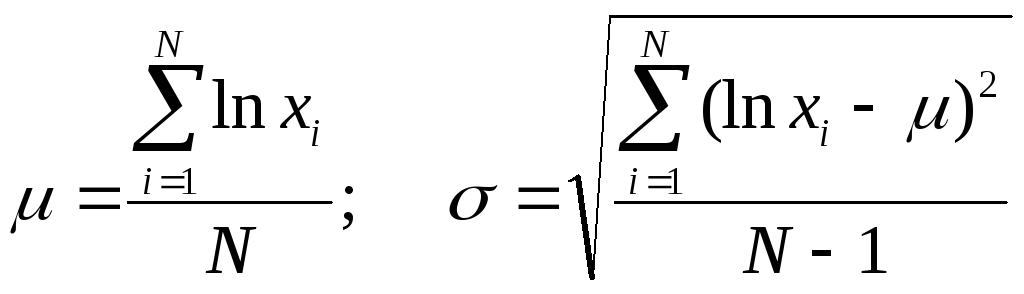

7. Логнормальное распределение

Реальные распределения случайных лингвистических единиц характеризуются обычно правосторонней асимметрией, и не очень хорошо аппроксимируются нормальным законом. В связи с этим делаются попытки моделировать эти эмпирические распределения с помощью распределений Кэпптейна, Шалье, выравнивающих кривых Пирсона и Бордачёва. Такое моделирование должно опираться на лингвистическую сущность случайного явления или процесса, приводящему к определённому закону распределения.

С этой точки зрения наибольший интерес представляет логарифмически нормальное (логнормальное) распределение. Основная идея – в следующем. Значение случайной лингвистической величины Х обычно складывается из независимых внутриязыковых и экстралингвистических величин. Чаще всего эти значения являются результатом действия ряда причин. В этом случае нормально распределена не сама СВХ, а её логарифм.

Функция плотности вероятности логнормального распределения имеет вид

,

где

,

где

.

.

Функция плотности вероятности логнормального распределения характеризуется островершинностью, и имеет правостороннюю (положительную) скошенность.

Г. Хердан ( «Квантитативная лингвистика», Лондон, 1964г ) использует логнормальное распределение для математической экспликации вероятностного построения словаря языка и его реализации в тексте. По его мнению, логнормальность словаря и текста отражает присущий естественному языку принцип оптимального кодирования информации.

Иногда

для решения лингвистической задачи

необязательно находить вероятности

появления данного события 0,1,2,…N

раз, а достаточно указать наивероятнейшее

число появления этого события х0,

которое определяется по формуле

![]()

Лекция №5

5.1. Система двух случайных величин (двумерная св) (1 час)

5.1.1. Начальные понятия.

1) Упорядоченная пара (Х ; Y) случайных величин Х и Y называется системой двух СВ или двумерной СВ.

2) Закон распределения двумерной СВ – соответствие между значениями (Х ; Y) и их вероятностями.

3) СВ Х и Y называются независимыми, если закон распределения каждой из них не зависит от того, какое значение приняла другая.

4) Две СВ Х и Y называются функционально зависимыми, если зная значение одной из них, можно точно указать значение другой.

5) СВ Х и Y связаны стохастической зависимостью, если зная значение одной из них, можно указать закон распределения, а не точное значение другой.

Примеры: две СВ Х – «рост человека», Y – « вес этого же человека» связаны стохастической зависимостью;

СВ U – «количество существительных в отрывке текста определённой длины», V – «количество наречий в том же отрывке текста», также связаны стохастической зависимостью.