- •Економетрія

- •Змістовий модуль 1: постановка задачі економетричного моделювання

- •1.1. Предмет, заВдання і зміст економетричного моделювання

- •1.1.1. Предмет економетрії

- •1.1.2. Проблеми і завдання економетричного моделювання

- •1.1.3. Зміст (послідовність) економетричного моделювання

- •1.2. Формування матриці даних для економетричного моделювання

- •1.2.1 Загальна характеристика матриці

- •1.2.2 Змінні в матриці

- •1.2.3. Об’єкти спостереження в матриці

- •1.2.4. Вимоги до розмірів матриці

- •1.2.5. Показники варіації змінних

- •1.2.6. Поля кореляції і їх аналіз

- •1.2.7. Вилучення аномальних об’єктів спостереження

- •1.3. Комплекс контрольних завдань

- •Навчальні елементи, що підлягають контролю і оцінюванню:

- •1.3.1. Тестові завдання

- •1.3.2. Логічні вправи

- •1.3.3. Розрахункові вправи

- •Змістовий модуль 2: специфікація економетричних моделей

- •2.1. Ідентифікація незалежних змінних

- •2.1.1. Мета і послідовність ідентифікації

- •2.1.2. Коефіцієнти парної кореляції і детермінації

- •2.1.3. Тестування суттєвості (невипадковості) коефіцієнтів кореляції

- •2.1.4. Інтервали довіри для коефіцієнтів кореляції

- •2.1.5 Мультиколінеарність

- •2.1.6. Бета - коефіцієнти

- •2.1.7. Тестування автономії екзогенних змінних

- •2.1.8. Коефіцієнт множинної кореляції і детермінації

- •2.1.9. Тестування значущості вкладу факторів у множинну детермінацію

- •2.1.10. Вилучення екзогенних змінних

- •2.2. Специфікація аналітичної форми рівнянь регресії

- •2.2.1. Мета і способи специфікації

- •2.2.2. Аналітичні форми рівнянь регресії

- •2.2.3. Спосіб перших різниць

- •2.2.4. Лінеаризація нелінійних рівнянь регресії

- •2.3. Комплекс контрольних завдань

- •Навчальні елементи, що підлягають контролю і оцінюванню:

- •2.3.1. Тестові завдання

- •2.3.2. Логічні вправи

- •2.3.3. Розрахункові вправи

- •Змістовий модуль 3: оцінювання параметрів економетричних моделей

- •3.1. Оцінювання параметрів рівнянь регресії

- •3.1.1. Мета і вимоги до оцінювання параметрів

- •3.1.2. Основні припущення щодо оцінювання параметрів

- •3.1.3. Метод найменших квадратів

- •3.1.4. Виконання за мнк основних припущень щодо оцінювання параметрів

- •3.1.5. Гетероскедастичність

- •3.1.6. Автокореляція

- •3.1.7. Значущість (адекватність) рівняння регресії

- •3.1.8. Перевірка значущості параметрів моделі

- •3.1.9. Інтервали довіри до коефіцієнтів регресії

- •3.2. Прогнозування залежної змінної

- •3.2.1. Прогнозування на парних моделях

- •3.2.2. Прогнозування на множинних моделях

- •3.3. Комплекс контрольних завдань

- •Навчальні елементи, що підлягають контролю і оцінюванню:

- •3.3.1. Тестові завдання

- •3.3.2. Логічні вправи

- •3.3.3. Розрахункові вправи

- •4. Відповіді до розрахункових вправ

- •Економетричних моделей

- •Список літератури

- •Критичні значення t для побудови прямокутного шаблону двомірного розсіювання*

- •Значення f – критерію Фішера

- •Навчальне видання

- •61002, Харків, хнамг, вул. Революції, 12

- •61002, Харків, хнамг, вул. Революції, 12

3.1.3. Метод найменших квадратів

Ідею методу найменших квадратів (МНК) вчені сформулювали ще на початку ХІХ ст., а саме англієць Гаус і француз Лежандр. Але МНК як метод оцінювання параметрів рівнянь регресії, був опрацьований пізніше російським математиком М. Чебишевим в монографії “Об интерполировании по методу наименьших квадратов”, що вийшла друком у 1859 р.

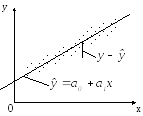

Метод найменших квадратів (МНК) заснований на вимозі, щоб

(y - ŷ)2 → min, (3.1)

тобто щоб відхилення точок поля кореляйії від прямої регресії (залишки е) були найменшими. Відхилення y – ŷ є помилкою оцінювання, бо залишки е не пояснюється рівнянням регресії (див. рис. 3.1.).

М и

можемо визначити величину цих помидок

тільки для об’єктів спостережень (точок

поля), але для інших можливих комбінаційy

і х

вони невідомі. Цілком природно за

“найкращу”

пряму лінію регресії вибрати таку, для

якої б сума квадратів залишків приймала

найменше Рис.3.1 − Залишки, що не

значення, тобто

и

можемо визначити величину цих помидок

тільки для об’єктів спостережень (точок

поля), але для інших можливих комбінаційy

і х

вони невідомі. Цілком природно за

“найкращу”

пряму лінію регресії вибрати таку, для

якої б сума квадратів залишків приймала

найменше Рис.3.1 − Залишки, що не

значення, тобто

пояснюються регресією.

![]() =

=

![]() (y

–

(y

–

![]() –

–

![]() x)2

=→ min.

x)2

=→ min.

Необхідною

умовою мінімуму є рівність нулю частинних

похідних цієї функції по

![]() і

і

![]() :

:

![]() = –2

= –2

![]() =0;

=0;

![]() = –2

= –2

![]() =0

=0

Розкривши

дужки, отримаємо систему нормальних

рівнянь з невідомими

![]() і

і

![]() :

:

![]() =

a0

=

a0

![]() +

a1

+

a1

![]() ;

(3.2)

;

(3.2)

![]() =

a0

=

a0

![]() +

a1

+

a1

![]() .

.

Наведемо давно підмічені правила і приклади складання системи нормальних рівнянь для будь – яких форм рівняння регресії. Правило перше: перше рівняння системи отримуємо, сумуючи рівняння регресії за всіма спостереженнями змінних. Наприклад, для трифакторної лінійної регресії

y = αо + α1 x1 + α2 x2 + α3 x3

перше рівняння системи за цим правилом матиме вигляд

y = αо 1 + α1 x1 + α2 x2 + α3 x3

Друге правило: друге, третє і всі інші рівняння систем отримують множенням першого рівняння на співмножники відповідно при а1, а2 и т.д. у рівнянні регресії. У даному випадку множенням першого рівняння відповідно на x1, x2 та x3 отримаємо друге, третє і четверте рівняння системи

y x1 = αо x1 + α1 x12 + α2 x2 x1 + α3 x3 x1,

y x2 = αо x2 + α1 x1 x2 + α2 x2 2 + α3 x3 x2,

y x3 = αо x3 + α1 x1 x3 + α2 x2 x3 + α3 x3 2.

Ще приклад. Нехай рівняння регресії має степеневу форму

y

= αо![]() .

.

Лінеаризуємо його

ℓg y = ℓg αо + α1 ℓgx.

Система нормальних рівнянь для визначення ℓg αо і α1, складена за наведеними щойно правилами, приймає такий вигляд:

ℓg y = ℓg αо 1 + α1 ℓgx,

ℓg y ℓgx = ℓg αо ℓgx + α1 (ℓgx)2.

У нашому наскрізному прикладі моделювання залежності рентабельності від двох факторів

Р = αо + α1 Е + α2 К

система нормальних рівнянь для оцінювання αо, α1, та α2 складена за наведеними вище правилами, така:

Р = αо 1 + α1 Е + α2 К,

РЕ = αо Е + α1 Е2 + α2 К Е,

РК = αо К + α1 ЕК + α2 К2.

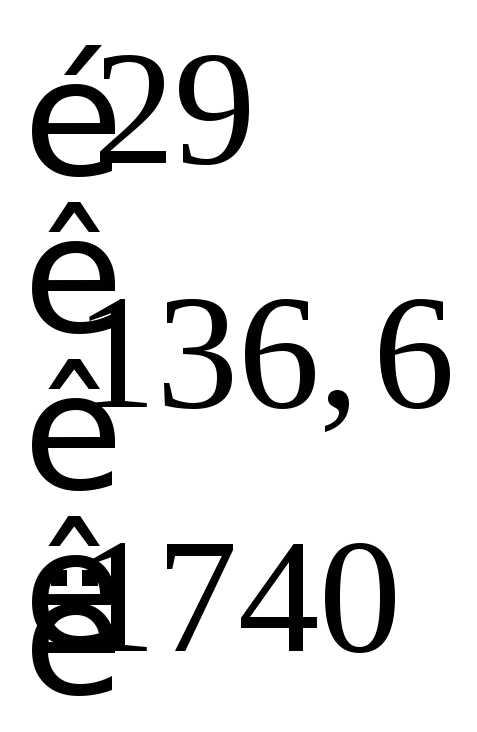

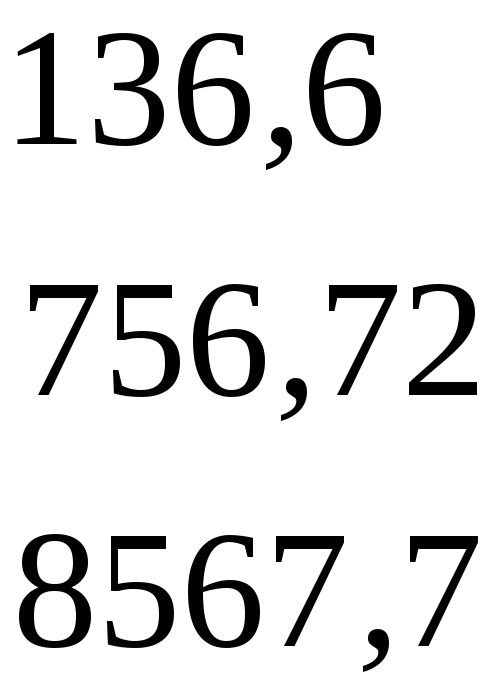

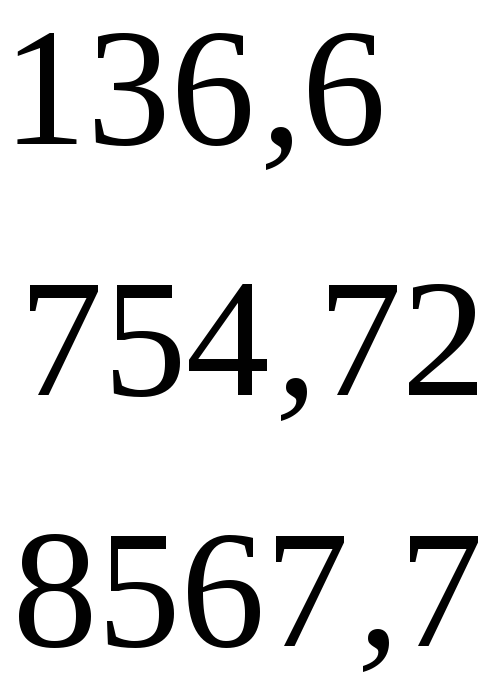

За даними табл. 1.5. і 2.1 перепишемо цю систему рівнянь в числах:

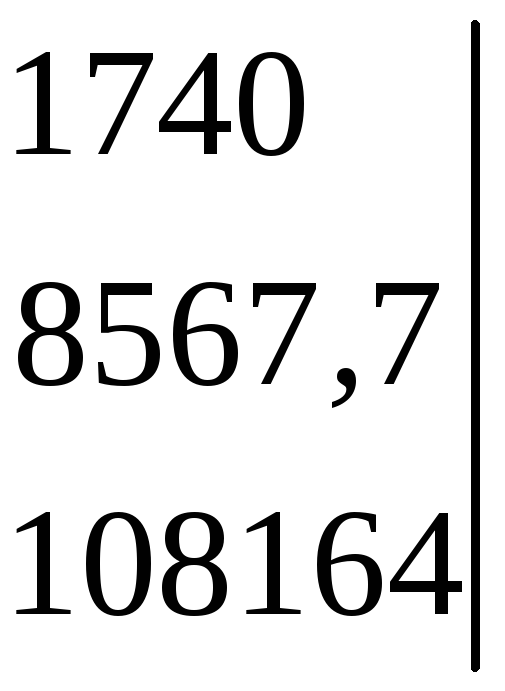

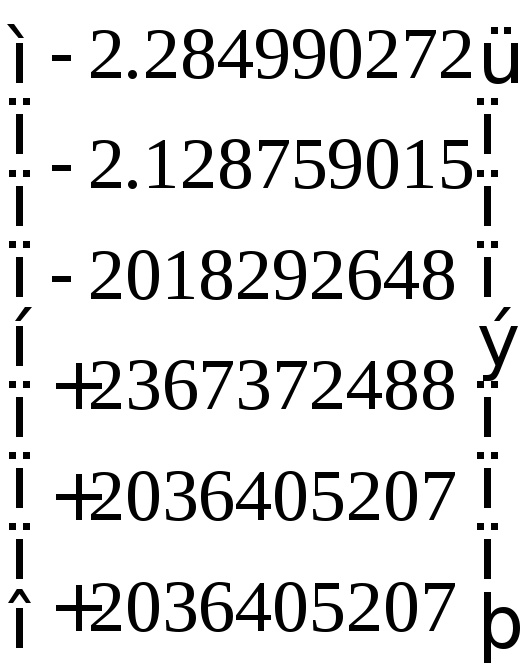

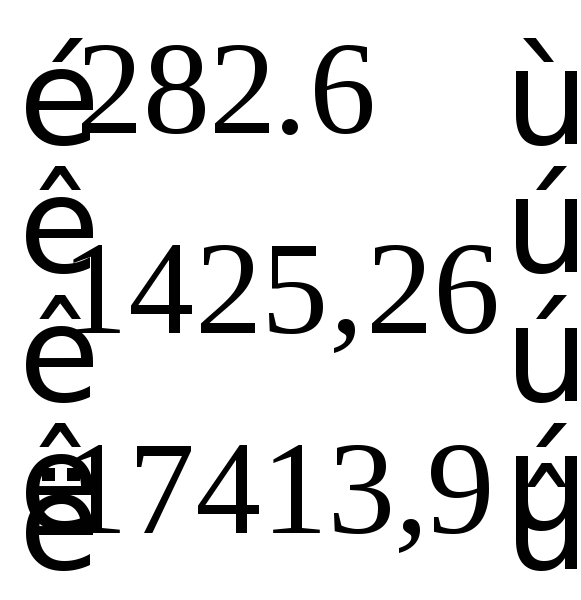

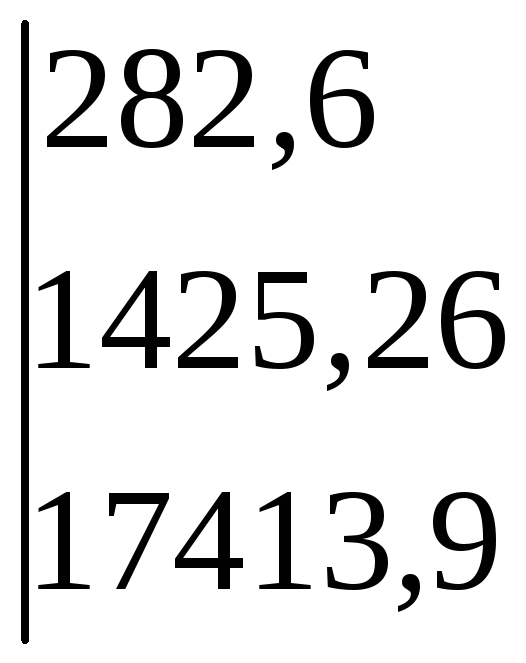

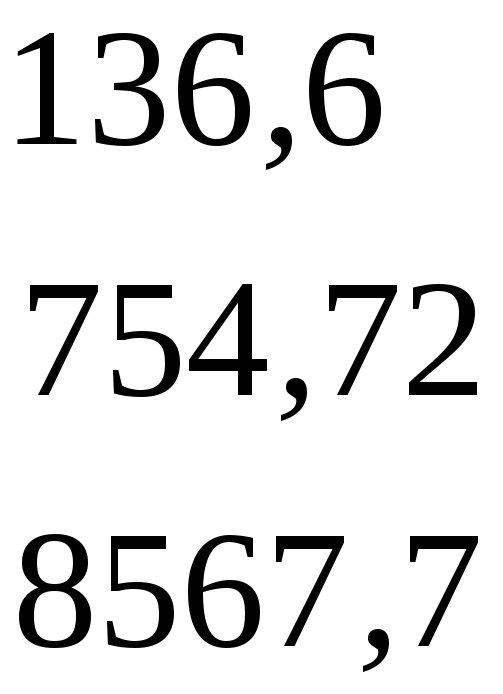

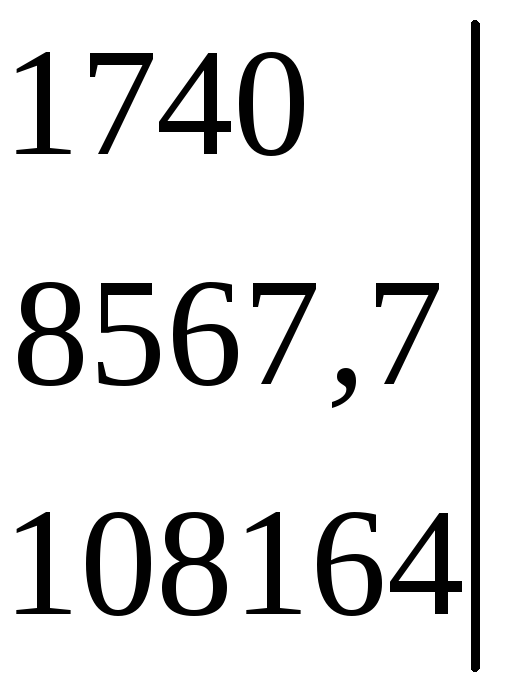

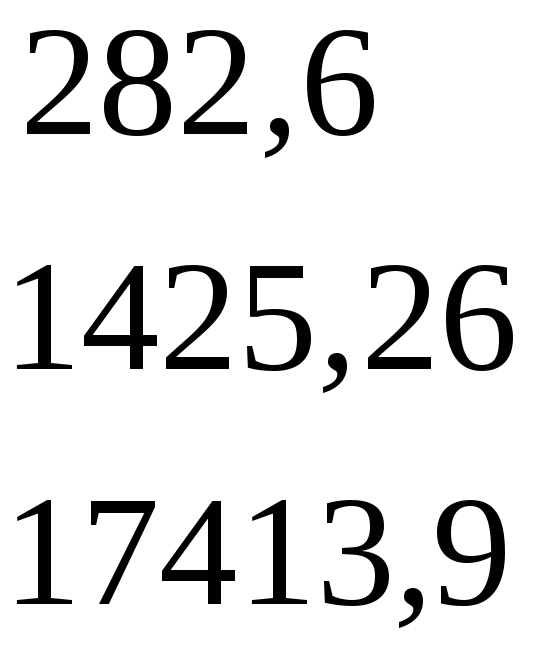

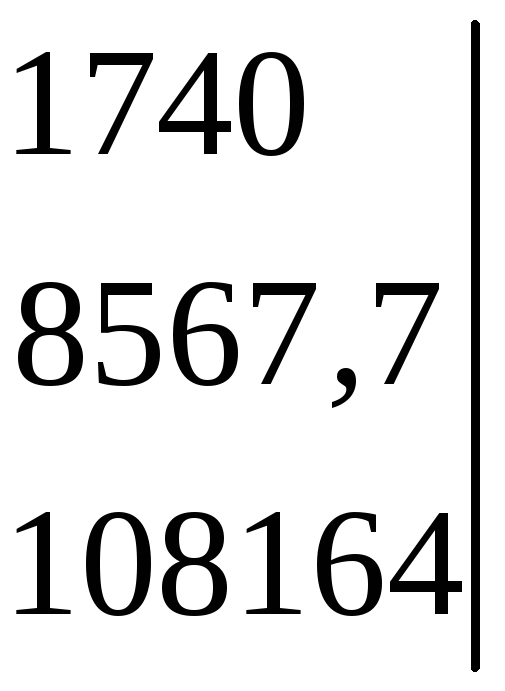

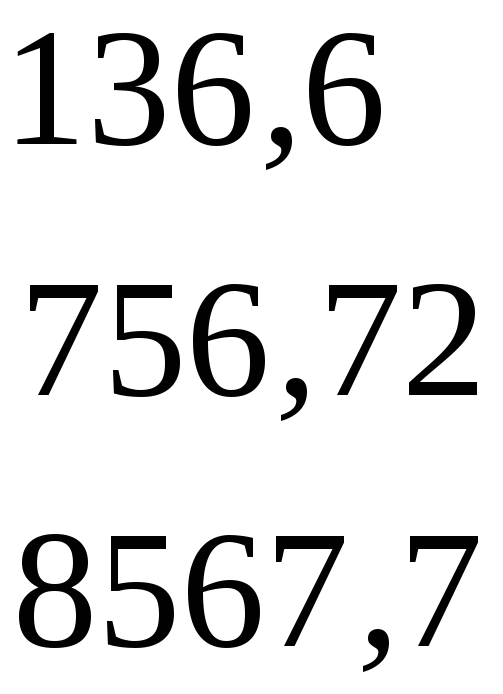

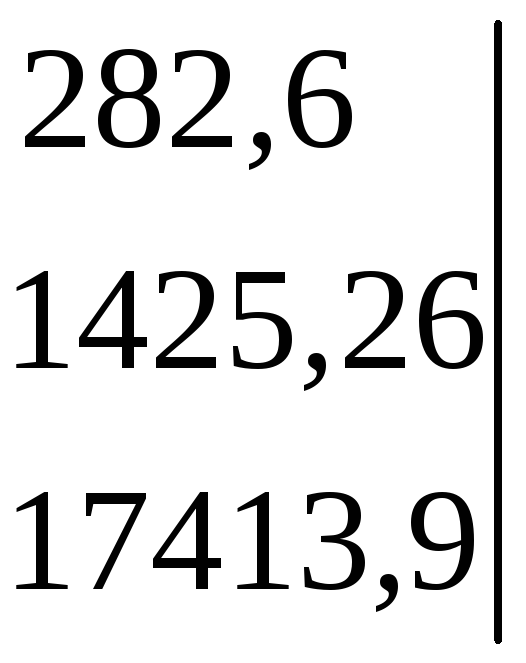

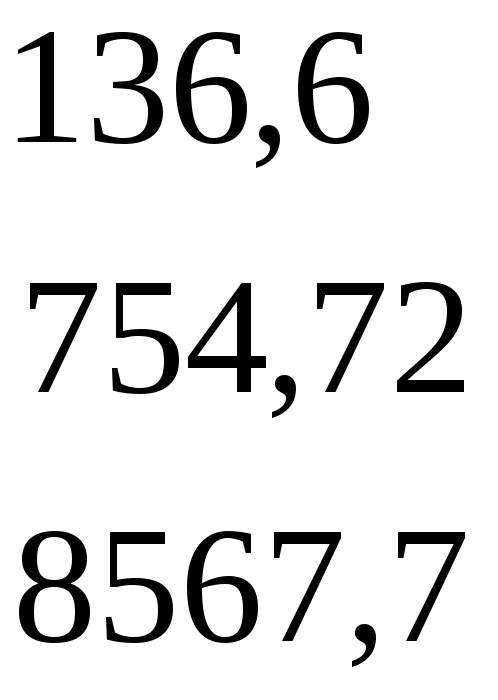

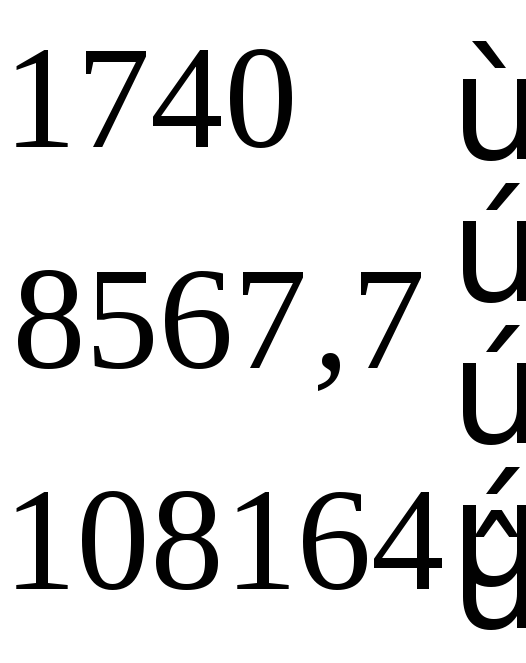

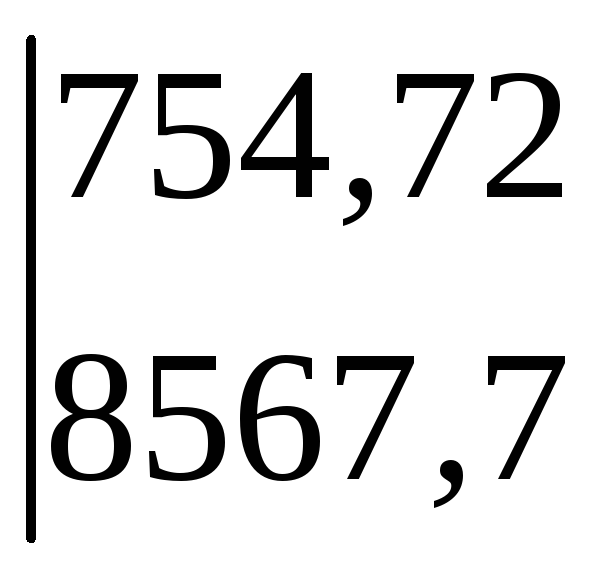

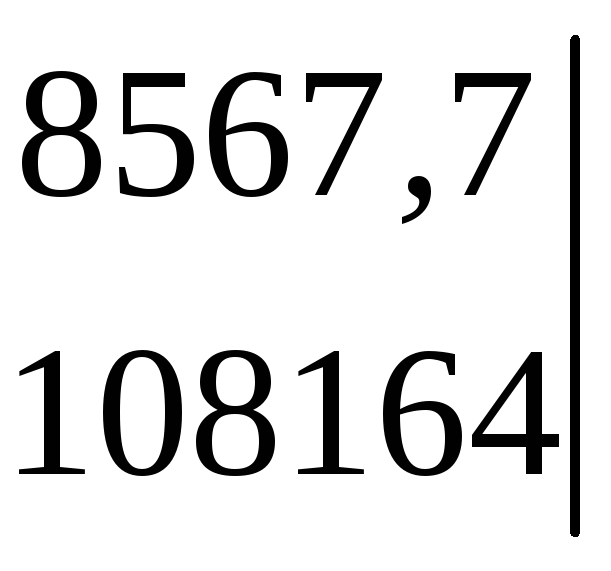

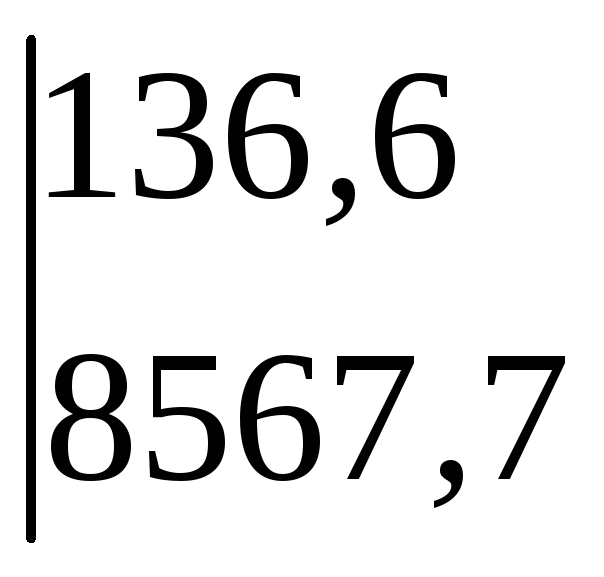

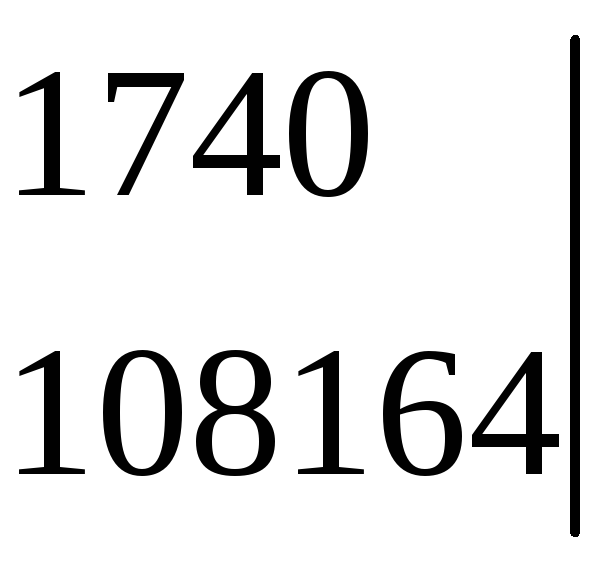

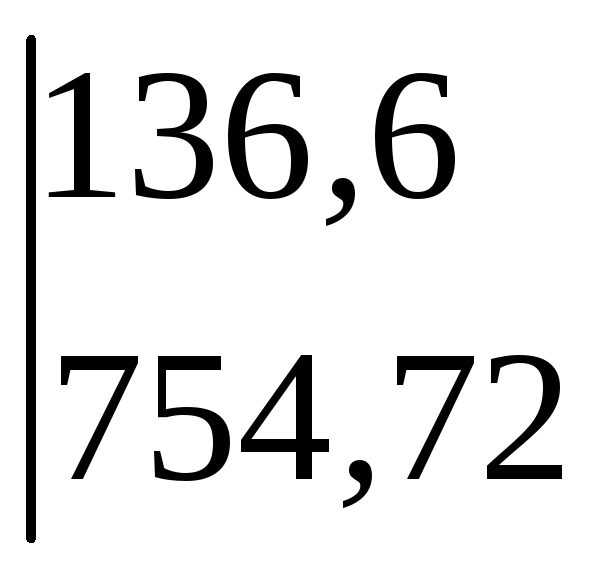

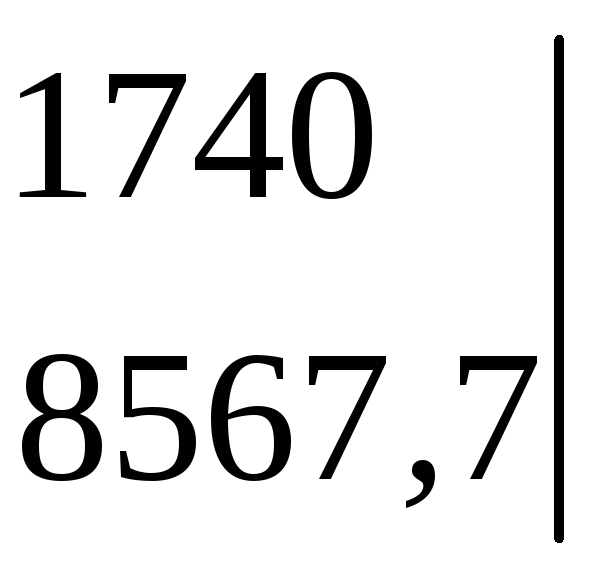

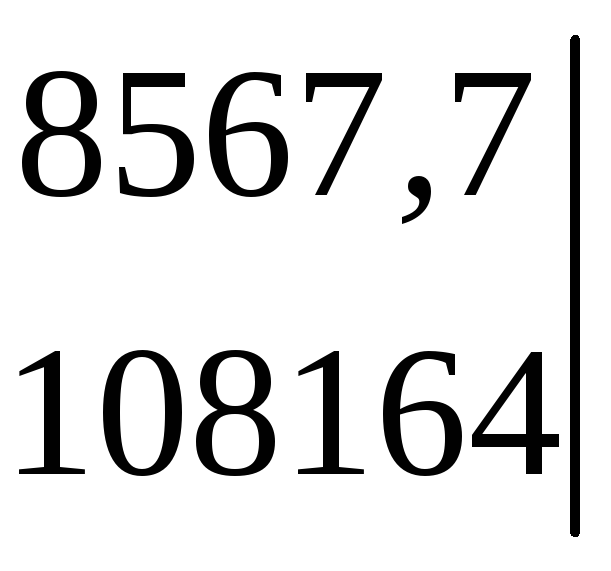

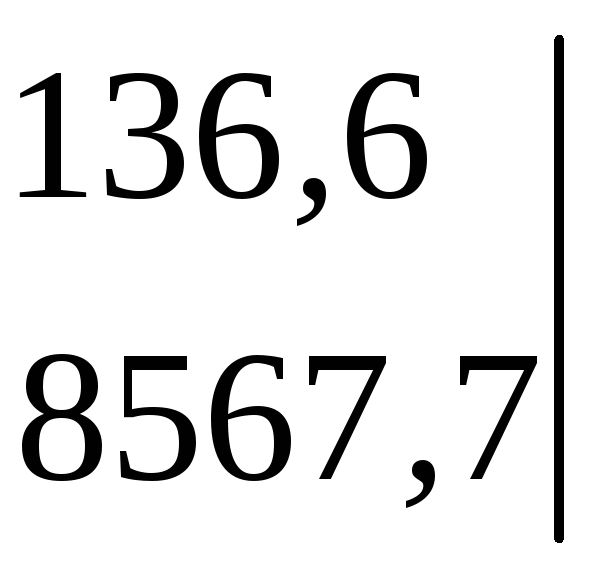

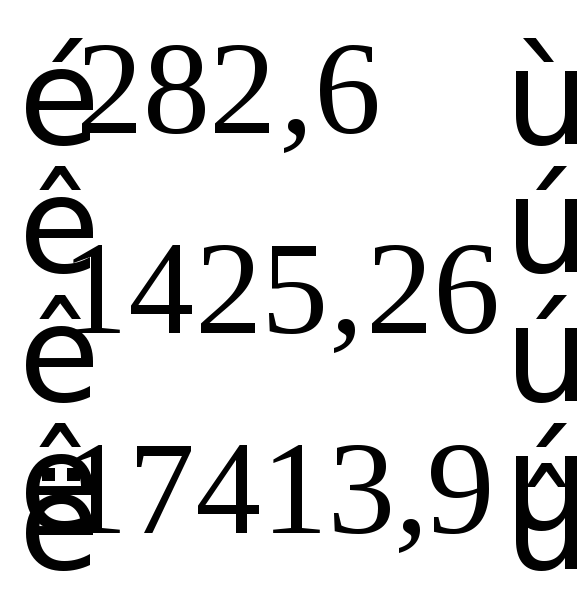

282,6 = 29 αо + 136,6 αЕ + 1740 αК,

1425,26 = 136,6 αо + 754,72 αЕ + 8567,7 αК, (3.3)

17413,9 = 1740 αо + 8567,7 αЕ + 108164 αК.

Нижче розглядаються декілька можливих способів розв’язання системи нормальних рівнянь.

• Спосіб Гаусса

Якщо вирішення системи нормальних рівнянь (3.3) виконується вручну, можна скористатися методом Гаусса послідовного вилучення невідомих. Поділимо рівняння системи на числові співмножники при αо, тобто відповідно на 29, 136,6 і 1740 і отримаємо

9,7448 = αо + 4,7103 αЕ + 60,0000 αК,

10,4338 = αо + 5,5250 αЕ + 62,7211 αК,

10,0080 = αо + 4,9240 αЕ + 62,1632 αК.

Віднімемо перше рівняння від другого і третього і отримаємо систему двох рівнянь з невідомими αЕ і αК

0,6890 = 0,8147 αЕ + 2,7211 αК,

0,2632 = 0,2137 αЕ + 2,1632 αК.

Поділимо систему рівнянь на числові співмножники при αЕ і отримаємо

0,8457 = αЕ + 3,3400 αК,

1,2316 = αЕ + 10,1226 αК.

Віднімемо перше рівняння від другого, маємо

0,3859 = 6,7826 αК,

звідки αК = 0,0569. Повертаючись послідовно до отриманих раніше рівнянь, знаходимо

αЕ = 0,6556 і αо = 3,2427.

Отже рівняння регресії рентабельності за енергоозброєністю праці і коефіцієнтом постійності складу ПВП має такий вигляд:

![]() = 3,2427 +

0,6556 Е

+ 0,0569 К. (3.4)

= 3,2427 +

0,6556 Е

+ 0,0569 К. (3.4)

У цьому рівнянні регресяї:

3,2427 – частка рентабельності, яка не задежить від Е і К і обумовлена всіма

іншими факторами, коп./ грн.;

0,6556 – підвищення рентабельності в коп./ грн. при зростанні

енергоозброєності праці на 1 кВт/ чол.;

0,0569 – підвищення рентабельності в коп./ грн. при зростанні коєфіцієнта

постійності складу ПВП на 1%.

Нехай вас не дивують десяті й соті частки копійки коефіцієнтів регресії! Допустимо, що витрати підприємства складають 10 млн. грн. Тоді вони становимимуть відповідно 65,6 та 5,69 тис. грн. зростання прибутку!

З першого рівняння системи (3.2) з урахуванням того, що

еj = yj – ŷj = yj – ао – а1 хj ,

випливає, що сума помилок (залишків) еj, а значить і їх середньоарифметичне значення дорівнюють нулю. Отже еj = 0 і тоді ŷj = yj. Це дуже важлива і необхідна ознака правильності оцінювання параметрів рівняння регресії за методом найменших квадратів.

• Спосіб детермінантів

Спосіб детермінантів (визначників) заснований на теорії матричної алгебри і пов'язаний з розрахунком визначників, кількість яких на одиницю перевищує кількість параметрів, що оцінюються.

Побудуємо матрицю числових коефіцієнтів правої частини системи нормальних рівнянь за МНК (3.3). У нашому наскрізному прикладі вона має вигляд

А

=

.

.

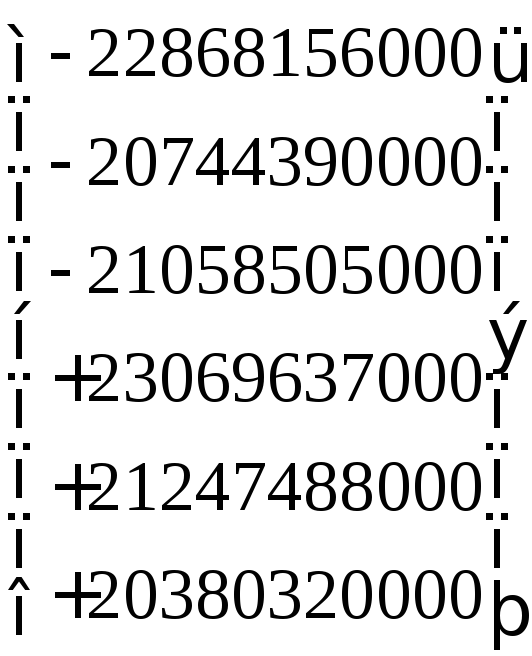

Знайдемо визначник матриці А

∆А

=

![]()

![]()

=

= = 8140967.

= 8140967.

Далі послідовно замінюватимемо стовпці матриці А стовпцем вільних членів системи нормальних рівнянь за МНК, тобто

.

.

і розрахуємо визначники ∆А0, ∆А1 і ∆А2. Покажемо визначення ∆А0:

∆А0

=

![]()

=

= = 26394000.

= 26394000.

Замінюючи в матриці А другий стовпчик стовпцем вільних членів, отримуємо

∆А1

=

![]()

= 5337218

= 5337218

і, нарешті, аналогічно

∆А2

=

![]()

= 463221.

= 463221.

Параметри рівняння регресії, включаючи ао розраховуємо за формулою

аі

=

![]() , (3.5)

, (3.5)

тобто

а0 = 26394000 / 8140967 = 3,2427,

а1 = 5337218 / 8140967 = 0,6556,

а2 = 463221 / 8140967 = 0,0569.

Отже,

маємо

![]() =

3,2427 + 0,6556Е

+ 0,0569

=

3,2427 + 0,6556Е

+ 0,0569

Таким чином ми отримали методомдетермінантів, як і сподівались, те саме рівняння регресії (3.4), що і раніше шляхом розв’язання системи нормальних рівнянь за схемою Гаусса.

• Спосіб оберненої матриці

Побудуємо матрицю, обернену до матриці А, тобто матрицю А-1. Для цього до кожного елемента аij матриці А знаходимо його алгебраїчне доповнення, тобто визначники відповідних матриць 2-го порядку. Отже матриця А така:

.

.

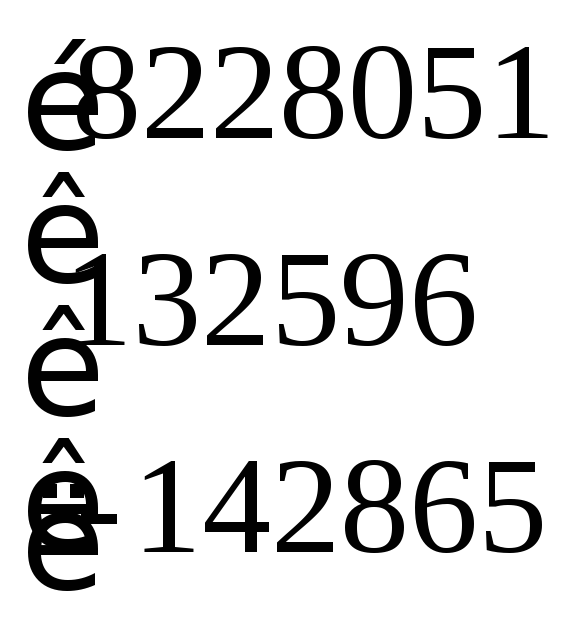

Алгебраїчне доповнення до елемента а11 = 29 – це визначник матриці без 1-го стовпця і 1-го рядка (і – номер стовпця, j – номер рядка), тобто мінор з індикатор знака – 1i+j. Отже

∆А11

=

= 81633534 – 73405483 = 8228051.

= 81633534 – 73405483 = 8228051.

Далі розрахуємо вісім інших алгебраїчних доповнень:

до елемента а12 = 136,6:

∆А12

= –

=+

132596,

=+

132596,

до елемента а13 = 1740:

∆А13

=

= –

142865,

= –

142865,

до елемента а21 = 136,6:

∆А21

= –

![]()

= + 132596,

= + 132596,

до елемента а22 = 754,72:

∆А22

=

![]()

= 109156,

= 109156,

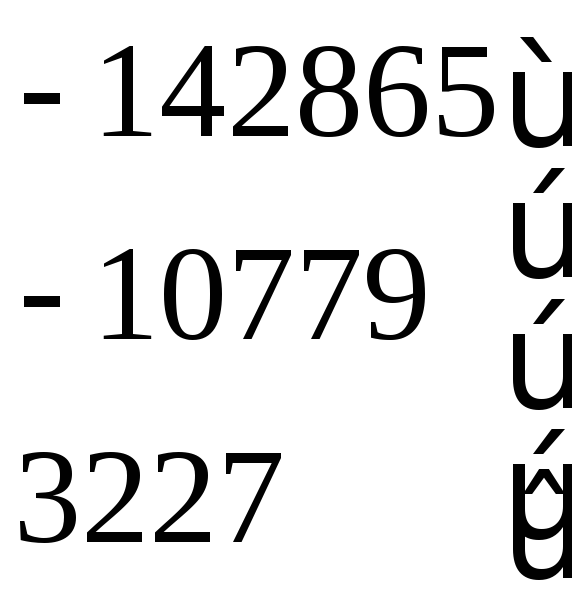

до елемента а23 =8567,7:

∆А23

= –

![]()

= –

10779,

= –

10779,

до елемента а31 = 1740:

∆А31

=

![]()

= –

142865,

= –

142865,

до елемента а32 = 8567,7:

∆А32

= –

![]()

= – 10779,

= – 10779,

до елемента а33 =108164:

∆А33

=

![]()

=

3227,

=

3227,

Обернена матриця А-1 визначається діленням матриці алгебраїчних доповнень до елементів матриці А на ії визначник ∆А:

А-1

=

![]()

![]() .

(3.6)

.

(3.6)

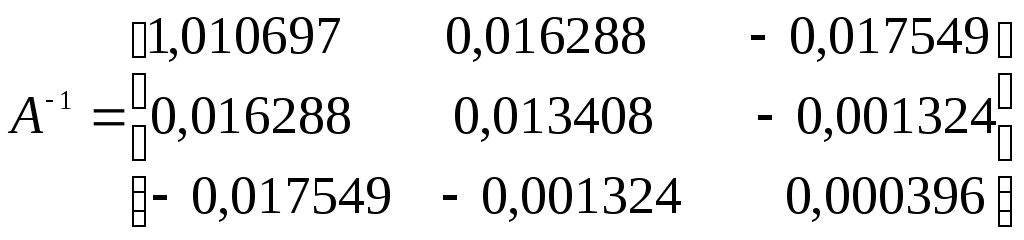

У нашому прикладі обернена матриця А-1 набуває вигляду

А-1

=

![]() *

*

=

=

.

.

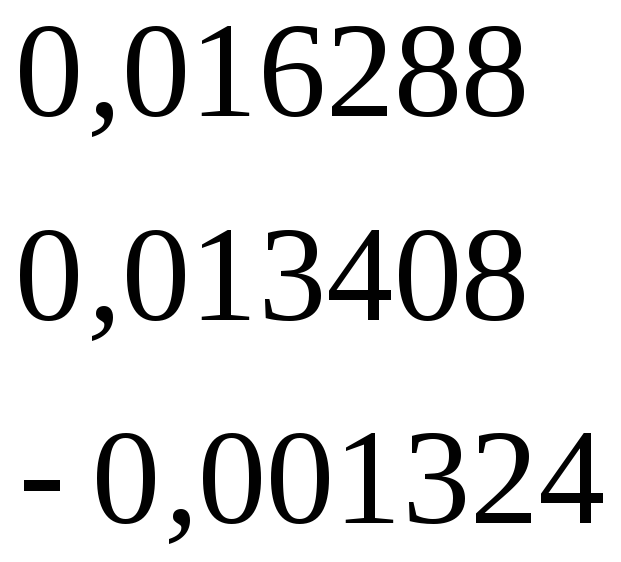

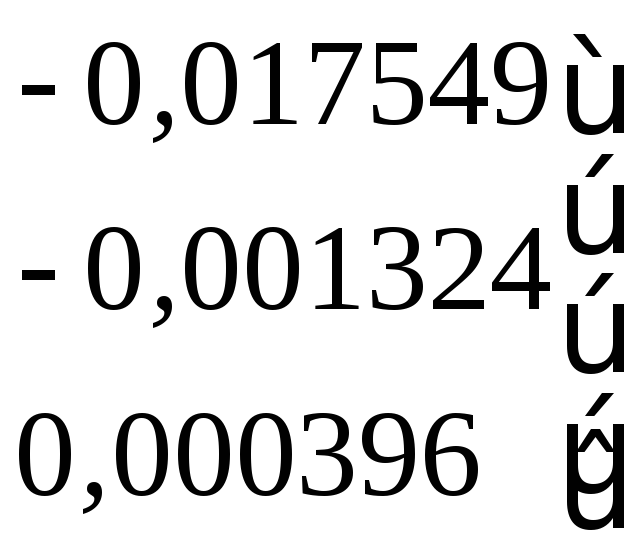

Отже обернена матриця А-1 така

(3.7)

(3.7)

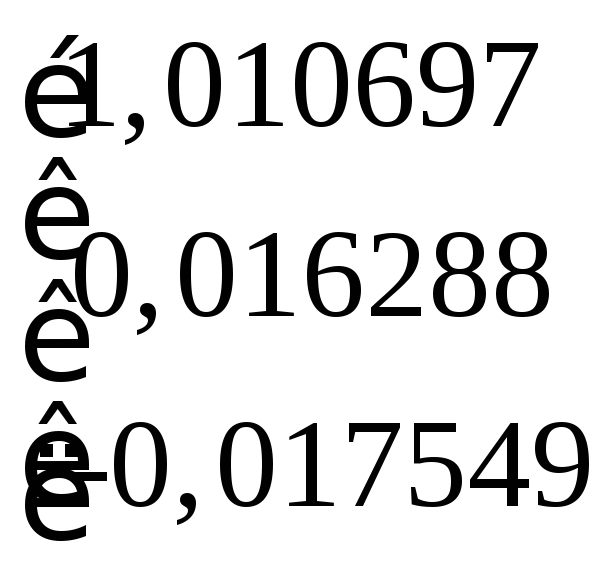

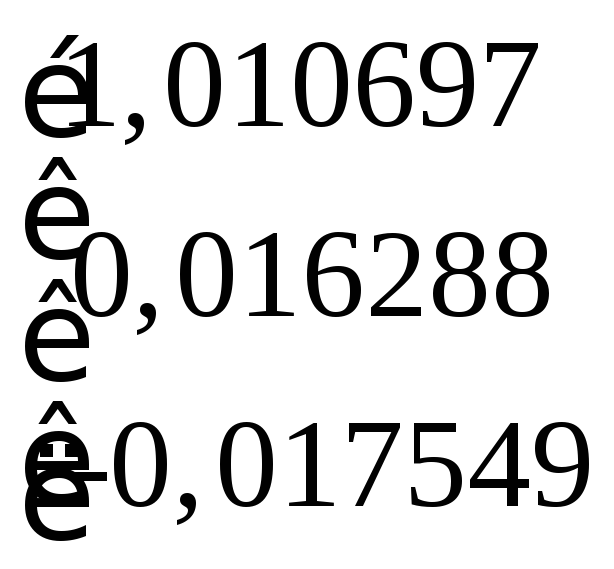

За допомогою оберненої матриці А-1 можна просто визначити коефіцієнти регресії. Для цього достатньо помножити обернену матрицю А-1 на стовпець вільних членів системи нормальних рівнянь за МНК. У нашому прикладі такий розрахунок аi виглядає так:

![]() =

=

*

* .

.

Отже

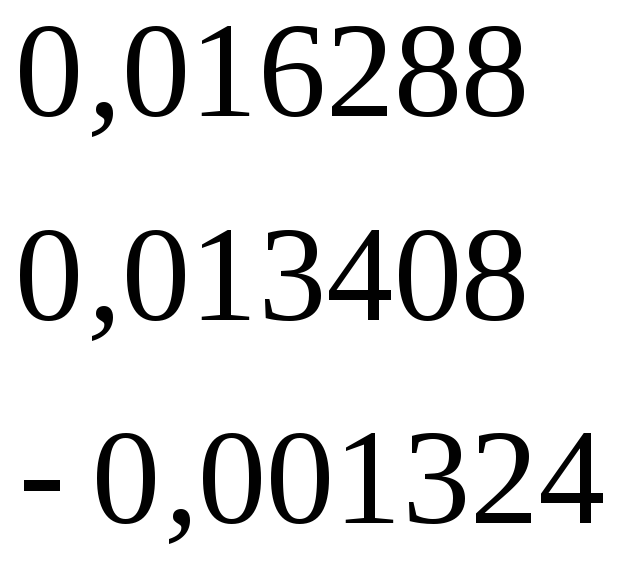

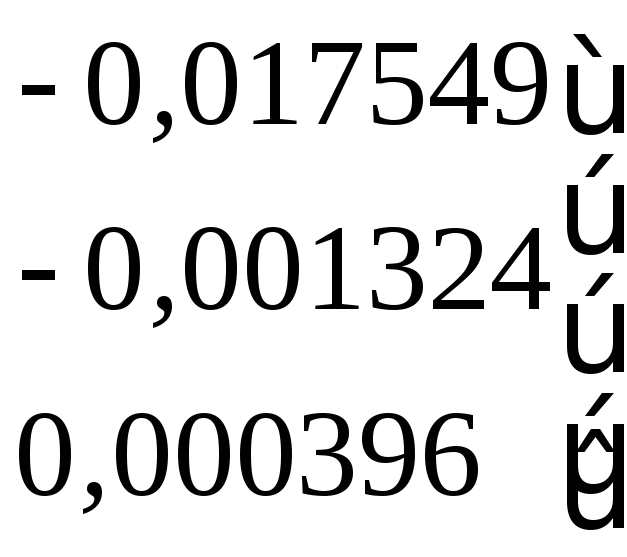

а0 = 1,010697 * 282,6 + 0,016288 * 1425,26 – 0,017549 * 17413,9 = 3,2427,

аЕ = 0,016288 * 282,6 + 0,013408 * 1425,26 – 0,001324 * 17413,9 = 0,6556,

аК = – 0,0175549 * 282,6 – 0,001324 * 1425,26 + 0,000396 * 17413,9 = 0,0569.

Ми отримали, як і сподівались, ті самі коефіцієнти регресії, як і раніше в цьому підрозділі, а також і рівняння регресії

![]() = 3,2427 +

0,6556 Е

+ 0,0569 К

= 3,2427 +

0,6556 Е

+ 0,0569 К

• Спосіб β - коефіцієнтів

Для розрахунку коефіцієнтів регресії аi можна скористатися β – коефіцієнтами, що зазвичай розраховуються раніше:

аi

=

βi

![]() .

(3.8)

.

(3.8)

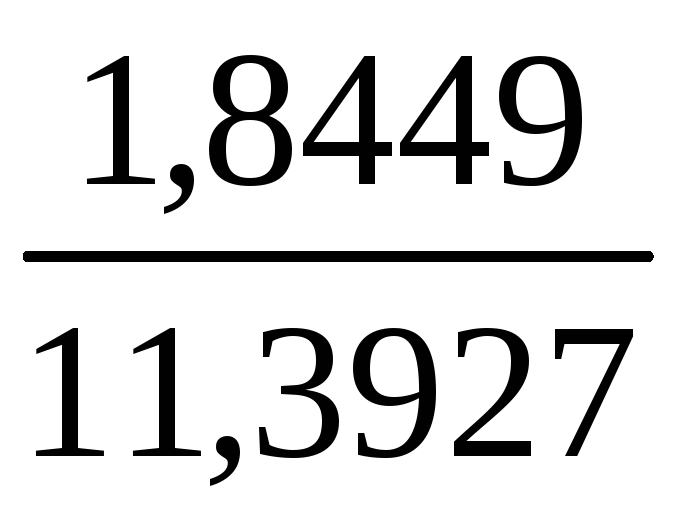

У нашому прикладі βЕ = 0,6963, βК = 0,3513, (див. підрозділ 3.5), σР = 1,8449, σЕ = 1,9591, σК = 11,3927 (див. табл 1.5). За цими даними за формулою (3.8) маємо

аЕ

= 0,6963

= 0,6556,

= 0,6556,

аК

= 0,3513

= 0,0569.

= 0,0569.

Діленням першого рівняння системи рівнянь для розрахунку параметрів аi на n маємо

![]() = αо

+ α1

= αо

+ α1

![]() 1

+ α2

1

+ α2

![]() 2

+ … + αm

2

+ … + αm

![]() m,

m,

звідки знаходимо

αо

=![]() –

α1

–

α1

![]() 1

–

α2

1

–

α2

![]() 2

–

… –

αm

2

–

… –

αm

![]() m.

(3.9)

m.

(3.9)

У нашому прикладі (див. табл 1.4)

αо = 9,7448 – 0,6556 * 4,7103 – 0,0569 * 60 = 3,2427.

Ми отримали за формулами (3.8) і (3.9) оцінки параметрів рівняння регресії, які ідентичні оцінкам, визначеним шляхом вирішення системи рівнянь за методом найменших квадратів будь-яким із наведених раніше способів.

Це і не

дивно! Адже β

–

коефіцієнти є параметрами рівняння

регресії, разрахованими методом найменших

квадратів за стандартизованими значеннями

![]() та

та![]() i

:

i

:

![]() =

=

![]() ,

,![]() I

=

I

=

![]() .

.

У стандартизованому масштабі одиницею виміру змінних як бачимо, є середньоквадратичні відхилення цих зміних. Тому і зв’язок між аi і βi такий:

аi

= βi

![]() , βi

=

аi

, βi

=

аi

![]() .

.