Лекции по МОСАПР(Комаров, МП46-47) / Lekciya_ot_23.05.02 / Лекция от 23.05.02

.rtfЛекция от 23.05.02

Метод оптимизации «случайного поиска»:

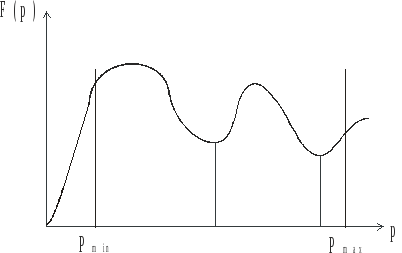

Если имеется не один минимум у целевой функции, то предыдущие случаи дадут один из этих минимумов. Т.о. мы можем пропустить «глобальный минимум».

Используя генератор случайных чисел, применяют следующий алгоритм:

Пусть например:

Рис. 4

Задаются

N-количество случайных испытаний;

вычисляется

случайная величина

В

результате получаем

;

;

-

вычисляем значение

для

всех N

испытаний;

для

всех N

испытаний; -

ранжирование

-

выстраивание значений от min

к max

значения. Затем производится усечение

-

выстраивание значений от min

к max

значения. Затем производится усечение

т.е.

оставляют «самые лучшие» точки;

т.е.

оставляют «самые лучшие» точки; -

производим перенос

;

; -

Если

то

то

,

в противном случае переходим к пункту

2.

,

в противном случае переходим к пункту

2.

Недостаток: метод гарантирует сходимость, но при «пологой» целевой функции метод сходится медленно.

Метод градиентной оптимизации

Этот метод один из самых распространенных.

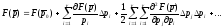

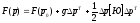

Пусть имеется целевая функция, зависящая от ν:

В более упрощенной записи:

,

,

где

или

при

при

.

.

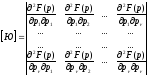

Метод оптимизации с сопряженными градиентами

где

-

матрица Гесса;

-

матрица Гесса;

Поиск минимума целевой функции производится по градиенту, учитывая результаты предыдущего поиска. Т.е. поиск по новому направлению происходит с учетом истории.